DeepSeek-R1 en DeepSeek-V3 het 'n wêreldwye sensasie veroorsaak sedert hul oopbronbekendstelling.

Hulle is 'n geskenk van die DeepSeek-span aan die hele mensdom, en ons is opreg bly vir hul sukses.

Na dae se harde werk deur die Silicon Mobility- en Huawei Cloud-spanne, gee ons vandag ook Chinese gebruikers 'n Chinese Nuwejaarsgeskenk: die grootskaalse modelwolkdiensplatform SiliconCloud het DeepSeek-V3 en DeepSeek-R1 bekend gestel, wat gebaseer is op Huawei Cloud se Ascend-wolkdiens.

Dit moet beklemtoon word dat ons groot ondersteuning van DeepSeek en Huawei Cloud ontvang het, beide in die aanpassing van DeepSeek-R1 & V3 op Ascend en in die proses om voorheen ander modelle bekend te stel, en ons wil graag diepe dankbaarheid en hoë respek betuig.

Kenmerke

Hierdie twee modelle wat deur SiliconCloud bekendgestel is, bevat hoofsaaklik vyf hoofkenmerke:

Gebaseer op Huawei Cloud se Ascend-wolkdiens, het ons die DeepSeek x Silicon Mobility x Huawei Cloud R1 & V3-modelafleidingsdiens vir die eerste keer.

Deur gesamentlike innovasie tussen die twee partye, en met die ondersteuning van die self-ontwikkelde inferensieversnellingsenjin, kan die DeepSeek-model wat deur die Silicon Mobility-span, gebaseer op Huawei Cloud se Ascend-wolkdiens ontplooi word, dieselfde effek bereik as 'n hoë-end GPU-ontplooiingsmodel in die wêreld.

Verskaf stabiele produksievlak DeepSeek-R1 & V3 afleidingsdienste. Dit stel ontwikkelaars in staat om stabiel in grootskaalse produksie-omgewings te werk en aan die behoeftes van kommersiële ontplooiing te voldoen. Huawei Cloud Ascend AI-dienste bied oorvloedige, elastiese en voldoende rekenaarkrag.

Daar is geen ontplooiingsdrempel nie, wat ontwikkelaars in staat stel om meer op toepassingsontwikkeling te fokus. Wanneer hulle toepassings ontwikkel, kan hulle die SiliconCloud API direk bel, wat 'n makliker en meer gebruikersvriendelike ervaring bied.

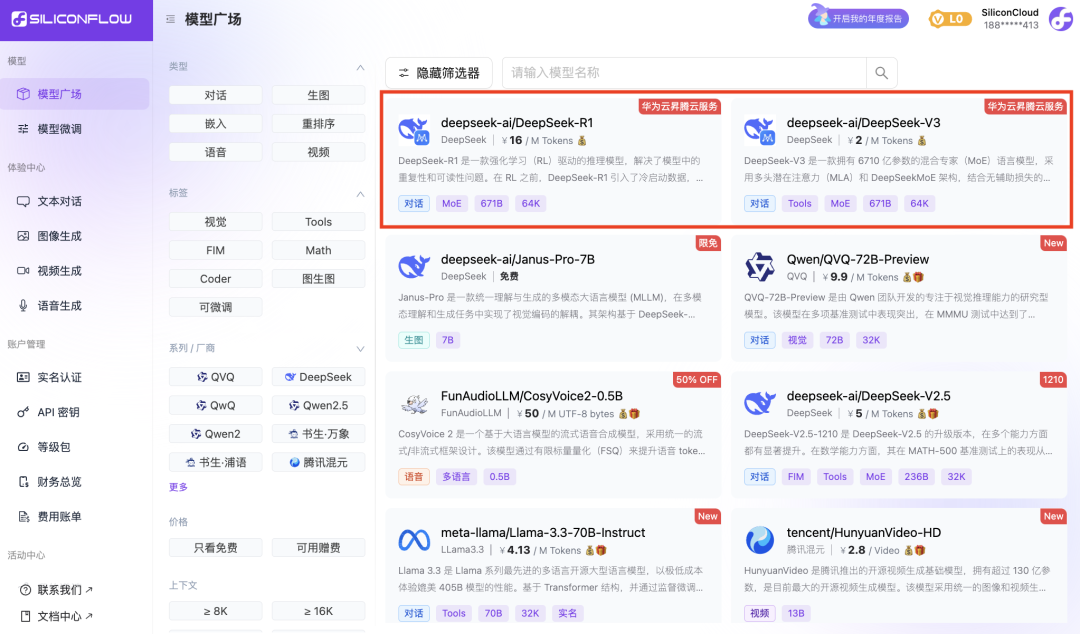

Die DeepSeek-V3-prys op SiliconCloud gedurende die amptelike afslagtydperk (tot 24:00 op 8 Februarie) is ¥1 / M-tokens (invoer) en ¥2 / M-tokens (afvoer), en die DeepSeek-R1-prys is ¥4 / M tekens (invoer) & ¥16 / M tekens (afvoer).

Aanlyn ervaring

DeepSeek-R1 met SiliconCloud

DeepSeek-V3 met SiliconCloud

API dokumentasie

Ontwikkelaars kan die effek ervaar van DeepSeek-R1 & V3 versnel op huishoudelike skyfies op SiliconCloud. Die vinniger uitsetspoed word steeds voortdurend geoptimaliseer.

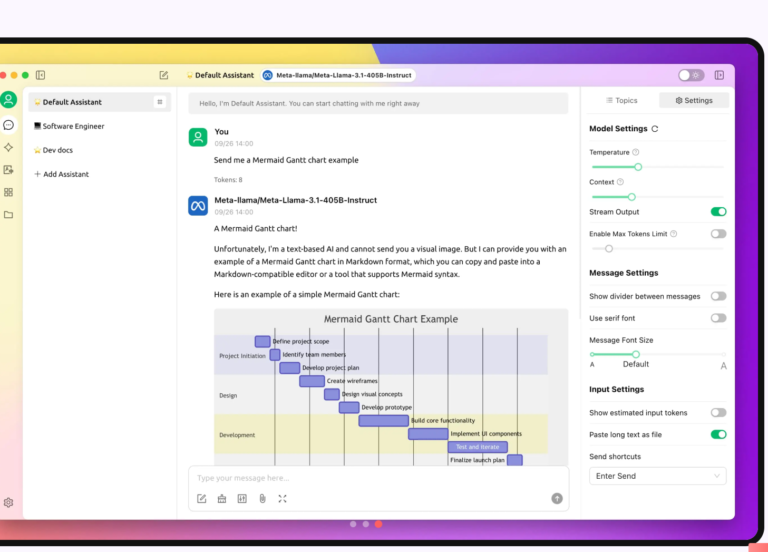

Ondervinding in kliënttoepassing

As jy die DeepSeek-R1 & V3-model direk in die kliënttoepassing wil ervaar, kan jy die volgende produkte plaaslik installeer en toegang kry tot die SiliconCloud API (jy kan hierdie twee modelle aanpas en byvoeg) om DeepSeek-R1 & V3 te ervaar.

- Groot model kliënt toepassings: ChatBox, Cherry Studio, OneAPI, LobeChat, NextChat

- Kode generering toepassings: Wyser, Windsurf, Cline

- Groot model toepassingsontwikkelingsplatform:Verskil

- KI kennisbasis:Obsidian KI, enFastGPT

- Vertaalinprop:Immersive Translate, en Eurodict

Vir meer scenario- en toepassingsgevalletoegangstutoriale, verwys asseblief na hier

Token Factory SiliconCloud

Qwen2.5 (7B), ens. 20+ modelle gratis om te gebruik

As 'n eenstop-wolkdiensplatform vir groot modelle, is SiliconCloud daartoe verbind om ontwikkelaars te voorsien van model-API's wat ultra-responsief, bekostigbaar, omvattend is en 'n syagtige ervaring het.

Benewens DeepSeek-R1 en DeepSeek-V3, het SiliconCloud ook Janus-Pro-7B, CosyVoice2, QVQ-72B-Preview, DeepSeek-VL2, DeepSeek-V2.5-1210, Llama-3.3-70B-Video-instruksie bekendgestel. , vis-spraak-1.5, Qwen2.5 -7B/14B/32B/72B, FLUX.1, InternLM2.5-20B-Chat, BCE, BGE, SenseVoice-Small, GLM-4-9B-Chat,

dosyne oopbron-groottaalmodelle, beeld-/videogenereringsmodelle, spraakmodelle, kode-/wiskundemodelle en vektor- en herrangskikkingsmodelle.

Die platform stel ontwikkelaars in staat om groot modelle van verskillende modaliteite vrylik te vergelyk en te kombineer om die beste praktyk vir jou generatiewe KI-toepassing te kies.

Onder hulle is 20+ groot model API's soos Qwen2.5 (7B) en Llama3.1 (8B) gratis om te gebruik, wat ontwikkelaars en produkbestuurders in staat stel om "tekenvryheid" te bereik sonder om bekommerd te wees oor die koste van rekenaarkrag tydens die navorsing en ontwikkelingstadium en grootskaalse bevordering.