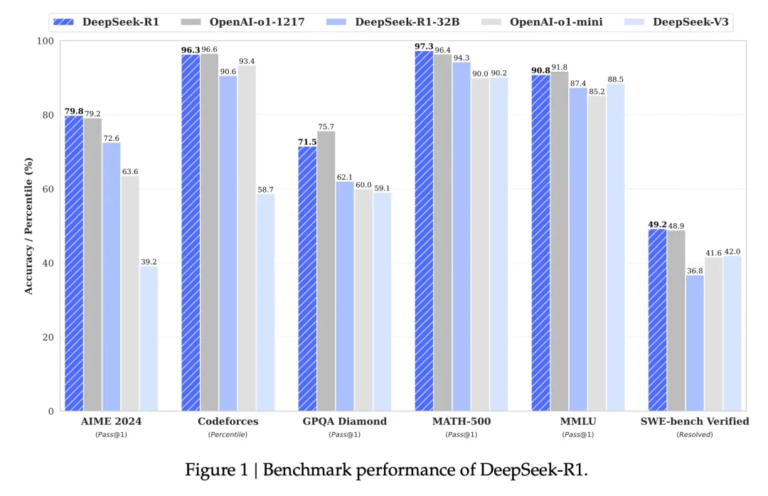

DeepSeek-R1-Technologie enthüllt: Die Kernprinzipien des Papiers werden aufgeschlüsselt und der Schlüssel zur bahnbrechenden Modellleistung wird enthüllt

Heute teilen wir DeepSeek R1, Titel: DeepSeek-R1: Förderung der Denkfähigkeit in LLMs durch bestärkendes Lernen: Förderung der Denkfähigkeit von LLMs durch bestärkendes Lernen. Dieses Dokument stellt die erste Generation von Denkmodellen von DeepSeek vor, DeepSeek-R1-Zero und DeepSeek-R1. Das Modell DeepSeek-R1-Zero wurde als erster Schritt durch groß angelegtes bestärkendes Lernen (RL) ohne überwachte Feinabstimmung (SFT) trainiert, …