Κανείς μας δεν περίμενε ότι έτσι θα ξεκινούσε το 2025 στον τομέα της τεχνητής νοημοσύνης.

DeepSeek R1 είναι πραγματικά καταπληκτικό!

Πρόσφατα, η "μυστηριώδης ανατολική δύναμη" DeepSeek "ελέγχει" σκληρά τη Silicon Valley.

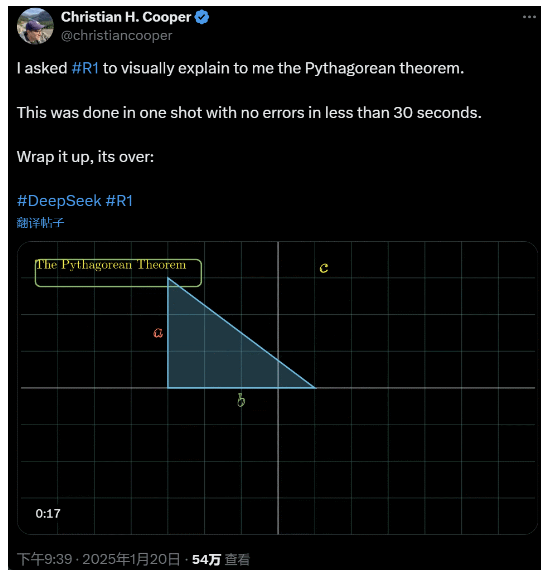

Ζήτησα από τον R1 να εξηγήσει λεπτομερώς το Πυθαγόρειο θεώρημα. Όλα αυτά έγιναν από την ΤΝ σε λιγότερο από 30 δευτερόλεπτα χωρίς κανένα λάθος. Εν ολίγοις, τελείωσε.

Στους εγχώριους και ξένους κύκλους της τεχνητής νοημοσύνης, οι απλοί διαδικτυακοί χρήστες ανακάλυψαν την εκπληκτική και ισχυρή νέα τεχνητή νοημοσύνη (η οποία είναι επίσης ανοικτού κώδικα) και οι ακαδημαϊκοί εμπειρογνώμονες φώναξαν "πρέπει να προλάβουμε". Υπάρχουν επίσης φήμες ότι οι υπερπόντιες εταιρείες AI αντιμετωπίζουν ήδη μια μεγάλη απειλή.

Πάρτε μόνο αυτό το DeepSeek R1 που κυκλοφόρησε αυτή την εβδομάδα. Η καθαρά ενισχυτική μάθηση χωρίς καμία επιβλεπόμενη εκπαίδευση είναι συγκλονιστική. Από την ανάπτυξη της βάσης Deepseek-v3 τον περασμένο Δεκέμβριο μέχρι τις τρέχουσες δυνατότητες της αλυσίδας σκέψης που είναι συγκρίσιμες με το OpenAI o1, φαίνεται ότι είναι θέμα χρόνου.

Αλλά ενώ η κοινότητα της τεχνητής νοημοσύνης είναι απασχολημένη με την ανάγνωση τεχνικών εκθέσεων και τη σύγκριση πραγματικών μετρήσεων, ο κόσμος εξακολουθεί να έχει αμφιβολίες σχετικά με το R1: εκτός από το ότι μπορεί να ξεπεράσει ένα σωρό συγκριτικά στοιχεία, μπορεί πραγματικά να οδηγήσει;

Μπορεί να κατασκευάσει τις δικές του προσομοιώσεις "φυσικών νόμων";

Δεν το πιστεύετε; Ας αφήσουμε το μεγάλο μοντέλο να παίξει με ένα φλιπεράκι;

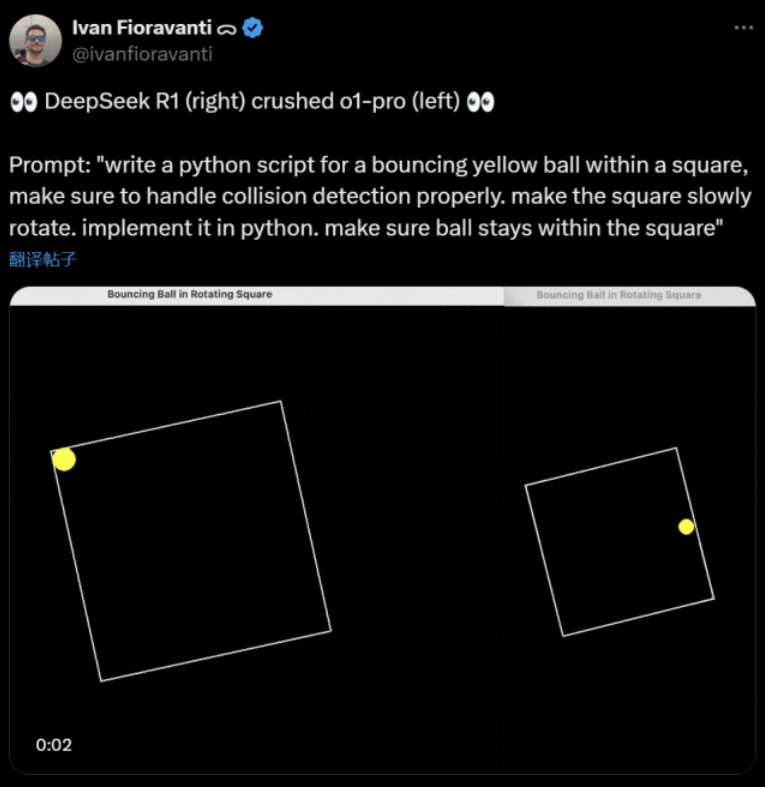

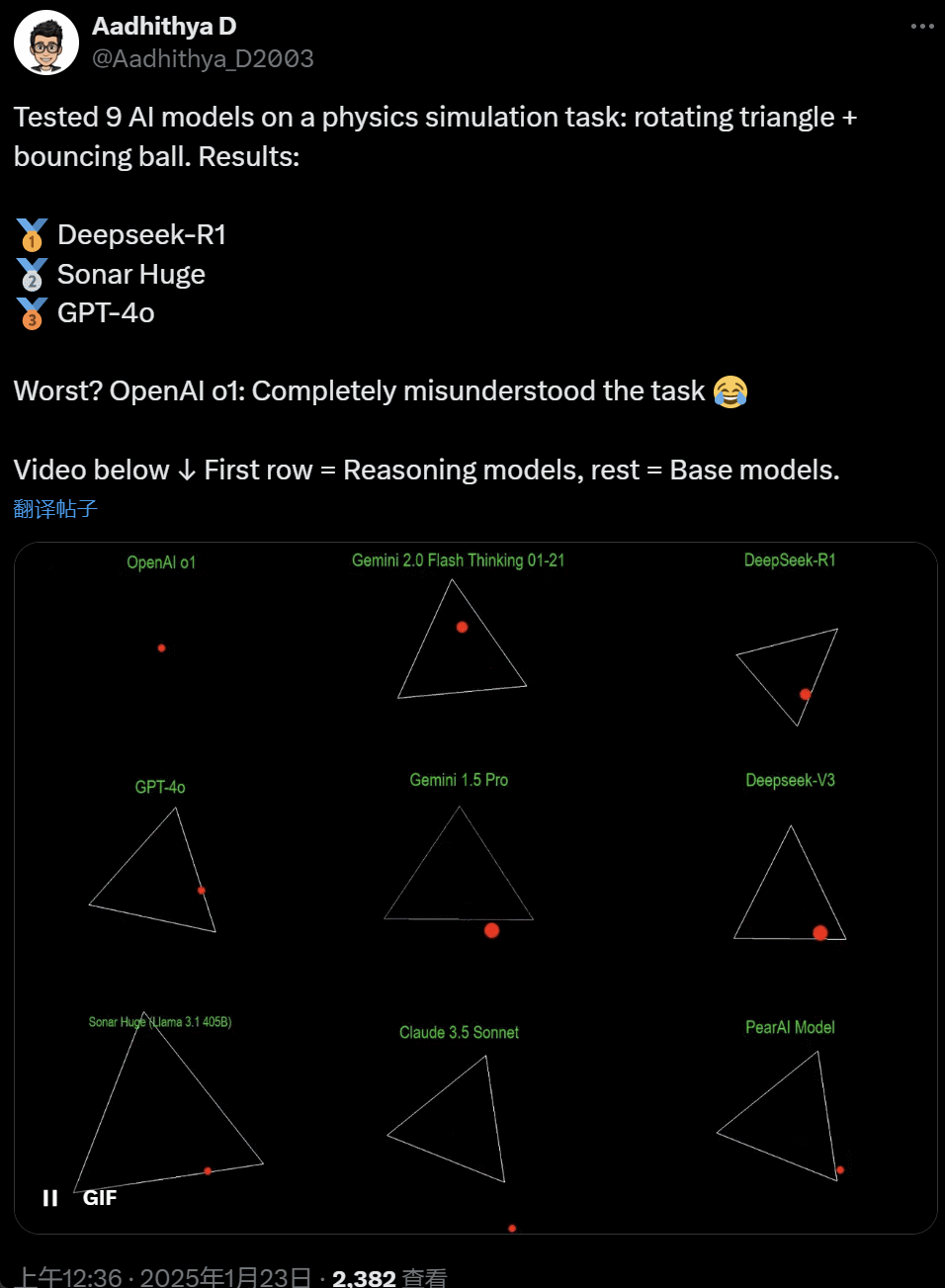

Τις τελευταίες ημέρες, ορισμένοι άνθρωποι στην κοινότητα της τεχνητής νοημοσύνης έχουν πάθει εμμονή με ένα τεστ - δοκιμή διαφορετικών μεγάλων μοντέλων τεχνητής νοημοσύνης (ειδικά των λεγόμενων μοντέλων συλλογισμού) για την επίλυση ενός προβλήματος: "Γράψε ένα σενάριο Python για να κάνεις μια κίτρινη μπάλα να αναπηδήσει μέσα σε ένα συγκεκριμένο σχήμα. Κάντε το σχήμα να περιστρέφεται αργά και βεβαιωθείτε ότι η μπάλα παραμένει μέσα στο σχήμα".

Ορισμένα μοντέλα υπερτερούν έναντι άλλων σε αυτό το σημείο αναφοράς "περιστρεφόμενης μπάλας". Σύμφωνα με τον CTO της CoreView Ivan Fioravanti, το DeepSeek, ένα εγχώριο εργαστήριο τεχνητής νοημοσύνης, διαθέτει ένα μεγάλο μοντέλο R1 ανοιχτού κώδικα που κερδίζει το μοντέλο o1 pro του OpenAI, το οποίο κοστίζει $200 το μήνα ως μέρος του προγράμματος ChatGPT Pro του OpenAI.

Στα αριστερά είναι το OpenAI o1 και στα δεξιά το DeepSeek R1. Όπως αναφέρθηκε παραπάνω, η προτροπή εδώ είναι: "γράψτε ένα σενάριο python για μια κίτρινη μπάλα που αναπηδά μέσα σε ένα τετράγωνο, βεβαιωθείτε ότι χειρίζεστε σωστά την ανίχνευση σύγκρουσης. κάντε το τετράγωνο να περιστρέφεται αργά. υλοποιήστε το σε python. βεβαιωθείτε ότι η μπάλα παραμένει μέσα στο τετράγωνο."

Σύμφωνα με έναν άλλο χρήστη στο X, τα μοντέλα Anthropic Claude 3.5 Sonnet και Gemini 1.5 Pro της Google έκαναν λανθασμένες εκτιμήσεις σχετικά με τις φυσικές αρχές, με αποτέλεσμα η μπάλα να αποκλίνει από το σχήμα της. Ορισμένοι χρήστες ανέφεραν επίσης ότι το πιο πρόσφατο Gemini 2.0 Flash Thinking Experimental της Google, καθώς και το σχετικά παλαιότερο OpenAI GPT-4o, πέρασαν αμέσως την αξιολόγηση.

Αλλά υπάρχει τρόπος να καταλάβετε τη διαφορά εδώ:

Οι Netizens κάτω από αυτό το tweet είπαν: Η ικανότητα του o1 ήταν αρχικά πολύ καλή, αλλά έγινε πιο αδύναμη μετά τη βελτιστοποίηση της ταχύτητας από το OpenAI, ακόμη και με την έκδοση συνδρομής $200/μήνα.

Η προσομοίωση μιας μπάλας που αναπηδά είναι μια κλασική πρόκληση προγραμματισμού. Η ακριβής προσομοίωση συνδυάζει αλγορίθμους ανίχνευσης σύγκρουσης, οι οποίοι πρέπει να εντοπίζουν πότε δύο αντικείμενα (όπως μια μπάλα και η πλευρά ενός σχήματος) συγκρούονται. Ένας λανθασμένα γραμμένος αλγόριθμος μπορεί να επηρεάσει την απόδοση της προσομοίωσης ή να προκαλέσει εμφανή φυσικά σφάλματα.

Ο N8 Programs, ερευνητής στην AI startup Nous Research, δήλωσε ότι του πήρε περίπου δύο ώρες για να γράψει από το μηδέν μια μπάλα που αναπηδά σε ένα περιστρεφόμενο επτάγωνο. "Πρέπει να παρακολουθούνται πολλαπλά συστήματα συντεταγμένων, απαιτείται κατανόηση του τρόπου με τον οποίο αντιμετωπίζονται οι συγκρούσεις σε κάθε σύστημα και ο κώδικας πρέπει να σχεδιαστεί από το μηδέν για να είναι εύρωστος".

Παρόλο που οι μπάλες που αναπηδούν και τα περιστρεφόμενα σχήματα αποτελούν μια λογική δοκιμασία των δεξιοτήτων προγραμματισμού, εξακολουθούν να είναι νέα έργα για μεγάλα μοντέλα, και ακόμη και μικρές αλλαγές στις οδηγίες μπορούν να οδηγήσουν σε διαφορετικά αποτελέσματα. Έτσι, αν πρόκειται τελικά να γίνει μέρος του τεστ αναφοράς για μεγάλα μοντέλα τεχνητής νοημοσύνης, χρειάζεται ακόμη να βελτιωθεί.

Σε κάθε περίπτωση, μετά από αυτό το κύμα πρακτικών δοκιμών, έχουμε μια αίσθηση των διαφορών στις δυνατότητες μεταξύ των μεγάλων μοντέλων.

Το DeepSeek είναι ο νέος "μύθος της Silicon Valley".

Το DeepSeek προκαλεί πανικό" σε όλο τον Ειρηνικό.

Οι υπάλληλοι της Meta έχουν δημοσιεύσει ότι "οι μηχανικοί της Meta αναλύουν μανιωδώς το DeepSeek για να προσπαθήσουν να αντιγράψουν οτιδήποτε μπορούν από αυτό".

Ο Alexandr Wang, ιδρυτής της νεοφυούς εταιρείας τεχνολογίας AI Scale AI, δήλωσε επίσης δημοσίως ότι η απόδοση του μεγάλου μοντέλου AI του DeepSeek είναι περίπου ισοδύναμη με το καλύτερο μοντέλο στις Ηνωμένες Πολιτείες.

Πιστεύει επίσης ότι οι Ηνωμένες Πολιτείες μπορεί να ήταν μπροστά από την Κίνα στον ανταγωνισμό της τεχνητής νοημοσύνης την τελευταία δεκαετία, αλλά η κυκλοφορία του μεγάλου μοντέλου AI της DeepSeek μπορεί να "αλλάξει τα πάντα".

Ο X Blogger @8teAPi πιστεύει ότι το DeepSeek δεν είναι ένα "παράπλευρο έργο", αλλά είναι σαν το πρώην "Skunk Works" της Lockheed Martin.

Το λεγόμενο "Skunk Works" αναφέρεται σε μια άκρως εμπιστευτική, σχετικά ανεξάρτητη μικρή ομάδα που η Lockheed Martin δημιούργησε αρχικά για την ανάπτυξη πολλών προηγμένων αεροσκαφών, η οποία ασχολείται με την έρευνα και την ανάπτυξη τεχνολογιών αιχμής ή αντισυμβατικών τεχνολογιών. Από το αναγνωριστικό αεροσκάφος U-2 και το SR-71 Blackbird μέχρι το F-22 Raptor και το μαχητικό F-35 Lightning II, όλα προήλθαν από εδώ.

Αργότερα, ο όρος εξελίχθηκε σταδιακά σε έναν γενικό όρο που χρησιμοποιείται για να περιγράψει "μικρές αλλά ωραίες", σχετικά ανεξάρτητες και πιο ευέλικτες ομάδες καινοτομίας που δημιουργούνται στο πλαίσιο μεγάλων εταιρειών ή οργανισμών.

Ανέφερε δύο λόγους:

- Από τη μία πλευρά, το DeepSeek διαθέτει μεγάλο αριθμό GPU, σύμφωνα με πληροφορίες περισσότερες από 10.000, και ο Alexandr Wang, CEO της Scale AI, δήλωσε μάλιστα ότι μπορεί να φτάσει τις 50.000.

- Από την άλλη πλευρά, το DeepSeek προσλαμβάνει ταλέντα μόνο από τα τρία κορυφαία πανεπιστήμια της Κίνας, πράγμα που σημαίνει ότι το DeepSeek είναι εξίσου ανταγωνιστικό με την Alibaba και την Tencent.

Αυτά τα δύο γεγονότα από μόνα τους δείχνουν ότι το DeepSeek έχει σαφώς επιτύχει εμπορική επιτυχία και είναι αρκετά γνωστό ώστε να αποκτήσει αυτούς τους πόρους.

Όσον αφορά το κόστος ανάπτυξης του DeepSeek, ο blogger δήλωσε ότι οι κινεζικές εταιρείες τεχνολογίας μπορούν να λάβουν διάφορες επιδοτήσεις, όπως χαμηλό κόστος ηλεκτρικής ενέργειας και χρήση γης.

Ως εκ τούτου, είναι πολύ πιθανό ότι το μεγαλύτερο μέρος του κόστους του DeepSeek έχει "τοποθετηθεί" σε λογαριασμό εκτός της κύριας δραστηριότητας ή με τη μορφή κάποιου είδους επιδότησης για την κατασκευή κέντρων δεδομένων.

Ακόμη και εκτός από τους ιδρυτές, κανείς δεν κατανοεί πλήρως όλες τις οικονομικές ρυθμίσεις. Ορισμένες συμφωνίες μπορεί να είναι απλώς "προφορικές συμφωνίες" που οριστικοποιούνται με βάση τη φήμη και μόνο.

Ανεξάρτητα από αυτό, μερικά πράγματα είναι ξεκάθαρα:

- Το μοντέλο είναι εξαιρετικό, συγκρίσιμο με την έκδοση που κυκλοφόρησε το OpenAI πριν από δύο μήνες, και φυσικά είναι πιθανό να μην είναι τόσο καλό όσο τα νέα μοντέλα που το OpenAI και η Anthropic δεν έχουν ακόμη κυκλοφορήσει.

- Από την τρέχουσα προοπτική, η κατεύθυνση της έρευνας εξακολουθεί να κυριαρχείται από αμερικανικές εταιρείες. Το μοντέλο DeepSeek είναι μια "γρήγορη συνέχεια" της έκδοσης o1, αλλά η πρόοδος της έρευνας και της ανάπτυξης του DeepSeek είναι πολύ γρήγορη, καλύπτοντας ταχύτερα από το αναμενόμενο. Δεν κάνουν λογοκλοπή ή εξαπάτηση, το πολύ-πολύ να κάνουν αντίστροφη μηχανική.

- Το DeepSeek εκπαιδεύει κυρίως τα δικά του ταλέντα, αντί να βασίζεται σε διδακτορικά που έχουν εκπαιδευτεί στην Αμερική, γεγονός που διευρύνει σημαντικά τη δεξαμενή ταλέντων.

- Σε σύγκριση με τις αμερικανικές εταιρείες, η DeepSeek υπόκειται σε λιγότερους περιορισμούς όσον αφορά την αδειοδότηση πνευματικής ιδιοκτησίας, την προστασία της ιδιωτικής ζωής, την ασφάλεια, την πολιτική κ.λπ. και υπάρχουν λιγότερες ανησυχίες σχετικά με την αθέμιτη χρήση δεδομένων στα οποία οι άνθρωποι δεν θέλουν να εκπαιδεύονται. Υπάρχουν λιγότερες αγωγές, λιγότεροι δικηγόροι και λιγότερες ανησυχίες.

Δεν υπάρχει αμφιβολία ότι όλο και περισσότεροι άνθρωποι πιστεύουν ότι το 2025 θα είναι ένα καθοριστικό έτος. Εν τω μεταξύ, οι εταιρείες προετοιμάζονται γι' αυτό. Η Meta, για παράδειγμα, κατασκευάζει ένα κέντρο δεδομένων 2GW+, με εκτιμώμενη επένδυση $60-65 δισεκατομμυρίων μέχρι το 2025, και θα διαθέτει περισσότερες από 1,3 εκατομμύρια GPU μέχρι το τέλος του έτους.

Η Meta χρησιμοποίησε ακόμη και ένα διάγραμμα για να συγκρίνει το κέντρο δεδομένων των 2 γιγαβάτ με το Μανχάταν της Νέας Υόρκης.

Αλλά τώρα το DeepSeek τα κατάφερε καλύτερα με χαμηλότερο κόστος και λιγότερες GPU. Πώς μπορεί αυτό να μην κάνει τους ανθρώπους να ανησυχούν;

Yann LeCun: CTO και συνιδρυτή της το ανοιχτός κώδικας

Hyperbolic, Yuchen Jin, για την ανάρτηση ότι μέσα σε μόλις 4 ημέρες, το DeepSeek-R1 μας απέδειξε 4 γεγονότα:

- Η AI ανοιχτού κώδικα είναι μόνο 6 μήνες πίσω από την AI κλειστού κώδικα

- Η Κίνα κυριαρχεί στον διαγωνισμό AI ανοιχτού κώδικα

- Μπαίνουμε στη χρυσή εποχή της ενισχυτικής μάθησης μεγάλων γλωσσικών μοντέλων

- Τα μοντέλα απόσταξης είναι πολύ ισχυρά, και θα τρέξουμε εξαιρετικά έξυπνη τεχνητή νοημοσύνη σε κινητά τηλέφωνα

Η αλυσιδωτή αντίδραση που προκλήθηκε από το DeepSeek συνεχίζεται ακόμα, όπως η ελεύθερη διάθεση του OpenAI o3-mini, η ελπίδα στην κοινότητα να μειωθούν οι ασαφείς συζητήσεις για AGI/ASI και η φήμη ότι η Meta βρίσκεται σε πανικό.

Πιστεύει ότι είναι δύσκολο να προβλέψουμε ποιος θα κερδίσει τελικά, αλλά δεν πρέπει να ξεχνάμε τη δύναμη του πλεονεκτήματος του καθυστερημένου. Εξάλλου, όλοι γνωρίζουμε ότι η Google ήταν αυτή που εφηύρε το Transformer, ενώ το OpenAI ξεκλείδωσε τις πραγματικές δυνατότητές του.

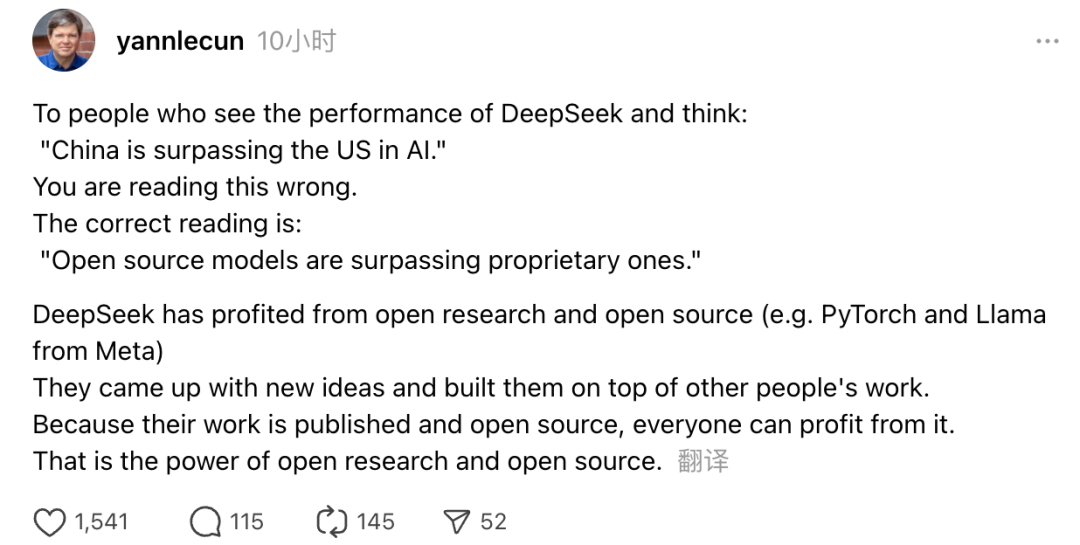

Επιπλέον, ο νικητής του βραβείου Turing και επικεφαλής επιστήμονας της Meta για την τεχνητή νοημοσύνη Yann LeCun εξέφρασε επίσης τις απόψεις του.

"Όσοι, βλέποντας τις επιδόσεις του DeepSeek, σκέφτονται ότι "η Κίνα ξεπερνά τις ΗΠΑ στην τεχνητή νοημοσύνη", κάνουν λάθος. Η σωστή αντίληψη είναι ότι τα μοντέλα ανοιχτού κώδικα ξεπερνούν τα ιδιόκτητα μοντέλα".

Ο LeCun δήλωσε ότι ο λόγος που το DeepSeek έκανε τόσο μεγάλη επιτυχία αυτή τη φορά είναι επειδή επωφελήθηκε από την ανοιχτή έρευνα και τον ανοιχτό κώδικα (όπως το PyTorch και το Llama της Meta). Το DeepSeek παρουσίασε νέες ιδέες και βασίστηκε στο έργο άλλων. Επειδή το έργο τους είναι δημοσιευμένο και ανοιχτού κώδικα, όλοι μπορούν να επωφεληθούν από αυτό. Αυτή είναι η δύναμη της ανοικτής έρευνας και του ανοικτού κώδικα.

Οι προβληματισμοί των διαδικτυακών πολιτών συνεχίζονται. Ενώ είναι ενθουσιασμένοι με την ανάπτυξη των νέων τεχνολογιών, μπορούν επίσης να νιώσουν μια μικρή ατμόσφαιρα ανησυχίας. Εξάλλου, η εμφάνιση των DeepSeekers μπορεί να έχει πραγματικό αντίκτυπο.