¡Últimas noticias! Un investigador de DeepSeek revela en línea: el entrenamiento de R1 solo tomó dos o tres semanas, y se observó una poderosa evolución de R1 cero durante las vacaciones del Año Nuevo chino

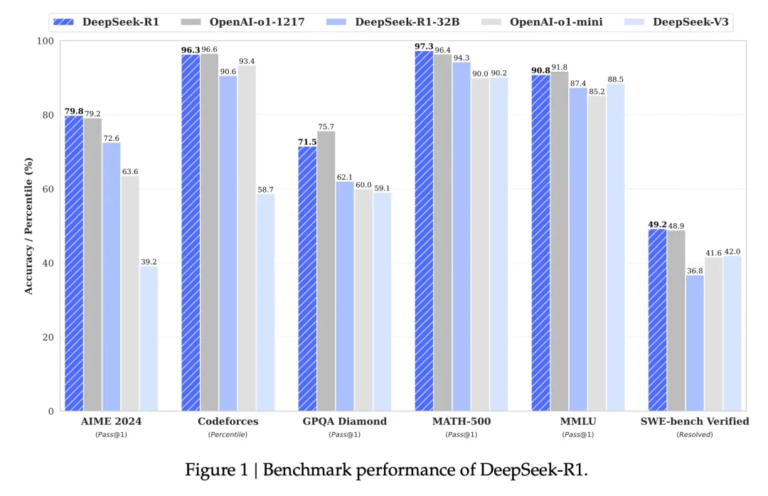

¡Últimas noticias! El investigador de DeepSeek revela en línea: el entrenamiento de R1 solo tomó dos o tres semanas, y se observó una poderosa evolución de R1 zero durante las vacaciones del Año Nuevo chino Hace un momento, notamos que el investigador de DeepSeek, Daya Guo, respondió a las preguntas de los internautas sobre DeepSeek R1 y los planes de la compañía para el futuro. Solo podemos decir…