En Google Géminis 2.0 ¡La familia finalmente está completa! Domina las listas de éxitos desde su lanzamiento.

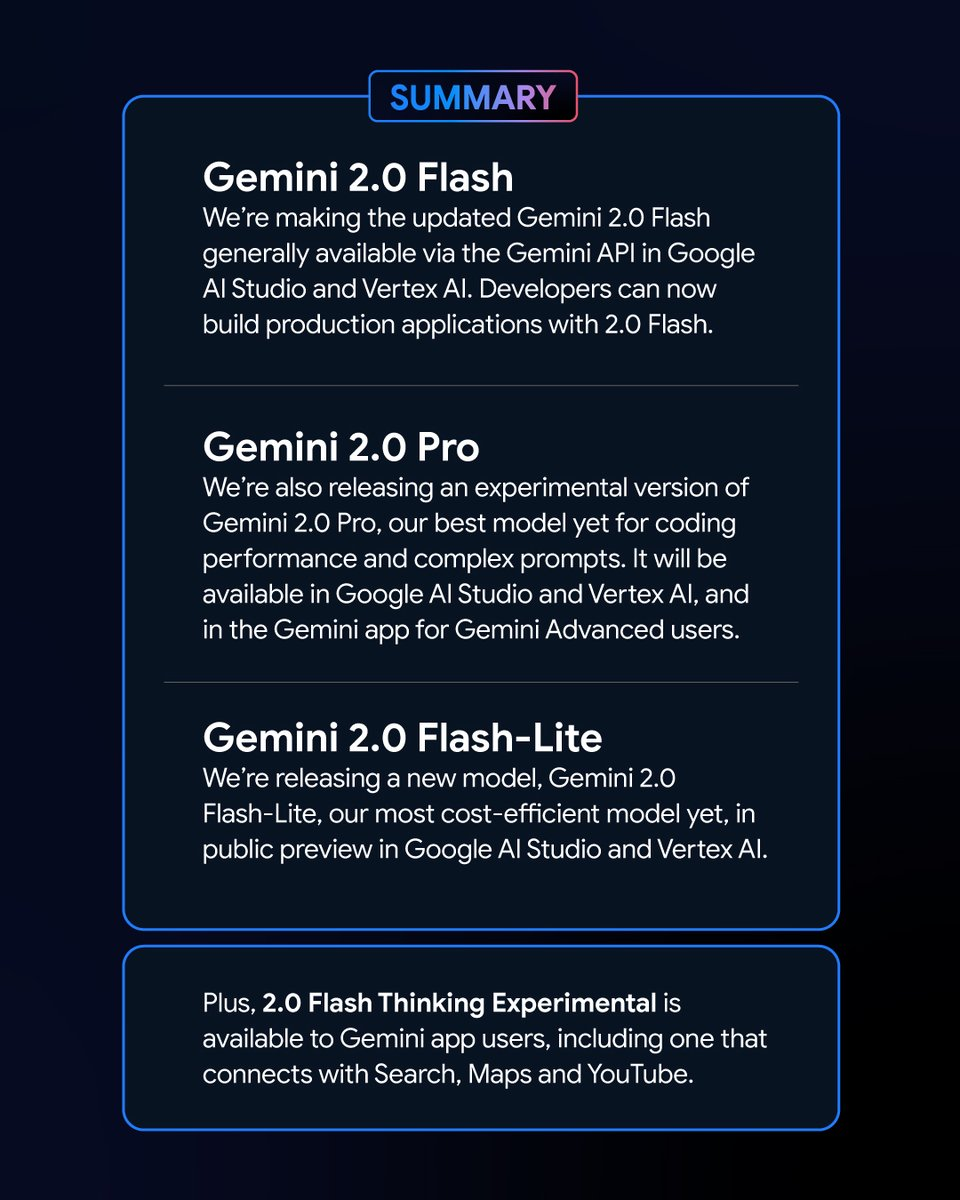

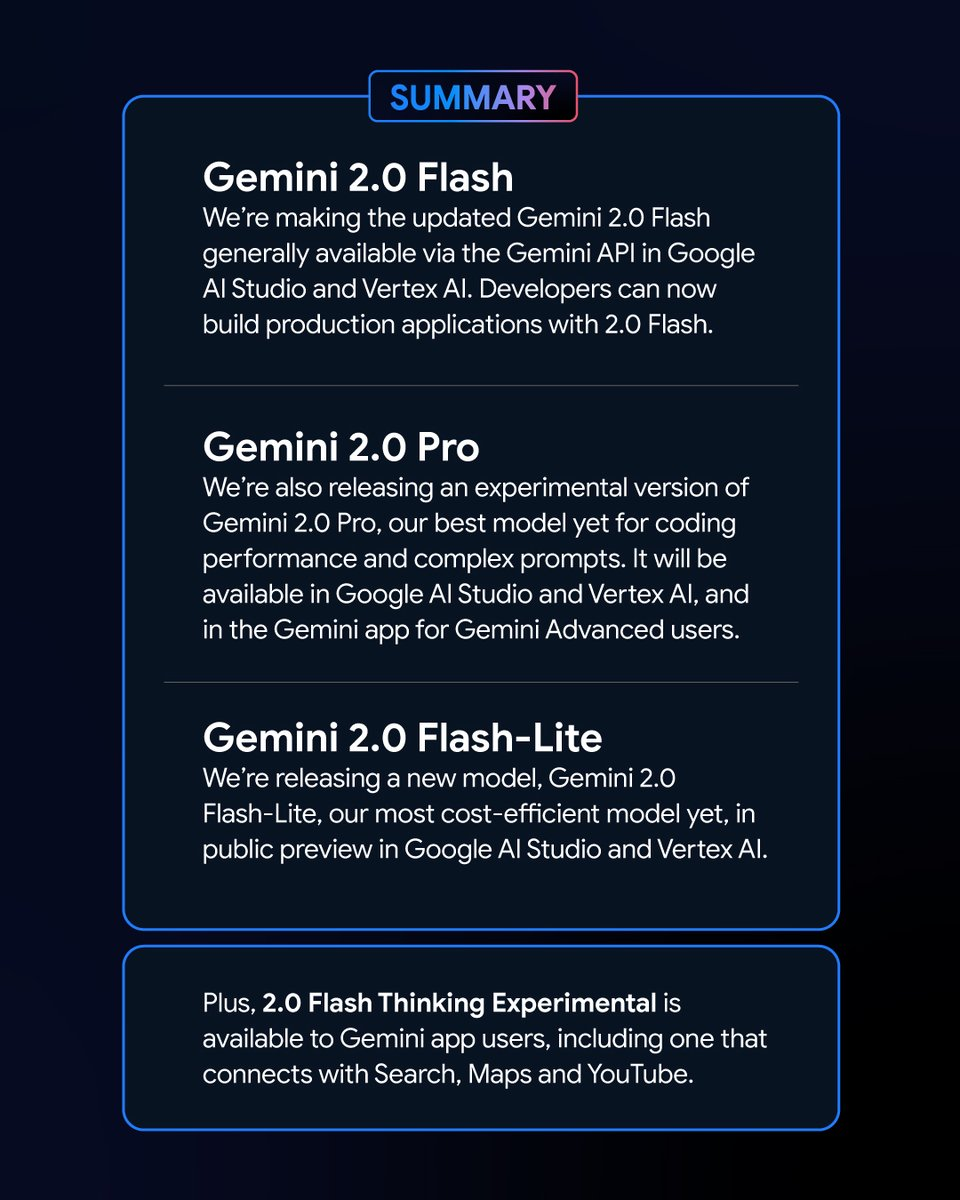

En medio de la persecución y los bloqueos de Búsqueda profunda, Qwen y o3, Google lanzó tres modelos de una sola vez esta mañana temprano: Gemini 2.0 Pro, Gemini 2.0 Flash y Gemini 2.0 Flash-Lite.

En el ranking de modelos grandes LMSYS, Gemini 2.0-Pro ha llegado a la cima, y toda la familia Gemini-2.0 ha avanzado hasta el top 10.

Veamos primero el rendimiento del modelo.

En Modelos Gemini 2.0 Los lanzados esta vez tienen sus propios aspectos destacados en términos de rendimiento.!

Gemini 2.0 Pro (Experimental)

Como el modelo insignia De la serie Gemini, la versión Pro representa las capacidades de IA más avanzadas de Google y se destaca en codificación e inferencia En particular:

- Ventana de contexto extra grande: Admite el procesamiento de contexto de hasta 2 millones de tokens

- Potente integración de herramientas: Integra profundamente la búsqueda de Google y la ejecución de código.

- Disponibilidad: Ya está disponible como versión experimental en Google AI Studio, Vertex AI y la plataforma Gemini Advanced

Géminis 2.0 Flash

se posiciona como un “caballo de batalla altamente eficiente”Está diseñado con el objetivo de equilibrar la velocidad y el rendimiento, y tiene como objetivo brindar soporte ideal para escenarios de aplicaciones que requieren respuestas de baja latencia:

- Millones de ventanas de contexto: Admite contexto de 1 millón de tokens

- Excelentes capacidades de inferencia multimodal: Bueno para procesar datos multimodales, actualmente admite entrada multimodal y entrada de texto monomodal

- Expansión de funciones futuras: Las funciones de generación de imágenes y conversión de texto a voz estarán disponibles próximamente

- Disponibilidad: Lanzado oficialmente en las plataformas Vertex AI Studio y Google AI Studio, y se puede acceder a través de la API de Gemini.

Gemini 2.0 Flash-Lite (versión preliminar)

Como modelo “más rentable”, Flash-Lite ofrece el mejor equilibrio entre velocidad, costo y rendimiento.

- Ventajas rentables: si bien mantiene la misma velocidad y costo que 1.5 Flash, supera a 1.5 Flash en la mayoría de las pruebas comparativas.

- Ventana de contexto de un millón de niveles: También admite 1 millón de tokens de potencia de procesamiento de contexto.

Según la comparación de evaluación de rendimiento publicada por Google, la versión experimental Gemini 2.0 Pro logró las puntuaciones más altas en casi todas las pruebas comparativas, con un excelente desempeño:

Se desempeñó particularmente bien en tareas de generación de código (como LiveCodeBench v5) y problemas matemáticos complejos (como álgebra, geometría y cálculo). Además, hubo una mejora significativa en la prueba de comprensión de documentos largos y complejos.

Y el precio

Google también es un fabricante consciente de la relación coste-eficacia de sus API.

El millón de tokens de Gemini 2.0 Flash cuesta menos de un dólar… Admite múltiples modos, búsquedas en red y una ventana de contexto sin precedentes.

Por el contrario, Deepseek V3 actualmente cuesta un dólar por un millón de tokens, y la inferencia R1 cuesta cuatro dólares.

PD: Pero aún así quiero agradecer a DeepSeek por bajar el precio. Cualquiera que pueda bajar el precio es parte de la familia.

¡Esto es realmente muy barato! En comparación con el rendimiento, creo que lo que Gemini ha pasado por alto es el precio.

Rendimiento del caso

Dado que afirma ser tan bueno como Deepseek, definitivamente tenemos que ver cómo funciona realmente en los casos y ver cómo lo han probado varios internautas.

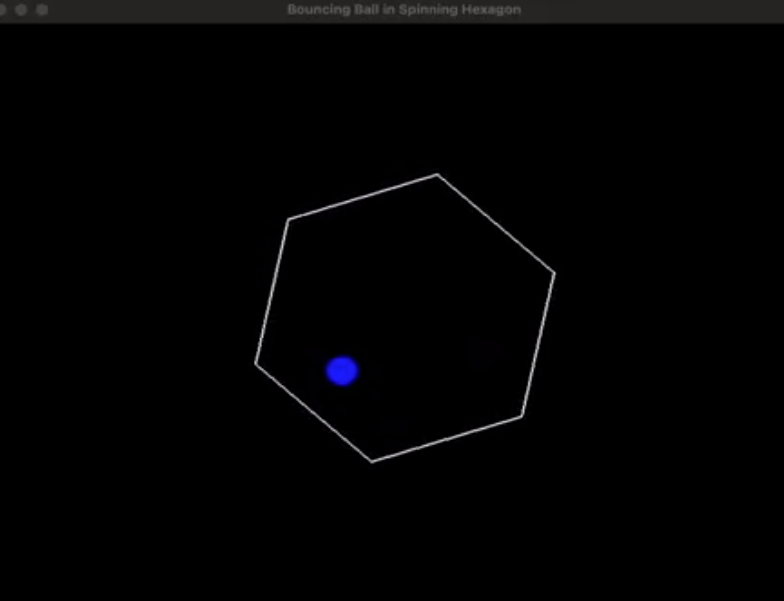

Un juego de pinball basado en la física

Veamos primero este caso popular, que utiliza un motor de física para simular efectos realistas como colisiones, fricción y gravedad.

Sugerencia: Escriba un programa en Python que muestre una pelota rebotando dentro de un hexágono giratorio. La pelota debe verse afectada por la gravedad y la fricción, y debe rebotar de manera realista en las paredes giratorias.

Así funcionan Deepseek R1 y o3-min:

La versión generada por Gemini 2.0 Pro Experimental:

Los dos modelos restantes no funcionan bien.

¡Duplica la dificultad! ¡Divide la bola en 100 bolas!

Sugerencia: Escriba un script para que 100 bolas amarillas brillantes reboten dentro de una esfera, asegurándose de manejar la detección de colisiones correctamente. Haga que la esfera gire lentamente. Asegúrese de que las bolas permanezcan dentro de la esfera. Implemente en p5.js

¡Bien hecho! La rotación lenta de la esfera es muy suave y la simulación de las leyes físicas es excelente. Las 100 bolas también chocan de manera constante y "hacen su trabajo".

Escribe un script p5.js para simular 25 partículas rebotando en un espacio vacío dentro de un contenedor cilíndrico. Usa un color diferente para cada bola y asegúrate de que dejen un rastro para mostrar su movimiento. Agrega una rotación lenta del contenedor para observar mejor lo que está sucediendo en la escena. Asegúrate de crear reglas físicas y de detección de colisiones adecuadas para garantizar que las partículas permanezcan dentro del contenedor. Agrega un contenedor esférico externo. Agrega un efecto de acercamiento y alejamiento lento a toda la escena.

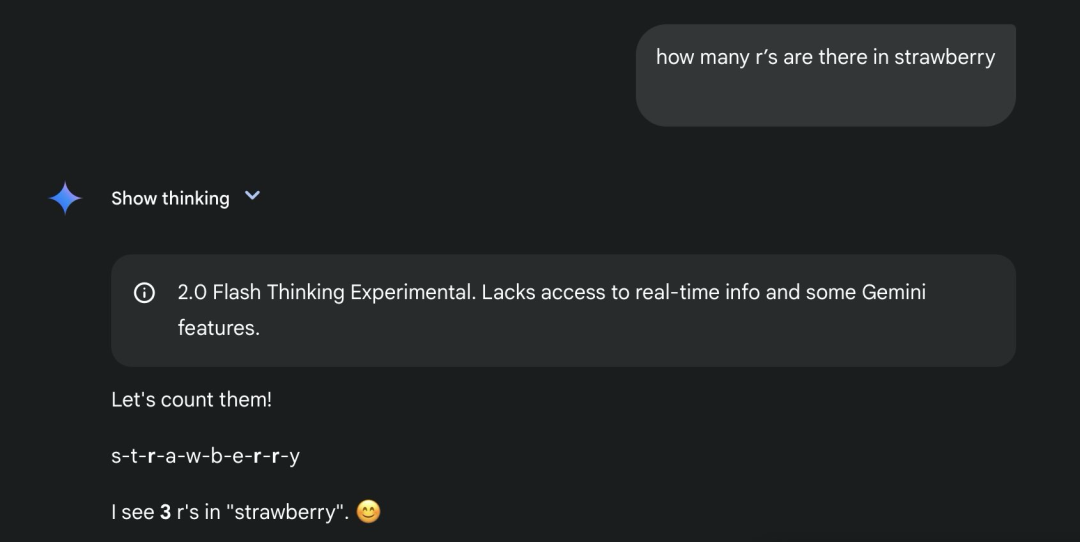

Una pregunta de prueba de fresa que no se puede pasar por alto

Y los astutos internautas han vuelto a hacer la clásica prueba de la fresa:

¿Cuántas r hay en fresa?

Y Gemini 2.0 Flash Thinking Experimental acertó:

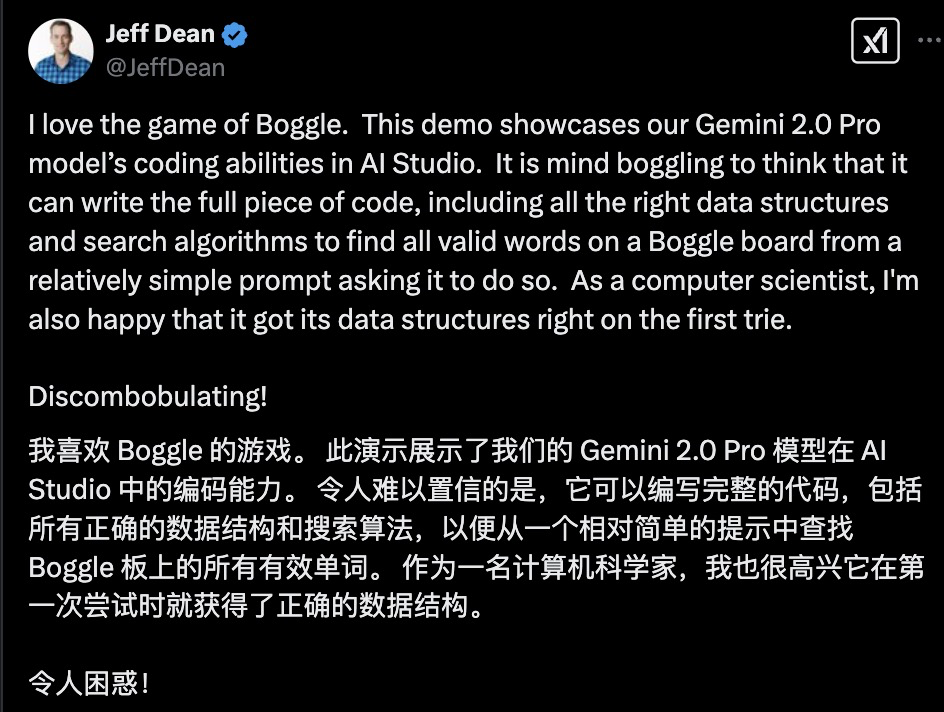

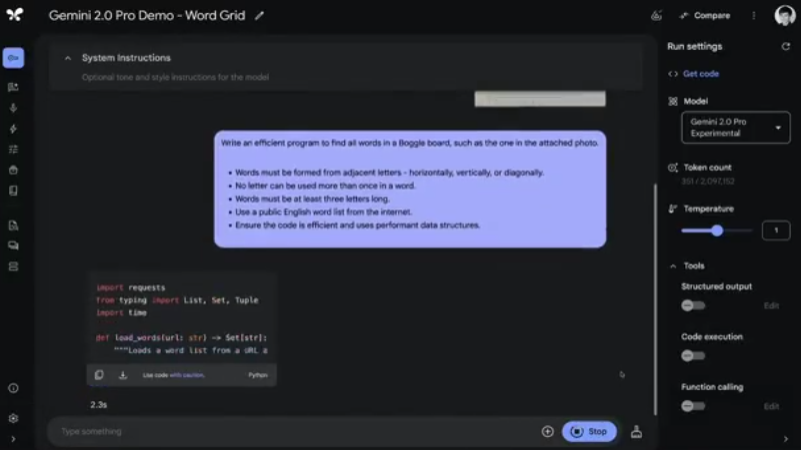

El jefe de Google, Jeff Dean, probó personalmente sus habilidades de programación

Jeff Dean, científico jefe de Google DeepMind y Google Research, también puso a prueba las habilidades de programación de una versión de Gemini 2.0 Pro:

Hizo que el modelo completara el clásico juego Boggle, y el código generado la primera vez completó la búsqueda de todas las palabras válidas en el “Cuadrado de letras” juego:

Además, Jeff Dean dijo que el código se completó en sólo 18,9 segundos, lo que es muy rápido.

El CEO de Google DeepMind se muestra lleno de confianza en esta importante actualización del modelo y afirma que este lanzamiento sienta las bases para que Google logre en el futuro el trabajo de agentes inteligentes:

El director ejecutivo de Google, Sundar Pichai, ya ha dejado claro que 2025 será un período crítico para que Google acelere el desarrollo en el campo de la IA. Parece que... ¡Después de este lanzamiento, la ruta de Google está más clara!

En comparación con las rutas de otros gigantes, la ruta de IA de Google Se centra más en la practicidad y proporciona directamente múltiples opciones de versión., al igual que Una caja de herramientas de IA, donde puedes elegir como quieras, según tus necesidades, de forma flexible y cómoda., y capaz de satisfacer todo tipo de necesidades.