Keegi meist ei oodanud, et nii algab 2025. aasta tehisintellekti valdkonnas.

DeepSeek R1 on tõeliselt hämmastav!

Hiljuti on "salapärane idavõim" DeepSeek "kõvasti kontrollimas" Silicon Valley'd.

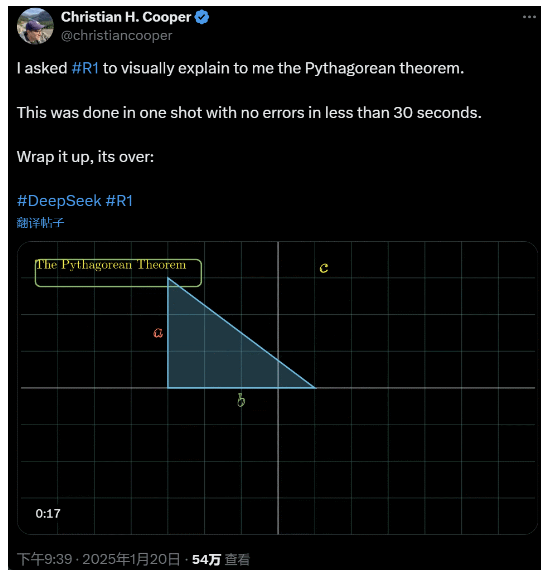

Ma palusin R1-il üksikasjalikult selgitada Pythagorase teoreemi. Seda kõike tegi AI vähem kui 30 sekundiga ilma vigadeta. Ühesõnaga, see on läbi.

Kodu- ja välismaistes tehisintellekti ringkondades on tavalised netikodanikud avastanud hämmastava ja võimsa uue tehisintellekti (mis on ka avatud lähtekoodiga) ning akadeemilised eksperdid on hüüdnud, et "me peame järele jõudma". Samuti on kuulda, et välismaised AI-ettevõtted on juba suure ohu ees.

Võtke lihtsalt see DeepSeek R1, mis sel nädalal välja anti. Selle puhas tugevdamise õppimise tee ilma igasuguse juhendatud treeninguta on šokeeriv. Alates Deepseek-v3 baasi arendamisest eelmise aasta detsembris kuni praeguste OpenAI o1-ga võrreldavate mõtlemisahela võimeteni tundub, et see on aja küsimus.

Kuid samal ajal, kui tehisintellekti kogukond on hõivatud tehniliste aruannete lugemisega ja tegelike mõõtmiste võrdlemisega, on inimestel endiselt kahtlusi R1 suhtes: kas see suudab lisaks sellele, et ta on võimeline ületama hulga võrdlusuuringuid, ka tegelikult juhtida?

Kas ta saab luua oma "füüsikaliste seaduste" simulatsioone?

Te ei usu seda? Laseme suurel mudelil flipperiga mängida?

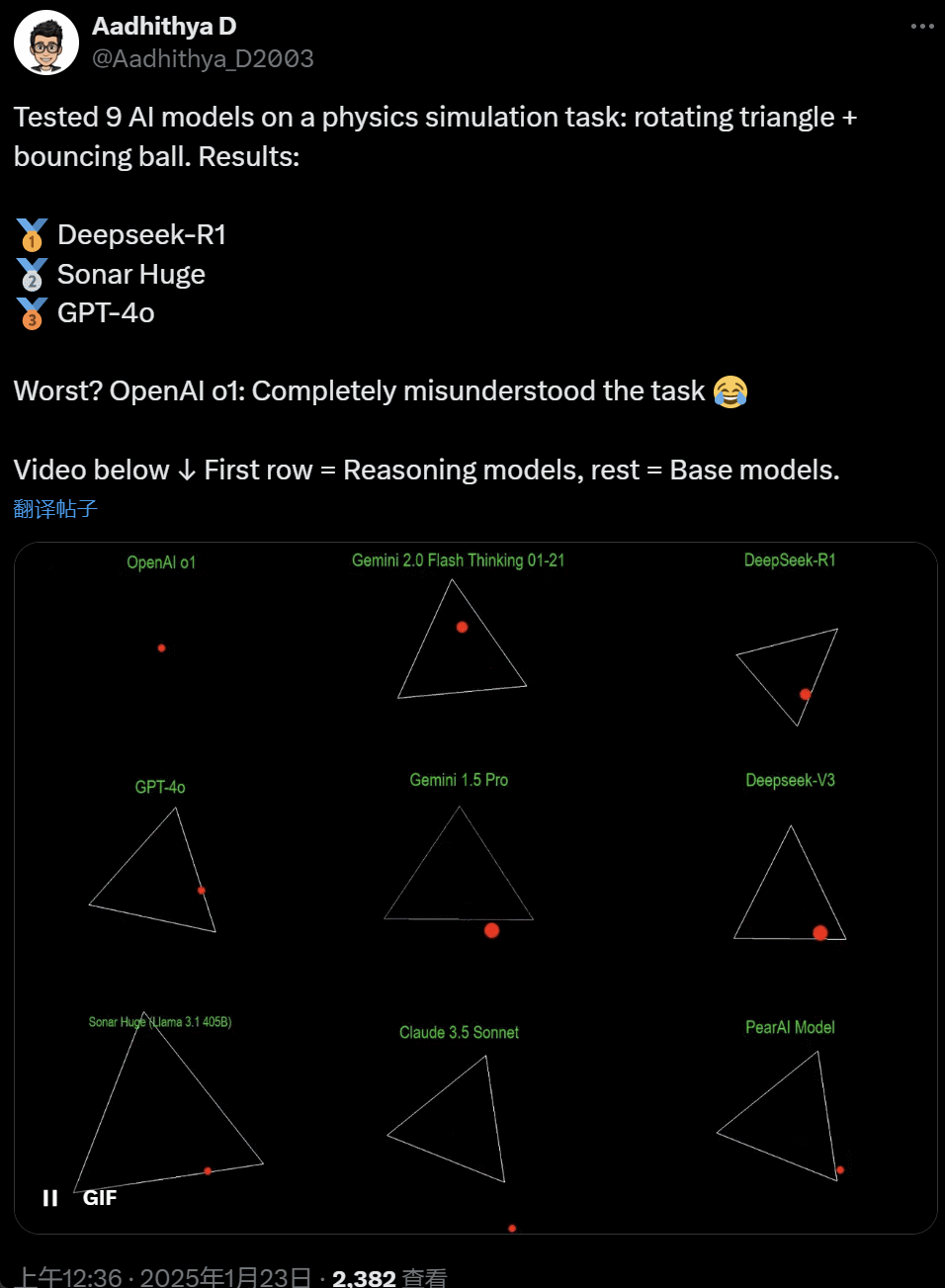

Viimastel päevadel on mõned inimesed AI kogukonnas muutunud kinnisideeks test - erinevate AI suurmudelite (eriti nn arutlusmudelite) testimine probleemi lahendamiseks: "Kirjuta Pythoni skript, mis paneb kollase palli põrgatama teatud kuju sees. Pane kuju aeglaselt pöörlema ja veendu, et pall jääb kuju sisse."

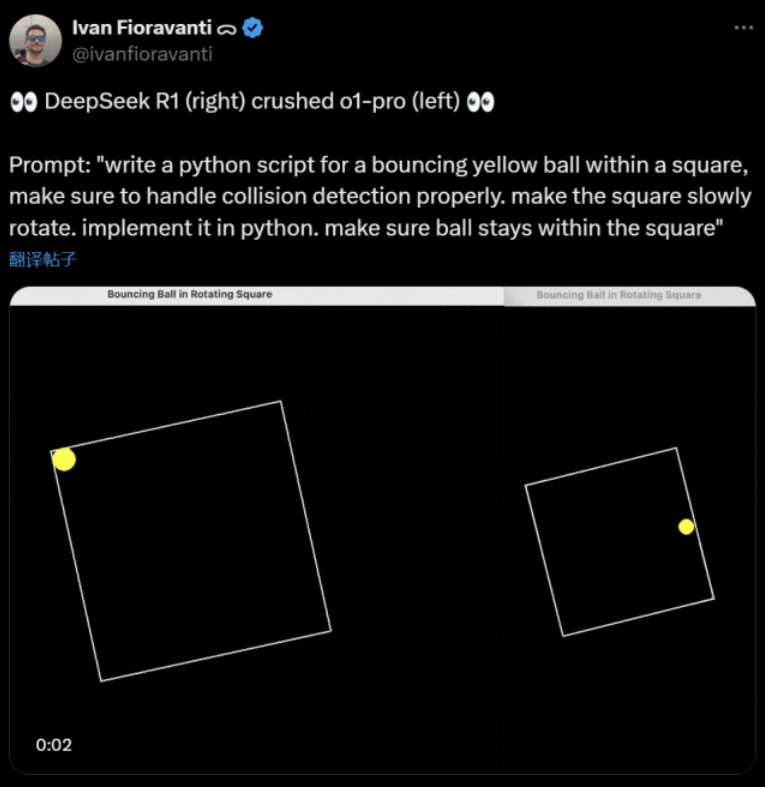

Mõned mudelid ületavad teisi selles "pöörleva palli" võrdluses. CoreView CTO Ivan Fioravanti sõnul on kodumaise tehisintellekti laboril DeepSeek avatud lähtekoodiga suur mudel R1, mis lööb OpenAI o1 pro mudelit, mis maksab $200 kuus OpenAI ChatGPT Pro programmi raames.

Vasakul on OpenAI o1 ja paremal DeepSeek R1. Nagu eespool mainitud, on siin käsk: "kirjuta python skript hüppava kollase palli jaoks ruutu sees, veendu, et see käitleb korralikult kokkupõrke tuvastamist. pane ruut aeglaselt pöörlema. implementeeri see pythonis. veendu, et pall jääb ruutu sisse.".

Ühe teise X-i kasutaja sõnul tegid Anthropic Claude 3.5 Sonnet ja Google'i Gemini 1.5 Pro mudelid valesid otsuseid füüsikaliste põhimõtete kohta, mille tõttu pall kaldus oma kujult kõrvale. Mõned kasutajad on teatanud ka, et Google'i uusim Gemini 2.0 Flash Thinking Experimental, aga ka suhteliselt vanem OpenAI GPT-4o läbisid hindamise kohe.

Kuid siin on võimalik vahet teha:

Netizens selle säutsu all ütles: o1i võime oli algselt väga hea, kuid see muutus nõrgemaks pärast seda, kui OpenAI optimeeris kiirust, isegi $200/kuu liikmelisuse versiooniga.

Põrkiva palli simuleerimine on klassikaline programmeerimisülesanne. Täpne simulatsioon kombineerib kokkupõrke tuvastamise algoritme, mis peavad tuvastama, kui kaks objekti (näiteks pall ja kuju külg) põrkuvad. Valesti kirjutatud algoritm võib mõjutada simulatsiooni jõudlust või põhjustada ilmseid füüsikalisi vigu.

N8 Programs, AI startup Nous Researchi teadlane, ütles, et tal kulus umbes kaks tundi, et kirjutada nullist pöörlevale heptagoonile põrkuv pall. "Jälgida tuleb mitut koordinaatsüsteemi, vaja on arusaamist, kuidas kokkupõrkeid igas süsteemis käsitletakse, ja kood tuleb nullist kujundada, et see oleks robustne."

Kuigi põrkuvad pallid ja pöörlevad kujundid on mõistlik test programmeerimisoskustele, on need siiski uued projektid suurte mudelite jaoks ning isegi väikesed muudatused käsklustes võivad anda erinevaid tulemusi. Seega, kui see peaks lõpuks saama suurte tehisintellekti mudelite võrdlustesti osaks, tuleb seda veel täiustada.

Igal juhul on meil pärast seda praktiliste testide lainet aimu, millised on suurte mudelite võimekuse erinevused.

DeepSeek on uus "Silicon Valley müüt".

DeepSeek tekitab paanikat" kogu Vaikse ookeani piirkonnas.

Meta töötajad on postitanud, et "Meta insenerid analüüsivad meeletult DeepSeek-d, et püüda kopeerida sellest kõike, mida nad suudavad."

Alexandr Wang, AI-tehnoloogia idufirma Scale AI asutaja, teatas samuti avalikult, et DeepSeek AI suurmudeli jõudlus on ligikaudu samaväärne Ameerika Ühendriikide parima mudeliga.

Ta usub ka, et Ameerika Ühendriigid on viimase kümnendi jooksul AI-konkurentsis Hiinast ees olnud, kuid DeepSeeki suure AI-mudeli vabastamine võib "kõike muuta".

X Blogija @8teAPi usub, et DeepSeek ei ole "kõrvalprojekt", vaid on nagu Lockheed Martini endine "Skunk Works".

Niinimetatud "Skunk Works" viitab väga konfidentsiaalsele, suhteliselt sõltumatule väikesele meeskonnale, mille Lockheed Martin algselt asutas paljude kõrgtehnoloogiliste õhusõidukite väljatöötamiseks, mis tegeles tipptasemel või ebatraditsioonilise tehnoloogia uurimis- ja arendustegevusega. Alates U-2 luurelennukist ja SR-71 Blackbirdist kuni F-22 Raptori ja F-35 Lightning II hävitajani - kõik need on pärit siit.

Hiljem kujunes see mõiste järk-järgult üldnimetuseks, mida kasutatakse suurte ettevõtete või organisatsioonide raames loodud "väikeste, kuid peente", suhteliselt sõltumatute ja paindlikumate innovatsioonimeeskondade kirjeldamiseks.

Ta tõi kaks põhjust:

- Ühest küljest on DeepSeek-l suur hulk GPUsid, väidetavalt üle 10 000, ja Scale AI tegevjuht Aleksandr Wang ütles isegi, et see võib ulatuda 50 000ni.

- Teisest küljest värbab DeepSeek talente ainult Hiina kolmest parimast ülikoolist, mis tähendab, et DeepSeek on sama konkurentsivõimeline kui Alibaba ja Tencent.

Juba need kaks asjaolu näitavad, et DeepSeek on selgelt saavutanud kaubandusliku edu ja on piisavalt tuntud, et neid vahendeid saada.

Mis puutub DeepSeek arenduskuludesse, siis ütles blogija, et Hiina tehnoloogiaettevõtted võivad saada mitmesuguseid toetusi, näiteks madalad elektrikulud ja maakasutus.

Seetõttu on väga tõenäoline, et enamik DeepSeek kuludest on "paigutatud" põhitegevusest väljapoole jäävale kontole või mingi andmekeskuse ehitamise toetuse kujul.

Isegi peale asutajate ei mõista keegi täielikult kõiki finantskokkuleppeid. Mõned kokkulepped võivad olla lihtsalt "suulised kokkulepped", mis sõlmitakse üksnes maine põhjal.

Sellest hoolimata on mõned asjad selged:

- Mudel on suurepärane, võrreldav OpenAI poolt kaks kuud tagasi avaldatud versiooniga, ja muidugi on võimalik, et see ei ole nii hea kui uued mudelid, mida OpenAI ja Anthropic ei ole veel avaldanud.

- Praegusest vaatenurgast vaadatuna domineerivad teadusuuringutes ikka veel Ameerika ettevõtted. Mudel DeepSeek on o1-versiooni "kiire jätk", kuid DeepSeek teadus- ja arendustegevuse areng on väga kiire, jõudmas oodatust kiiremini järele. Nad ei plagieeri ega peta, kõige rohkem on nad pöördprojekteerimine.

- DeepSeek koolitab peamiselt omaenda talente, mitte ei toetu ameeriklaste koolitatud doktorantidele, mis laiendab oluliselt talendipotentsiaali.

- Võrreldes USA ettevõtetega on DeepSeek-l vähem piiranguid seoses intellektuaalomandi litsentsimise, eraelu puutumatuse, turvalisuse, poliitika jne. osas ning vähem on muret andmete väärkasutuse pärast, mida inimesed ei soovi, et neid koolitatakse. On vähem kohtuasju, vähem advokaate ja vähem muresid.

Kahtlemata usub üha rohkem inimesi, et 2025. aasta saab olema otsustav aasta. Vahepeal valmistuvad ettevõtted selleks. Meta näiteks ehitab 2025. aastaks 2GW+ andmekeskust, mille investeeringud on hinnanguliselt $60-65 miljardit, ning aasta lõpuks on neil üle 1,3 miljoni GPU.

Meta kasutas isegi graafikut, et võrrelda oma 2 gigavati andmekeskust New Yorgi Manhattani andmekeskusega.

Kuid nüüd on DeepSeek teinud parema tulemuse madalama hinna ja vähemate GPUde abil. Kuidas see ei saa inimesi murelikuks teha?

Yann LeCun: Me peame tänama tehnikajuhti ja kaasasutajat . avatud lähtekood

Hyperbolic, Yuchen Jin, postituse eest, et vaid 4 päeva jooksul on DeepSeek-R1 tõestanud meile 4 fakti:

- Avatud lähtekoodiga tehisintellekt on suletud lähtekoodiga tehisintellektist vaid 6 kuud maas

- Hiina domineerib avatud lähtekoodiga tehisintellekti konkursil

- Oleme sisenemas suurte keelemudelite tugevdava õppimise kuldajastusse

- Destillatsioonimudelid on väga võimsad ja me käivitame mobiiltelefonides väga intelligentset tehisintellekti

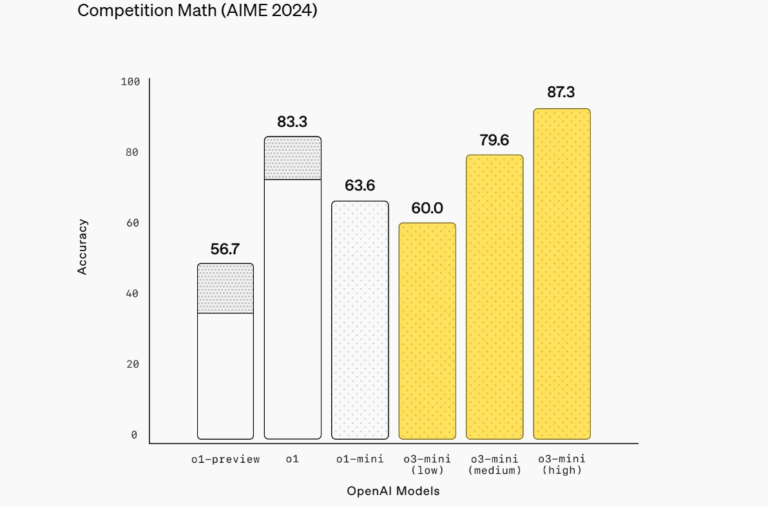

DeepSeek poolt vallandunud ahelreaktsioon jätkub endiselt, näiteks OpenAI o3-mini vabalt kättesaadavaks tegemine, lootus kogukonnas vähendada ebamääraseid arutelusid AGI/ASI kohta ja kuulujutt, et Meta on paanikas.

Ta usub, et raske on ennustada, kes lõpuks võidab, kuid me ei tohiks unustada hilise võitja eelise jõudu. Me kõik teame ju, et Google oli see, kes leiutas Transformeri, samas kui OpenAI avas selle tegeliku potentsiaali.

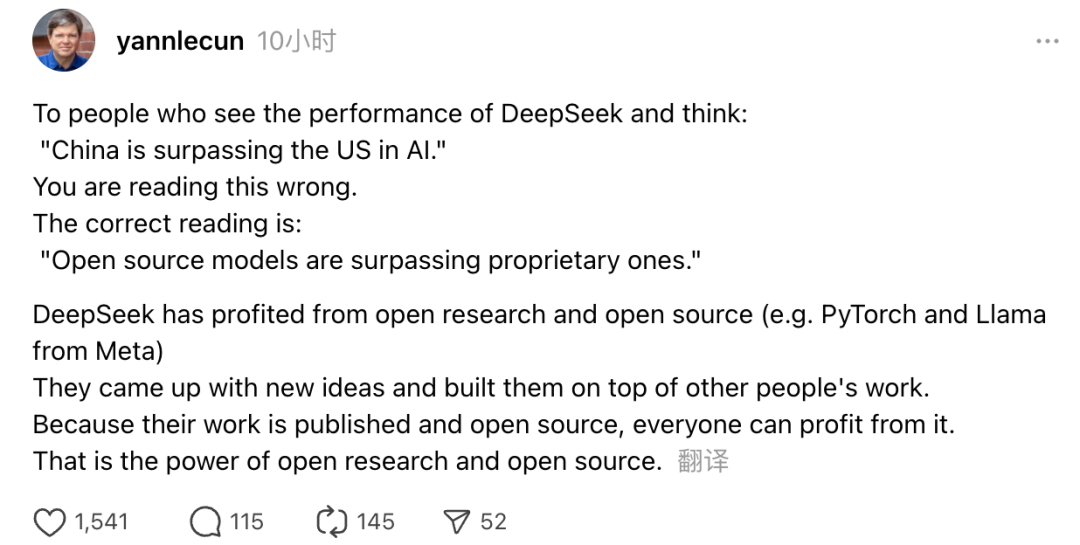

Lisaks sellele avaldas oma arvamust ka Turingi auhinna võitja ja Meta juhtiv tehisintellekti teadlane Yann LeCun.

"Need, kes DeepSeek tulemuslikkust nähes arvavad, et Hiina edestab USA-d tehisintellekti vallas, eksivad. Õige arusaam on see, et avatud lähtekoodiga mudelid on möödumas patenteeritud mudelitest."

LeCun ütles, et põhjus, miks DeepSeek on seekord nii suure edu saavutanud, on see, et nad on saanud kasu avatud teadusuuringutest ja avatud lähtekoodist (näiteks Meta PyTorch ja Llama). DeepSeek on tulnud välja uute ideedega ja tuginenud teiste tööle. Kuna nende töö on avalikult avaldatud ja avatud lähtekoodiga, saavad kõik sellest kasu. See ongi avatud teadustöö ja avatud lähtekoodi jõud.

Netikodanike mõtisklused jätkuvad. Kuigi nad on uute tehnoloogiate arengust vaimustuses, võivad nad tunda ka veidi ärevust. Lõppude lõpuks võib DeepSeekersi esilekerkimine avaldada reaalset mõju.