La technologie DeepSeek-R1 dévoilée : les principes fondamentaux de l'article sont décomposés et la clé des performances révolutionnaires du modèle est révélée

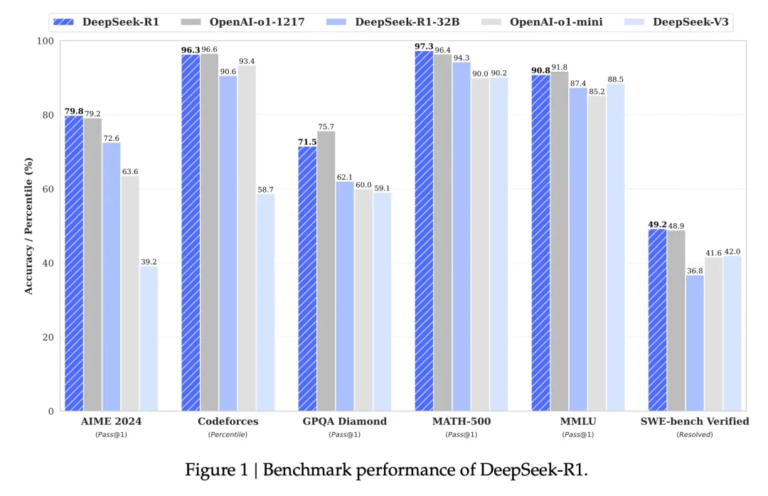

Aujourd'hui, nous allons partager DeepSeek R1, titre : DeepSeek-R1 : Incitation à la capacité de raisonnement dans les LLM via l'apprentissage par renforcement : Incitation à la capacité de raisonnement des LLM via l'apprentissage par renforcement. Cet article présente la première génération de modèles de raisonnement de DeepSeek, DeepSeek-R1-Zero et DeepSeek-R1. Le modèle DeepSeek-R1-Zero a été formé par apprentissage par renforcement à grande échelle (RL) sans réglage fin supervisé (SFT) comme étape initiale,…