ה דגם DeepSeek R1 עבר שדרוג גרסה קל, כאשר הגרסה הנוכחית היא DeepSeek-R1-0528. כשאתם נכנסים לדף האינטרנט או לאפליקציה של DeepSeek, הפעילו את התכונה "חשיבה מעמיקה" בממשק הדיאלוג כדי לחוות את הגרסה העדכנית ביותר.

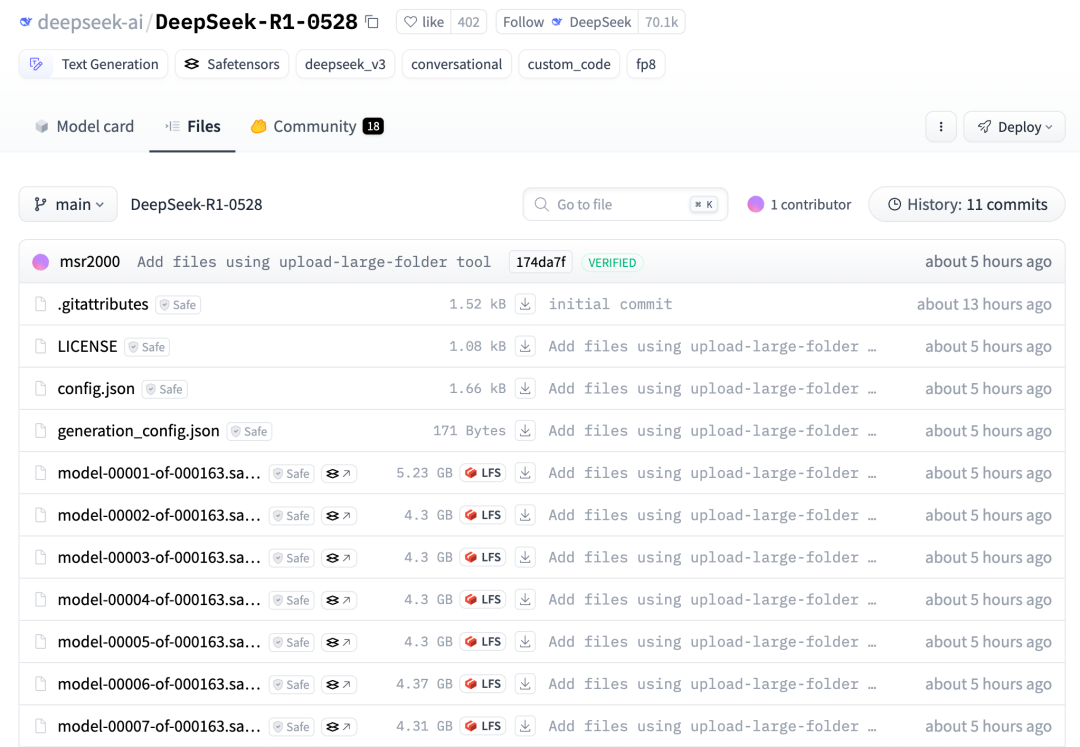

משקלי המודל DeepSeek-R1-0528 הועלו ל-HuggingFace

במהלך ארבעת החודשים האחרונים, DeepSeek-R1 עבר אבולוציה-על, והשיג יכולות קידוד יוצאות דופן וזמני חשיבה ארוכים משמעותית. למרות שייתכן שזה לא... DeepSeek-R2 כולם ציפו, השיפורים בדגם DeepSeek-R1-0528 הם משמעותיים.

על פי דיווחים, המודל החדש מאומן על DeepSeek-V3-0324 (עם פרמטרים של 660B).

בואו נסתכל תחילה בקצרה על העדכונים המרכזיים בגרסה זו באמצעות טבלה

| ממד היכולת | deepseek-R1 | דיפסיק-R1-0528 |

| הקשר מקסימלי | 64k (API) | 128K (API) אפילו יותר |

| יצירת קוד | סגירת liveCodeBench פתח את O1 | קרוב ל-O3 |

| עומק חשיבה | שאלות מורכבות דורשות הנחיות מפולחות. | תומך 30-60 דקות של חשיבה עמוקה |

| טבעיות השפה | ארוך למדי | מבנה קומפקטי, כתיבה דומה ל-O3 |

| עלות שימוש | קוד פתוח או API$0.5/M | קוד פתוח או API$0.5/M |

יכולות חשיבה עמוקה משופרות

DeepSeek-R1-0528 עדיין משתמש במודל הבסיסי DeepSeek V3 שיצא בדצמבר 2024 כבסיס, אך במהלך האימון שלאחר מכן הושקע כוח מחשוב רב יותר, מה ששיפור משמעותי את עומק החשיבה ויכולות ההיגיון של המודל.

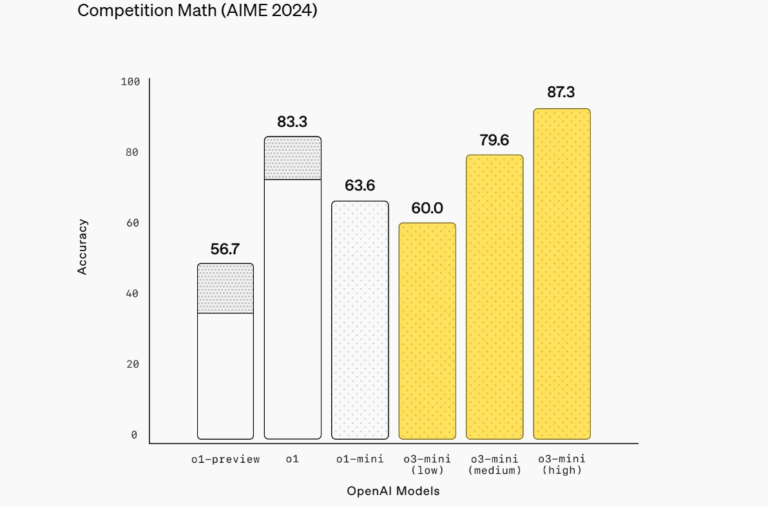

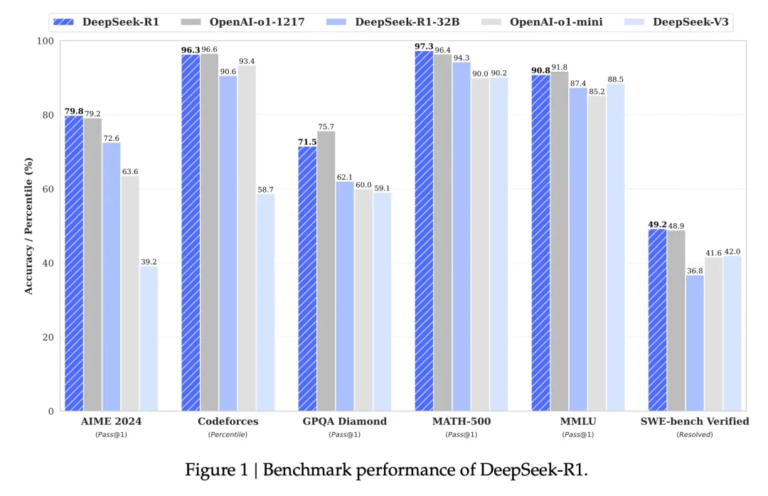

דגם ה-R1 המעודכן השיג ביצועים מהשורה הראשונה מבין כל הדגמים המקומיים במספר מבחנים, כולל מתמטיקה, תכנות ולוגיקה כללית, והביצועים הכוללים שלו עומדים כעת בקנה אחד עם דגמים בינלאומיים מובילים אחרים כמו o3 ו-Gemini-2.5-Pro.

- יכולות מתמטיקה ותכנות: בתחרות המתמטיקה AIME 2025, הדיוק השתפר מ-70% בגרסה הקודמת ל-87.5%; יכולות יצירת הקוד במבחן benchmark LiveCodeBench כמעט שוות ערך למודל o3-high של OpenAI, כאשר ציון ה-pass@1 הוא 73.3%.

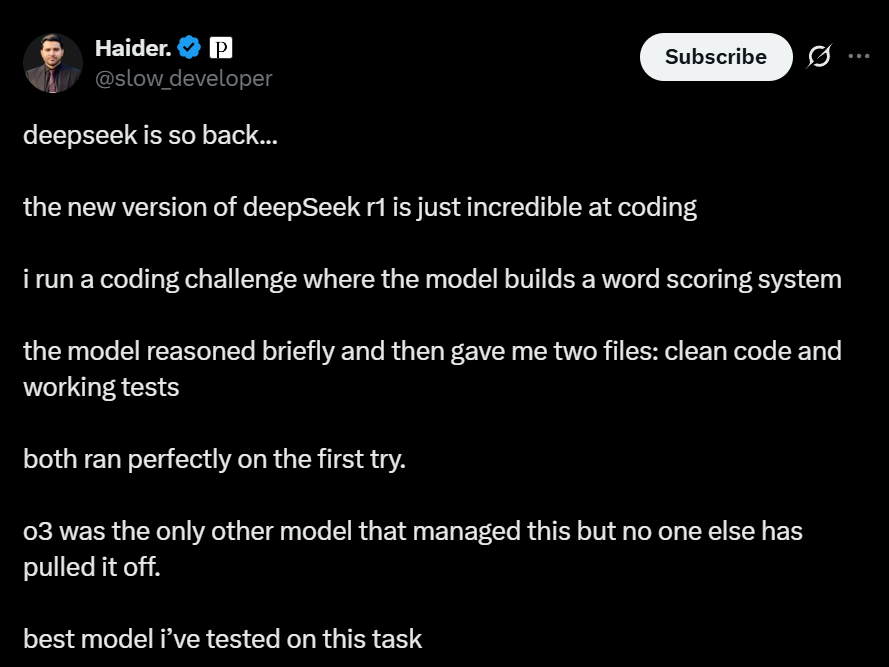

מבחני משתמשים מראים שה-DeepSeek-R1 החדש פשוט מדהים בתכנות!

מומחה הבינה המלאכותית "karminski-dentist" בדק את DeepSeek-R1-0528 ואת Claude 4 Sonnet באמצעות אותה הנחיה ומצא כי:

בין אם מדובר בהשתקפות מפושטת של אור על קיר, בכיוון תנועת הכדור לאחר הפגיעה, או במראה האסתטי של לוח הבקרה, R1 עולה בבירור על המתחרים.

המשתמש היידר ביקש מהמודל לבנות מערכת ניקוד מילים. R1 שקל לרגע את המשימה ויצר מיד שני קבצים - אחד לקוד ואחד לבדיקות עבודה - אשר רצו ללא רבב בניסיון הראשון.

בעבר, o3 היה המודל היחיד שהיה מסוגל להשלים משימה זו. כעת, R1 הוא ללא ספק המודל הטוב ביותר למשימה זו.

שימו לב שהביצועים של R1 כל כך יוצאי דופן מכיוון ששני הקבצים שהוא מחזיר פועלים ללא רבב בניסיון הראשון, ללא כל עריכה או ניסיונות חוזרים, וזה נדיר ביותר.

בעבר, רוב המודלים הסתיימו במקרי קצה, סיבכו את הפתרון יתר על המידה, או שחסרה כיסוי בדיקה מספק.

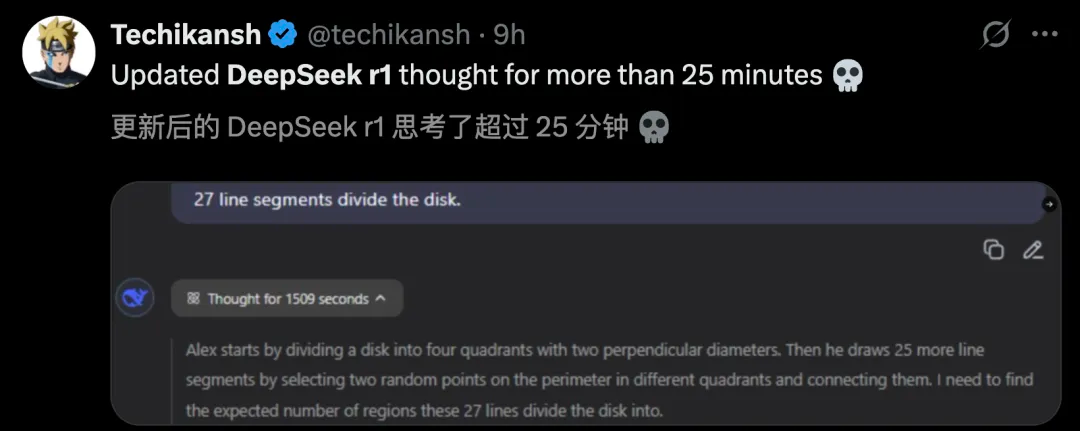

- עומק הסקה: זמן חשיבה במשימה בודדת הוארך ל-30-60 דקות, עם יכולות פתרון בעיות משופרות משמעותית עבור סוגיות מורכבות (למשל, סימולציות פיזיקה, חידות לוגיות מרובות שלבים).

זמן חשיבה ארוך יותר הפך לתכונה המדוברת ביותר ברשת. חלק מהמשתמשים דיווחו שזמן החשיבה של R1 עלה על 25 דקות במבחנים בעולם האמיתי.

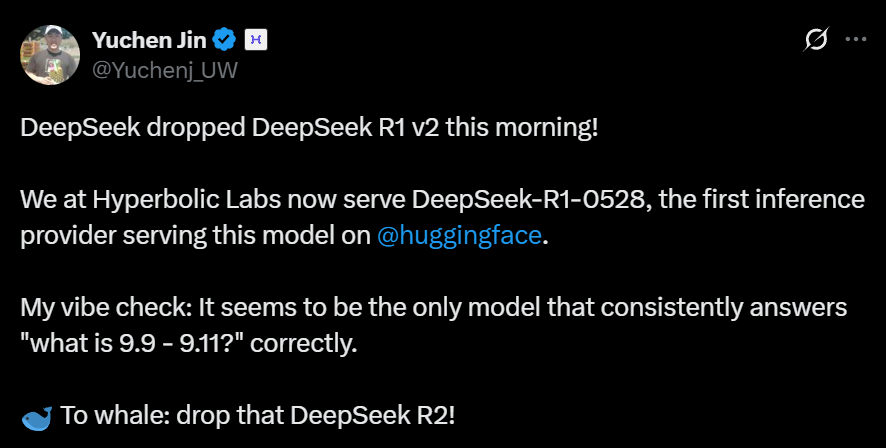

בנוסף, נראה שזהו המודל היחיד המסוגל לענות בצורה עקבית ומדויקת על השאלה "מה זה 9.9 פחות 9.11?"

DeepSeek-R1-0528 השיג ביצועים מצוינים על כל מערכי נתוני ההערכה

בהשוואה לגרסה הקודמת של R1, המודל החדש מציג שיפורים משמעותיים במשימות חשיבה מורכבות. לדוגמה, במבחן AIME 2025, שיעור הדיוק של המודל החדש עלה מ-70% ל-87.5%.

שיפור זה נובע מעומק החשיבה המשופר במודל: במערך הבדיקות AIME 2025, המודל הישן השתמש בממוצע של 12,000 טוקנים לכל שאלה, בעוד שהמודל החדש השתמש בממוצע של 23,000 טוקנים לכל שאלה, דבר המצביע על חשיבה מפורטת ומעמיקה יותר בתהליך פתרון הבעיות.

בנוסף, צוות deepseek זיקק את שרשרת ההיגיון מ-DeepSeek-R1-0528 וכיוונן את בסיס Qwen3-8B, וכתוצאה מכך נוצר ה-DeepSeek-R1-0528-Qwen3-8B.

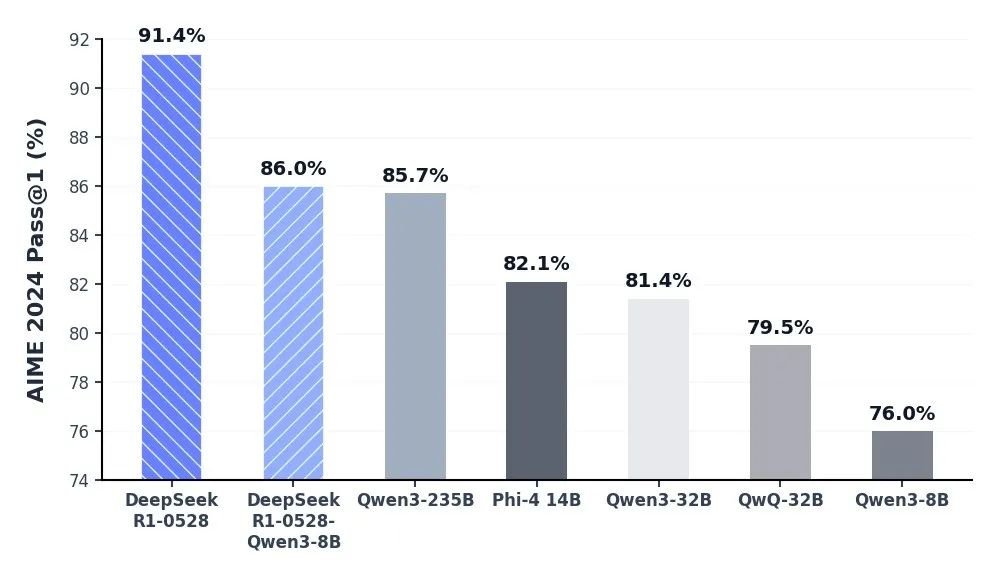

דגם 8B זה דורג במקום השני רק ל-DeepSeek-R1-0528 במבחן המתמטיקה AIME 2024, כשהוא עולה על Qwen3-8B (+10.0%) ותואם את Qwen3-235B.

לשרשראות ההיגיון של DeepSeek-R1-0528 יהיו השלכות משמעותיות על מחקר אקדמי על מודלים של חשיבה ופיתוח תעשייתי של מודלים בקנה מידה קטן.

חלק מהגולשים ברשת שיבחו את DeepSeek-R1 על יכולתו לתקן שרשראות חשיבה כמו o3 ולבנות באופן יצירתי עולמות כמו של קלוד.

חשוב לציין ש-DeepSeek הוא מודל קוד פתוח, מה שמסמן ניצחון גדול עבור מודלים בקוד פתוח.

תוצאות השוואה של AIME 2024 עבור מודלים בקוד פתוח כגון DeepSeek-R1-0528-Qwen3-8B

עדכוני יכולות נוספים

- שיפור הזיות: הגרסה החדשה של DeepSeek R1 אופטימלית את הביצועים עבור בעיות "הזיות". בהשוואה לגרסה הקודמת, המודל המעודכן משיג הפחתה של 45-50% בשיעורי ההזיות במשימות כגון כתיבה מחדש וליטוש, סיכום והבנת הנקרא, ומספק תוצאות מדויקות ואמינות יותר.

- כתיבה יצירתית: בהתבסס על גרסת R1 הקודמת, מודל R1 המעודכן עבר אופטימיזציה נוספת עבור סגנונות כתיבה של חיבורים, רומנים ופרוזה, מה שמאפשר לו ליצור עבודות ארוכות ושלמות יותר מבחינה מבנית, תוך הצגת סגנון כתיבה התואם יותר להעדפות אנושיות.

- קריאה לכלי: DeepSeek-R1-0528 תומך בקריאה לכלי (קריאה לכלי אינה נתמכת בחשיבה). ציוני ההערכה של Tau-Bench של המודל הנוכחי הם 53.5% עבור תעופה ו-63.9% עבור קמעונאות, בהשוואה ל-OpenAI עם ערך o1-high, אך עדיין מפגר אחרי ערך o3-High ו-Claude 4 Sonnet.

הדוגמה מציגה סיכום של מאמר אינטרנט שנוצר באמצעות יכולת הפעלת הכלי DeepSeek-R1-0528 דרך LobeChat. בנוסף, DeepSeek-R1-0528 עודכן ושופר בתחומים כגון יצירת קוד חזיתי ומשחקי תפקידים.

הדוגמה מציגה אפליקציית כרטיסי מילים מודרנית ומינימליסטית שפותחה באמצעות HTML/CSS/JavaScript על ידי הפעלת DeepSeek-R1-0528 בדף אינטרנט.

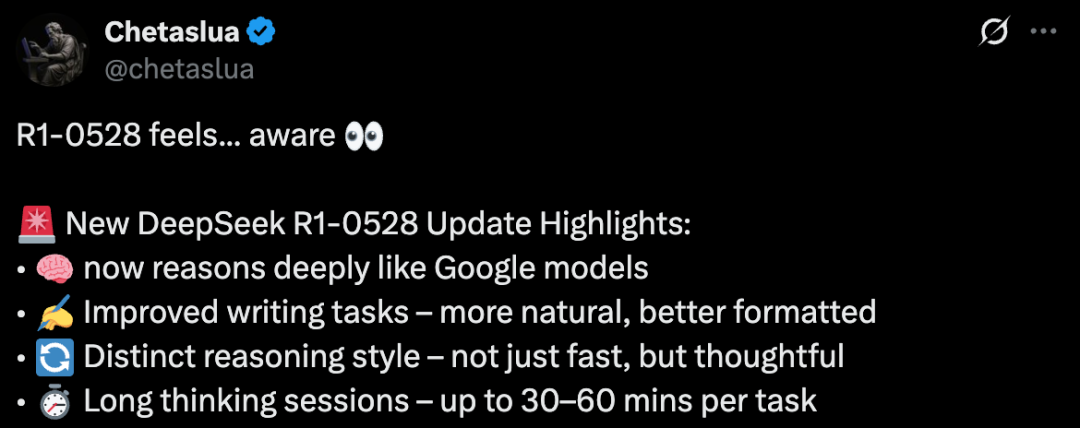

נקודות עיקריות של עדכון DeepSeek-R1-0528

- יכולות חשיבה עמוקה דומות למודלים של גוגל

- אופטימיזציה של יצירת טקסט: טבעי יותר ומעוצב טוב יותר

- סגנון חשיבה ייחודי: לא רק מהיר יותר אלא גם קפדני יותר

- תמיכה בחשיבה לטווח ארוך: זמן עיבוד של משימה בודדת יכול להגיע ל-30-60 דקות

היכולות של הגרסה החדשה של DeepSeek-R1 נבדקו על ידינו. למרות שמדובר בעדכון "גרסה משנית", ביצועיו שופרו באופן "אפי".

במיוחד מבחינת יכולות תכנות, זה מרגיש כאילו הוא עלה על Claude 4 ו- Gemini 2.5 Pro או עומד בקנה אחד איתם. כל ההנחיות הן "פעולה אחת", ללא צורך בשינויים! וניתן להריץ אותו ישירות בדפדפן אינטרנט כדי להדגים את יכולותיו.

ניתן להרגיש בבירור שתהליך החשיבה של גרסת ה-DeepSeek-R1 החדשה יציב יותר.

אתם יכולים לשאול את deepseek-R1 כל שאלה שתרצו לדעת את התשובה עליה, גם אם השאלה שלכם קצת חסרת היגיון, היא עדיין תחשוב בזהירות ותארגן את ההיגיון. אנו ממליצים בחום לנסות את דגם deepseek-R1 העדכני ביותר.

מידע על עדכון API

ה-API עודכן, אך הממשק ושיטות הקריאה נותרו ללא שינוי. ה-API החדש של R1 עדיין תומך בצפייה בתהליך החשיבה של המודל וכעת תומך גם ב-Function Calling וב-JsonOutput.

צוות deepseek התאים את משמעות הפרמטר max_tokens בממשק ה-API החדש של R1: max_tokens מגביל כעת את האורך הכולל של הפלט היחיד של המודל (כולל תהליך החשיבה), עם ערך ברירת מחדל של 32K ומקסימום של 64K. מומלץ למשתמשי ה-API להתאים את הפרמטר max_tokens בהקדם כדי למנוע קיצור מוקדם של הפלט.

להוראות מפורטות בנוגע לשימוש במודל R1, אנא עיינו ב מדריך API של deepseek R1:

לאחר עדכון R1 זה, אורך ההקשר של המודל באתר הרשמי, במיני-תוכנית, באפליקציה וב-API יישאר 64K. אם משתמשים זקוקים לאורך הקשר ארוך יותר, הם יכולים לקרוא לגרסת הקוד הפתוח של מודל R1-0528 עם אורך הקשר של 128K דרך פלטפורמות צד שלישי אחרות.

קוד פתוח

DeepSeek-R1-0528 משתמש באותו מודל בסיס כמו ה-DeepSeek-R1 הקודם, עם שיפורים בלבד שבוצעו בשיטות שלאחר האימון.

בעת פריסה פרטית, יש לעדכן רק את נקודת הביקורת ואת tokenizer_config.json (שינויים הקשורים לקריאות לכלי). פרמטרי המודל הם 685B (מתוכם 14B עבור שכבת ה-MTP), ולגרסת הקוד הפתוח יש אורך הקשר של 128K (אורך הקשר של 64K מסופק עבור אינטרנט, אפליקציה ו-API).