Tak satu pun dari kami yang menyangka bahwa tahun 2025 akan dimulai dengan cara seperti ini di bidang AI.

DeepSeek R1 benar-benar luar biasa!

Baru-baru ini, "kekuatan Timur yang misterius" DeepSeek telah "mengendalikan" Silicon Valley.

Saya meminta R1 untuk menjelaskan teorema Pythagoras secara rinci. Semua ini dilakukan oleh AI dalam waktu kurang dari 30 detik tanpa kesalahan. Singkatnya, selesai.

Di kalangan AI dalam dan luar negeri, netizen biasa telah menemukan AI baru yang menakjubkan dan kuat (yang juga open source), dan para ahli akademis telah berteriak "kita harus mengejar ketertinggalan". Ada juga desas-desus bahwa perusahaan AI di luar negeri sudah menghadapi ancaman besar.

Contohnya DeepSeek R1 yang dirilis minggu ini. Rute pembelajaran penguatannya yang murni tanpa pelatihan yang diawasi sangat mengejutkan. Dari pengembangan basis Deepseek-v3 pada bulan Desember tahun lalu hingga kemampuan rantai pemikiran saat ini yang sebanding dengan OpenAI o1, tampaknya tinggal menunggu waktu.

Namun, sementara komunitas AI sibuk membaca laporan teknis dan membandingkan pengukuran aktual, orang-orang masih meragukan R1: selain mampu mengungguli banyak tolok ukur, apakah R1 benar-benar bisa memimpin?

Dapatkah ia membangun simulasi "hukum fisika" sendiri?

Anda tidak percaya? Mari kita biarkan model besar ini bermain dengan pinball?

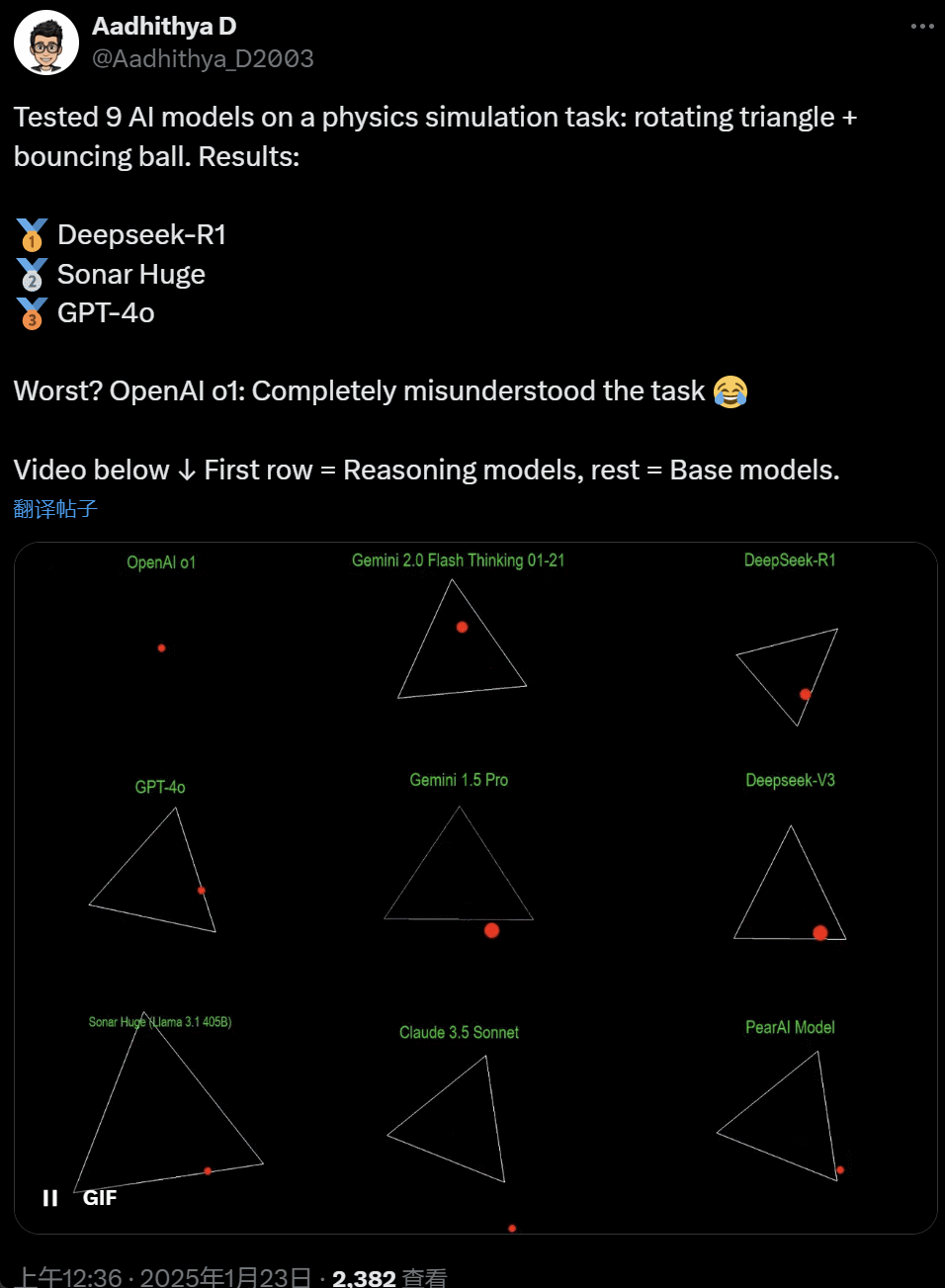

Dalam beberapa hari terakhir, beberapa orang dalam komunitas AI telah terobsesi dengan sebuah tes - menguji model besar AI yang berbeda (terutama yang disebut model penalaran) untuk menyelesaikan sebuah masalah: "Tuliskan skrip Python untuk membuat bola kuning memantul di dalam bentuk tertentu. Buatlah bentuk tersebut berputar secara perlahan dan pastikan bola tersebut tetap berada di dalam bentuk tersebut."

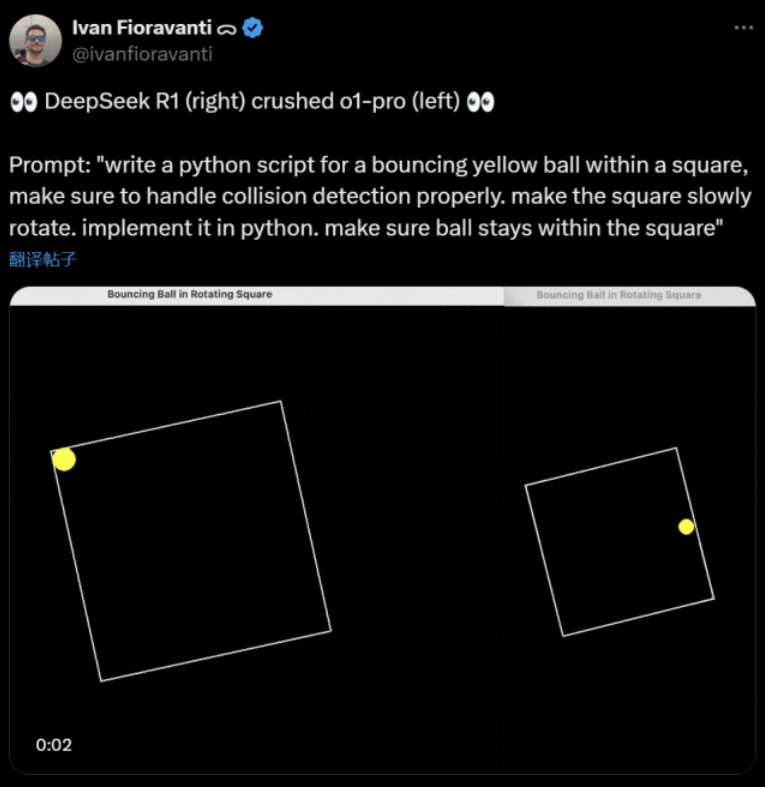

Beberapa model mengungguli model lainnya dalam tolok ukur "bola berputar" ini. Menurut CTO CoreView Ivan Fioravanti, DeepSeek, sebuah laboratorium kecerdasan buatan dalam negeri, memiliki model R1 open source besar yang mengalahkan model o1 pro dari OpenAI, yang harganya $200 per bulan sebagai bagian dari program ChatGPT Pro dari OpenAI.

Di sebelah kiri adalah OpenAI o1, dan di sebelah kanan adalah DeepSeek R1. Seperti yang disebutkan di atas, perintah di sini adalah: "tulis skrip python untuk bola kuning yang memantul di dalam kotak, pastikan untuk menangani deteksi tabrakan dengan benar. buat kotak berputar secara perlahan. implementasikan dalam python. pastikan bola tetap berada di dalam kotak."

Menurut pengguna lain di X, model Anthropic Claude 3.5 Sonnet dan Google Gemini 1.5 Pro membuat penilaian yang salah tentang prinsip-prinsip fisika, sehingga menyebabkan bola menyimpang dari bentuknya. Beberapa pengguna juga melaporkan bahwa Gemini 2.0 Flash Thinking Experimental terbaru dari Google, serta OpenAI GPT-4o yang relatif lebih tua, lulus penilaian sekaligus.

Tetapi ada cara untuk membedakannya di sini:

Netizen di bawah tweet ini mengatakan: kemampuan o1 pada awalnya sangat bagus, tetapi menjadi lebih lemah setelah OpenAI mengoptimalkan kecepatannya, bahkan dengan versi keanggotaan $200/bulan.

Mensimulasikan bola yang memantul adalah tantangan pemrograman klasik. Simulasi yang akurat menggabungkan algoritme pendeteksi tabrakan, yang perlu mengidentifikasi ketika dua objek (seperti bola dan sisi bentuk) bertabrakan. Algoritme yang tidak ditulis dengan benar dapat memengaruhi kinerja simulasi atau menyebabkan kesalahan fisik yang nyata.

N8 Programs, seorang peneliti di perusahaan rintisan AI Nous Research, mengatakan bahwa ia membutuhkan waktu sekitar dua jam untuk menulis kode bola yang memantul dalam heptagon yang berputar dari awal. "Berbagai sistem koordinat harus dilacak, pemahaman tentang bagaimana tabrakan ditangani di setiap sistem diperlukan, dan kode harus dirancang dari awal agar kuat."

Meskipun bola yang memantul dan bentuk yang berputar merupakan ujian keterampilan pemrograman yang wajar, namun ini masih merupakan proyek baru untuk model besar, dan bahkan perubahan kecil pada petunjuknya bisa menghasilkan hasil yang berbeda. Jadi, jika pada akhirnya akan menjadi bagian dari tes tolok ukur untuk model AI yang besar, ini masih perlu ditingkatkan.

Bagaimanapun, setelah gelombang pengujian praktis ini, kami merasakan perbedaan dalam kemampuan antara model-model besar.

DeepSeek adalah "mitos Lembah Silikon" yang baru

DeepSeek menyebabkan kepanikan" di seluruh Pasifik.

Karyawan Meta telah memposting bahwa "Para insinyur Meta dengan panik menganalisis DeepSeek untuk mencoba menyalin apa pun yang mereka bisa."

Alexandr Wang, pendiri startup teknologi AI, Scale AI, juga secara terbuka menyatakan bahwa performa model besar AI DeepSeek secara kasar setara dengan model terbaik di Amerika Serikat.

Dia juga percaya bahwa Amerika Serikat mungkin telah berada di depan Tiongkok dalam kompetisi AI selama dekade terakhir, tetapi rilis model besar AI DeepSeek dapat "mengubah segalanya."

X Blogger @8teAPi percaya bahwa DeepSeek bukanlah "proyek sampingan" tetapi seperti "Skunk Works" milik Lockheed Martin.

Apa yang disebut "Skunk Works" mengacu pada tim kecil yang sangat rahasia dan relatif independen yang awalnya dibentuk oleh Lockheed Martin untuk mengembangkan banyak pesawat canggih, yang terlibat dalam penelitian dan pengembangan teknologi canggih atau tidak konvensional. Dari pesawat pengintai U-2 dan SR-71 Blackbird hingga pesawat tempur F-22 Raptor dan F-35 Lightning II, semuanya berasal dari sini.

Belakangan, istilah ini berangsur-angsur berkembang menjadi istilah umum yang digunakan untuk menggambarkan tim inovasi yang "kecil tapi bagus", relatif independen, dan lebih fleksibel yang dibentuk di dalam perusahaan atau organisasi besar.

Dia memberikan dua alasan:

- Di satu sisi, DeepSeek memiliki jumlah GPU yang banyak, kabarnya lebih dari 10.000, dan Alexandr Wang, CEO Scale AI, bahkan mengatakan bahwa jumlah GPU-nya bisa mencapai 50.000.

- Di sisi lain, DeepSeek hanya merekrut talenta dari tiga universitas terbaik di Tiongkok, yang berarti DeepSeek sama kompetitifnya dengan Alibaba dan Tencent.

Dua fakta ini saja menunjukkan bahwa DeepSeek jelas telah mencapai kesuksesan komersial dan cukup terkenal untuk mendapatkan sumber daya ini.

Mengenai biaya pengembangan DeepSeek, blogger tersebut mengatakan bahwa perusahaan teknologi Tiongkok dapat menerima berbagai subsidi, seperti biaya listrik dan penggunaan lahan yang rendah.

Oleh karena itu, sangat mungkin bahwa sebagian besar biaya DeepSeek telah "ditempatkan" di akun di luar bisnis inti atau dalam bentuk semacam subsidi pembangunan pusat data.

Bahkan selain para pendiri, tidak ada yang sepenuhnya memahami semua pengaturan keuangan. Beberapa perjanjian mungkin hanya berupa "perjanjian lisan" yang diselesaikan berdasarkan reputasi saja.

Terlepas dari itu, ada beberapa hal yang jelas:

- Model ini sangat baik, sebanding dengan versi yang dirilis oleh OpenAI dua bulan yang lalu, dan tentu saja ada kemungkinan tidak sebagus model-model baru yang belum dirilis oleh OpenAI dan Anthropic.

- Dari perspektif saat ini, arah penelitian masih didominasi oleh perusahaan Amerika. Model DeepSeek adalah "tindak lanjut cepat" ke versi o1, tetapi kemajuan penelitian dan pengembangan DeepSeek sangat pesat, mengejar lebih cepat dari yang diharapkan. Mereka tidak menjiplak atau menyontek, paling-paling mereka merekayasa balik.

- DeepSeek terutama melatih bakatnya sendiri, daripada mengandalkan PhD yang dilatih di Amerika, yang sangat memperluas kumpulan bakat.

- Dibandingkan dengan perusahaan-perusahaan AS, DeepSeek tunduk pada lebih sedikit kendala dalam hal lisensi kekayaan intelektual, privasi, keamanan, politik, dll., dan ada lebih sedikit kekhawatiran tentang penggunaan data yang salah yang tidak ingin dilatih. Tuntutan hukum lebih sedikit, lebih sedikit pengacara, dan lebih sedikit kekhawatiran.

Tidak diragukan lagi bahwa semakin banyak orang yang percaya bahwa tahun 2025 akan menjadi tahun yang menentukan. Sementara itu, perusahaan-perusahaan bersiap-siap untuk itu. Meta, misalnya, sedang membangun pusat data 2GW+, dengan perkiraan investasi sebesar $60-65 miliar pada tahun 2025, dan akan memiliki lebih dari 1,3 juta GPU pada akhir tahun.

Meta bahkan menggunakan grafik untuk membandingkan pusat data 2 gigawatt-nya dengan Manhattan, New York.

Tetapi sekarang DeepSeek telah bekerja lebih baik dengan biaya yang lebih rendah dan jumlah GPU yang lebih sedikit. Bagaimana mungkin hal ini tidak membuat orang cemas?

Yann LeCun: Kami harus berterima kasih kepada CTO dan salah satu pendiri yang sumber terbuka

Hiperbolis, Yuchen Jin, karena telah memposting bahwa hanya dalam waktu 4 hari, DeepSeek-R1 telah membuktikan 4 fakta kepada kami:

- AI sumber terbuka hanya tertinggal 6 bulan dari AI sumber tertutup

- Tiongkok mendominasi kompetisi AI sumber terbuka

- Kita memasuki masa keemasan pembelajaran penguatan model bahasa yang besar

- Model distilasi sangat kuat, dan kami akan menjalankan AI yang sangat cerdas pada ponsel

Reaksi berantai yang dipicu oleh DeepSeek masih terus berlanjut, seperti OpenAI o3-mini yang tersedia secara gratis, harapan di komunitas untuk mengurangi diskusi yang tidak jelas mengenai AGI/ASI, dan rumor bahwa Meta sedang panik.

Dia percaya bahwa sulit untuk memprediksi siapa yang pada akhirnya akan menang, tetapi kita tidak boleh melupakan kekuatan dari keunggulan pendatang baru. Bagaimanapun juga, kita semua tahu bahwa Google-lah yang menciptakan Transformer, sementara OpenAI membuka potensi sebenarnya.

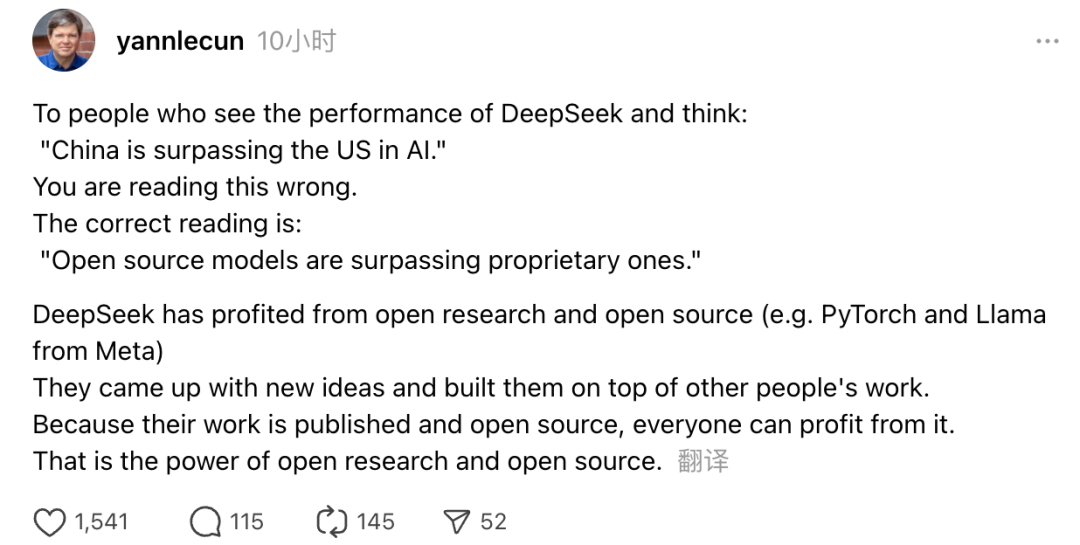

Selain itu, pemenang Turing Award dan Kepala Ilmuwan AI Meta, Yann LeCun, juga menyampaikan pandangannya.

"Bagi mereka yang, setelah melihat performa DeepSeek, berpikir, 'Tiongkok menyalip AS dalam hal AI,' Anda salah. Pemahaman yang benar adalah bahwa model open source menyalip model berpemilik."

LeCun mengatakan bahwa alasan DeepSeek membuat gebrakan kali ini adalah karena mereka telah mendapatkan keuntungan dari penelitian terbuka dan sumber terbuka (seperti PyTorch dan Llama dari Meta). DeepSeek telah menghasilkan ide-ide baru dan dibangun di atas karya orang lain. Karena karya mereka dirilis untuk umum dan sumber terbuka, semua orang dapat mengambil manfaat darinya. Inilah kekuatan dari penelitian terbuka dan sumber terbuka.

Refleksi netizen terus berlanjut. Meskipun mereka gembira dengan perkembangan teknologi baru, namun mereka juga bisa merasakan sedikit suasana cemas. Bagaimanapun, kemunculan DeepSeekers mungkin memiliki dampak yang nyata.