DeepSeek-R1 와 DeepSeek-V3는 오픈 소스 출시 이후 전 세계적으로 센세이션을 일으켰습니다.

DeepSeek 팀이 모든 인류에게 주는 선물이며, 저희는 그들의 성공을 진심으로 축하합니다.

실리콘 모빌리티와 화웨이 클라우드 팀의 며칠간의 노력 끝에, 오늘 중국 사용자들에게도 춘절 선물을 드립니다: 대규모 모델 클라우드 서비스 플랫폼인 실리콘클라우드가 화웨이 클라우드의 어센드 클라우드 서비스를 기반으로 하는 DeepSeek-V3 및 DeepSeek-R1을 출시했습니다.

DeepSeek-R1 및 V3를 Ascend에 적용하는 과정과 이전에 다른 모델을 출시하는 과정에서 DeepSeek와 화웨이 클라우드의 큰 지원을 받았음을 강조하며, 깊은 감사와 존경의 마음을 전합니다.

특징

실리콘클라우드가 출시한 이 두 모델은 크게 다섯 가지 주요 기능을 제공합니다:

화웨이 클라우드의 어센드 클라우드 서비스를 기반으로 다음과 같이 출시했습니다. DeepSeek x 실리콘 모빌리티 x 화웨이 클라우드 R1 및 V3 모델 추론 서비스를 최초로 도입했습니다.

양사 간의 공동 혁신과 자체 개발한 추론 가속 엔진의 지원을 통해, 화웨이 클라우드의 어센드 클라우드 서비스를 기반으로 실리콘 모빌리티 팀이 배포한 DeepSeek 모델은 전 세계 하이엔드 GPU 배포 모델과 동일한 효과를 얻을 수 있습니다.

안정적인 프로덕션 수준의 DeepSeek-R1 및 V3 추론 서비스를 제공합니다. 이를 통해 개발자는 대규모 프로덕션 환경에서 안정적으로 실행하고 상용 배포의 요구 사항을 충족할 수 있습니다. 화웨이 클라우드 어센드 AI 서비스는 풍부하고 탄력적이며 충분한 컴퓨팅 성능을 제공합니다.

배포 임계값이 없으므로 개발자는 애플리케이션 개발에 더 집중할 수 있습니다. 애플리케이션을 개발할 때 SiliconCloud API를 직접 호출할 수 있어 더욱 쉽고 사용자 친화적인 환경을 제공합니다.

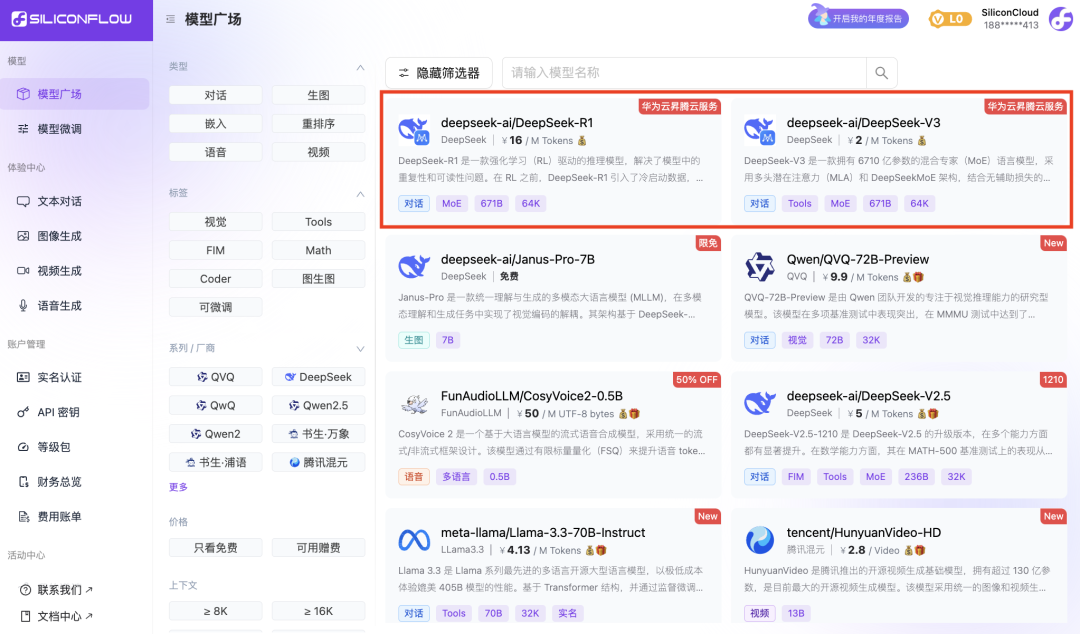

공식 할인 기간(2월 8일 24시까지) 동안 실리콘클라우드의 DeepSeek-V3 가격은 1M 토큰(입력) 1엔, 2M 토큰(출력)이며, DeepSeek-R1 가격은 4M 토큰(입력) 16엔, 2M 토큰(출력)입니다.

온라인 경험

DeepSeek-R1 실리콘클라우드

DeepSeek-V3 실리콘클라우드

API 문서

개발자는 실리콘클라우드에서 국내 칩에서 가속화된 DeepSeek-R1 및 V3의 효과를 경험할 수 있습니다. 더 빠른 출력 속도는 계속 최적화되고 있습니다.

클라이언트 애플리케이션 사용 경험

클라이언트 애플리케이션에서 DeepSeek-R1 및 V3 모델을 직접 체험하려면 다음 제품을 로컬에 설치하고 SiliconCloud API(이 두 모델을 사용자 지정하고 추가할 수 있음)에 액세스하여 DeepSeek-R1 및 V3를 체험할 수 있습니다.

- 대형 모델 클라이언트 애플리케이션: 채팅박스, 체리 스튜디오, OneAPI, 로브챗, 넥스트챗

- 코드 생성 애플리케이션: 커서, 윈드서핑, 클라인

- 대규모 모델 애플리케이션 개발 플랫폼:Dify

- AI 지식창고:옵시디언 AI및FastGPT

- 번역 플러그인:몰입형 번역 및 유로딕트

더 많은 시나리오 및 애플리케이션 사례 액세스 자습서를 보려면 다음을 참조하세요. 여기

토큰 팩토리 실리콘클라우드

Qwen2.5(7B) 등 20개 이상의 모델 무료 사용

대규모 모델을 위한 원스톱 클라우드 서비스 플랫폼인 SiliconCloud는 개발자에게 응답성이 뛰어나고 저렴하며 포괄적이고 매끄러운 경험을 제공하는 모델 API를 제공하기 위해 최선을 다하고 있습니다.

실리콘클라우드는 DeepSeek-R1 및 DeepSeek-V3 외에도 Janus-Pro-7B, CosyVoice2, QVQ-72B-Preview, DeepSeek-VL2, DeepSeek-V2.5-1210, Llama-3.3-70B-Instruct, HunyuanVideo, fish-speech-1.5, Qwen2.5 -7B/14B/32B/72B, FLUX.1도 출시했습니다, InternLM2.5-20B-Chat, BCE, BGE, SenseVoice-Small, GLM-4-9B-Chat,

수십 개의 오픈 소스 대규모 언어 모델, 이미지/비디오 생성 모델, 음성 모델, 코드/수학 모델, 벡터 및 재주문 모델 등을 지원합니다.

이 플랫폼을 통해 개발자는 다양한 양식의 대규모 모델을 자유롭게 비교하고 결합하여 제너레이티브 AI 애플리케이션에 적합한 모범 사례를 선택할 수 있습니다.

그 중 Qwen2.5(7B), Llama3.1(8B) 등 20개 이상의 대형 모델 API를 무료로 사용할 수 있어 개발자와 제품 관리자는 연구 개발 단계와 대규모 프로모션에서 컴퓨팅 파워 비용 걱정 없이 "토큰 프리"를 실현할 수 있습니다.