Atskleista DeepSeek-R1 technologija: išardomi pagrindiniai popieriaus principai ir atskleistas raktas į proveržio modelio veikimą

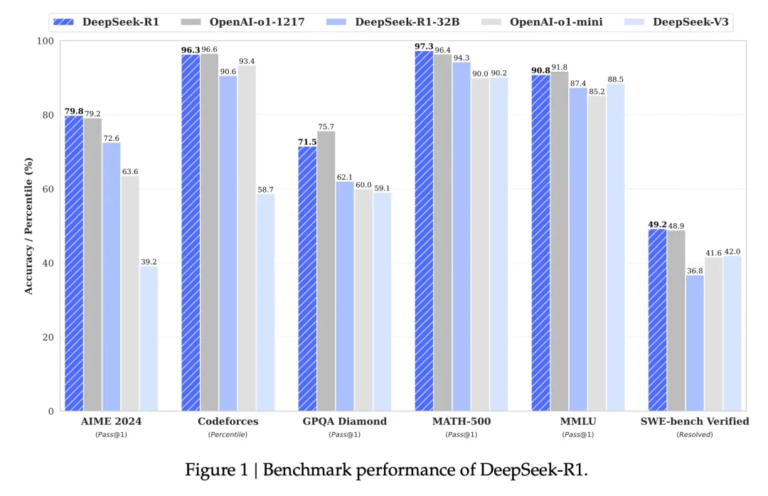

Šiandien pasidalinsime DeepSeek R1, pavadinimas: DeepSeek-R1: Mokymosi gebėjimų skatinimas LLM per stiprinimo mokymąsi: LLM samprotavimo gebėjimų skatinimas per stiprinimo mokymąsi. Šiame straipsnyje pristatomi pirmosios kartos DeepSeek samprotavimo modeliai DeepSeek-R1-Zero ir DeepSeek-R1. DeepSeek-R1-Zero modelis buvo apmokytas naudojant didelio masto sustiprinimo mokymąsi (RL) be prižiūrimo tikslaus derinimo (SFT) kaip pradinio žingsnio,…