DeepSeek-R1 dan DeepSeek-V3 telah menyebabkan sensasi global sejak pelancaran sumber terbuka mereka.

Mereka adalah hadiah daripada pasukan DeepSeek kepada semua manusia, dan kami amat gembira atas kejayaan mereka.

Selepas berhari-hari bekerja keras oleh pasukan Silicon Mobility dan Huawei Cloud, hari ini kami turut memberikan hadiah Tahun Baru Cina kepada pengguna China: platform perkhidmatan awan model berskala besar SiliconCloud telah melancarkan DeepSeek-V3 dan DeepSeek-R1, yang berdasarkan perkhidmatan awan Ascend Huawei Cloud.

Perlu ditekankan bahawa kami telah menerima sokongan hebat daripada DeepSeek dan Huawei Cloud, kedua-duanya dalam menyesuaikan DeepSeek-R1 & V3 pada Ascend dan dalam proses melancarkan model lain sebelum ini, dan kami ingin mengucapkan terima kasih yang mendalam dan penghormatan yang tinggi.

Ciri-ciri

Kedua-dua model yang dilancarkan oleh SiliconCloud ini terutamanya termasuk lima ciri utama:

Berdasarkan perkhidmatan awan Ascend Huawei Cloud, kami telah melancarkan DeepSeek x Mobiliti Silikon x Perkhidmatan inferens model Huawei Cloud R1 & V3 buat kali pertama.

Melalui inovasi bersama antara kedua-dua pihak, dan dengan sokongan enjin pecutan inferens yang dibangunkan sendiri, model DeepSeek yang digunakan oleh pasukan Silicon Mobility berdasarkan perkhidmatan awan Ascend Huawei Cloud boleh mencapai kesan yang sama seperti model penggunaan GPU mewah. di dunia.

Menyediakan perkhidmatan inferens DeepSeek-R1 & V3 peringkat pengeluaran yang stabil. Ini membolehkan pembangun berjalan secara stabil dalam persekitaran pengeluaran berskala besar dan memenuhi keperluan penggunaan komersial. Perkhidmatan AI Cloud Ascend Huawei menyediakan kuasa pengkomputeran yang banyak, anjal dan mencukupi.

Tiada ambang penggunaan, membolehkan pembangun menumpukan lebih pada pembangunan aplikasi. Apabila membangunkan aplikasi, mereka boleh menghubungi terus API SiliconCloud, yang menyediakan pengalaman yang lebih mudah dan lebih mesra pengguna.

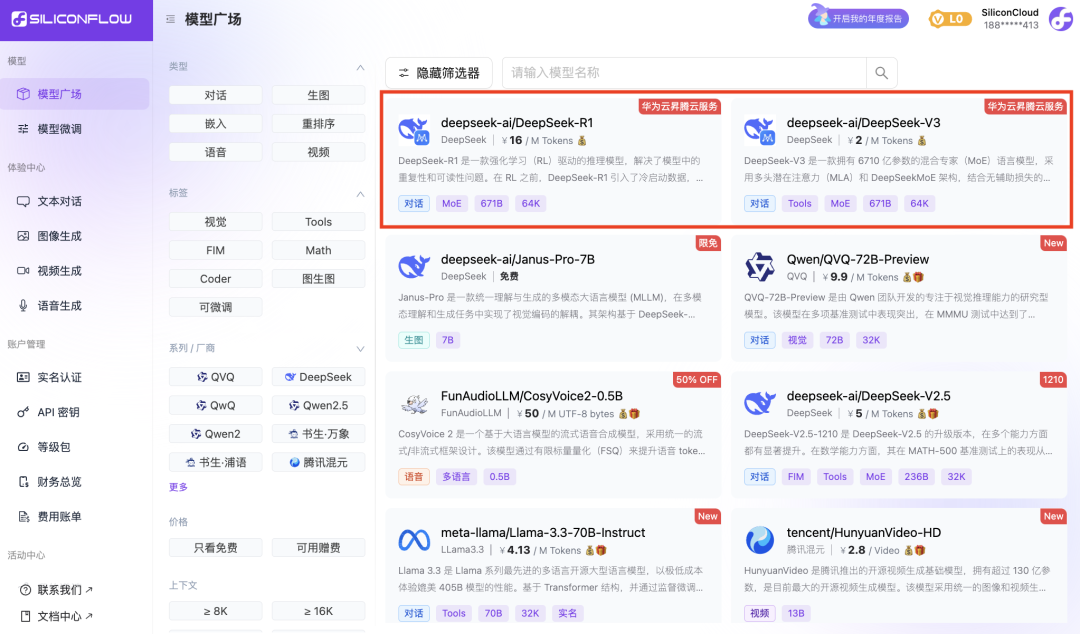

Harga DeepSeek-V3 di SiliconCloud semasa tempoh diskaun rasmi (sehingga 24:00 pada 8 Februari) ialah ¥1 / M token (input) & ¥2 / M token (output), dan harga DeepSeek-R1 ialah ¥4 / Token M (input) & token ¥16 / M (output).

Pengalaman dalam talian

DeepSeek-R1 dengan SiliconCloud

DeepSeek-V3 dengan SiliconCloud

dokumentasi API

Pembangun boleh mengalami kesan DeepSeek-R1 & V3 dipercepatkan pada cip domestik pada SiliconCloud. Kelajuan keluaran yang lebih pantas masih dioptimumkan secara berterusan.

Pengalaman dalam permohonan pelanggan

Jika anda ingin mengalami model DeepSeek-R1 & V3 secara langsung dalam aplikasi pelanggan, anda boleh memasang produk berikut secara setempat dan mengakses API SiliconCloud (anda boleh menyesuaikan dan menambah kedua-dua model ini) untuk mengalami DeepSeek-R1 & V3.

- Aplikasi pelanggan model besar: Kotak Sembang, Studio Ceri, OneAPI, LobeChat, NextChat

- Aplikasi penjanaan kod: Kursor, Luncur Angin, Cline

- Platform pembangunan aplikasi model besar:Dify

- Pangkalan pengetahuan AI:AI Obsidian, danFastGPT

- pemalam terjemahan:Terjemahan Imersif, danEurodict

Untuk lebih banyak senario dan tutorial akses kes aplikasi, sila rujuk di sini

Kilang Token SiliconCloud

Qwen2.5 (7B), dsb. 20+ model percuma untuk digunakan

Sebagai platform perkhidmatan awan sehenti untuk model besar, SiliconCloud komited untuk menyediakan pembangun API model yang sangat responsif, mampu milik, komprehensif dan mempunyai pengalaman yang selembut sutera.

Selain DeepSeek-R1 dan DeepSeek-V3, SiliconCloud juga telah melancarkan Janus-Pro-7B, CosyVoice2, QVQ-72B-Preview, DeepSeek-VL2, DeepSeek-V2.5-1210, Llama-3.3-70B-Instruct, Hunyuan , pertuturan ikan-1.5, Qwen2.5 -7B/14B/32B/72B, FLUX.1, InternLM2.5-20B-Chat, BCE, BGE, SenseVoice-Small, GLM-4-9B-Chat,

berpuluh-puluh model bahasa besar sumber terbuka, model penjanaan imej/video, model pertuturan, model kod/matematik dan vektor dan model penyusunan semula.

Platform ini membolehkan pembangun membandingkan dan menggabungkan model besar pelbagai modaliti secara bebas untuk memilih amalan terbaik untuk aplikasi AI generatif anda.

Antaranya, 20+ API model besar seperti Qwen2.5 (7B) dan Llama3.1 (8B) adalah percuma untuk digunakan, membolehkan pembangun dan pengurus produk mencapai "kebebasan token" tanpa perlu risau tentang kos kuasa pengkomputeran semasa penyelidikan dan peringkat pembangunan dan promosi berskala besar.