The Mfano wa DeepSeek R1 imepitia uboreshaji wa toleo dogo, na toleo la sasa likiwa DeepSeek-R1-0528. Unapoingiza ukurasa wa tovuti wa DeepSeek au programu, washa kipengele cha "Kufikiri kwa Kina" katika kiolesura cha mazungumzo ili upate toleo jipya zaidi.

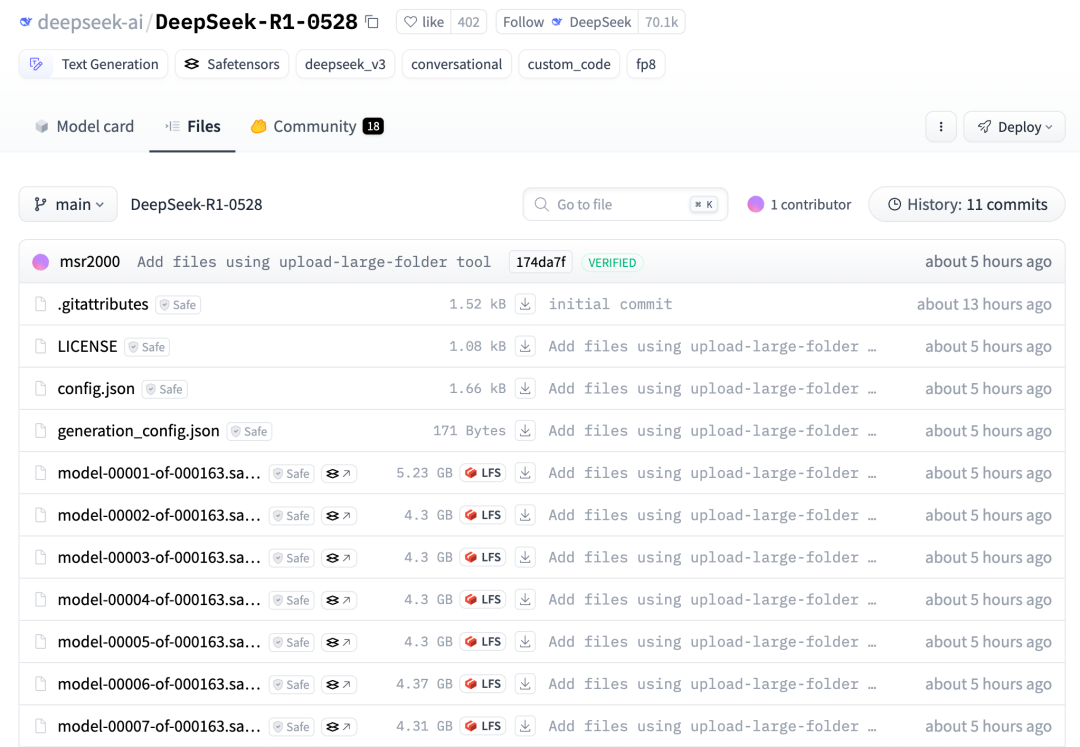

Vipimo vya uzani vya DeepSeek-R1-0528 vimepakiwa kwenye HuggingFace

Katika kipindi cha miezi minne iliyopita, DeepSeek-R1 imepitia mageuzi makubwa, na kufikia uwezo wa usimbaji ambao hauko kwenye chati na muda mrefu zaidi wa kufikiria. Ingawa inaweza kuwa sio DeepSeek-R2 kila mtu alikuwa akitarajia, maboresho katika modeli ya DeepSeek-R1-0528 ni makubwa.

Kulingana na ripoti, mtindo mpya umefunzwa kwenye DeepSeek-V3-0324 (na vigezo 660B).

Hebu kwanza tuangalie kwa haraka masasisho muhimu katika toleo hili kupitia jedwali

| Kipimo cha Uwezo | deepseek-R1 | Deepseek-R1-0528 |

| Upeo Muktadha | 64k(API) | 128K(API) hata zaidi |

| Uzalishaji wa Kanuni | liveCodeBench funga openai O1 | Karibu na O3 |

| Undani wa Kusababu | Maswali changamano yanahitaji vidokezo vilivyogawanywa. | Inasaidia dakika 30-60 za kufikiri kwa kina |

| Usawa wa Lugha | badala ndefu | Muundo wa kompakt, kuandika sawa na O3 |

| Gharama ya Matumizi | Chanzo-wazi au API$0.5/M | Chanzo-wazi au API$0.5/M |

Kuimarishwa kwa uwezo wa kufikiri kwa kina

DeepSeek-R1-0528 bado inatumia muundo wa DeepSeek V3 Base uliotolewa Desemba 2024 kama msingi wake, lakini wakati wa mafunzo baada ya mafunzo, nguvu zaidi ya kompyuta iliwekezwa, na kuimarisha kwa kiasi kikubwa uwezo wa kufikiri wa modeli na uwezo wa kufikiri.

Muundo uliosasishwa wa R1 umepata utendaji wa kiwango cha juu kati ya miundo yote ya ndani katika tathmini nyingi za viwango, ikijumuisha hisabati, upangaji programu, na mantiki ya jumla, na utendaji wake wa jumla sasa unalingana na miundo mingine ya kiwango cha juu cha kimataifa kama vile o3 na Gemini-2.5-Pro.

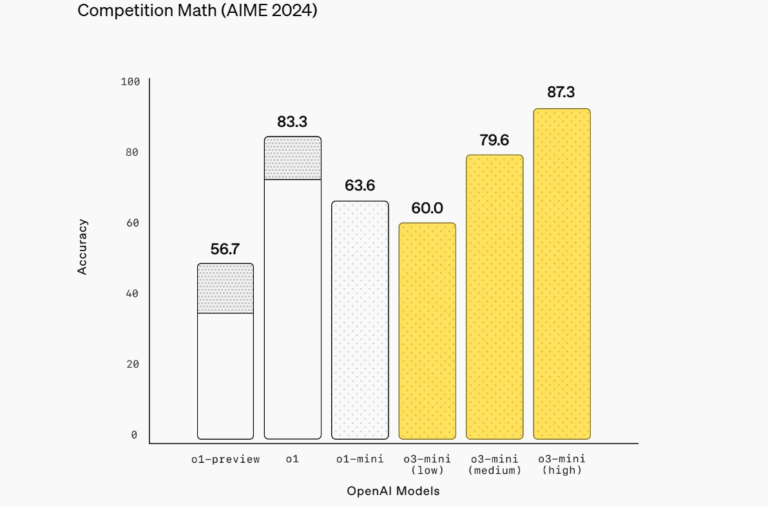

- Uwezo wa Hisabati na programu: Katika shindano la hisabati la AIME 2025, usahihi uliboreshwa kutoka 70% katika toleo la awali hadi 87.5%; uwezo wa kuzalisha msimbo katika jaribio la kuigwa la LiveCodeBench unakaribia kuwa sawa na modeli ya o3 ya juu ya OpenAI, kupata alama ya pass@1 ni 73.3%.

Vipimo vya mtumiaji vinaonyesha kuwa DeepSeek-R1 mpya inashangaza tu katika upangaji programu!

Mtaalamu wa AI "karminski-dentist" alipima DeepSeek-R1-0528 na Claude 4 Sonnet kwa kutumia dodoso sawa na kugundua kuwa:

Iwe ni kuangazia kwa mwanga kwenye ukuta, mwelekeo wa harakati ya mpira baada ya athari, au mvuto wa urembo wa paneli dhibiti, R1 inashinda shindano kwa njia dhahiri.

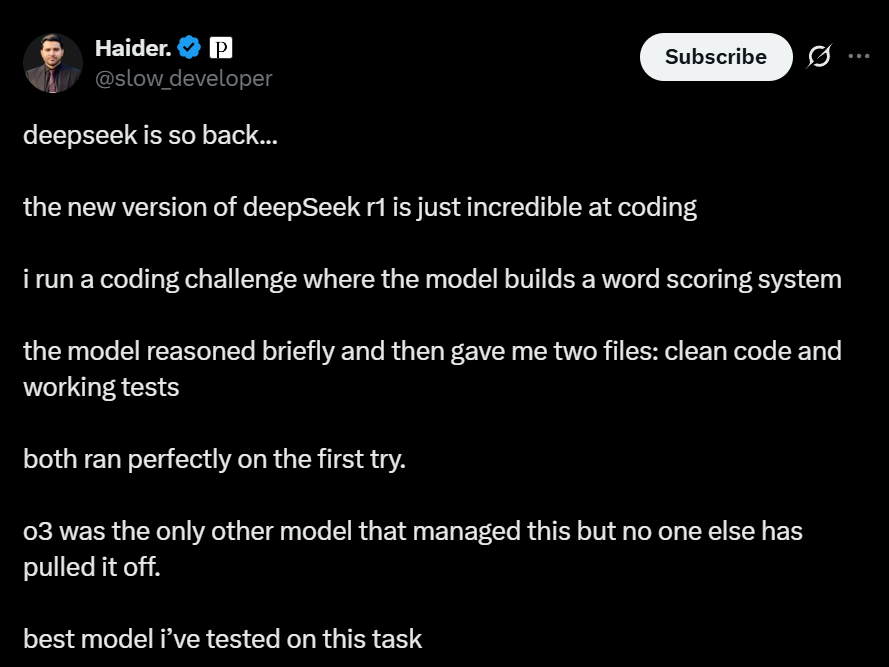

Mtumiaji Haider. alikuwa na mfano kujenga mfumo wa bao neno. R1 ilizingatia kazi hiyo kwa ufupi na ikatoa faili mbili mara moja—moja kwa ajili ya msimbo na nyingine kwa ajili ya majaribio ya kazi—ambayo ilifanya kazi bila dosari kwenye jaribio la kwanza.

Hapo awali, o3 ilikuwa mfano pekee wenye uwezo wa kukamilisha kazi hii. Sasa, R1 bila shaka ni mfano bora wa kazi hii.

Kumbuka kuwa utendakazi wa R1 ni wa kustaajabisha sana kwa sababu faili mbili inazorudisha huendeshwa bila dosari kwenye jaribio la kwanza, bila kuhaririwa au kujaribu tena, ambayo ni nadra sana.

Hapo awali, miundo mingi aidha ilikomeshwa katika visa vikali, ilifanya suluhu kuwa ngumu kupita kiasi, au ilikosa chanjo ya kutosha ya majaribio.

- Kina cha uelekezaji: Muda wa kufikiria wa kazi moja umeongezwa hadi dakika 30-60, na uwezo wa kutatua matatizo ulioimarishwa zaidi kwa masuala changamano (km, uigaji wa fizikia, mafumbo yenye mantiki ya hatua nyingi).

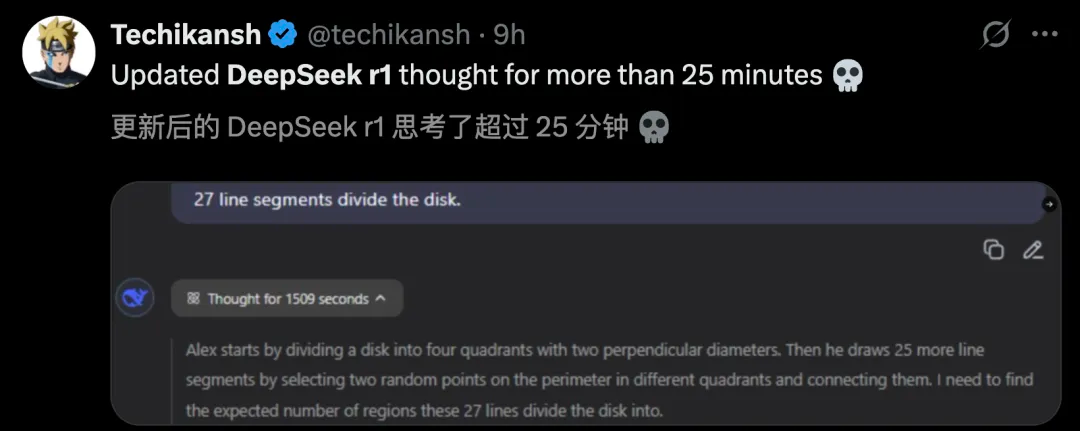

Muda wa kufikiria tena umekuwa kipengele kinachojadiliwa zaidi mtandaoni. Baadhi ya watumiaji waliripoti kuwa muda wa kufikiri wa R1 ulizidi dakika 25 katika majaribio ya ulimwengu halisi.

Zaidi ya hayo, huu unaonekana kuwa mtindo pekee unaoweza kujibu kwa usahihi kila mara "9.9 minus 9.11 ni nini?"

DeepSeek-R1-0528 ilipata utendaji bora kwenye seti zote za data za tathmini

Ikilinganishwa na toleo la awali la R1, mtindo mpya unaonyesha maboresho makubwa katika kazi changamano za hoja. Kwa mfano, katika jaribio la AIME 2025, kiwango cha usahihi cha muundo mpya kiliongezeka kutoka 70% hadi 87.5%.

Uboreshaji huu unatokana na kina kilichoimarishwa cha hoja katika muundo: kwenye seti ya jaribio la AIME 2025, muundo wa zamani ulitumia wastani wa tokeni 12K kwa kila swali, huku muundo mpya ukitumia wastani wa tokeni 23K kwa kila swali, ikionyesha mawazo ya kina na ya kina katika mchakato wa kutatua matatizo.

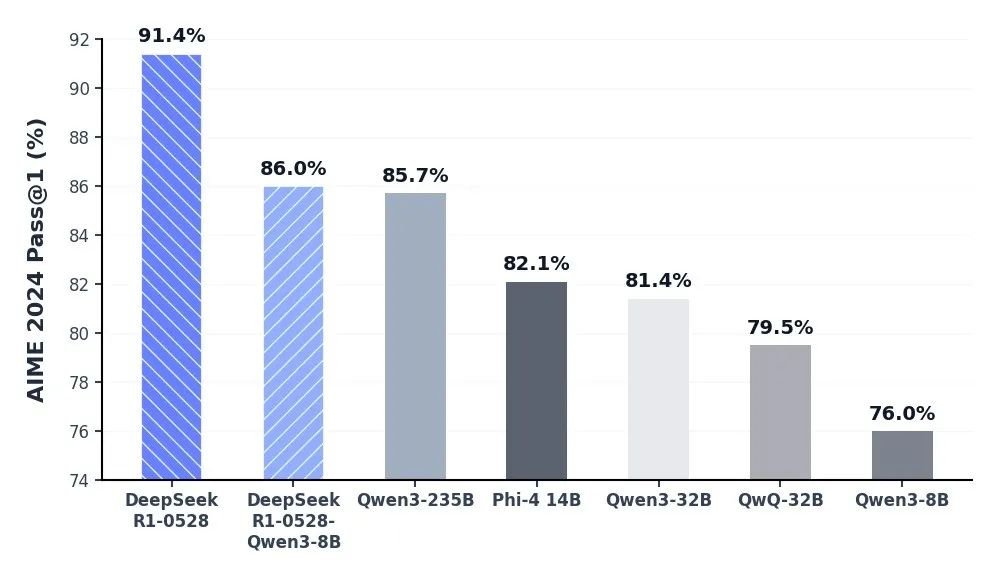

Zaidi ya hayo, timu ya deepseek ilisafisha msururu wa hoja kutoka DeepSeek-R1-0528 na Msingi wa Qwen3-8B uliowekwa vizuri, na kusababisha DeepSeek-R1-0528-Qwen3-8B.

Muundo huu wa 8B ulishika nafasi ya pili baada ya DeepSeek-R1-0528 katika jaribio la hesabu la AIME 2024, ulifanya vyema zaidi Qwen3-8B (+10.0%) na kulingana na Qwen3-235B.

Misururu ya hoja ya DeepSeek-R1-0528 italeta athari kubwa kwa utafiti wa kitaaluma kuhusu miundo ya kufikiri na ukuzaji wa kiviwanda wa miundo midogo midogo.

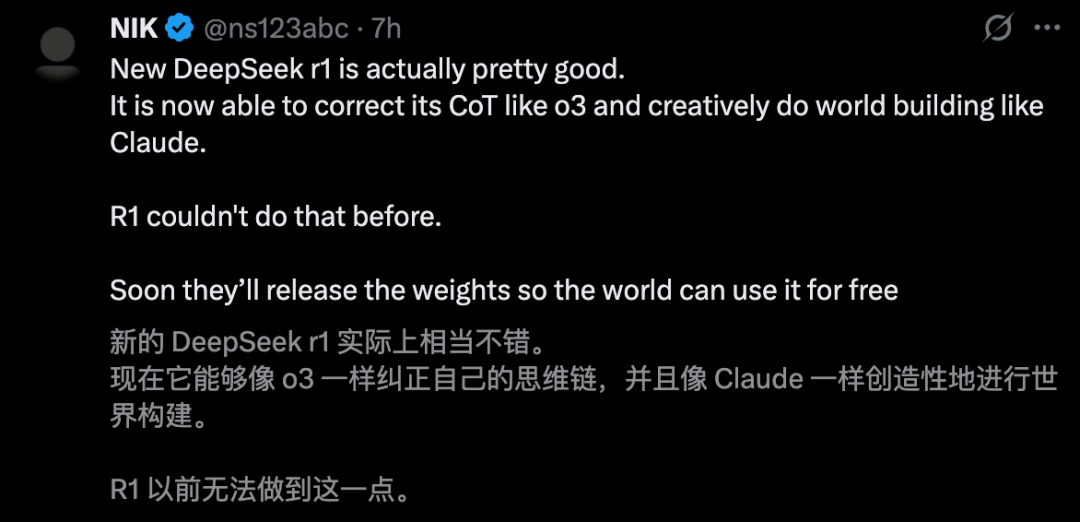

Baadhi ya watumiaji wa mtandao waliisifu DeepSeek-R1 kwa kuweza kusahihisha misururu ya hoja kama o3 na kuunda ulimwengu kwa ubunifu kama Claude.

Ni muhimu kutambua kwamba DeepSeek ni mfano wa chanzo-wazi, unaoashiria ushindi mkubwa kwa mifano ya chanzo-wazi.

Matokeo ya kulinganisha ya AIME 2024 kwa mifano ya chanzo huria kama vile DeepSeek-R1-0528-Qwen3-8B

Sasisho zingine za uwezo

- Uboreshaji wa ufahamu: Toleo jipya la DeepSeek R1 limeboresha utendaji wa masuala ya "hallucination". Ikilinganishwa na toleo la awali, muundo uliosasishwa hufanikisha punguzo la 45–50% katika viwango vya maono katika kazi zote kama vile kuandika upya na kung'arisha, muhtasari na ufahamu wa kusoma, na kutoa matokeo sahihi na ya kuaminika zaidi.

- Uandishi Ubunifu: Kulingana na toleo la awali la R1, modeli iliyosasishwa ya R1 imeboreshwa zaidi kwa mitindo ya uandishi wa insha, riwaya, na nathari, na kuiwezesha kutoa kazi ndefu zaidi, kamili zaidi za kimuundo huku ikiwasilisha mtindo wa uandishi unaolingana zaidi na matakwa ya binadamu.

- Ombi la zana: DeepSeek-R1-0528 inasaidia ombi la zana (maombi ya zana hayatumiki katika kufikiria). Alama za tathmini za muundo wa sasa wa Tau-Bench ni 53.5% kwa ndege na 63.9% kwa rejareja, ikilinganishwa na OpenAI o1-high, lakini bado iko nyuma ya o3-High na Claude 4 Sonnet.

Mfano unaonyesha muhtasari wa makala ya wavuti uliotolewa kwa kutumia uwezo wa uombaji wa zana wa DeepSeek-R1-0528 kupitia LobeChat. Kwa kuongezea, DeepSeek-R1-0528 imesasishwa na kuboreshwa katika maeneo kama vile utengenezaji wa msimbo wa mbele na uigizaji dhima.

Mfano unaonyesha utumizi wa kadi ya maneno ya kisasa na ya kiwango cha chini kabisa iliyotengenezwa kwa kutumia HTML/CSS/JavaScript kwa kutumia DeepSeek-R1-0528 kwenye ukurasa wa wavuti.

Vivutio muhimu vya sasisho la DeepSeek-R1-0528

- Uwezo wa kina wa hoja unaolinganishwa na miundo ya Google

- Uboreshaji wa kutengeneza maandishi: asili zaidi na umbizo bora zaidi

- Mtindo wa kipekee wa kufikiria: sio haraka tu, bali pia kwa ukali zaidi

- Usaidizi wa kufikiri kwa muda mrefu: muda wa usindikaji wa kazi moja unaweza kufikia dakika 30-60

Uwezo wa toleo jipya la DeepSeek-R1 umejaribiwa na sisi. Ingawa ni sasisho la "toleo dogo", utendakazi wake 'umeimarishwa'.

Hasa katika suala la uwezo wa programu, inahisi kama imepita au iko sawa na Claude 4 na Gemini 2.5 Pro. Vidokezo vyote ni "picha moja," bila kuhitaji marekebisho! Na inaweza kuendeshwa moja kwa moja kwenye kivinjari ili kuonyesha uwezo wake.

Unaweza kuhisi wazi kuwa mchakato wa kufikiria wa toleo jipya la DeepSeek-R1 ni thabiti zaidi.

Unaweza kuuliza deepseek-R1 swali lolote unalotaka kujua jibu lake, hata kama swali lako si la maana kidogo, bado itatafakari kwa makini na kupanga mantiki. Tunapendekeza sana ujaribu mtindo wa hivi punde zaidi wa deepseek-R1.

Taarifa ya sasisho la API

API imesasishwa, lakini kiolesura na mbinu za kupiga simu bado hazijabadilika. API mpya ya R1 bado inasaidia kutazama mchakato wa kufikiria wa modeli na sasa pia inasaidia Upigaji simu wa Kazi na JsonOutput.

Timu ya deepseek imerekebisha maana ya kigezo cha max_tokens katika API mpya ya R1: max_tokens sasa inaweka kikomo jumla ya urefu wa toleo moja la modeli (pamoja na mchakato wa kufikiria), na thamani chaguo-msingi ya 32K na isiyozidi 64K. Watumiaji wa API wanashauriwa kurekebisha kigezo cha max_tokens mara moja ili kuzuia pato kupunguzwa kabla ya wakati.

Kwa maagizo ya kina juu ya kutumia mfano wa R1, tafadhali rejelea Mwongozo wa API ya deepseek R1:

Baada ya sasisho hili la R1, urefu wa muktadha wa mfano kwenye tovuti rasmi, programu ndogo, programu na API utabaki 64K. Ikiwa watumiaji wanahitaji urefu wa muktadha, wanaweza kupigia simu toleo la chanzo huria la muundo wa R1-0528 lenye urefu wa muktadha wa 128K kupitia mifumo mingine ya watu wengine.

Chanzo wazi

DeepSeek-R1-0528 hutumia muundo wa msingi sawa na DeepSeek-R1 ya awali, na uboreshaji pekee umefanywa kwa mbinu za baada ya mafunzo.

Wakati wa kupeleka kwa faragha, ni sehemu ya ukaguzi na tokenizer_config.json pekee (mabadiliko yanayohusiana na simu) zinazohitaji kusasishwa. Vigezo vya mfano ni 685B (ambayo 14B ni ya safu ya MTP), na toleo la chanzo huria lina urefu wa muktadha wa 128K (urefu wa muktadha wa 64K umetolewa kwa wavuti, programu na API).