Hakuna hata mmoja wetu aliyetarajia kuwa hivi ndivyo 2025 ingeanza katika uwanja wa AI.

DeepSeek R1 ni ajabu kweli!

Hivi majuzi, "nguvu ya ajabu ya Mashariki" DeepSeek imekuwa "kudhibiti kwa bidii" Silicon Valley.

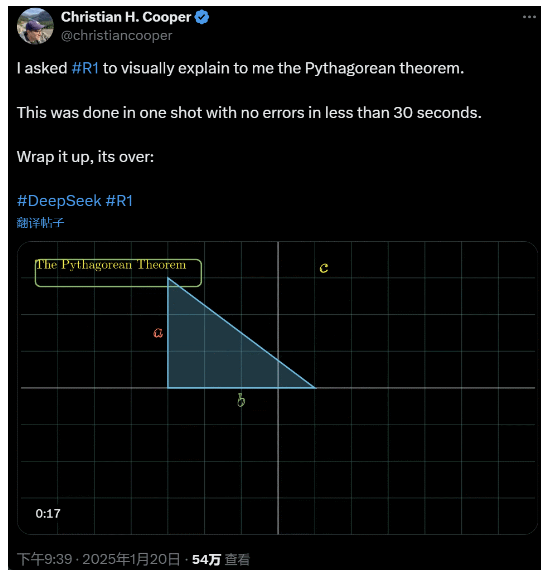

Niliuliza R1 kuelezea nadharia ya Pythagorean kwa undani. Haya yote yalifanywa na AI kwa chini ya sekunde 30 bila makosa yoyote. Kwa kifupi, imekwisha.

Katika miduara ya ndani na nje ya AI, watumiaji wa kawaida wa mtandao wamegundua AI mpya ya kushangaza na yenye nguvu (ambayo pia ni chanzo wazi), na wataalam wa kitaaluma wamepiga kelele "lazima tupate". Pia kuna tetesi kwamba kampuni za AI za ng'ambo tayari zinakabiliwa na tishio kubwa.

Chukua tu DeepSeek R1 hii iliyotolewa wiki hii. Njia yake safi ya kujifunzia bila mafunzo yoyote yanayosimamiwa inashtua. Kuanzia uundaji wa msingi wa Deepseek-v3 mnamo Desemba mwaka jana hadi uwezo wa sasa wa mnyororo wa kufikiria unaolinganishwa na OpenAI o1, inaonekana kuwa suala la muda.

Lakini wakati jumuiya ya AI inashughulika kusoma ripoti za kiufundi na kulinganisha vipimo halisi, watu bado wana shaka kuhusu R1: mbali na kuwa na uwezo wa kushinda rundo la vigezo, je inaweza kweli kuongoza?

Je, inaweza kujenga uigaji wake wa "sheria za kimwili"?

Huamini? Hebu tuache mwanamitindo mkubwa acheze na mpira wa pini?

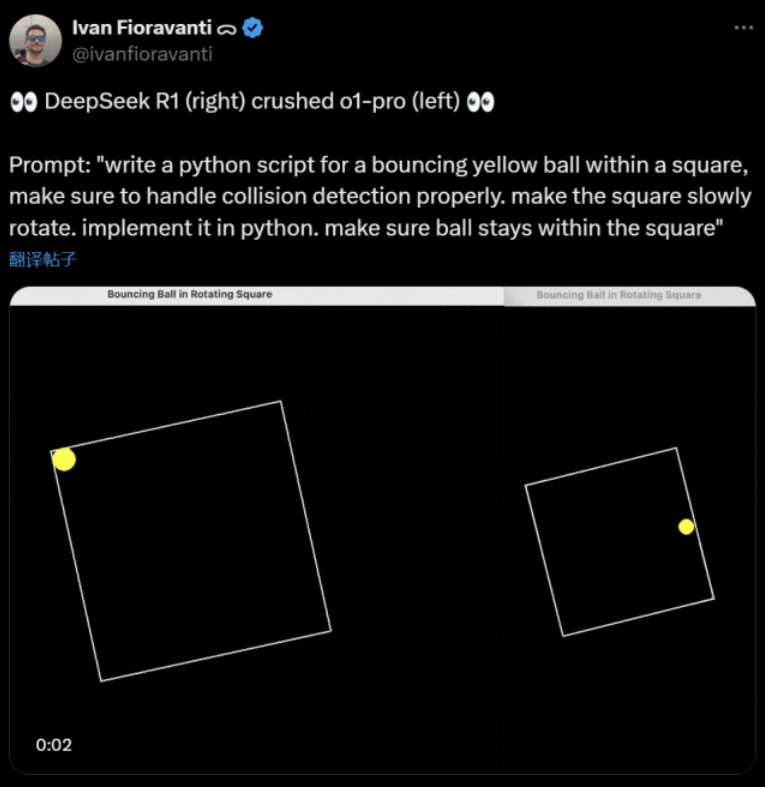

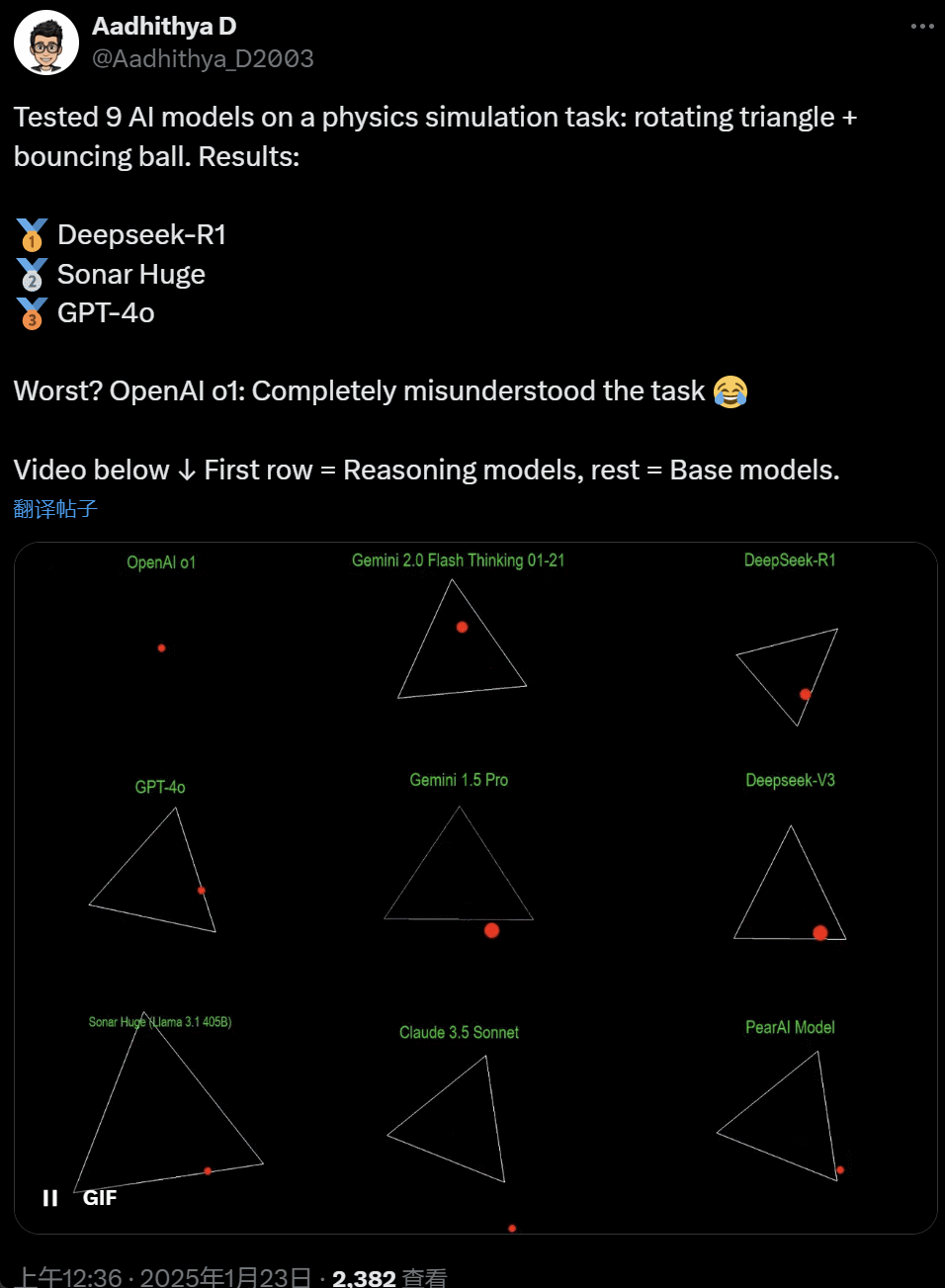

Katika siku za hivi majuzi, baadhi ya watu katika jumuiya ya AI wamehangaishwa na jaribio - wakijaribu mifano mikubwa ya AI (haswa ile inayoitwa mifano ya kufikiria) ili kutatua tatizo: "Andika hati ya Python ili kufanya mpira wa manjano kuruka ndani ya sehemu fulani. umbo. Fanya umbo lizunguke polepole na hakikisha mpira unabaki ndani ya umbo hilo."

Baadhi ya miundo inashinda zingine katika kiwango hiki cha "mpira unaozunguka". Kulingana na CoreView CTO Ivan Fioravanti, DeepSeek, maabara ya kijasusi ya ndani, ina chanzo wazi cha modeli kubwa R1 ambayo inashinda modeli ya o1 ya OpenAI, ambayo hugharimu $200 kwa mwezi kama sehemu ya mpango wa OpenAI's ChatGPT Pro.

Upande wa kushoto ni OpenAI o1, na kulia ni DeepSeek R1. Kama ilivyotajwa hapo juu, haraka hapa ni: "andika hati ya chatu kwa mpira wa manjano unaodunda ndani ya mraba, hakikisha kushughulikia ugunduzi wa mgongano vizuri. fanya mraba kuzunguka polepole. kutekeleza katika python. hakikisha mpira unabaki ndani ya uwanja."

Kulingana na mtumiaji mwingine kwenye X, miundo ya Anthropic Claude 3.5 Sonnet na Google Gemini 1.5 Pro zilifanya maamuzi yasiyo sahihi kuhusu kanuni za kimwili, na kusababisha mpira kupotoka kutoka kwa umbo lake. Watumiaji wengine pia wameripoti kwamba Jaribio la hivi punde la Google la Gemini 2.0 Flash Thinking, pamoja na OpenAI GPT-4o ya zamani zaidi, ilipitisha tathmini mara moja.

Lakini kuna njia ya kusema tofauti hapa:

Wanamtandao chini ya tweet hii walisema: uwezo wa o1 awali ulikuwa mzuri sana, lakini ulipungua baada ya OpenAI kuboresha kasi, hata kwa toleo la uanachama la $200/mwezi.

Kuiga mpira unaodunda ni changamoto ya kawaida ya upangaji. Uigaji sahihi unachanganya kanuni za utambuzi wa mgongano, ambazo zinahitaji kutambua wakati vitu viwili (kama vile mpira na upande wa umbo) vinapogongana. Algorithm iliyoandikwa vibaya inaweza kuathiri utendaji wa simulation au kusababisha makosa dhahiri ya mwili.

Programu za N8, mtafiti katika shirika la AI la Nous Research, alisema ilimchukua kama saa mbili kuandika mpira unaodunda kwenye heptagoni inayozunguka kutoka mwanzo. "Mifumo mingi ya kuratibu lazima ifuatiliwe, uelewa wa jinsi migongano inashughulikiwa katika kila mfumo inahitajika, na kanuni lazima iundwe kutoka mwanzo ili iwe thabiti."

Ingawa mipira ya kudunda na maumbo ya kusokota ni jaribio la kuridhisha la ustadi wa kupanga programu, bado ni miradi mipya kwa miundo mikubwa, na hata mabadiliko madogo katika maongozi yanaweza kutoa matokeo tofauti. Kwa hivyo ikiwa hatimaye kuwa sehemu ya jaribio la kuigwa kwa miundo mikubwa ya AI, bado inahitaji kuboreshwa.

Kwa hali yoyote, baada ya wimbi hili la vipimo vya vitendo, tuna hisia ya tofauti katika uwezo kati ya mifano kubwa.

DeepSeek ni hadithi mpya ya "Silicon Valley

DeepSeek inaleta hofu” kote katika Pasifiki.

Wafanyikazi wa Meta wamechapisha kuwa "Wahandisi wa Meta wanachambua DeepSeek kwa bidii ili kujaribu kunakili chochote wanachoweza kutoka kwayo."

Alexandr Wang, mwanzilishi wa AI ya uanzishaji wa teknolojia ya AI, pia alisema hadharani kwamba utendakazi wa modeli kubwa ya DeepSeek ya AI ni takribani sawa na muundo bora zaidi nchini Marekani.

Anaamini pia kuwa Merika inaweza kuwa mbele ya Uchina katika shindano la AI katika muongo mmoja uliopita, lakini kutolewa kwa DeepSeek kwa muundo wake mkubwa wa AI kunaweza "kubadilisha kila kitu."

X Blogger @8teAPi inaamini kuwa DeepSeek si "mradi wa kando" lakini ni kama "Skunk Works" ya Lockheed Martin ya zamani.

Kinachojulikana kama "Skunk Works" kinarejelea timu ndogo iliyo na usiri mkubwa, na huru kiasi ambayo awali Lockheed Martin ilianzisha ili kuunda ndege nyingi za hali ya juu, zinazojishughulisha na utafiti na maendeleo ya teknolojia ya kisasa au isiyo ya kawaida. Kutoka kwa ndege ya upelelezi ya U-2 na SR-71 Blackbird hadi F-22 Raptor na mpiganaji wa F-35 Lightning II, wote walitoka hapa.

Baadaye, neno hili polepole lilibadilika na kuwa neno la jumla linalotumiwa kuelezea "ndogo lakini sawa", timu za ubunifu zinazojitegemea na rahisi zaidi zilizoanzishwa ndani ya makampuni makubwa au mashirika.

Alitoa sababu mbili:

- Kwa upande mmoja, DeepSeek ina idadi kubwa ya GPU, zinazoripotiwa kuwa zaidi ya 10,000, na Alexandr Wang, Mkurugenzi Mtendaji wa Scale AI, hata alisema inaweza kufikia 50,000.

- Kwa upande mwingine, DeepSeek huajiri tu talanta kutoka vyuo vikuu vitatu bora nchini Uchina, ambayo inamaanisha kuwa DeepSeek ina ushindani kama Alibaba na Tencent.

Mambo haya mawili pekee yanaonyesha kuwa DeepSeek imepata mafanikio ya kibiashara kwa uwazi na inajulikana vya kutosha kupata rasilimali hizi.

Kuhusu gharama za maendeleo za DeepSeek, mwanablogu huyo alisema kuwa makampuni ya teknolojia ya China yanaweza kupokea ruzuku mbalimbali, kama vile gharama ndogo za umeme na matumizi ya ardhi.

Kwa hivyo, kuna uwezekano mkubwa kwamba gharama nyingi za DeepSeek "zimewekwa" katika akaunti nje ya biashara kuu au kwa namna ya aina fulani ya ruzuku ya ujenzi wa kituo cha data.

Hata mbali na waanzilishi, hakuna mtu anayeelewa kikamilifu mipango yote ya kifedha. Makubaliano mengine yanaweza kuwa "makubaliano ya maneno" ambayo hukamilishwa kwa kuzingatia sifa pekee.

Bila kujali, mambo machache ni wazi:

- Mfano huo ni bora, ukilinganishwa na toleo lililotolewa na OpenAI miezi miwili iliyopita, na bila shaka inawezekana kwamba si nzuri kama mifano mpya ambayo OpenAI na Anthropic bado haijatoa.

- Kwa mtazamo wa sasa, mwelekeo wa utafiti bado unaongozwa na makampuni ya Marekani. Muundo wa DeepSeek ni "ufuatiliaji wa haraka" wa toleo la o1, lakini maendeleo ya utafiti na usanidi wa DeepSeek ni ya haraka sana, yanafikiwa haraka kuliko ilivyotarajiwa. Sio wizi wa maandishi au kudanganya, kwa kiasi kikubwa wao ni uhandisi wa kinyume.

- DeepSeek inafunza talanta yake yenyewe, badala ya kutegemea PhD zilizofunzwa kutoka Amerika, ambayo huongeza sana kundi la talanta.

- Ikilinganishwa na makampuni ya Marekani, DeepSeek inakabiliwa na vikwazo vichache katika suala la utoaji leseni ya uvumbuzi, faragha, usalama, siasa, n.k., na kuna wasiwasi mdogo kuhusu matumizi mabaya ya data ambayo watu hawataki kufunzwa. Kuna mashtaka machache, wanasheria wachache, na wasiwasi mdogo.

Hakuna shaka kwamba watu zaidi na zaidi wanaamini kwamba 2025 itakuwa mwaka wa maamuzi. Wakati huo huo, makampuni yanajitayarisha. Meta, kwa mfano, inajenga kituo cha data cha 2GW+, chenye makadirio ya uwekezaji wa $60-65 bilioni kufikia 2025, na itakuwa na zaidi ya GPU milioni 1.3 ifikapo mwisho wa mwaka.

Meta hata ilitumia chati kulinganisha kituo chake cha data cha gigawati 2 na Manhattan, New York.

Lakini sasa DeepSeek imefanya vyema kwa gharama ya chini na GPU chache. Je, hii haiwezi kuwafanya watu kuwa na wasiwasi?

Yann LeCun: Tunapaswa kumshukuru CTO na mwanzilishi mwenza wa ya chanzo wazi

Hyperbolic, Yuchen Jin, kwa kuchapisha kwamba katika siku 4 tu, DeepSeek-R1 imethibitisha ukweli 4 kwetu:

- Chanzo huria AI iko miezi 6 tu nyuma ya chanzo kilichofungwa AI

- Uchina inatawala shindano la wazi la AI

- Tunaingia katika enzi kuu ya ujifunzaji wa uimarishaji wa modeli ya lugha

- Aina za kunereka zina nguvu sana, na tutaendesha AI yenye akili sana kwenye simu za rununu

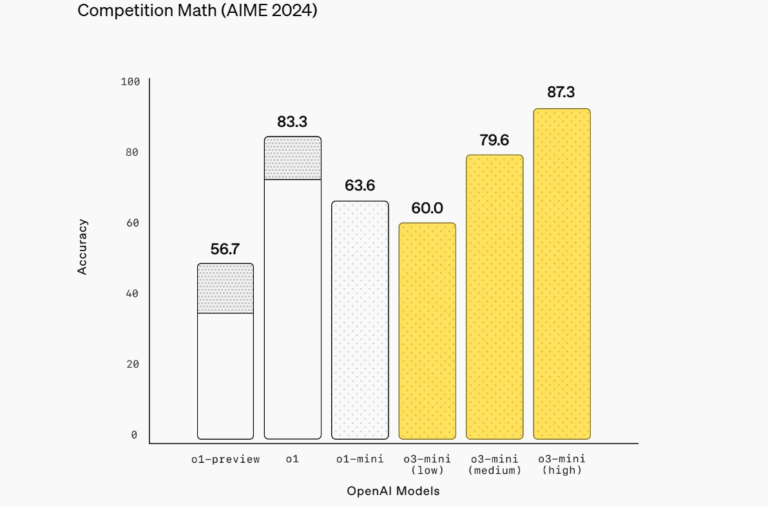

Mwitikio wa msururu uliochochewa na DeepSeek bado unaendelea, kama vile OpenAI o3-mini kupatikana kwa uhuru, matumaini katika jamii kupunguza mijadala isiyoeleweka kuhusu AGI/ASI, na uvumi kwamba Meta iko katika hofu.

Anaamini kuwa ni ngumu kutabiri ni nani hatimaye atashinda, lakini hatupaswi kusahau nguvu ya faida ya marehemu. Baada ya yote, sote tunajua kuwa ni Google ambayo iligundua Transformer, wakati OpenAI ilifungua uwezo wake wa kweli.

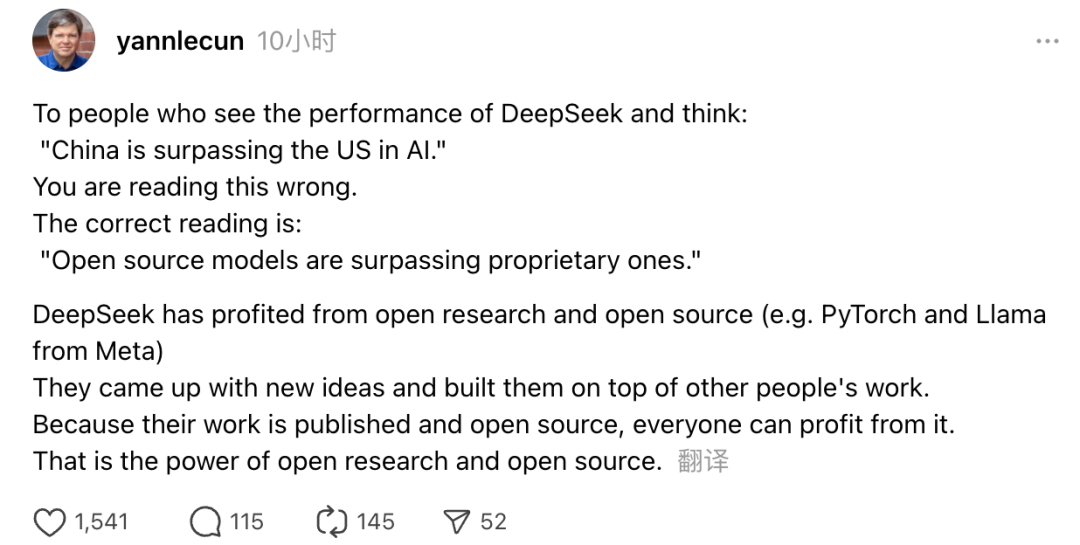

Kwa kuongezea, mshindi wa Tuzo ya Turing na Mwanasayansi Mkuu wa AI wa Meta Yann LeCun pia alitoa maoni yake.

"Kwa wale ambao, wanapoona utendaji wa DeepSeek, wanafikiri, 'Uchina inaipita Marekani katika AI,' umekosea. Uelewa sahihi ni kwamba mifano ya chanzo huria inapita mifano ya wamiliki.

LeCun alisema kuwa sababu ya DeepSeek kufanya mwonekano huo wakati huu ni kwa sababu wamefaidika na utafiti huria na chanzo huria (kama vile Meta's PyTorch na Llama). DeepSeek imekuja na mawazo mapya na kujengwa juu ya kazi za wengine. Kwa sababu kazi yao imetolewa hadharani na chanzo wazi, kila mtu anaweza kufaidika nayo. Hii ni nguvu ya utafiti wazi na chanzo wazi.

Tafakari za wanamtandao zinaendelea. Ingawa wanafurahia maendeleo ya teknolojia mpya, wanaweza pia kuhisi hali ya wasiwasi kidogo. Baada ya yote, kuibuka kwa DeepSeekers kunaweza kuwa na athari halisi.