في المستقبل، سيكون هناك المزيد والمزيد من الابتكارات المتشددة. قد لا يكون من السهل فهم ذلك الآن، لأن المجموعة الاجتماعية بأكملها تحتاج إلى التثقيف بالحقائق. عندما يسمح هذا المجتمع للأشخاص الذين يبتكرون بشكل متشدد بالنجاح، ستتغير العقلية الجماعية. نحتاج فقط إلى مجموعة من الحقائق والعملية. - ليانغ ون فنغ، مؤسس DeepSeek

في الأيام الأخيرة، انتشرت شركة DeepSeek في جميع أنحاء العالم، ولكن نظرًا لأن الشركة لم تعلن عن أي إعلانات ولم تصدر أي إعلانات، فإن الجمهور لا يعرف الكثير عن هذه الشركة التكنولوجية ذات الإمكانات الكبيرة - سواء كان ذلك في خلفيتها التأسيسية أو نطاق أعمالها أو تخطيط منتجاتها.

بعد الانتهاء من فرز جميع المواد، كتبت هذه المقالة

ما هي خلفية لاعبي الذكاء الاصطناعي الحاليين، وما الذي يخططون له، ومن هم اللاعبون الذين يقومون بتجنيدهم؟

وربما تكون النظرة التاريخية الأكثر اكتمالاً لـ DeepSeek.

في مثل هذا الوقت من العام الماضي، جاءني صديق من "ماجيك كيوب كوانت" وسألني: "هل تريد بناء نموذج كبير في الصين؟ وقضيت فترة ما بعد الظهر ببساطة وأنا أشرب القهوة. وكما هو متوقع، لا تزال الحياة تعتمد على الخيارات.

إن المكعب السحري الكمي المذكور هنا هو المستثمرأو الشركة الأم لـ DeepSeek

إن ما يسمى بـ "الكم" هو مؤسسة استثمارية لا تتخذ قراراتها بالقدرة البشرية بل بالخوارزميات. لم يمضِ وقت طويل على تأسيس كوانت فانتاسي الكوانتية التي بدأت في عام 2015. وبحلول عام 2021، عندما كان عمرها ست سنوات، تجاوز حجم إدارة الأصول في Quant Fantasy 100 مليار، وتم الترحيب بها باعتبارها أحد "ملوك الكم الأربعة الكبار في الصين".

مؤسس Fantasy Square، ليانغ وينفينغ، وهو أيضًا مؤسس شركة DeepSeek, هو قائد مالي "غير سائد" من مواليد ثمانينيات القرن الماضي: ليس لديه خبرة دراسية في الخارج، وليس فائزًا في مسابقة أولمبية، وتخرج من قسم الهندسة الإلكترونية في جامعة تشجيانغ، وتخصص في الذكاء الاصطناعي. وهو خبير تكنولوجي أصيل يتصرف بطريقة متواضعة، "يقرأ الأوراق البحثية ويكتب الأكواد ويشارك في المناقشات الجماعية" كل يوم.

لا يتمتع ليانغ ون فنغ بعادات صاحب العمل التقليدي، بل هو أقرب إلى "مهووس بالتكنولوجيا". وقد أثنى العديد من المطلعين على الصناعة والباحثين في DeepSeek على ليانغ ون فنغ ثناءً كبيرًا للغاية: "شخص لديه قدرات هندسية قوية في مجال هندسة المعلوماتية وقدرات بحثية في مجال النماذج، ويمكنه أيضًا تعبئة الموارد"، "شخص يمكنه إصدار أحكام دقيقة من مستوى عالٍ، ولكنه أيضًا يتفوق في التفاصيل على باحثي الخطوط الأمامية"، ولديه أيضًا "قدرة تعلم مرعبة".

قبل فترة طويلة من تأسيس شركة DeepSeek، كانت شركة Huanfang قد بدأت بالفعل في وضع خطط طويلة الأجل في صناعة الذكاء الاصطناعي. في مايو 2023، ذكر ليانغ ون فنغ في مقابلة مع Darksurge: "بعد أن أصدرت OpenAI GPT3 في عام 2020، أصبح اتجاه تطوير الذكاء الاصطناعي واضحًا جدًا، وستصبح قوة الحوسبة عنصرًا أساسيًا؛ ولكن حتى في عام 2021، عندما استثمرنا في بناء Firefly 2، لا يزال معظم الناس لا يستطيعون فهمه."

وبناءً على هذا الحكم، بدأت Huanfang في بناء البنية التحتية الخاصة بها للحوسبة. "من أول بطاقة واحدة، إلى 100 بطاقة في عام 2015، ثم 1000 بطاقة في عام 2019، ثم 10000 بطاقة، ثم 10000 بطاقة، وقد حدثت هذه العملية تدريجيًا. قبل بضع مئات من البطاقات، كنا نستضيفها في مركز البيانات الدولي. عندما أصبح الحجم أكبر، لم تعد الاستضافة قادرة على تلبية المتطلبات، لذلك بدأنا في بناء غرفة الكمبيوتر الخاصة بنا."

في وقت لاحق، ذكرت المالية أحد عشر: "لا يوجد أكثر من خمسة الشركات المحلية التي لديها أكثر من 10,000 وحدة معالجة رسومات (GPU)، وبالإضافة إلى عدد قليل من الشركات المصنعة الكبرى، فإنها تشمل أيضًا شركة صناديق كمية تسمى Magic Cube." يُعتقد عمومًا أن 10,000 رقاقة Nvidia A100 هي الحد الأدنى من القدرة الحاسوبية لتدريب النماذج الكبيرة.

في مقابلة سابقة، ذكر ليانغ ون فنغ أيضًا نقطة مثيرة للاهتمام: قد يعتقد الكثير من الناس أن هناك منطقًا تجاريًا غير معروف وراء ذلك، ولكن في الواقع، فإن الدافع الرئيسي وراء ذلك هو الفضول.

DeepSeekاللقاء الأول

في مقابلة مع Darksurge في مايو 2023، عندما سُئل عن "منذ فترة ليست بالبعيدة، أعلنت شركة Huanfang عن قرارها بصنع نماذج كبيرة، فلماذا يقوم صندوق كمي بمثل هذا الأمر؟"

كانت إجابة ليانغ ون فنغ مدوية: "قرارنا ببناء نموذج كبير لا علاقة له بالتقدير الكمي أو التمويل. لقد أنشأنا شركة جديدة تسمى DeepSeek للقيام بذلك. ويشارك العديد من الأعضاء الرئيسيين في الفريق في Mianfang في مجال الذكاء الاصطناعي. في ذلك الوقت، جربنا العديد من السيناريوهات واستقرينا في النهاية على التمويل، وهو أمر معقد بما فيه الكفاية. قد يكون الذكاء الاصطناعي العام من أصعب الأشياء التالية التي يمكن تحقيقها، لذا بالنسبة لنا، فإن المسألة تتعلق بكيفية القيام بذلك، وليس السبب.

ليس مدفوعًا بمصالح تجارية أو ملاحقة اتجاهات السوق، ولكن ببساطة مدفوعًا بالرغبة في استكشاف تكنولوجيا الذكاء الاصطناعي المتقدم نفسه والسعي الدؤوب وراء "الشيء الأهم والأصعب" تم تأكيد الاسم "DeepSeek" رسميًا في مايو 2023. في 17 يوليو 2023، تم تأسيس شركة "Hangzhou DeepSeek Artificial Intelligence Basic Technology Research Co." المحدودة.

على 2 نوفمبر 2023، قدمت DeepSeek أول إجابة لها: DeepSeek Coder، وهو نموذج كبير من التعليمات البرمجية مفتوحة المصدر. يتضمن هذا النموذج أحجامًا متعددة مثل 1B و7B و33B. يتضمن المحتوى مفتوح المصدر النموذج الأساسي ونموذج ضبط الأوامر.

في ذلك الوقت، من بين النماذج مفتوحة المصدر، كان CodeLlama من Meta هو المعيار القياسي في هذا المجال. ومع ذلك، بمجرد إصدار برنامج DeepSeek Coder، أظهر موقعًا متقدمًا متعدد الأوجه مقارنةً بـ CodeLlama: في توليد الشفرة، كان HumanEval متقدمًا بـ 9.3%، و MBPP متقدمًا بـ 10.8%، و DS-1000 متقدمًا بـ 5.9%.

ضع في اعتبارك أن DeepSeek Coder هو نموذج 7B، بينما CodeLlama هو نموذج 34B. بالإضافة إلى ذلك، تجاوز نموذج DeepSeek Coder، بعد ضبطه بالتعليمات، نموذج GPT3.5-Turbo بشكل شامل.

لا يقتصر الأمر على توليد الشيفرة البرمجية المثير للإعجاب فحسب، بل إن برنامج DeepSeek Coder يستعرض أيضًا عضلاته في الرياضيات والمنطق.

بعد ثلاثة أيام، في 5 نوفمبر 2023، أصدرت شركة DeepSeek كمية كبيرة من محتوى التوظيف عبر حسابها العام على WeChat، بما في ذلك وظائف مثل متدرب نموذج كبير في AGI، وخبير بيانات، وخبير بيانات، وموهبة هندسة البيانات، ومهندس أول لجمع البيانات، ومهندس أبحاث التعلم العميق والتطوير، وما إلى ذلك، وبدأت في توسيع الفريق بنشاط.

وكما قال ليانغ ون فنغ DeepSeek "المتطلبات الضرورية" لتوظيف المواهب هي "الشغف والمهارات الأساسية القوية"وأكد أن "يتطلب الابتكار أقل قدر ممكن من التدخل والإدارة، بحيث يتمتع الجميع بحرية ارتكاب الأخطاء وتجربة أشياء جديدة. وغالبًا ما يأتي الابتكار من الداخل، وليس من الترتيبات المتعمدة، وبالتأكيد لا يأتي من التعليم."

يتم إصدار النماذج بشكل متكرر، ويتم ممارسة المصدر المفتوح

بعد أن حقق برنامج DeepSeek Coder نجاحًا كبيرًا، حولت DeepSeek انتباهها إلى ساحة المعركة الرئيسية: نماذج اللغة العامة.

على في 29 نوفمبر 2023، أصدرت شركة DeepSeek أول نموذج لغوي كبير للأغراض العامة، DeepSeek LLM 67B. تمت مقارنة هذا النموذج بنموذج Meta's LLaMA2 70B من نفس المستوى، وقد حقق أداءً أفضل في ما يقرب من 20 قائمة تقييم عامة باللغتين الصينية والإنجليزية. وعلى وجه الخصوص، فإن قدراته المنطقية والرياضية والبرمجية (على سبيل المثال: HumanEval وMATH وCEval وCMMLU) متميزة.

كما اختارت DeepSeek LLM 67B طريق المصدر المفتوح وتدعم الاستخدام التجاري. ولإثبات إخلاصها وتصميمها على المصدر المفتوح، قامت DeepSeek، بشكل غير مسبوق، بفتح المصدر لنموذجين بمقياسين مختلفين في آن واحد، وهما 7B و67B، بل إنها نشرت نقاط التدقيق التسع التي تم إنشاؤها أثناء عملية تدريب النموذج للباحثين لتنزيلها واستخدامها. هذا النوع من العمليات، الذي يشبه "تعليم كل شيء"، نادر للغاية في مجتمع المصادر المفتوحة بأكمله.

من أجل إجراء تقييم أكثر شمولاً وموضوعية للقدرات الحقيقية لـ DeepSeek LLM 67B، صمم فريق البحث DeepSeek أيضًا بعناية سلسلة من "الأسئلة الجديدة" من أجل "اختبار الضغط". وتغطي هذه الأسئلة اختبارات عالية المستوى وعالية التمييز مثل أسئلة امتحان الرياضيات في المدرسة الثانوية الهنغارية، ومجموعات التقييم التالية لأوامر Google، وأسئلة المسابقة الأسبوعية LeetCode. كانت نتائج الاختبار مشجعة. فقد أظهر DeepSeek LLM 67B إمكانات مذهلة من حيث قدرته على التعميم خارج العينة، وكان أداؤه العام قريبًا حتى من أداء نموذج GPT-4 الأكثر تقدمًا آنذاك.

على 18 ديسمبر 2023، 18 ديسمبر 2023، فتح DeepSeek مصدر نموذج فنسنت ثلاثي الأبعاد DreamCraft3D:: يمكن أن يولد نماذج ثلاثية الأبعاد عالية الجودة من جملة، مما يحقق القفزة من المستويات ثنائية الأبعاد إلى الفضاء ثلاثي الأبعاد في AIGC. على سبيل المثال، إذا أدخل المستخدم "يركض عبر الغابة، صورة هجينة مضحكة لرأس خنزير وجسم الملك القرد"، يمكن لـ DreamCraft3D إخراج محتوى عالي الجودة:

من حيث المبدأ، يكمل النموذج أولاً مخطط فِن، ثم يكمل الهيكل الهندسي العام بناءً على خريطة المفاهيم ثنائية الأبعاد:

في التقييم الذاتي الذي أعقب ذلك، قال أكثر من 90% من المستخدمين أن DreamCraft3D يتمتع بميزة في جودة التوليد مقارنةً بطرق التوليد السابقة.

في 7 يناير 2024، أصدرت DeepSeek DeepSeek LLM 67B التقرير الفني لـ DeepSeek LLM 67B. يحتوي هذا التقرير المكون من أكثر من 40 صفحة على العديد من التفاصيل عن DeepSeek LLM 67B، بما في ذلك قوانين القياس الذاتي، والتفاصيل العملية الكاملة لمحاذاة النموذج، ونظام تقييم شامل لقدرة AGI.

على في 11 يناير 2024، أطلقت شركة DeepSeek أول نموذج كبير من طراز MoE (بنية الخبراء المختلطة) في الصين وهو DeepSeekMoE: بنية جديدة تمامًا تدعم اللغتين الصينية والإنجليزية وهي مجانية للاستخدام التجاري. وقد اعتُبرت بنية MoE عمومًا في ذلك الوقت مفتاح الإنجاز الذي حققته OpenAI GPT-4 في الأداء. تُعد بنية MoE المطورة ذاتيًا لـ DeepSeek رائدة في مقاييس متعددة مثل 2B و16B و145B، كما أن بنيتها الحسابية جديرة بالثناء.

في 25 يناير 2024، أصدرت DeepSeek التقرير الفني لـ DeepSeek Coder DeepSeek. يقدم هذا التقرير تحليلاً تقنيًا شاملاً لبيانات التدريب وأساليب التدريب وأداء النموذج. في هذا التقرير، يمكننا أن نلاحظ في هذا التقرير أنه وللمرة الأولى، تم إنشاء بيانات التعليمات البرمجية على مستوى المستودعات واستخدام الفرز الطوبولوجي لتحليل التبعيات بين الملفات، مما عزز بشكل كبير القدرة على فهم الملفات المتقاطعة على مسافات طويلة. فيما يتعلق بأساليب التدريب، تمت إضافة طريقة ملء الوسط، والتي حسّنت بشكل كبير من قدرة إكمال التعليمات البرمجية.

في 30 يناير 2024، تم إطلاق منصة DeepSeek المفتوحة رسميًا، وبدأ اختبار خدمة DeepSeek الكبيرة لواجهة برمجة التطبيقات (API). سجّل لتحصل على 10 ملايين توكن مجاناً. تتوافق الواجهة مع واجهة واجهة OpenAI API، ويتوفر كلا النموذجين المزدوجين للدردشة/المبرمج. في هذا الوقت، بدأت شركة DeepSeek في استكشاف مسار مزود خدمات التكنولوجيا بالإضافة إلى البحث والتطوير التكنولوجي.

على في 5 فبراير 2024، أصدرت DeepSeek نموذج مجال عمودي آخر، DeepSeekMathنموذج استدلال رياضي. يحتوي هذا النموذج على 7 مليار معلمة فقط، لكن قدرته على الاستدلال الرياضي قريبة من قدرة GPT-4. في قائمة معيار MATH المعيارية الموثوقة، يتفوق هذا النموذج على الجمهور ويتفوق على عدد من النماذج مفتوحة المصدر ذات أحجام معلمات تتراوح بين 30 مليار و70 مليار. يُظهر إصدار DeepSeekMath بشكل كامل قوة DeepSeek التقنية وتخطيطه الاستشرافي في البحث والتطوير الرأسي وتخطيطه الاستشرافي في البحث والتطوير للنموذج.

على 28 فبراير 2024، من أجل زيادة تخفيف مخاوف المطورين بشأن استخدام نماذج DeepSeek مفتوحة المصدر، أصدرت DeepSeek أسئلة وأجوبة حول سياسة المصادر المفتوحةالذي يوفر إجابات مفصلة على الأسئلة المتداولة مثل نموذج الترخيص مفتوح المصدر وقيود الاستخدام التجاري. تتبنى DeepSeek المصدر المفتوح بموقف أكثر شفافية وانفتاحاً:

على في 11 مارس 2024، أصدرت DeepSeek الطراز الكبير متعدد الوسائط DeepSeek-VL. هذه هي المحاولة الأولى لـ DeepSeek في تكنولوجيا الذكاء الاصطناعي متعدد الوسائط. يبلغ حجم النموذج 7B و1.3B، والنموذج والأوراق الفنية مفتوحة المصدر في آن واحد.

على 20 مارس 2024، دُعيت Huanfang AI & DeepSeek مرة أخرى للمشاركة في مؤتمر NVIDIA GTC 2024، وألقى مؤسسها ليانغ وينفنغ كلمة رئيسية تقنية بعنوان "الانسجام في التنوع: مواءمة وفصل قيم النماذج اللغوية الكبيرة". نوقشت قضايا مثل "التعارض بين النموذج الكبير ذي القيمة الواحدة والمجتمع والثقافة التعددية"، و"فصل مواءمة قيم النماذج الكبيرة"، و"التحديات متعددة الأبعاد لمواءمة القيم المنفصلة". وقد أظهر ذلك اهتمام شركة DeepSeek بالرعاية الإنسانية والمسؤولية الاجتماعية لتطوير الذكاء الاصطناعي، بالإضافة إلى البحث والتطوير التكنولوجي.

في مارس 2024, DeepSeek API أطلقت رسميًا الخدمات المدفوعة، والتي أشعلت حرب الأسعار في سوق النماذج الصينية الكبيرة بشكل كامل: 1 يوان لكل مليون توكن إدخال و2 يوان لكل مليون توكن إخراج.

في عام 2024، نجحت شركة DeepSeek في اجتياز الرقم القياسي للنماذج الكبيرة في الصين بنجاح، مما أدى إلى إزالة العقبات السياسية أمام الانفتاح الكامل لخدمات واجهة برمجة التطبيقات.

في مايو 2024، تم إصدار DeepSeek-V2، وهو نموذج كبير مفتوح المصدر من طراز MoE العام، وبدأت حرب الأسعار رسميًا. يستخدم DeepSeek-V2 آلية الانتباه الكامن متعدد الرؤوس (MLA)، مما يقلل من بصمة ذاكرة النموذج إلى 5%-13% من تلك الخاصة بآلية MHA التقليدية. في الوقت نفسه، طورت أيضًا بشكل مستقل بنية DeepSeek MoE Sparse المتناثرة DeepSeek، مما يقلل بشكل كبير من التعقيد الحسابي للنموذج. وبفضل هذا، يحافظ النموذج على سعر واجهة برمجة التطبيقات "1 يوان/مليون مدخلات و2 يوان/مليون مخرجات".

كان لورقة DeepSeek تأثير كبير. وفي هذا الصدد، يعتقد كبير المحللين في SemiAnalysis أن ورقة DeepSeek V2 "قد تكون واحدة من أفضل الأوراق البحثية هذا العام". وبالمثل، يعتقد أندرو كار، وهو موظف سابق في OpenAI، أن الورقة البحثية "مليئة بالحكمة المذهلة" وقد طبق إعدادات التدريب الخاصة بها على نموذجه الخاص.

تجدر الإشارة إلى أن هذا نموذج يقيس GPT-4-Turbo، وسعر API هو 1/70 فقط من الأخير

في يونيو 17، 2024، قامت شركة DeepSeek مرة أخرى بدفعة كبيرة، حيث أصدرت نموذج كود DeepSeek Coder V2 المصدر المفتوح وادعاء أن قدراته البرمجية تفوق GPT-4-Turbo، وهو النموذج الأكثر تقدمًا مغلق المصدر في ذلك الوقت. ويواصل DeepSeek Coder V2 استراتيجية DeepSeek مفتوحة المصدر المتسقة التي تتبعها شركة DeepSeek، حيث أن جميع النماذج والرموز والأوراق مفتوحة المصدر، كما تم توفير نسختين هما 236B و16B. كما تتوفر خدمات DeepSeek C oder V2 الخاصة بـ DeepSeek C oder V2 على الإنترنت، ويظل السعر "1 يوان/مليون مدخلات و2 يوان/مليون مخرجات".

على 21 يونيو 2024، DeepSeek المبرمج DeepSeek يدعم تنفيذ التعليمات البرمجية عبر الإنترنت. في اليوم نفسه، تم إصدار Claude3.5 Sonnet، مع ميزة Artifacts الجديدة، التي تقوم تلقائيًا بإنشاء التعليمات البرمجية وتشغيلها مباشرةً في المتصفح. وفي اليوم نفسه، أطلق مساعد الشيفرة على موقع DeepSeek الإلكتروني نفس الميزة: توليد الشيفرة وتشغيلها بنقرة واحدة.

دعونا نستعرض الأحداث الرئيسية في هذه الفترة:

اختراقات مستمرة، تجذب الانتباه العالمي

في مايو 2024، أصبح DeepSeek مشهورًا بين عشية وضحاها بإصدار DeepSeek V2، وهو نموذج مفتوح المصدر يعتمد على MoE. وهو يضاهي أداء GPT-4-Turbo، ولكن بسعر 1 يوان/مليون يوان فقط من المدخلات، وهو 1/70 من GPT-4-Turbo. في ذلك الوقت، أصبح DeepSeek "جزار أسعار" معروفًا في هذه الصناعة، ثم سرعان ما حذا حذوه اللاعبون الرئيسيون مثل Zhicheng وBeteDance وAlibaba... وسرعان ما حذا حذوه اللاعبون الرئيسيون الآخرون وخفضوا أسعارهم. وفي ذلك الوقت أيضًا كانت هناك جولة أخرى من حظر GPT، وبدأ عدد كبير من تطبيقات الذكاء الاصطناعي في تجربة النماذج المحلية لأول مرة.

في يوليو 2024، وافق مؤسس شركة DeepSeek ليانغ ون فنغ مرة أخرى على إجراء مقابلة مع Dark Surge ورد مباشرة على حرب الأسعار: "غير متوقع على الإطلاق. لم أتوقع أن يجعل السعر الجميع حساسا للغاية. نحن نقوم بالأشياء على طريقتنا الخاصة ثم نقوم بالتسعير بناءً على التكلفة. مبدأنا هو عدم خسارة المال أو تحقيق أرباح باهظة. كما أن هذا السعر أعلى قليلاً من التكلفة مع القليل من الأرباح."

يمكن ملاحظة أنه، على عكس العديد من المنافسين الذين يدفعون من جيوبهم الخاصة للدعم، فإن DeepSeek مربحة بهذا السعر.

قد يقول البعض: إن تخفيض الأسعار بمثابة سرقة المستخدمين، وهذا هو الحال عادة في حروب الأسعار في عصر الإنترنت

وردًا على ذلك، رد ليانغ ون فنغ أيضًا: "سرقة المستخدمين ليس هدفنا الرئيسي. لقد خفضنا السعر لأننا من ناحية خفضنا التكلفة لأننا نستكشف هيكلية نموذج الجيل التالي، ومن ناحية أخرى، نشعر أن كلاً من واجهة برمجة التطبيقات والذكاء الاصطناعي يجب أن يكونا في متناول الجميع وبأسعار معقولة".

وهكذا تستمر القصة مع مثالية ليانغ ون فنغ.

في 4 يوليو 2024، تم تشغيل واجهة برمجة التطبيقات DeepSeek على الإنترنت. ظل سعر السياق 128K دون تغيير. ترتبط تكلفة الاستدلال للنموذج ارتباطًا وثيقًا بطول السياق. ولذلك، فإن العديد من النماذج لديها قيود صارمة على هذا الطول: الإصدار الأولي من GPT-3.5 يحتوي على 4 آلاف سياق فقط.

في هذا الوقت، زادت DeepSeek من طول السياق من 32 ألفًا إلى 128 ألفًا في السابق مع الحفاظ على السعر دون تغيير (1 يوان لكل مليون عملة إدخال و2 يوان لكل مليون عملة إخراج).

على 10 يوليو 2024، تم الإعلان عن نتائج أول أولمبياد الذكاء الاصطناعي في العالم (AIMO)، وأصبح نموذج DeepSeekMath هو الخيار الشائع للفرق الأولى. اختارت جميع الفرق الأربعة الأولى الفائزة بالمراكز الأربعة الأولى DeepSeekMath-7B كأساس لنماذج دخولها وحققت نتائج مبهرة في المسابقة.

على في 18 يوليو 2024، تصدرت DeepSeek-V2 قائمة النماذج مفتوحة المصدر على ساحة الدردشة الآلية, متفوقًا على نماذج النجوم مثل Llama3-70B وQwen2-72B وNemotron4-340B وGemma2-27B، وأصبح معيارًا جديدًا للنماذج الكبيرة مفتوحة المصدر.

في يوليو 2024، واصلت شركة DeepSeek توظيف المواهب واستقطبنا أفضل المواهب من جميع أنحاء العالم في مجالات متعددة، بما في ذلك خوارزميات الذكاء الاصطناعي، والذكاء الاصطناعي إنفرا، والذكاء الاصطناعي المدرسي، ومنتجات الذكاء الاصطناعي، وذلك استعدادًا للابتكار التكنولوجي وتطوير المنتجات في المستقبل.

على في 26 يوليو 2024، بدأت واجهة برمجة التطبيقات DeepSeek بترقية مهمة، حيث تدعم بشكل كامل سلسلة من الميزات المتقدمة مثل الكتابة فوق، وإكمال FIM (ملء الوسط)، واستدعاء الدالة، وإخراج JSON. دالة FIM مثيرة للاهتمام للغاية: يعطي المستخدم البداية والنهاية، والنموذج الكبير يملأ الوسط، وهو مناسب جدًا لعملية البرمجة لملء رمز الدالة بالضبط. خذ كتابة متتابعة فيبوناتشي كمثال:

على 2 أغسطس 2024، طرحت شركة DeepSeek تقنية التخزين المؤقت للأقراص الصلبة بشكل مبتكر، مما أدى إلى خفض أسعار واجهة برمجة التطبيقات إلى الكاحلين. في السابق، كانت أسعار واجهة برمجة التطبيقات ¥ 1 ¥ فقط لكل مليون توكن. أما الآن، فبمجرد الوصول إلى ذاكرة التخزين المؤقت، تنخفض رسوم واجهة برمجة التطبيقات مباشرةً إلى ¥ 0.1.

هذه الميزة عملية للغاية عندما يتعلق الأمر بالمحادثات المستمرة ومهام المعالجة المجمعة.

على في 16 أغسطس 2024، أصدرت DeepSeek نموذج إثبات النظريات الرياضية DeepSeek-Prover-V1.5 كمصدر مفتوح، والذي تفوّق على العديد من النماذج المفتوحة المصدر المعروفة في اختبارات إثبات النظريات الرياضية في المدارس الثانوية والكليات.

على في 6 سبتمبر 2024، أصدرت شركة DeepSeek نموذج الاندماج DeepSeek-V2.5. في السابق، كان DeepSeek يقدم نموذجين بشكل أساسي: نموذج المحادثة الذي يركز على مهارات المحادثة العامة، ونموذج البرمجة الذي يركز على مهارات معالجة البرمجة. في هذه المرة، تم دمج النموذجين في نموذج واحد، وتمت ترقيته إلى DeepSeek-V2.5، والذي يتماشى بشكل أفضل مع التفضيلات البشرية وحقق أيضًا تحسينات كبيرة في كتابة المهام واتباع الأوامر وجوانب أخرى.

على في 18 سبتمبر 2024، كان DeepSeek-V2.5 مرة أخرى على أحدث قائمة LMSYSYS، متصدرًا الطرازات المحلية وتسجيل أفضل النتائج الجديدة للنماذج المحلية في القدرات الفردية المتعددة.

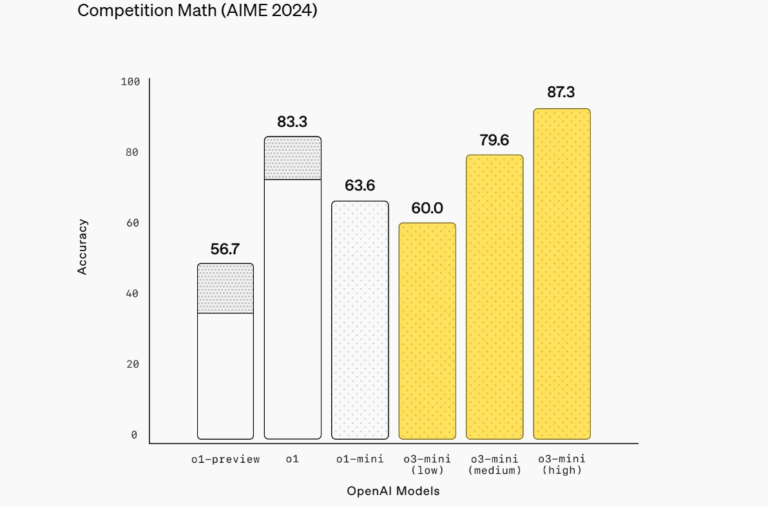

على 20 نوفمبر 2024، 2024، أصدرت DeepSeek DeepSeek-R1-Lite على الموقع الرسمي. هذا نموذج استدلالي يمكن مقارنته بنموذج o1-preview، ويوفر أيضًا كمية كافية من البيانات التركيبية للتدريب اللاحق لـ V3.

على في 10 ديسمبر 2024، دشنت سلسلة DeepSeek V2 نهايتها بإصدار الإصدار النهائي المعدّل DeepSeek-V2.5-1210. يعمل هذا الإصدار على تحسين قدرات متعددة بشكل شامل بما في ذلك الرياضيات والترميز والكتابة ولعب الأدوار من خلال التدريب اللاحق.

مع وصول هذا الإصدار، فتح تطبيق الويب DeepSeek أيضًا وظيفة البحث في الشبكة.

على في 13 ديسمبر 2024، حققت DeepSeek طفرة أخرى في مجال الوسائط المتعددة وأصدرت الطراز الكبير متعدد الوسائط مفتوح المصدر DeepSeek-VL2. يعتمد DeepSeek-VL2 على بنية MoE، مما يحسّن قدراته البصرية بشكل كبير. وهي متوفرة بثلاثة أحجام: 3B، و16B، و27B، ويتمتع بميزة في جميع المقاييس.

على في 26 ديسمبر 2024، تم إصدار DeepSeek-V3 بمصدر مفتوح: بلغت تكلفة التدريب المقدرة 5.5 مليون دولار أمريكي فقط. DeepSeek-V3 قياس أداء الطرازات المغلقة المصدر الرائدة في الخارج بشكل كامل وتحسين سرعة التوليد بشكل كبير.

تم تعديل تسعير خدمات واجهة برمجة التطبيقات، ولكن في الوقت نفسه، تم تحديد فترة تجريبية تفضيلية مدتها 45 يومًا للنموذج الجديد.

في 15 يناير 2025، تم إطلاق تطبيق DeepSeek الرسمي رسميًا وإطلاقه بالكامل في أسواق تطبيقات iOS/أندرويد الرئيسية.

في 20 يناير 2025، في 20 يناير 2025، على مقربة من العام الصيني الجديد، تم إصدار نموذج الاستدلال DeepSeek-R1 رسميًا وإتاحته للمصادر المفتوحة. قام DeepSeek-R1 بمواءمة أدائه بشكل كامل مع الإصدار الرسمي OpenAI o1 وفتح وظيفة إخراج سلسلة الأفكار. في الوقت نفسه، أعلن DeepSeek أيضًا عن تغيير رخصة المصدر المفتوح للنموذج إلى رخصة MIT، وستسمح اتفاقية المستخدم صراحةً بـ "تقطير النموذج"، مما يزيد من تبني المصدر المفتوح وتعزيز مشاركة التكنولوجيا.

في وقت لاحق، أصبح هذا النموذج شائعًا جدًا وبشر بعصر جديد

ونتيجة لذلك، واعتبارًا من 27 يناير 2025، نجح تطبيق DeepSeek في تجاوز تطبيق ChatGPT وتصدّر قائمة تنزيل التطبيقات المجانية على متجر تطبيقات iOS في الولايات المتحدة، ليصبح تطبيق الذكاء الاصطناعي الهائل.

في 27 يناير 2025، في الساعة 1:00 صباحًا من ليلة رأس السنة الجديدة، تم إصدار DeepSeek Janus-Pro كمصدر مفتوح. هذا نموذج متعدد الوسائط سُمي على اسم الإله جانوس ذي الوجهين في الأساطير الرومانية القديمة: فهو يواجه الماضي والمستقبل. ويمثل هذا أيضًا قدرتي النموذج - الفهم البصري وتوليد الصور - وهيمنته على تصنيفات متعددة.

1تسببت شعبية DeepSeek المتفجرة على الفور في حدوث موجة صدمة تكنولوجية عالمية، حتى أنها تسببت بشكل مباشر في انخفاض سعر سهم NVIDIA 18%، وتبخر القيمة السوقية لسوق الأسهم التكنولوجية العالمية بنحو تريليون دولار أمريكي. صرّحت وول ستريت ووسائل الإعلام التكنولوجية بأن صعود شركة DeepSeek يزعزع المشهد العالمي لصناعة الذكاء الاصطناعي ويشكل تحديًا غير مسبوق لعمالقة التكنولوجيا الأمريكية.

كما أثار نجاح DeepSeek اهتمامًا دوليًا كبيرًا ومناقشات ساخنة حول قدرات الصين في مجال الابتكار التكنولوجي للذكاء الاصطناعي. وقد أشاد الرئيس الأمريكي دونالد ترامب، في تعليق علني نادر، بظهور DeepSeek ووصفه بأنه "إيجابي" وقال إنه "جرس إنذار" للولايات المتحدة. كما أشاد كل من الرئيس التنفيذي لشركة مايكروسوفت ساتيا ناديلا والرئيس التنفيذي لشركة OpenAI سام ألتمان بشركة DeepSeek، واصفين تقنيتها بأنها "مثيرة للإعجاب للغاية".

وبالطبع، يجب أن نفهم أيضًا أن إشادتهم هي في جزء منها اعتراف بقوة DeepSeek، وفي جزء آخر انعكاس لدوافعهم الخاصة. على سبيل المثال، في حين أن أنثروبيك تعترف بإنجازات DeepSeek، إلا أنها تدعو الحكومة الأمريكية أيضًا إلى تعزيز ضوابط الرقائق على الصين.

الرئيس التنفيذي لشركة أنثروبيك ينشر مقالاً من 10,000 كلمة ارتفاع DeepSeek يعني أن على البيت الأبيض تكثيف الضوابط

الملخص والنظرة المستقبلية

وبالنظر إلى العامين الماضيين في شركة DeepSeek، نجد أنها كانت حقًا "معجزة صينية": من شركة ناشئة غير معروفة إلى "القوة الشرقية الغامضة" التي تتألق الآن على الساحة العالمية للذكاء الاصطناعي، كتبت DeepSeek "المستحيل" تلو الآخر بقوتها وابتكاراتها.

لقد تجاوز المعنى الأعمق لهذه الرحلة الاستكشافية التكنولوجية منذ فترة طويلة نطاق المنافسة التجارية. وقد أعلنت شركة DeepSeek بالوقائع أن في المجال الاستراتيجي للذكاء الاصطناعي الذي يتعلق بالمستقبل، فإن الشركات الصينية قادرة تمامًا على الصعود إلى آفاق التكنولوجيا الأساسية.

إن "جرس الإنذار" الذي دقّه ترامب والخوف الخفي من الأنثروبولوجيا يؤكدان بدقة أهمية قدرات الصين في مجال الذكاء الاصطناعي: فهي لا تستطيع ركوب الأمواج فحسب، بل إنها تعيد تشكيل اتجاه المد والجزر

ديبسيك المنتج الإصدار المعالم البارزة

- 2 نوفمبر 2023: DeepSeek مبرمج DeepSeek طراز كبير

- 29 نوفمبر 2023: DeepSeek LLM 67B الطراز العالمي

- 18 ديسمبر 2023: نموذج DreamCraft3D3D 3D

- 11 يناير 2024: طراز DeepSeekMoE MoE كبير الحجم

- 5 فبراير 2024: DeepSeekMath نموذج الاستدلال الرياضي

- 11 مارس 2024: DeepSeek-VL طراز كبير متعدد الوسائط DeepSeek-VL

- مايو 2024: الطراز العام DeepSeek-V2 MoE العام

- 17 يونيو 2024: نموذج الكود DeepSeek Coder V2 المبرمج V2

- 6 سبتمبر 2024: DeepSeek-V2.5 دمج نموذجي الكفاءة العامة والكفاءة في الترميز

- 13 ديسمبر 2024: DeepSeek-VL2 نموذج MoE متعدد الوسائط

- 26 ديسمبر 2024: DeepSeek-V3 سلسلة جديدة من الموديلات الكبيرة للأغراض العامة

- 20 يناير 2025: DeepSeek-R1 نموذج الاستدلال DeepSeek-R1

- 20 يناير 2025: تطبيق DeepSeek الرسمي (iOS وAndroid)

- 27 يناير 2025 طراز DeepSeek Janus-Pro متعدد الوسائط DeepSeek