لم يكن أحد منا يتوقع أن يبدأ عام 2025 في مجال الذكاء الاصطناعي بهذه الطريقة.

DeepSeek R1 مدهش حقًا!

في الآونة الأخيرة، كانت "القوة الشرقية الغامضة" DeepSeek "تسيطر بشدة" على وادي السيليكون.

طلبت من R1 شرح نظرية فيثاغورس بالتفصيل. تم كل هذا بواسطة الذكاء الاصطناعي في أقل من 30 ثانية دون أي أخطاء. باختصار، انتهى الأمر.

في دوائر الذكاء الاصطناعي المحلية والأجنبية، اكتشف مستخدمو الإنترنت العاديون الذكاء الاصطناعي الجديد المذهل والقوي (وهو أيضًا مفتوح المصدر)، وصاح الخبراء الأكاديميون "يجب أن نلحق بالركب". وهناك أيضًا أقاويل بأن شركات الذكاء الاصطناعي في الخارج تواجه بالفعل تهديدًا كبيرًا.

فقط خذ هذا DeepSeek R1 الذي صدر هذا الأسبوع. إن طريقته في التعلم المعزز الخالص دون أي تدريب تحت الإشراف أمر صادم. من تطوير قاعدة Deepseek-v3 في ديسمبر من العام الماضي إلى قدرات سلسلة التفكير الحالية التي تضاهي OpenAI o1، يبدو أنها مسألة وقت.

ولكن بينما ينشغل مجتمع الذكاء الاصطناعي بقراءة التقارير الفنية ومقارنة القياسات الفعلية، لا تزال الشكوك تساور الناس حول R1: بصرف النظر عن قدرته على التفوق على مجموعة من المعايير، هل يمكنه أن يقود حقًا؟

هل يمكنها بناء محاكاة خاصة بها لـ "القوانين الفيزيائية"؟

ألا تصدق ذلك؟ دعنا نترك النموذج الكبير يلعب بالكرة والدبابيس؟

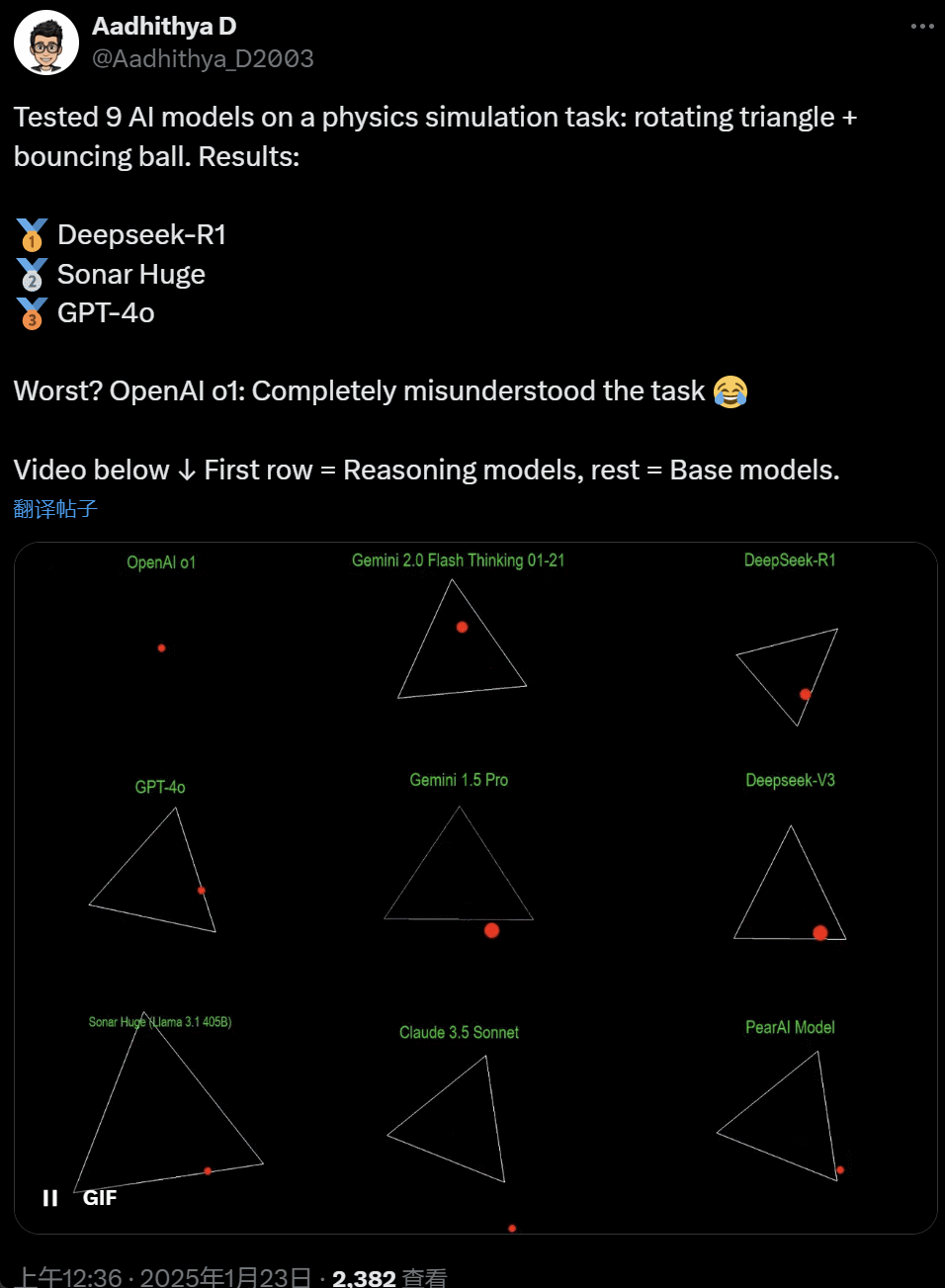

في الأيام الأخيرة، أصبح بعض الناس في مجتمع الذكاء الاصطناعي مهووسين باختبار - اختبار نماذج الذكاء الاصطناعي الكبيرة المختلفة (خاصةً ما يسمى بنماذج التفكير) لحل مشكلة: "اكتب نصاً برمجياً من بايثون لجعل كرة صفراء ترتد داخل شكل معين. اجعل الشكل يدور ببطء وتأكد من بقاء الكرة داخل الشكل."

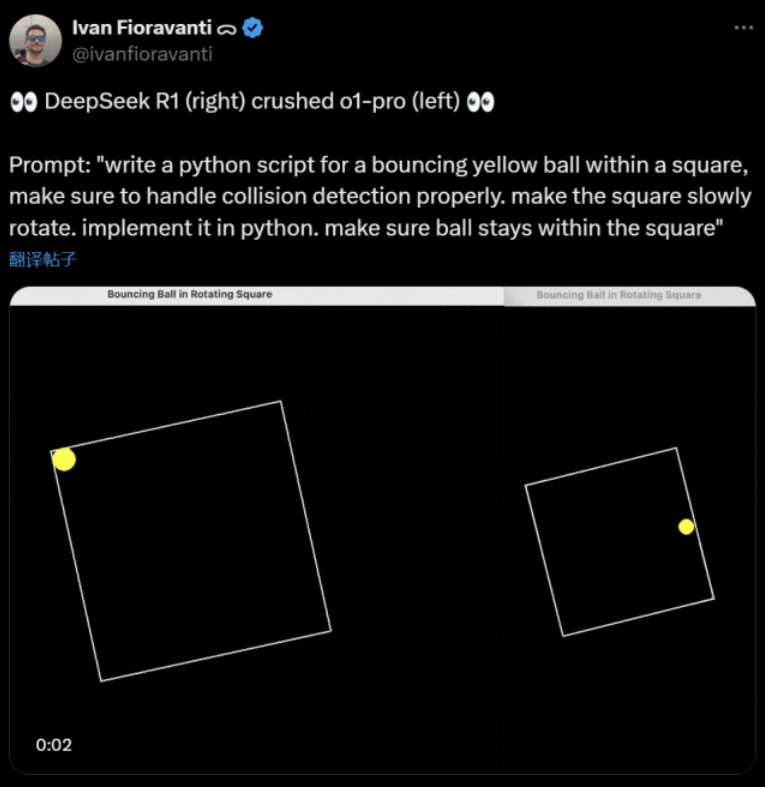

تتفوق بعض النماذج على نماذج أخرى في معيار "الكرة الدوارة" هذا. وفقاً لرئيس قسم التكنولوجيا في CoreView، إيفان فيورافانتي، فإن مختبر الذكاء الاصطناعي المحلي DeepSeek لديه نموذج R1 كبير مفتوح المصدر يتفوق على نموذج o1 pro الخاص بـ OpenAI، والذي يكلف $200 شهرياً كجزء من برنامج OpenAI's ChatGPT Pro.

على اليسار هو OpenAI o1، وعلى اليمين هو DeepSeek R1. كما ذُكر أعلاه، المطالبة هنا هي "اكتب نص برمجي بايثون لكرة صفراء ترتد داخل مربع، تأكد من التعامل مع اكتشاف التصادم بشكل صحيح. اجعل المربع يدور ببطء. نفّذها في بايثون. تأكد من بقاء الكرة داخل المربع."

ووفقًا لمستخدم آخر على X، فإن نموذجي أنثروبيك كلود 3.5 سونيت وجوزاء 1.5 برو من جوجل أصدر أحكامًا غير صحيحة حول المبادئ الفيزيائية، مما تسبب في انحراف الكرة عن شكلها. كما أفاد بعض المستخدمين أيضًا أن أحدث إصدار من Google Gemini 2.0 Flash Thinking التجريبي من Google، بالإضافة إلى OpenAI GPT-4o الأقدم نسبيًا، اجتازا التقييم في الحال.

ولكن هناك طريقة لمعرفة الفرق هنا:

قال مستخدمو الإنترنت تحت هذه التغريدة: كانت قدرة o1 جيدة جدًا في الأصل، لكنها أصبحت أضعف بعد تحسين OpenAI للسرعة، حتى مع إصدار العضوية $200T/شهر.

تعد محاكاة الكرة المرتدة تحديًا برمجيًا كلاسيكيًا. تجمع المحاكاة الدقيقة بين خوارزميات الكشف عن التصادم، والتي تحتاج إلى تحديد متى يتصادم جسمان (مثل كرة وجانب شكل ما). يمكن لخوارزمية مكتوبة بشكل غير صحيح أن تؤثر على أداء المحاكاة أو تسبب أخطاء فيزيائية واضحة.

قال N8 Programs، وهو باحث في شركة Nous Research الناشئة في مجال الذكاء الاصطناعي، إن الأمر استغرق منه حوالي ساعتين لكتابة كرة مرتدة في سباعي دوار من الصفر. "يجب تعقب أنظمة الإحداثيات المتعددة، ويلزم فهم كيفية التعامل مع التصادمات في كل نظام، ويجب تصميم الكود من الصفر ليكون قوياً".

على الرغم من أن الكرات القافزة والأشكال الدوارة هي اختبار معقول لمهارات البرمجة، إلا أنها لا تزال مشاريع جديدة للنماذج الكبيرة، وحتى التغييرات الصغيرة في المطالبات يمكن أن تؤدي إلى نتائج مختلفة. لذا، إذا كانت ستصبح في نهاية المطاف جزءًا من الاختبار المعياري لنماذج الذكاء الاصطناعي الكبيرة، فلا تزال بحاجة إلى تحسين.

على أي حال، بعد هذه الموجة من الاختبارات العملية، أصبح لدينا إحساس بالاختلافات في القدرات بين النماذج الكبيرة.

DeepSeek هي "أسطورة وادي السيليكون الجديدة

DeepSeek يسبب الذعر" عبر المحيط الهادئ.

نشر موظفو Meta أن "مهندسي Meta يحللون بشكل محموم DeepSeek لمحاولة نسخ أي شيء يمكنهم نسخه منه."

كما ذكر ألكسندر وانغ، مؤسس شركة Scale AI الناشئة في مجال تكنولوجيا الذكاء الاصطناعي، علناً أن أداء نموذج الذكاء الاصطناعي الكبير DeepSeek يعادل تقريباً أفضل نموذج في الولايات المتحدة.

وهو يعتقد أيضاً أن الولايات المتحدة ربما كانت متقدمة على الصين في منافسة الذكاء الاصطناعي على مدى العقد الماضي، ولكن إطلاق شركة DeepSeek لنموذجها الكبير للذكاء الاصطناعي قد "يغير كل شيء".

يعتقد مدون X @8teAPi أن DeepSeek ليس "مشروعًا جانبيًا" ولكنه مثل "Skunk Works" السابق لشركة Lockheed Martin.

يشير ما يسمى "Skunk Works" إلى فريق صغير مستقل نسبياً وسري للغاية أنشأته شركة لوكهيد مارتن في الأصل لتطوير العديد من الطائرات المتقدمة، حيث يعمل في مجال البحث والتطوير التكنولوجي المتطور أو غير التقليدي. من طائرة الاستطلاع U-2 وطائرة SR-71 Blackbird إلى طائرة F-22 Raptor ومقاتلة F-35 Lightning II، كلها جاءت من هنا.

وفي وقت لاحق، تطور المصطلح تدريجيًا ليصبح مصطلحًا عامًا يستخدم لوصف فرق الابتكار "الصغيرة ولكن الجيدة" والمستقلة نسبيًا والأكثر مرونة التي يتم إنشاؤها داخل الشركات أو المؤسسات الكبيرة.

وأعطى سببين:

- فمن ناحية، تمتلك DeepSeek عددًا كبيرًا من وحدات معالجة الرسومات، يقال إنها تزيد عن 10,000، بل إن ألكسندر وانغ، الرئيس التنفيذي لشركة Scale AI، قال إنها قد تصل إلى 50,000.

- ومن ناحية أخرى، لا تستقطب شركة DeepSeek سوى المواهب من أفضل ثلاث جامعات في الصين، مما يعني أن DeepSeek لا تقل تنافسية عن شركتي علي بابا وتينسنت.

تُظهر هاتان الحقيقتان وحدهما أن DeepSeek قد حققت نجاحًا تجاريًا واضحًا ومعروفًا بما يكفي للحصول على هذه الموارد.

أما بالنسبة لتكاليف تطوير DeepSeek، قال المدون إن شركات التكنولوجيا الصينية يمكن أن تحصل على مجموعة متنوعة من الإعانات، مثل تكاليف الكهرباء المنخفضة واستخدام الأراضي.

ولذلك، فمن المحتمل جدًا أن معظم تكاليف DeepSeek قد "وُضعت" في حساب خارج الأعمال الأساسية أو في شكل نوع من الدعم لبناء مركز البيانات.

حتى بصرف النظر عن المؤسسين، لا أحد يفهم تماماً جميع الترتيبات المالية. وقد تكون بعض الاتفاقات مجرد "اتفاقات شفهية" يتم إبرامها بناءً على السمعة فقط.

بغض النظر عن ذلك، هناك بعض الأمور الواضحة:

- النموذج ممتاز، ويمكن مقارنته بالنسخة التي أصدرتها OpenAI قبل شهرين، وبالطبع من الممكن ألا يكون بجودة النماذج الجديدة التي لم تصدرها OpenAI وAthropic بعد.

- من المنظور الحالي، لا تزال الشركات الأمريكية تهيمن على الاتجاه البحثي. إن نموذج DeepSeek هو "متابعة سريعة" لإصدار o1، ولكن تقدم البحث والتطوير في DeepSeek سريع جدًا، ويلحقون بالركب أسرع من المتوقع. إنهم لا يقومون بالسرقة أو الغش، بل على الأكثر يقومون بالهندسة العكسية.

- DeepSeek تقوم بشكل أساسي بتدريب مواهبها الخاصة، بدلاً من الاعتماد على حملة الدكتوراه المدربين في الولايات المتحدة، مما يوسع بشكل كبير من مجموعة المواهب.

- بالمقارنة مع الشركات الأمريكية، تخضع شركة DeepSeek لقيود أقل من حيث ترخيص الملكية الفكرية والخصوصية والأمن والسياسة وما إلى ذلك، وهناك مخاوف أقل بشأن الاستخدام غير المشروع للبيانات التي لا يريد الناس أن يتدربوا عليها. هناك عدد أقل من الدعاوى القضائية، وعدد أقل من المحامين، ومخاوف أقل.

لا شك أن هناك المزيد والمزيد من الناس يعتقدون أن عام 2025 سيكون عامًا حاسمًا. وفي هذه الأثناء، تستعد الشركات لذلك. فشركة Meta، على سبيل المثال، تقوم ببناء مركز بيانات بقدرة 2 جيجاوات فأكثر، باستثمارات تقدر بـ $60-65 مليار بحلول عام 2025، وسيكون لديها أكثر من 1.3 مليون وحدة معالجة رسومات بحلول نهاية العام.

حتى أن شركة Meta استخدمت مخططًا بيانيًا لمقارنة مركز البيانات الخاص بها بقدرة 2 جيجاوات مع مانهاتن، نيويورك.

ولكن الآن حققت DeepSeek أداءً أفضل بتكلفة أقل ووحدات معالجة رسومات أقل. كيف لا يثير هذا قلق الناس؟

يان لوكون علينا أن نشكر الرئيس التنفيذي للتكنولوجيا والمؤسس المشارك لـ فإن المصدر المفتوح

لقد أثبت لنا DeepSeek-R1 في 4 أيام فقط 4 حقائق، وهي أن DeepSeek-R1 قد أثبت لنا 4 حقائق:

- الذكاء الاصطناعي مفتوح المصدر متأخر 6 أشهر فقط عن الذكاء الاصطناعي مغلق المصدر

- الصين تهيمن على منافسة الذكاء الاصطناعي مفتوح المصدر

- نحن ندخل العصر الذهبي للتعلم المعزز للنماذج اللغوية الكبيرة

- نماذج التقطير قوية للغاية، وسنقوم بتشغيل الذكاء الاصطناعي الذكي للغاية على الهواتف المحمولة

لا تزال سلسلة ردود الفعل التي أثارها DeepSeek مستمرة، مثل إتاحة OpenAI o3-mini مجانًا، والأمل في المجتمع للحد من المناقشات الغامضة حول الذكاء الاصطناعي للذكاء الاصطناعي/ الذكاء الاصطناعي المتقدم، والشائعات التي تقول إن ميتا في حالة ذعر.

وهو يعتقد أنه من الصعب التنبؤ بمن سيفوز في نهاية المطاف، ولكن يجب ألا ننسى قوة ميزة المتأخر. ففي النهاية، نعلم جميعًا أن جوجل هي التي اخترعت المتحوّل، بينما أطلق OpenAI العنان لإمكاناته الحقيقية.

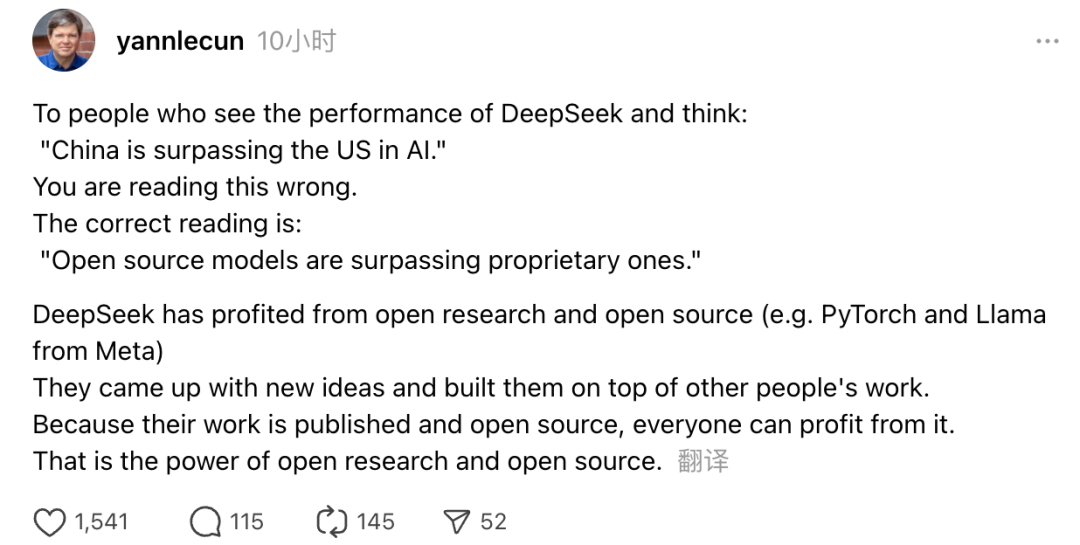

بالإضافة إلى ذلك، أعرب يان لوكون، الحائز على جائزة تورينج وكبير علماء الذكاء الاصطناعي في Meta، عن آرائه.

"بالنسبة لأولئك الذين يعتقدون، عند رؤية أداء DeepSeek، أن "الصين تتفوق على الولايات المتحدة في مجال الذكاء الاصطناعي، فهمتم خطأ. الفهم الصحيح هو أن النماذج مفتوحة المصدر تتفوق على النماذج المملوكة."

قال لوكون إن السبب الذي جعل DeepSeek تحقق مثل هذا النجاح هذه المرة هو أنها استفادت من الأبحاث المفتوحة والمصدر المفتوح (مثل PyTorch وLlama من Meta). لقد توصل DeepSeek إلى أفكار جديدة وبنى على عمل الآخرين. ولأن أعمالهم منشورة علنًا ومفتوحة المصدر، يمكن للجميع الاستفادة منها. هذه هي قوة البحث المفتوح والمصدر المفتوح.

تستمر تأملات مستخدمي الإنترنت. فبينما هم متحمسون لتطور التكنولوجيات الجديدة، إلا أنهم يشعرون أيضًا بقليل من القلق. ففي نهاية المطاف، قد يكون لظهور DeepSeekers تأثير حقيقي.