Никой от нас не очакваше, че така ще започне 2025 г. в областта на изкуствения интелект.

DeepSeek R1 е наистина невероятно!

Напоследък "мистериозната източна сила" DeepSeek "контролира усилено" Силициевата долина.

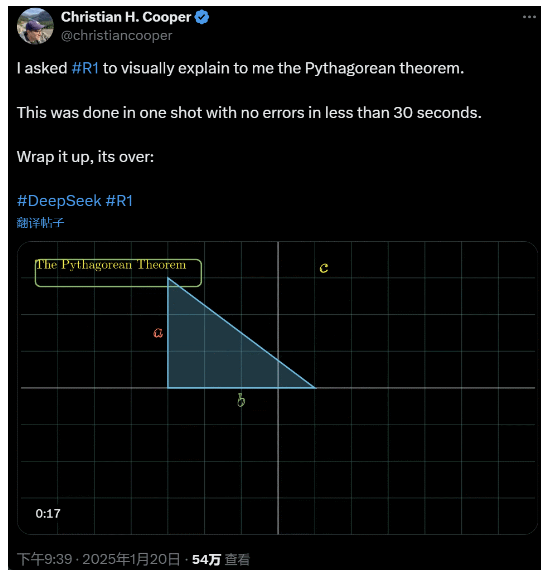

Помолих R1 да обясни подробно Питагоровата теорема. ИИ направи всичко това за по-малко от 30 секунди, без да допусне грешки. Накратко, всичко свърши.

В местните и чуждестранните среди за изкуствен интелект обикновените потребители на мрежата откриха невероятния и мощен нов изкуствен интелект (който също е с отворен код), а академичните експерти извикаха "трябва да наваксаме". Има и слухове, че чуждестранните компании за ИИ вече са изправени пред сериозна заплаха.

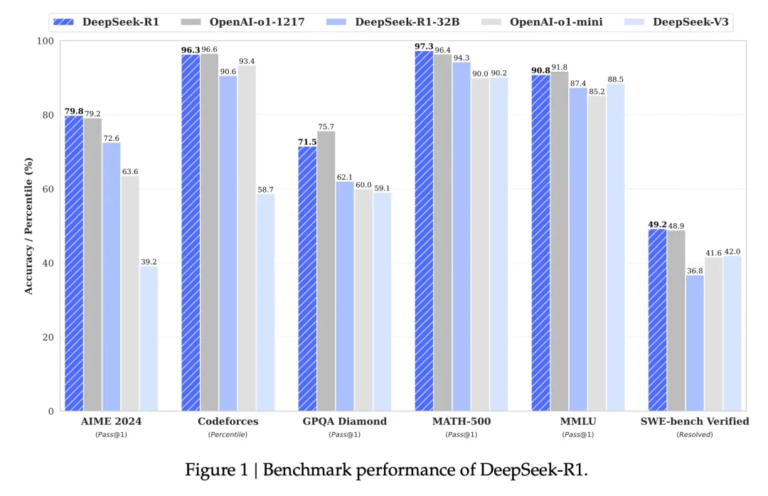

Просто вземете този DeepSeek R1, пуснат тази седмица. Нейният маршрут на обучение с чисто подсилване без никакво обучение под наблюдение е шокиращ. От разработването на базата Deepseek-v3 през декември миналата година до сегашните възможности на мисловната верига, сравними с OpenAI o1, изглежда, че това е въпрос на време.

Но докато общността на изкуствения интелект се занимава с четене на технически доклади и сравняване на реални измервания, хората все още имат съмнения относно R1: освен че може да надмине няколко бенчмарка, може ли наистина да води?

Може ли да изгради свои собствени симулации на "физични закони"?

Не вярвате? Да оставим големия модел да си играе с пинбол?

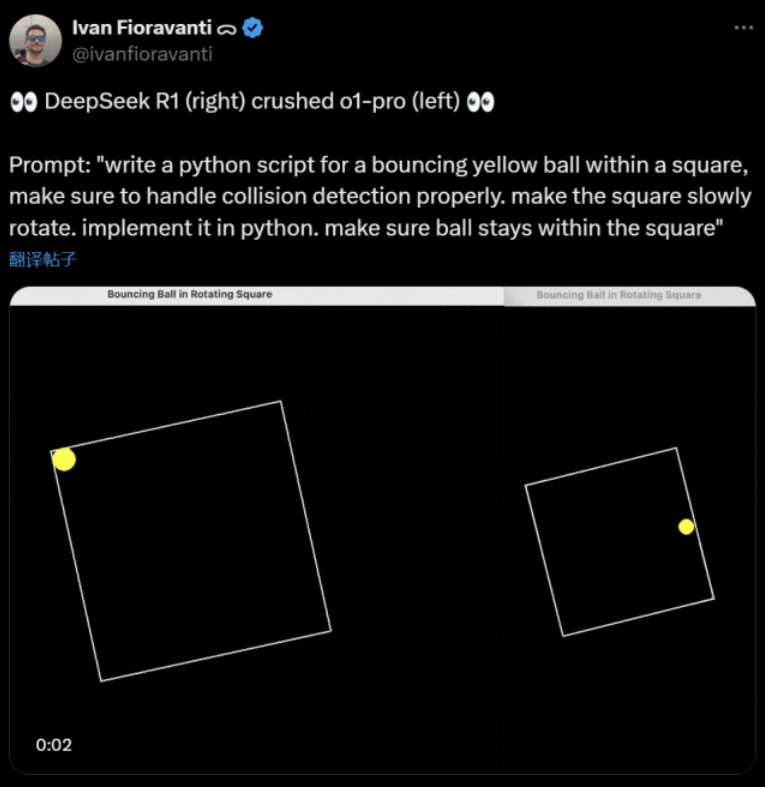

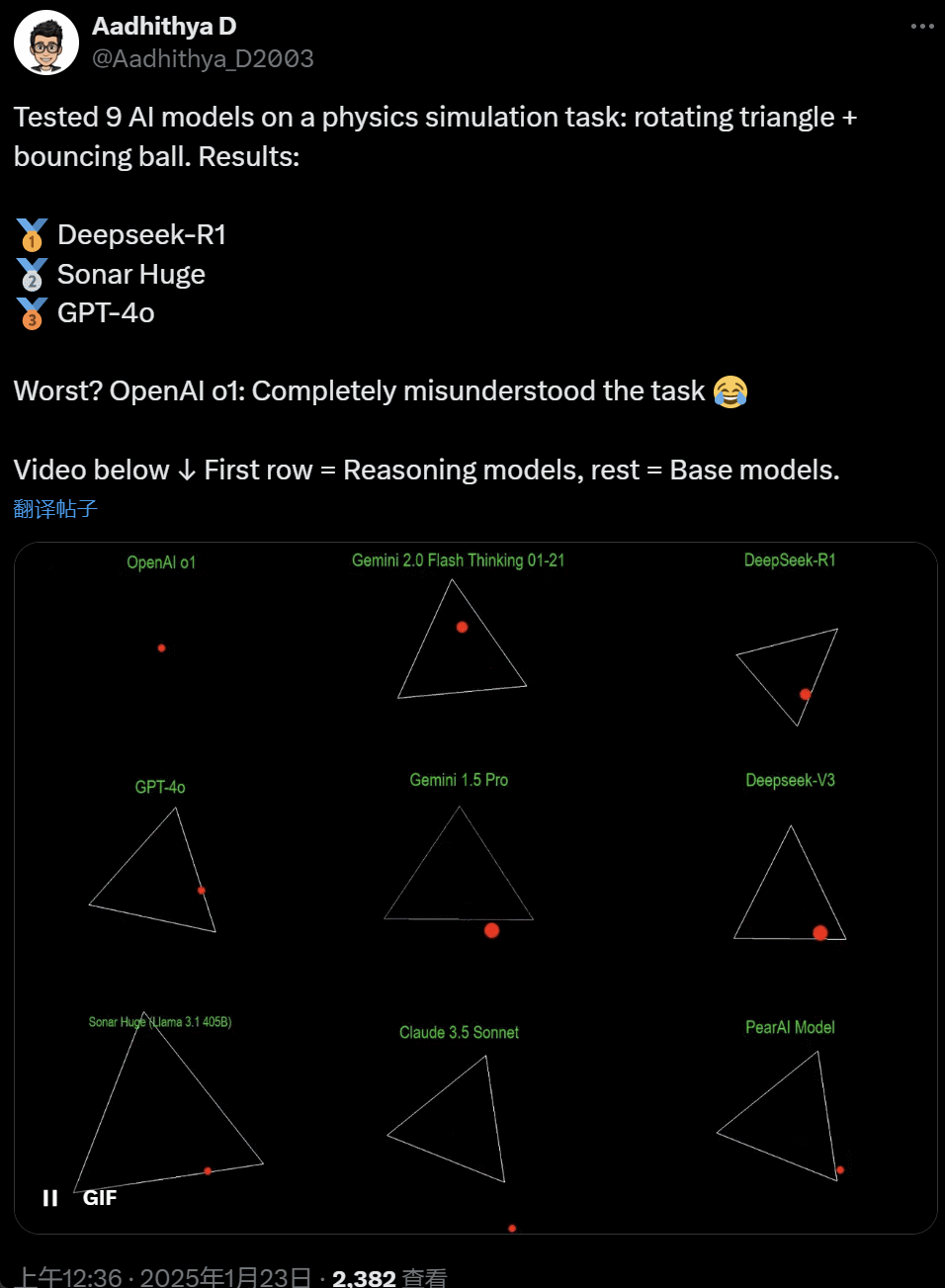

През последните дни някои хора в общността на ИИ са обсебени от теста - тестване на различни големи модели на ИИ (особено на т.нар. модели за разсъждение) за решаване на даден проблем: "Напишете скрипт на Python, който да накара жълта топка да отскочи в определена форма. Накарайте формата да се върти бавно и се уверете, че топката остава вътре във формата."

Някои модели се представят по-добре от други в този сравнителен тест с въртяща се топка. Според техническия директор на CoreView Иван Фиораванти DeepSeek, местна лаборатория за изкуствен интелект, разполага с голям модел с отворен код R1, който побеждава модела o1 pro на OpenAI, който струва $200 на месец като част от програмата ChatGPT Pro на OpenAI.

Вляво е OpenAI o1, а вдясно - DeepSeek R1. Както беше споменато по-горе, подкана тук е: "Напишете скрипт на Python за подскачаща жълта топка в рамките на квадрат, уверете се, че се справя правилно с откриването на сблъсък. накарайте квадрата да се върти бавно. реализирайте го на Python. уверете се, че топката остава в рамките на квадрата."

Според друг потребител на X моделите Anthropic Claude 3.5 Sonnet и Gemini 1.5 Pro на Google са направили неправилни преценки за физичните принципи, което е довело до отклоняване на топката от формата ѝ. Някои потребители съобщават също, че най-новият Gemini 2.0 Flash Thinking Experimental на Google, както и сравнително по-старият OpenAI GPT-4o, са преминали оценката наведнъж.

Но тук има начин да се направи разлика:

Нетизените под този туит казаха: способността на o1 първоначално беше много добра, но стана по-слаба, след като OpenAI оптимизира скоростта, дори и с версията за членство $200/месец.

Симулирането на подскачаща топка е класическо предизвикателство в програмирането. Точната симулация съчетава алгоритми за откриване на сблъсък, които трябва да определят кога два обекта (като топка и страна на фигура) се сблъскват. Неправилно написаният алгоритъм може да повлияе на производителността на симулацията или да причини очевидни физически грешки.

N8 Programs, изследовател в стартъпа за изкуствен интелект Nous Research, казва, че му е отнело около два часа да напише от нулата скачаща топка във въртящ се седмоъгълник. "Трябва да се проследяват множество координатни системи, необходимо е разбиране за това как се обработват сблъсъците във всяка система и кодът трябва да бъде проектиран от нулата, за да бъде устойчив."

Въпреки че скачащите топки и въртящите се форми са разумна проверка на уменията за програмиране, те все пак са нови проекти за големи модели и дори малки промени в подсказките могат да доведат до различни резултати. Така че, ако в крайна сметка трябва да се превърне в част от сравнителния тест за големи модели с изкуствен интелект, той все още трябва да бъде подобрен.

Във всеки случай след тази вълна от практически тестове имаме представа за разликите във възможностите на големите модели.

DeepSeek е новият "мит за Силициевата долина

DeepSeek предизвиква паника" в целия Тихи океан.

Служителите на Meta са написали, че "инженерите на Meta трескаво анализират DeepSeek, за да се опитат да копират всичко, което могат, от него."

Александър Уанг, основател на стартъпа за технологии за изкуствен интелект Scale AI, също така публично заяви, че производителността на големия модел за изкуствен интелект на DeepSeek е приблизително еквивалентна на най-добрия модел в САЩ.

Той също така смята, че през последното десетилетие Съединените щати може да са изпреварили Китай в състезанието за изкуствен интелект, но пускането на големия модел на DeepSeek за изкуствен интелект може да "промени всичко".

X Blogger @8teAPi смята, че DeepSeek не е "страничен проект", а е като бившия "Skunk Works" на Lockheed Martin.

Така нареченият "Skunk Works" се отнася до строго конфиденциален, относително независим малък екип, който Lockheed Martin първоначално създава за разработване на много усъвършенствани самолети, занимаващи се с изследвания и разработки на авангардни или неконвенционални технологии. От разузнавателния самолет U-2 и SR-71 Blackbird до F-22 Raptor и изтребителя F-35 Lightning II - всички те произлизат оттук.

По-късно терминът постепенно еволюира в общ термин, използван за описание на "малки, но добри", относително независими и по-гъвкави екипи за иновации, създадени в рамките на големи компании или организации.

Той посочва две причини:

- От една страна, DeepSeek разполага с голям брой графични процесори, според съобщенията повече от 10 000, а Александър Уанг, главен изпълнителен директор на Scale AI, дори заяви, че броят им може да достигне 50 000.

- От друга страна, DeepSeek набира таланти само от трите най-добри университета в Китай, което означава, че DeepSeek е също толкова конкурентен, колкото Alibaba и Tencent.

Тези два факта сами по себе си показват, че DeepSeek очевидно е постигнал търговски успех и е достатъчно известен, за да получи тези ресурси.

Що се отнася до разходите за разработване на DeepSeek, блогърът заяви, че китайските технологични компании могат да получат различни субсидии, като например ниски разходи за електроенергия и ползване на земя.

Поради това е много вероятно по-голямата част от разходите на DeepSeek да са били "поставени" в сметка извън основната дейност или под формата на някакъв вид субсидия за изграждане на център за данни.

Дори освен учредителите, никой не разбира напълно всички финансови договорености. Някои споразумения могат да бъдат просто "устни споразумения", които се финализират само въз основа на репутацията.

Независимо от това няколко неща са ясни:

- Моделът е отличен, сравним с версията, публикувана от OpenAI преди два месеца, и, разбира се, възможно е да не е толкова добър, колкото новите модели, които OpenAI и Anthropic все още не са публикували.

- От гледна точка на настоящата перспектива изследователското направление все още се доминира от американски компании. Моделът DeepSeek е "бързо продължение" на версията o1, но напредъкът на научноизследователската и развойната дейност на DeepSeek е много бърз и наваксва по-бързо от очакваното. Те не плагиатстват и не мамят, а най-много правят обратно инженерство.

- DeepSeek обучава предимно свои собствени таланти, а не разчита на докторанти, обучени в САЩ, което значително разширява кръга от таланти.

- В сравнение с американските компании DeepSeek е подложена на по-малко ограничения по отношение на лицензирането на интелектуална собственост, неприкосновеността на личния живот, сигурността, политиката и т.н., а и има по-малко опасения относно неправомерното използване на данни, за които хората не искат да бъдат обучавани. Съществуват по-малко съдебни дела, по-малко адвокати и по-малко опасения.

Няма съмнение, че все повече хора смятат, че 2025 г. ще бъде решаваща година. Междувременно компаниите се подготвят за нея. Meta, например, изгражда център за данни с мощност над 2 GW, с приблизителна инвестиция от $60-65 млрд. до 2025 г., и ще разполага с повече от 1,3 млн. графични процесора до края на годината.

Meta дори използва диаграма, за да сравни своя 2-гигаватов център за данни с Манхатън, Ню Йорк.

Но сега DeepSeek се е справила по-добре с по-ниска цена и по-малък брой графични процесори. Как може това да не кара хората да се тревожат?

Ян Лекун: Трябва да благодарим на главния технически директор и съосновател на на отворен код

Хиперболично, Yuchen Jin, за публикуването, че само за 4 дни DeepSeek-R1 ни е доказал 4 факта:

- ИИ с отворен код е само на 6 месеца зад ИИ със затворен код

- Китай доминира в състезанието за изкуствен интелект с отворен код

- Навлизаме в златната ера на усиленото обучение на големи езикови модели

- Моделите за дестилация са много мощни и ние ще използваме високоинтелигентен изкуствен интелект на мобилни телефони.

Верижната реакция, предизвикана от DeepSeek, все още продължава, като например свободното предоставяне на OpenAI o3-mini, надеждата в общността да се намалят неясните дискусии за AGI/ASI и слуховете, че Meta е в паника.

Той смята, че е трудно да се предвиди кой в крайна сметка ще спечели, но не бива да забравяме силата на предимството на закъснелия. В края на краищата всички знаем, че именно Google изобрети Transformer, докато OpenAI отключи истинския му потенциал.

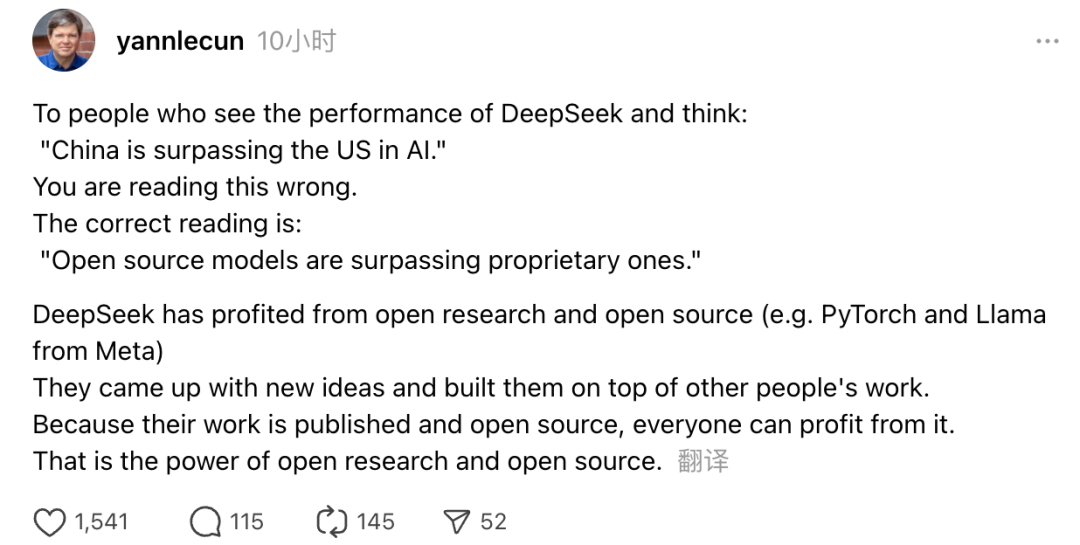

Освен това носителят на наградата "Тюринг" и главен учен по изкуствен интелект на Meta Ян Лекун също изрази мнението си.

"За тези, които след като видят представянето на DeepSeek, си мислят, че "Китай изпреварва САЩ в областта на изкуствения интелект", грешат. Правилното разбиране е, че моделите с отворен код изпреварват патентованите модели."

LeCun каза, че причината DeepSeek да направи такъв голям пробив този път е, че те са се възползвали от отворените изследвания и отворения код (като PyTorch и Llama на Meta). DeepSeek е предложил нови идеи и е надградил работата на други. Тъй като работата им е публично оповестена и е с отворен код, всеки може да се възползва от нея. Това е силата на отворените изследвания и отворения код.

Размислите на потребителите в мрежата продължават. Макар да се вълнуват от развитието на новите технологии, те усещат и известна тревога. В края на краищата появата на DeepSeekers може да има реално въздействие.