o3-mini ankom sent om aftenen, og OpenAI afslørede endelig sit seneste trumfkort. Under en Reddit AMA Q&A indrømmede Altman dybt, at han havde stået på den forkerte side af open source AI.

Han sagde, at den interne strategi for open source er under overvejelse, og at modellen fortsat vil blive udviklet, men OpenAI's forspring vil ikke være så stort som tidligere.

Mens alle stadig undrede sig over DeepSeek's fantastiske kraft, kunne OpenAI til sidst ikke sidde stille længere.

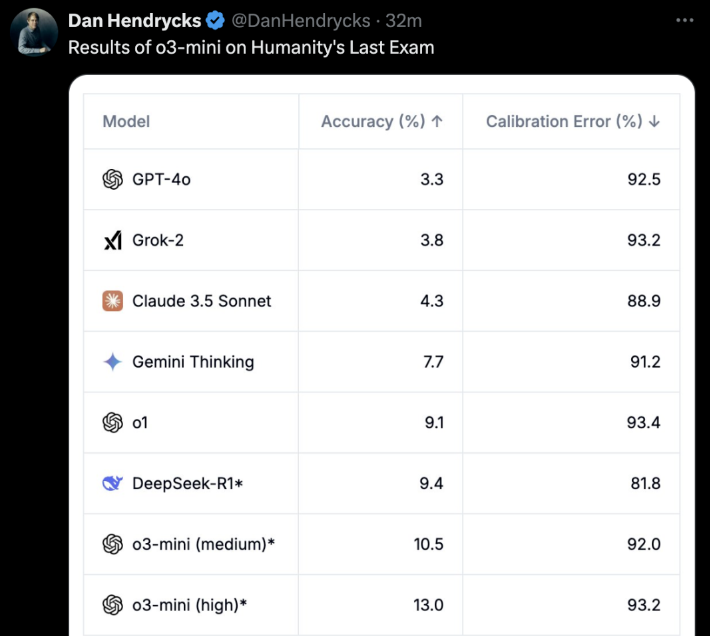

Tidligt om morgenen i går blev o3-mini hastigt lanceret og satte nye SOTA i benchmarktests som matematisk kode og vendte tilbage til tronen.

Det vigtigste er, at gratis brugere også kan opleve det! o3-mini er ikke til at spøge med. I den "sidste eksamen for mennesker" opnåede o3-mini (høj) direkte den bedste nøjagtighed og kalibreringsfejl.

Et par timer efter o3-mini gik onlineåbnede OpenAI officielt en Reddit AMA i cirka en time.

Altman gik også selv online og svarede på alle spørgsmålene fra netbrugere.

De vigtigste højdepunkter er:

- DeepSeek er faktisk meget godog vi vil fortsætte med at udvikle bedre modeller, men forspringet vil ikke være så stort som før.

- Sammenlignet med for et par år siden er jeg nu mere tilbøjelig til at tro, at AI kan opleve hurtige spring og spring

- Vi er på den forkerte side af spørgsmålet om open-sourcing af vægtede AI-modeller

- Der kommer snart en opdatering til den avancerede stemmetilstand, og vi kalder den direkte GPT-5, ikke GPT-5o. Der er ingen specifik tidsplan endnu.

Ud over Altman selv var Chief Research Officer Mark Chen, Chief Product Officer Kevin Weil, Vice President of Engineering Srinivas Narayanan, Head of API Research Michelle Pokrass og Head of Research Hongyu Ren også online og svarede omhyggeligt på alle spørgsmålene fra netbrugere.

Lad os nu se på, hvad de alle sagde.

Altman fortryder dybt, at han valgte den forkerte side i kampen om open source AI

DeepSeek's pludselige comeback kan have været uventet for alle.

Under AMA Q&A angrede Altman også dybt, at han havde valgt den forkerte side i open source AI-kampen og måtte indrømme DeepSeek's stærke fordele.

Det, der overraskede mange, var, at Altman endda sagde, at OpenAI's føring ikke var så stærk, som den plejede at være.

Her er alle de klassiske svar, vi har samlet fra Altman.

Q: Lad os tale om ugens store emne: Deepseek. Det er helt klart en meget imponerende model, og jeg ved, at den sandsynligvis er blevet trænet oven på resultaterne fra andre LLM'er. Hvordan vil det ændre dine planer for fremtidige modeller?

Altman: Det er virkelig en meget imponerende model! Vi vil udvikle bedre modeller, men vi vil ikke være i stand til at holde et så stort forspring som i de foregående år.

Spørgsmål: Tror du, at rekursiv selvforbedring vil være en gradvis proces eller en pludselig opblomstring?

Altman: Personligt tror jeg, at jeg er mere tilbøjelig til at tro, at AI kan gøre hurtige fremskridt, end jeg var for et par år siden. Måske er det på tide at skrive noget om dette emne ...

Q: Kan vi se alle de symboler, som modellen tænker på?

Altman: Ja, vi viser snart en mere nyttig og detaljeret version. Tak til R1 for opdateringen.

Kevin Weil, produktchef: Vi arbejder på at vise mere, end vi gør nu - det vil ske snart. Om vi viser alt eller ej, er endnu ikke afgjort. At vise alle tankekæderne (CoT) ville føre til destillation af konkurrentmodeller, men vi ved også, at brugerne (i hvert fald de avancerede brugere) gerne vil se det, så vi finder en god balance.

Q: Hvornår vil den fulde version af o3 være tilgængelig?

Altman: Jeg vil anslå, at det bliver mere end et par uger, men ikke mere end et par måneder.

Q: Kommer der en opdatering til voice mode? Er det potentielt et fokus for GPT-5o? Hvad er den omtrentlige tidslinje for GPT-5o?

Altman: Ja, der kommer en opdatering til den avancerede stemmetilstand! Jeg tror bare, vi vil kalde den GPT-5, ikke GPT-5o. Der er ingen specifik tidslinje endnu.

Spørgsmål: Vil du overveje at frigive nogle modelvægte og offentliggøre noget forskning?

Altman: Ja, vi diskuterer det. Jeg synes personligt, at vi er på den forkerte side af dette spørgsmål og er nødt til at komme med en anden open source-strategi; ikke alle i OpenAI deler denne opfattelse, og det er ikke vores højeste prioritet i øjeblikket.

Endnu et sæt spørgsmål:

- Hvor tæt er vi på at kunne tilbyde Operator i det almindelige Plus-program?

- Hvad er robotafdelingens topprioriteter?

- Hvad mener OpenAI om mere specialiserede chips/TPU'er som Trillium, Cerebras osv. Er OpenAI opmærksom på dette?

- Hvilke investeringer foretages for at sikre sig mod fremtidige risici i AGI og ASI?

- Hvad var din mest mindeværdige ferie?

Altman:

- Et par måneder

- at producere en rigtig god robot i lille skala og lære af erfaringerne

- GB200 er i øjeblikket svær at slå!

- Et godt valg ville være at forbedre din indre tilstand - modstandskraft, tilpasningsevne, ro, glæde osv.

- Det er svært at vælge! Men de to første, der falder mig ind, er: backpacking i Sydøstasien eller safari i Afrika.

Q: Har du planer om at hæve prisen på Plus-serien?

Altman: Faktisk vil jeg gradvist reducere det.

Spørgsmål: Antag, at vi befinder os i år 2030, og at du lige har skabt et system, som de fleste vil kalde en AGI. Det udmærker sig i alle benchmark-tests og udkonkurrerer dine bedste ingeniører og forskere med hensyn til hastighed og ydeevne. Hvad er det næste skridt? Bortset fra "at lægge det på hjemmesiden og tilbyde det som en service", har du så andre planer?

Altman: Den vigtigste effekt vil efter min mening være at fremskynde videnskabelige opdagelser, som jeg tror er den faktor, der vil bidrage mest til at forbedre livskvaliteten.

4o billedgenerering, kommer snart

Derefter blev der tilføjet svar fra andre OpenAI-medlemmer.

Q: Har du stadig planer om at lancere 4o-billedgeneratoren?

Kevin Weil, produktchef: Ja! Og jeg tror, at ventetiden er det værd.

Q: Fantastisk! Er der en nogenlunde tidsplan?

Kevin Weil, produktchef: Du beder mig om at komme i problemer. Måske et par måneder.

Og et andet lignende spørgsmål.

Q: Hvornår kan vi forvente at se ChatGPT-5?

Kevin Weil, produktchef: Kort efter o-17 micro og GPT-(π+1).

Og et andet spørgsmål dukker op:

- Hvilke andre typer agenter kan vi forvente?

- Og også give en agent til gratis brugere, hvilket kunne fremskynde adoptionen ...

- Er der nyt om den nye version af DALL-E?

- Et sidste spørgsmål, og det er det, alle spørger om ... Hvornår bliver AGI implementeret?

Kevin Weil, produktchef:

- Flere agenter: meget, meget snart. Jeg tror, du bliver glad.

- Billedgenerering baseret på 4o: om et par måneder, jeg kan ikke vente på, at du bruger det. Den er fantastisk.

- AGI: Ja

Q: Har du planer om at tilføje filvedhæftningsfunktionalitet til ræsonneringsmodellen?

Srinivas Narayanan, teknisk direktør: Det er under udvikling. I fremtiden vil ræsonneringsmodellen kunne bruge forskellige værktøjer, herunder søgefunktioner.

Kevin Weil, produktchef: Bare for at sige, at jeg ikke kan vente med at se argumentationsmodellen for at kunne bruge værktøjer

Spørgsmål: Virkelig. Når du løser dette problem, vil der blive åbnet op for nogle meget nyttige AI-applikationsscenarier. Forestil dig, at den kan forstå indholdet af dine 500 GB arbejdsdokumenter.

Når du skal til at svare på en e-mail, åbnes et panel ved siden af din e-mail-app, som løbende analyserer alle de oplysninger, der er relateret til denne person, herunder jeres forhold, de emner, der er blevet diskuteret, tidligere arbejde osv. Måske vil noget fra et dokument, du for længst har glemt, blive markeret, fordi det er yderst relevant for den aktuelle diskussion. Jeg vil så gerne have denne funktion.

Srinivas Narayanan, teknisk direktør: Vi arbejder på at øge længden af konteksten. Der er ingen fast dato/annoncering endnu.

Spørgsmål: Hvor vigtigt er Stargate-projektet for OpenAI's fremtid? Kevin Weil, produktchef: Det er meget vigtigt. Alt, hvad vi har set, tyder på, at jo mere computerkraft vi har, jo bedre modeller kan vi bygge, og jo mere værdifulde produkter kan vi skabe.

Vi skalerer modeller i to dimensioner lige nu - større pretraining og mere reinforcement learning (RL)/"strawberry"-træning - som begge kræver computerressourcer.

At betjene hundredvis af millioner af brugere kræver også computerressourcer! Og når vi bevæger os i retning af mere intelligente agentprodukter, der kan arbejde for dig hele tiden, kræver det også computerressourcer. Så du kan tænke på Stargate som vores fabrik, hvor elektricitet/GPU'er omdannes til fantastiske produkter.

Spørgsmål: Hvilken intern model bruger du nu? o4, o5 eller o6? Hvor meget smartere er disse interne modeller i forhold til o3?

Michelle Pokrass, leder af API Research: Vi har mistet overblikket.

Spørgsmål: Giv os mulighed for at interagere med tekst/canvas ved hjælp af avancerede stemmefunktioner. Jeg vil gerne kunne tale til den og få den til at ændre dokumenter iterativt.

Kevin Weil, produktchef: Ja! Vi har en masse gode værktøjer, som er blevet udviklet relativt uafhængigt af hinanden - målet er at få de værktøjer i hænderne på dig så hurtigt som muligt.

Det næste skridt er at integrere alle disse funktioner, så man kan tale med en model, der søger og ræsonnerer på samme tid, og generere et lærred, der kan køre Python. Alle værktøjer skal arbejde bedre sammen. Og forresten skal alle modeller have fuld værktøjsadgang (modellerne i o-serien kan i øjeblikket ikke bruge alle værktøjer), hvilket også vil blive implementeret.

Q: Hvornår vil modellerne i o-serien understøtte hukommelsesfunktionen i ChatGPT?

Michelle Pokrass, leder af API Research: Det er under udvikling! Vores højeste prioritet er at forene alle vores funktioner med modellerne i o-serien.

Spørgsmål: Kommer der nogen større forbedringer til 4o? Jeg kan virkelig godt lide den brugerdefinerede GPT, og det ville være dejligt, hvis den kunne opgraderes, eller hvis vi kunne vælge, hvilken model der skal bruges i den brugerdefinerede GPT (som f.eks. o3 mini).

Michelle Pokrass, leder af API Research: Ja, vi er ikke færdige med 4o-serien endnu!