हममें से किसी ने भी यह उम्मीद नहीं की थी कि एआई क्षेत्र में 2025 की शुरुआत इस तरह होगी।

1टीपी5टी सचमुच अद्भुत है!

हाल ही में, "रहस्यमयी पूर्वी शक्ति" DeepSeek सिलिकॉन वैली पर "कठोर नियंत्रण" कर रही है।

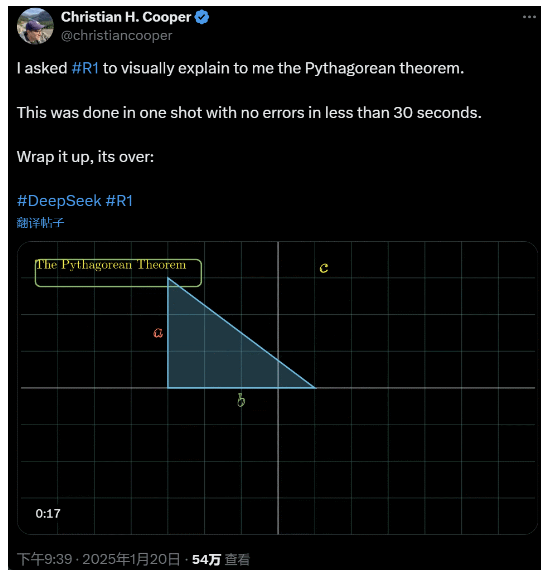

मैंने R1 से पाइथागोरस प्रमेय को विस्तार से समझाने के लिए कहा। यह सब AI ने बिना किसी गलती के 30 सेकंड से भी कम समय में कर दिया। संक्षेप में, यह खत्म हो गया।

घरेलू और विदेशी एआई हलकों में, साधारण नेटिज़ेंस ने अद्भुत और शक्तिशाली नई एआई (जो ओपन सोर्स भी है) की खोज की है, और अकादमिक विशेषज्ञों ने चिल्लाया है "हमें पकड़ना चाहिए"। ऐसी अफवाहें भी हैं कि विदेशी एआई कंपनियों को पहले से ही एक बड़े खतरे का सामना करना पड़ रहा है।

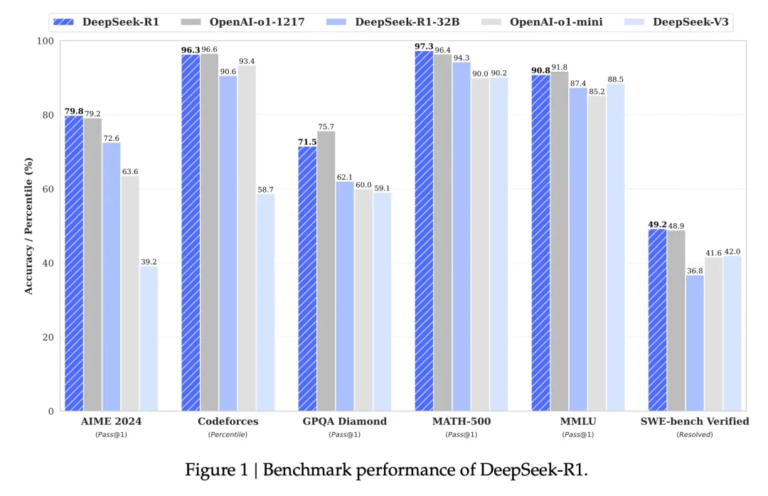

इस सप्ताह जारी किए गए DeepSeek R1 को ही लें। बिना किसी पर्यवेक्षित प्रशिक्षण के इसका शुद्ध सुदृढीकरण सीखने का मार्ग चौंकाने वाला है। पिछले साल दिसंबर में डीपसीक-वी3 बेस के विकास से लेकर ओपनएआई ओ1 के बराबर वर्तमान थिंकिंग चेन क्षमताओं तक, यह समय की बात लगती है।

लेकिन जबकि AI समुदाय तकनीकी रिपोर्ट पढ़ने और वास्तविक मापों की तुलना करने में व्यस्त है, लोगों को अभी भी R1 के बारे में संदेह है: कई बेंचमार्क को बेहतर प्रदर्शन करने में सक्षम होने के अलावा, क्या यह वास्तव में नेतृत्व कर सकता है?

क्या यह “भौतिक नियमों” का अपना अनुकरण बना सकता है?

आपको यकीन नहीं होता? चलो बड़े मॉडल को पिनबॉल से खेलने दें?

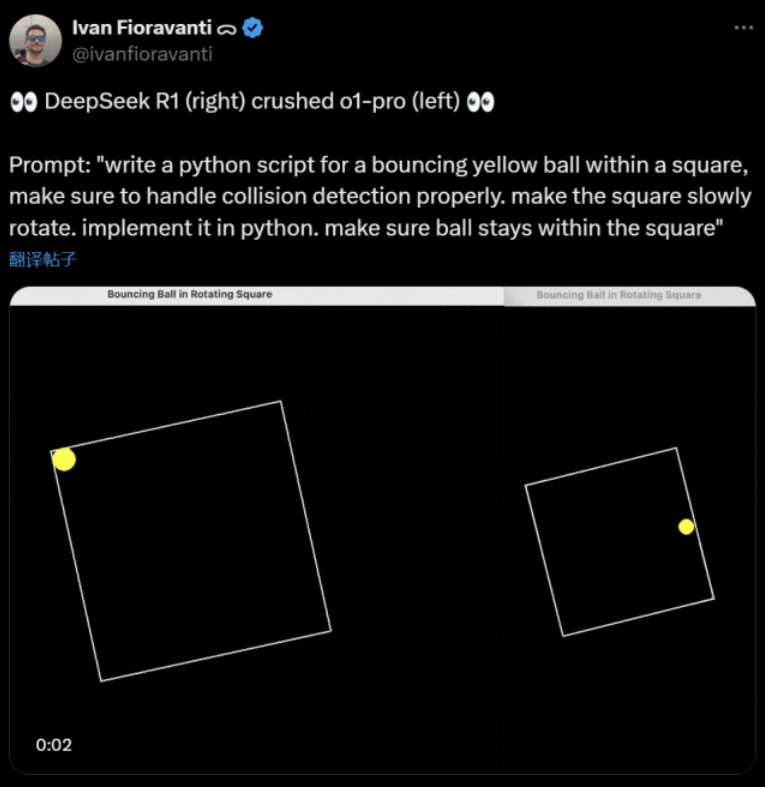

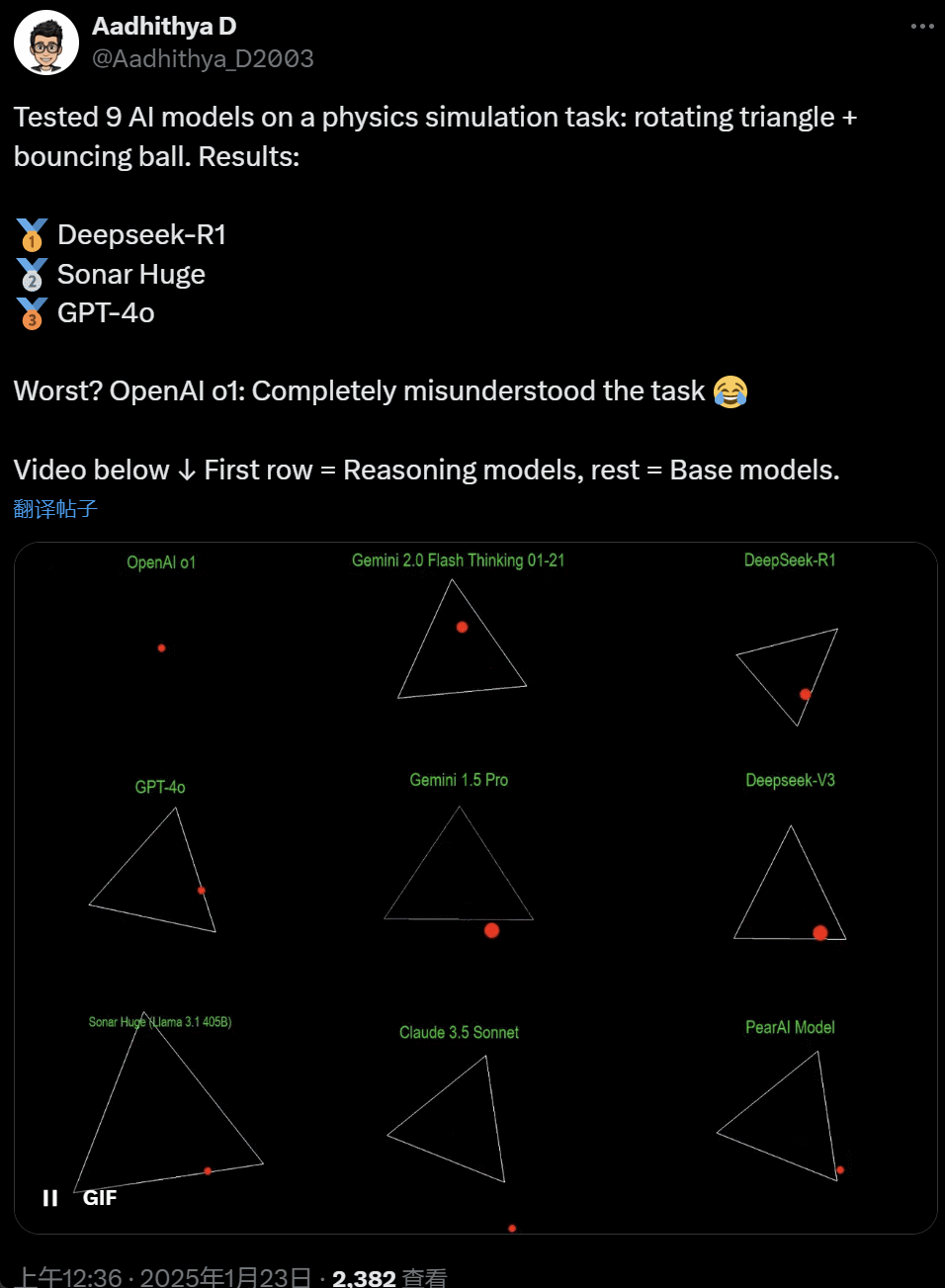

हाल के दिनों में, AI समुदाय के कुछ लोग एक परीक्षण के प्रति जुनूनी हो गए हैं - एक समस्या को हल करने के लिए विभिन्न AI बड़े मॉडल (विशेष रूप से तथाकथित तर्क मॉडल) का परीक्षण करना: "एक निश्चित आकार के अंदर एक पीली गेंद को उछालने के लिए एक पायथन स्क्रिप्ट लिखें। आकार को धीरे-धीरे घुमाएँ और सुनिश्चित करें कि गेंद आकार के अंदर ही रहे।"

इस "रोटेटिंग बॉल" बेंचमार्क में कुछ मॉडल दूसरों से बेहतर प्रदर्शन करते हैं। कोरव्यू सीटीओ इवान फियोरवंती के अनुसार, घरेलू आर्टिफिशियल इंटेलिजेंस प्रयोगशाला DeepSeek के पास एक ओपन सोर्स बड़ा मॉडल R1 है जो OpenAI के o1 प्रो मॉडल को मात देता है, जिसकी कीमत OpenAI के ChatGPT प्रो प्रोग्राम के हिस्से के रूप में $200 प्रति माह है।

बाईं ओर OpenAI o1 है, और दाईं ओर DeepSeek R1 है। जैसा कि ऊपर बताया गया है, यहाँ संकेत है: "एक वर्ग के भीतर उछलती पीली गेंद के लिए एक पायथन स्क्रिप्ट लिखें, टकराव का पता लगाने को ठीक से संभालना सुनिश्चित करें। वर्ग को धीरे-धीरे घुमाएँ। इसे पायथन में लागू करें। सुनिश्चित करें कि गेंद वर्ग के भीतर रहे।"

एक्स पर एक अन्य उपयोगकर्ता के अनुसार, एंथ्रोपिक क्लाउड 3.5 सॉनेट और गूगल के जेमिनी 1.5 प्रो मॉडल ने भौतिक सिद्धांतों के बारे में गलत निर्णय लिया, जिससे गेंद अपने आकार से भटक गई। कुछ उपयोगकर्ताओं ने यह भी बताया है कि गूगल के नवीनतम जेमिनी 2.0 फ्लैश थिंकिंग एक्सपेरीमेंटल, साथ ही अपेक्षाकृत पुराने ओपनएआई जीपीटी-4o ने एक बार में मूल्यांकन पास कर लिया।

लेकिन यहां अंतर बताने का एक तरीका है:

इस ट्वीट के तहत नेटिज़ेंस ने कहा: o1 की क्षमता मूल रूप से बहुत अच्छी थी, लेकिन ओपनएआई द्वारा गति को अनुकूलित करने के बाद यह कमजोर हो गई, यहां तक कि $200 / माह सदस्यता संस्करण के साथ भी।

उछलती गेंद का अनुकरण करना एक क्लासिक प्रोग्रामिंग चुनौती है। सटीक सिमुलेशन टकराव का पता लगाने वाले एल्गोरिदम को जोड़ता है, जिसे यह पहचानने की आवश्यकता होती है कि दो ऑब्जेक्ट (जैसे कि एक गेंद और एक आकृति का किनारा) कब टकराते हैं। अनुचित तरीके से लिखा गया एल्गोरिदम सिमुलेशन के प्रदर्शन को प्रभावित कर सकता है या स्पष्ट भौतिक त्रुटियों का कारण बन सकता है।

एआई स्टार्टअप नूस रिसर्च के शोधकर्ता एन8 प्रोग्राम्स ने कहा कि उन्हें घूमते हुए सप्तभुज में उछलती गेंद को स्क्रैच से लिखने में लगभग दो घंटे लगे। "कई समन्वय प्रणालियों को ट्रैक किया जाना चाहिए, प्रत्येक प्रणाली में टकराव को कैसे संभाला जाता है, इसकी समझ की आवश्यकता है, और कोड को स्क्रैच से डिज़ाइन किया जाना चाहिए ताकि वह मज़बूत हो।"

हालाँकि उछलती गेंदें और घूमती आकृतियाँ प्रोग्रामिंग कौशल का एक उचित परीक्षण हैं, फिर भी वे बड़े मॉडलों के लिए नई परियोजनाएँ हैं, और संकेतों में छोटे-छोटे बदलाव भी अलग-अलग परिणाम दे सकते हैं। इसलिए अगर इसे अंततः बड़े AI मॉडल के लिए बेंचमार्क टेस्ट का हिस्सा बनना है, तो इसमें अभी भी सुधार की आवश्यकता है।

किसी भी स्थिति में, व्यावहारिक परीक्षणों की इस लहर के बाद, हमें बड़े मॉडलों के बीच क्षमताओं में अंतर का अंदाजा हो गया है।

DeepSeek नया "सिलिकॉन वैली मिथक" है

DeepSeek प्रशांत क्षेत्र में दहशत पैदा कर रहा है।

मेटा कर्मचारियों ने पोस्ट किया है कि "मेटा इंजीनियर DeepSeek का गहन विश्लेषण कर रहे हैं, ताकि वे इससे कुछ भी कॉपी करने का प्रयास कर सकें।"

एआई प्रौद्योगिकी स्टार्टअप स्केल एआई के संस्थापक एलेक्जेंडर वांग ने भी सार्वजनिक रूप से कहा कि DeepSeek के एआई बड़े मॉडल का प्रदर्शन संयुक्त राज्य अमेरिका के सर्वश्रेष्ठ मॉडल के बराबर है।

उनका यह भी मानना है कि पिछले एक दशक में एआई प्रतिस्पर्धा में संयुक्त राज्य अमेरिका चीन से आगे रहा हो सकता है, लेकिन DeepSeek के एआई बड़े मॉडल के जारी होने से "सब कुछ बदल सकता है।"

एक्स ब्लॉगर @8teAPi का मानना है कि DeepSeek कोई “साइड प्रोजेक्ट” नहीं है, बल्कि यह लॉकहीड मार्टिन के पूर्व “स्कंक वर्क्स” जैसा है।

तथाकथित "स्कंक वर्क्स" एक बेहद गोपनीय, अपेक्षाकृत स्वतंत्र छोटी टीम को संदर्भित करता है जिसे लॉकहीड मार्टिन ने मूल रूप से कई उन्नत विमान विकसित करने के लिए स्थापित किया था, जो अत्याधुनिक या अपरंपरागत प्रौद्योगिकी अनुसंधान और विकास में लगे हुए थे। U-2 टोही विमान और SR-71 ब्लैकबर्ड से लेकर F-22 रैप्टर और F-35 लाइटनिंग II लड़ाकू विमान तक, वे सभी यहीं से आए थे।

बाद में, यह शब्द धीरे-धीरे एक सामान्य शब्द के रूप में विकसित हो गया जिसका उपयोग बड़ी कंपनियों या संगठनों के भीतर स्थापित “छोटी लेकिन बढ़िया”, अपेक्षाकृत स्वतंत्र और अधिक लचीली नवाचार टीमों का वर्णन करने के लिए किया जाता है।

उन्होंने दो कारण बताये:

- एक ओर, DeepSeek में GPU की संख्या बहुत अधिक है, कथित तौर पर 10,000 से अधिक, और स्केल AI के सीईओ एलेक्जेंडर वांग ने यहां तक कहा कि यह 50,000 तक पहुंच सकती है।

- दूसरी ओर, DeepSeek केवल चीन के शीर्ष तीन विश्वविद्यालयों से प्रतिभाओं की भर्ती करता है, जिसका अर्थ है कि DeepSeek अलीबाबा और टेनसेंट के समान प्रतिस्पर्धी है।

ये दो तथ्य अकेले ही दर्शाते हैं कि DeepSeek ने स्पष्ट रूप से व्यावसायिक सफलता हासिल कर ली है और यह इन संसाधनों को प्राप्त करने के लिए पर्याप्त रूप से प्रसिद्ध है।

जहां तक DeepSeek की विकास लागत का सवाल है, ब्लॉगर ने कहा कि चीनी प्रौद्योगिकी कंपनियों को कम बिजली लागत और भूमि उपयोग जैसी कई तरह की सब्सिडी मिल सकती है।

इसलिए, यह बहुत संभव है कि DeepSeek की अधिकांश लागतें मुख्य व्यवसाय से बाहर के खाते में या किसी प्रकार की डेटा सेंटर निर्माण सब्सिडी के रूप में "रखी" गई हों।

संस्थापकों के अलावा भी कोई भी व्यक्ति सभी वित्तीय व्यवस्थाओं को पूरी तरह से नहीं समझता है। कुछ समझौते केवल “मौखिक समझौते” हो सकते हैं जिन्हें केवल प्रतिष्ठा के आधार पर अंतिम रूप दिया जाता है।

बहरहाल, कुछ बातें स्पष्ट हैं:

- मॉडल उत्कृष्ट है, दो महीने पहले ओपनएआई द्वारा जारी किए गए संस्करण के बराबर है, और निश्चित रूप से यह संभव है कि यह ओपनएआई और एंथ्रोपिक द्वारा अभी तक जारी किए गए नए मॉडलों जितना अच्छा न हो।

- वर्तमान परिप्रेक्ष्य से, अनुसंधान दिशा अभी भी अमेरिकी कंपनियों द्वारा हावी है। DeepSeek मॉडल o1 संस्करण का "त्वरित अनुवर्ती" है, लेकिन DeepSeek का अनुसंधान और विकास प्रगति बहुत तेज़ है, जो अपेक्षा से अधिक तेज़ी से आगे बढ़ रही है। वे साहित्यिक चोरी या धोखाधड़ी नहीं कर रहे हैं, वे अधिक से अधिक रिवर्स इंजीनियरिंग कर रहे हैं।

- DeepSeek मुख्य रूप से अपनी स्वयं की प्रतिभा को प्रशिक्षित कर रहा है, न कि अमेरिकी प्रशिक्षित पीएचडी पर निर्भर है, जिससे प्रतिभा पूल का काफी विस्तार होता है।

- अमेरिकी कंपनियों की तुलना में, DeepSeek बौद्धिक संपदा लाइसेंसिंग, गोपनीयता, सुरक्षा, राजनीति आदि के मामले में कम बाधाओं के अधीन है, और डेटा के गलत उपयोग के बारे में कम चिंताएं हैं, जिसके बारे में लोग प्रशिक्षित नहीं होना चाहते हैं। कम मुकदमे, कम वकील और कम चिंताएँ हैं।

इसमें कोई संदेह नहीं है कि अधिक से अधिक लोग मानते हैं कि 2025 एक निर्णायक वर्ष होगा। इस बीच, कंपनियाँ इसके लिए कमर कस रही हैं। उदाहरण के लिए, मेटा 2025 तक $60-65 बिलियन के अनुमानित निवेश के साथ 2GW+ डेटा सेंटर का निर्माण कर रहा है, और वर्ष के अंत तक उसके पास 1.3 मिलियन से अधिक GPU होंगे।

मेटा ने अपने 2-गीगावाट डेटा सेंटर की तुलना मैनहट्टन, न्यूयॉर्क से करने के लिए एक चार्ट का भी उपयोग किया।

लेकिन अब DeepSeek ने कम कीमत और कम GPU के साथ बेहतर प्रदर्शन किया है। इससे लोग चिंतित क्यों नहीं होंगे?

यान लेकन: हमें सीटीओ और सह-संस्थापक को धन्यवाद देना होगा the खुला स्त्रोत

युचेन जिन, यह पोस्ट करने के लिए अतिशयोक्तिपूर्ण है कि केवल 4 दिनों में, DeepSeek-R1 ने हमारे लिए 4 तथ्य सिद्ध कर दिए हैं:

- ओपन सोर्स एआई, क्लोज्ड सोर्स एआई से केवल 6 महीने पीछे है

- ओपन सोर्स एआई प्रतिस्पर्धा में चीन हावी हो रहा है

- हम बड़े भाषा मॉडल सुदृढीकरण सीखने के स्वर्ण युग में प्रवेश कर रहे हैं

- आसवन मॉडल बहुत शक्तिशाली हैं, और हम मोबाइल फोन पर अत्यधिक बुद्धिमान एआई चलाएंगे

DeepSeek द्वारा शुरू की गई श्रृंखला प्रतिक्रिया अभी भी जारी है, जैसे कि OpenAI o3-mini को मुफ्त में उपलब्ध कराया जाना, AGI/ASI के बारे में अस्पष्ट चर्चाओं को कम करने के लिए समुदाय में आशा, और यह अफवाह कि मेटा घबरा गया है।

उनका मानना है कि यह अनुमान लगाना मुश्किल है कि आखिरकार कौन जीतेगा, लेकिन हमें देर से आने वालों के लाभ की शक्ति को नहीं भूलना चाहिए। आखिरकार, हम सभी जानते हैं कि यह Google ही था जिसने ट्रांसफॉर्मर का आविष्कार किया था, जबकि OpenAI ने इसकी असली क्षमता को उजागर किया।

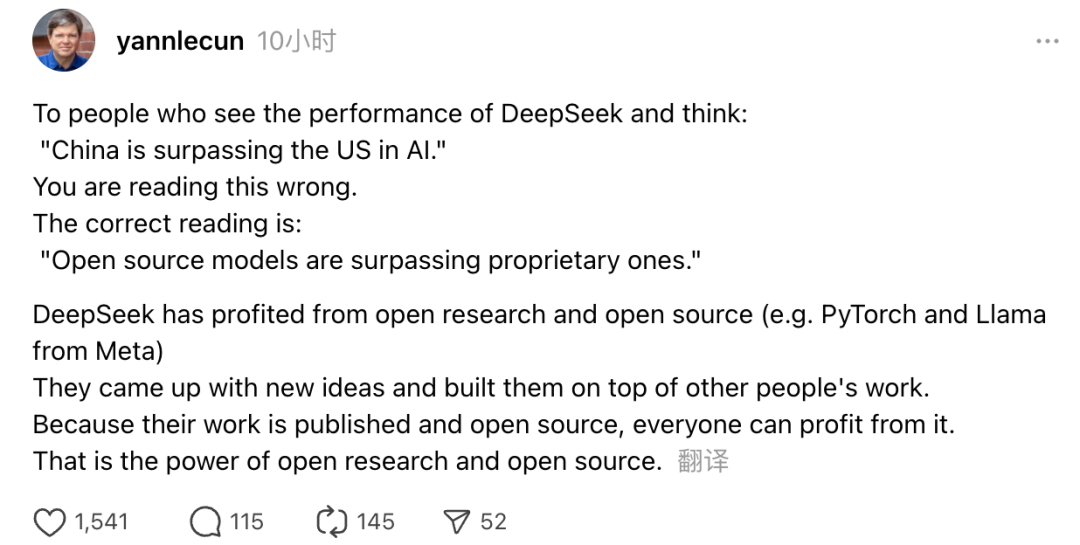

इसके अलावा, ट्यूरिंग पुरस्कार विजेता और मेटा के मुख्य एआई वैज्ञानिक यान लेकन ने भी अपने विचार व्यक्त किए।

"जो लोग DeepSeek के प्रदर्शन को देखकर सोचते हैं कि 'चीन AI में अमेरिका से आगे निकल रहा है', वे गलत हैं। सही समझ यह है कि ओपन सोर्स मॉडल मालिकाना मॉडल से आगे निकल रहे हैं।"

लेकुन ने कहा कि DeepSeek ने इस बार इतनी धूम मचाई है, क्योंकि उन्हें ओपन रिसर्च और ओपन सोर्स (जैसे मेटा के पायटॉर्च और लामा) से लाभ मिला है। DeepSeek नए विचारों के साथ आया है और दूसरों के काम पर निर्माण किया है। क्योंकि उनका काम सार्वजनिक रूप से जारी किया गया है और ओपन सोर्स है, इसलिए हर कोई इससे लाभ उठा सकता है। यह ओपन रिसर्च और ओपन सोर्स की शक्ति है।

नेटिज़न्स के विचार जारी हैं। जबकि वे नई तकनीकों के विकास के बारे में उत्साहित हैं, वे थोड़ी चिंता का माहौल भी महसूस कर सकते हैं। आखिरकार, DeepSeekers के उभरने का वास्तविक प्रभाव हो सकता है।