भविष्य में, अधिक से अधिक कट्टर नवाचार होंगे। इसे समझना अभी आसान नहीं हो सकता है, क्योंकि पूरे सामाजिक समूह को तथ्यों से शिक्षित करने की आवश्यकता है। जब यह समाज कट्टर नवाचार करने वाले लोगों को सफल होने देगा, तो सामूहिक मानसिकता बदल जाएगी। हमें बस तथ्यों और एक प्रक्रिया की आवश्यकता है। - लिआंग वेनफेंग, DeepSeek के संस्थापक

हाल के दिनों में, DeepSeek ने पूरी दुनिया में धूम मचा दी है, लेकिन क्योंकि कंपनी बहुत कम चर्चित है और उसने कोई घोषणा नहीं की है, इसलिए जनता को इस महान संभावनाओं वाली प्रौद्योगिकी कंपनी के बारे में बहुत कम जानकारी है - चाहे वह इसकी स्थापना की पृष्ठभूमि हो, व्यवसाय का दायरा हो, या उत्पाद लेआउट हो।

सभी सामग्रियों को छांटने के बाद, मैंने यह लेख लिखा

वर्तमान एआई खिलाड़ियों की पृष्ठभूमि क्या है, वे क्या कर रहे हैं, और वे किसे भर्ती कर रहे हैं?

और संभवतः DeepSeek का सबसे पूर्ण ऐतिहासिक अवलोकन।

पिछले साल इसी समय, मैजिक क्यूब क्वांट का एक दोस्त मेरे पास आया और पूछा, "क्या आप चीन में एक बड़ा मॉडल बनाना चाहते हैं?" और मैंने दोपहर को बस कॉफी पीते हुए बिताया। जैसा कि अपेक्षित था, जीवन अभी भी विकल्पों पर निर्भर करता है।

The यहां उल्लिखित मैजिक क्यूब क्वांट निवेशक हैDeepSeek की मूल कंपनी, या मूल कंपनी।

तथाकथित "क्वांट" एक निवेश संस्था है जो मानव शक्ति से नहीं बल्कि एल्गोरिदम द्वारा निर्णय लेती है। क्वांट फैंटेसी की स्थापना बहुत लंबी नहीं है, 2015 में शुरू हुई। 2021 तक, जब यह छह साल का था, क्वांट फैंटेसी का एसेट मैनेजमेंट स्केल 100 बिलियन से अधिक हो गया था, और इसे चीन के "चार महान क्वांट किंग्स" में से एक के रूप में प्रतिष्ठित किया गया था।

फैंटेसी स्क्वायर के संस्थापक लियांग वेनफ़ेंग, जो DeepSeek के भी संस्थापक हैं, 1980 के दशक में जन्मे एक "गैर-मुख्यधारा" वित्तीय नेता हैं: उनके पास विदेश में अध्ययन का कोई अनुभव नहीं है, वे ओलंपिक प्रतियोगिता के विजेता नहीं हैं, और उन्होंने झेजियांग विश्वविद्यालय में इलेक्ट्रॉनिक इंजीनियरिंग विभाग से स्नातक की उपाधि प्राप्त की है, जिसमें कृत्रिम बुद्धिमत्ता की प्रमुखता है। वे एक देशी प्रौद्योगिकी विशेषज्ञ हैं जो हर दिन "कागज़ात पढ़ते हैं, कोड लिखते हैं और समूह चर्चाओं में भाग लेते हैं" और शांत तरीके से काम करते हैं।

लिआंग वेनफ़ेंग में पारंपरिक व्यवसायी की आदतें नहीं हैं, बल्कि वह एक शुद्ध "टेक गीक" की तरह हैकई उद्योग के अंदरूनी सूत्रों और DeepSeek शोधकर्ताओं ने लियांग वेनफ़ेंग की बहुत प्रशंसा की है: "ऐसा व्यक्ति जिसके पास मजबूत इंफ्रा इंजीनियरिंग क्षमताएं और मॉडल अनुसंधान क्षमताएं हैं, और जो संसाधनों को भी जुटा सकता है," "कोई ऐसा व्यक्ति जो उच्च स्तर से सटीक निर्णय ले सकता है, लेकिन फ्रंटलाइन शोधकर्ताओं की तुलना में विवरणों में भी उत्कृष्टता प्राप्त करता है," और साथ ही उसके पास "एक भयानक सीखने की क्षमता है।"

DeepSeek की स्थापना से बहुत पहले ही, हुआनफैंग ने AI उद्योग में दीर्घकालिक योजनाएँ बनाना शुरू कर दिया थामई 2023 में, लिआंग वेनफ़ेंग ने डार्कसर्ज के साथ एक साक्षात्कार में उल्लेख किया: "ओपनएआई द्वारा 2020 में जीपीटी 3 जारी करने के बाद, एआई विकास की दिशा बहुत स्पष्ट हो गई है, और कंप्यूटिंग शक्ति एक प्रमुख तत्व बन जाएगी; लेकिन 2021 में भी, जब हमने फायरफ्लाई 2 के निर्माण में निवेश किया, तब भी अधिकांश लोग इसे समझ नहीं पाए।"

इस निर्णय के आधार पर, हुआनफैंग ने अपना खुद का कंप्यूटिंग इंफ्रास्ट्रक्चर बनाना शुरू किया। "शुरुआती 1 कार्ड से लेकर 2015 में 100 कार्ड, 2019 में 1,000 कार्ड और फिर 10,000 कार्ड तक, यह प्रक्रिया धीरे-धीरे हुई। कुछ सौ कार्ड से पहले, हम एक IDC में होस्ट किए गए थे। जब पैमाना बड़ा हो गया, तो होस्टिंग अब आवश्यकताओं को पूरा नहीं कर सकती थी, इसलिए हमने अपना खुद का कंप्यूटर रूम बनाना शुरू कर दिया।"

बाद में फाइनेंस इलेवन ने रिपोर्ट दी, "पांच से अधिक नहीं हैं 10,000 से अधिक GPU वाली घरेलू कंपनियाँ, और कुछ प्रमुख निर्माताओं के अलावा, उनमें मैजिक क्यूब नामक एक मात्रात्मक निधि कंपनी भी शामिल हैआमतौर पर यह माना जाता है कि 10,000 एनवीडिया ए100 चिप्स बड़े मॉडलों को प्रशिक्षित करने के लिए कंप्यूटिंग शक्ति की सीमा है।

पिछले साक्षात्कार में, लियांग वेनफ़ेंग ने भी एक दिलचस्प बात का उल्लेख किया था: कई लोग सोचेंगे कि इसके पीछे कोई अज्ञात व्यावसायिक तर्क है, लेकिन वास्तव में, यह मुख्य रूप से जिज्ञासा से प्रेरित है।

1टीपी8टीकी पहली मुलाकात

मई 2023 में डार्कसर्ज के साथ एक साक्षात्कार में जब पूछा गया "कुछ समय पहले ही हुआनफैंग ने बड़े मॉडल बनाने के अपने निर्णय की घोषणा की थी, एक मात्रात्मक फंड ऐसा क्यों करेगा?"

लिआंग वेनफ़ेंग का जवाब ज़ोरदार था: “एक बड़ा मॉडल बनाने के हमारे निर्णय का परिमाणीकरण या वित्त से कोई लेना-देना नहीं है। हमने ऐसा करने के लिए DeepSeek नाम से एक नई कंपनी बनाई है। मियांफैंग की टीम के कई प्रमुख सदस्य आर्टिफिशियल इंटेलिजेंस से जुड़े हैं। उस समय, हमने कई परिदृश्यों की कोशिश की और अंत में वित्त पर बस गए, जो काफी जटिल है। सामान्य आर्टिफिशियल इंटेलिजेंस हासिल करना अगली सबसे कठिन चीजों में से एक हो सकता है, इसलिए हमारे लिए, यह सवाल है कि इसे कैसे किया जाए, न कि क्यों।

वाणिज्यिक हितों या बाजार के रुझान का पीछा करने से प्रेरित नहीं, बल्कि केवल एजीआई प्रौद्योगिकी का पता लगाने की इच्छा और "सबसे महत्वपूर्ण और कठिन चीज" की लगातार खोज से प्रेरित है, मई 2023 में “DeepSeek” नाम की आधिकारिक पुष्टि की गई. 17 जुलाई, 2023 को, "हांग्जो DeepSeek आर्टिफिशियल इंटेलिजेंस बेसिक टेक्नोलॉजी रिसर्च कं, लिमिटेड" को शामिल किया गया।

पर 2 नवंबर, 2023, DeepSeek ने अपना पहला उत्तर दिया: DeepSeek कोडर, ओपन सोर्स कोड का एक बड़ा मॉडलइस मॉडल में 1B, 7B और 33B जैसे कई आकार शामिल हैं। ओपन सोर्स सामग्री में बेस मॉडल और कमांड ट्यूनिंग मॉडल शामिल हैं।

उस समय, ओपन सोर्स मॉडलों में, मेटा का कोडलामा उद्योग का बेंचमार्क था। हालाँकि, DeepSeek कोडर के रिलीज़ होने के बाद, इसने कोडलामा की तुलना में एक बहुआयामी अग्रणी स्थिति प्रदर्शित की: कोड जनरेशन में, ह्यूमनइवल 9.3% आगे था, MBPP 10.8% आगे था, और DS-1000 5.9% आगे था।

ध्यान रखें कि DeepSeek Coder एक 7B मॉडल है, जबकि CodeLlama एक 34B मॉडल है। इसके अलावा, DeepSeek Coder मॉडल, निर्देशों के साथ ट्यून किए जाने के बाद, GPT3.5-Turbo से व्यापक रूप से आगे निकल गया है।

न केवल कोड जनरेशन प्रभावशाली है, बल्कि DeepSeek कोडर गणित और तर्क में भी अपनी क्षमता का प्रदर्शन करता है।

तीन दिन बाद, 5 नवंबर, 2023 को, DeepSeek ने अपने WeChat सार्वजनिक खाते के माध्यम से बड़ी मात्रा में भर्ती सामग्री जारी की, जिसमें AGI बड़े मॉडल इंटर्न, डेटा विशेषज्ञ, डेटा आर्किटेक्चर प्रतिभा, वरिष्ठ डेटा संग्रह इंजीनियर, गहन शिक्षण अनुसंधान और विकास इंजीनियर आदि जैसे पद शामिल थे, और टीम का सक्रिय रूप से विस्तार करना शुरू कर दिया।

जैसा कि लिआंग वेनफ़ेंग ने कहा, प्रतिभा भर्ती के लिए DeepSeek की “आवश्यकताएँ” हैं “जुनून और ठोस बुनियादी कौशल”, और उन्होंने इस बात पर जोर दिया कि "नवाचार के लिए यथासंभव कम हस्तक्षेप और प्रबंधन की आवश्यकता होती है, ताकि हर किसी को गलतियाँ करने और नई चीज़ें आज़माने की स्वतंत्रता हो। नवाचार अक्सर भीतर से आता है, जानबूझकर की गई व्यवस्था से नहीं, और यह निश्चित रूप से शिक्षण से नहीं आता है।"

मॉडल अक्सर जारी किए जाते हैं, और ओपन सोर्स का अभ्यास किया जाता है

DeepSeek कोडर के धूम मचा देने के बाद, DeepSeek ने अपना ध्यान मुख्य युद्धक्षेत्र की ओर लगाया: सामान्य भाषा मॉडल।

पर 29 नवंबर, 2023 को DeepSeek ने अपना पहला सामान्य प्रयोजन वाला बड़ा भाषा मॉडल, DeepSeek LLM 67B जारी किया। इस मॉडल को मेटा के LLaMA2 70B मॉडल के समान स्तर पर बेंचमार्क किया गया है और इसने चीनी और अंग्रेजी में लगभग 20 सार्वजनिक मूल्यांकन सूचियों में बेहतर प्रदर्शन किया है। विशेष रूप से, इसकी तर्क, गणित और प्रोग्रामिंग क्षमताएं (जैसे, ह्यूमनइवल, MATH, CEval और CMMLU) उत्कृष्ट हैं।

DeepSeek LLM 67B ने भी ओपन सोर्स मार्ग चुना है और व्यावसायिक उपयोग का समर्थन करता है। ओपन सोर्स के प्रति अपनी ईमानदारी और दृढ़ संकल्प को और अधिक प्रदर्शित करने के लिए, DeepSeek ने अभूतपूर्व रूप से, अलग-अलग पैमाने के दो मॉडल, 7B और 67B को एक साथ ओपन सोर्स किया है, और यहां तक कि मॉडल प्रशिक्षण प्रक्रिया के दौरान उत्पन्न नौ चेकपॉइंट्स को शोधकर्ताओं के लिए डाउनलोड और उपयोग करने के लिए सार्वजनिक किया है। इस तरह का ऑपरेशन, जो "सब कुछ सिखाने" के समान है, पूरे ओपन सोर्स समुदाय में अत्यंत दुर्लभ है।

DeepSeek LLM 67B की वास्तविक क्षमताओं का अधिक व्यापक और वस्तुनिष्ठ मूल्यांकन करने के लिए, DeepSeek शोध दल ने "तनाव परीक्षण" के लिए "नए प्रश्नों" की एक श्रृंखला को भी सावधानीपूर्वक डिज़ाइन किया। ये प्रश्न उच्च-स्तरीय, उच्च-भेदभाव वाले परीक्षणों जैसे कि हंगेरियन हाई स्कूल गणित परीक्षा प्रश्न, Google कमांड फ़ॉलोइंग मूल्यांकन सेट और LeetCode साप्ताहिक प्रतियोगिता प्रश्नों को कवर करते हैं। परीक्षण के परिणाम उत्साहजनक थे। DeepSeek LLM 67B ने नमूने से परे सामान्यीकरण करने की अपनी क्षमता के संदर्भ में अद्भुत क्षमता दिखाई, और इसका समग्र प्रदर्शन तत्कालीन सबसे उन्नत GPT-4 मॉडल के करीब भी था।

पर 18 दिसंबर, 2023, DeepSeek ने विन्सेंट 3D मॉडल ड्रीमक्राफ्ट3D का ओपन सोर्स लॉन्च किया: यह एक वाक्य से उच्च-गुणवत्ता वाले 3D मॉडल उत्पन्न कर सकता है, AIGC में 2D प्लेन से 3D स्पेस तक छलांग लगा सकता है। उदाहरण के लिए, यदि उपयोगकर्ता इनपुट करता है: "जंगल में भागते हुए, सुअर के सिर और बंदर राजा के शरीर की एक मज़ेदार संकर छवि," DreamCraft3D उच्च-गुणवत्ता वाली सामग्री आउटपुट कर सकता है:

सिद्धांत रूप में, मॉडल सबसे पहले वेन आरेख को पूरा करता है, और फिर 2D अवधारणा मानचित्र के आधार पर समग्र ज्यामितीय संरचना को पूरक बनाता है:

इसके बाद किए गए व्यक्तिपरक मूल्यांकन में, 90% से अधिक उपयोगकर्ताओं ने कहा कि ड्रीमक्राफ्ट3डी में पिछली पीढ़ी के तरीकों की तुलना में पीढ़ी की गुणवत्ता में लाभ था।

7 जनवरी, 2024 को DeepSeek ने DeepSeek LLM 67B तकनीकी रिपोर्ट जारी की। इस 40+ पृष्ठ की रिपोर्ट में DeepSeek LLM 67B के कई विवरण शामिल हैं, जिनमें स्व-निर्मित स्केलिंग कानून, मॉडल संरेखण का पूर्ण व्यावहारिक विवरण और एक व्यापक AGI क्षमता मूल्यांकन प्रणाली शामिल है।

पर 11 जनवरी, 2024, DeepSeek ने चीन में पहला MoE (मिश्रित विशेषज्ञ वास्तुकला) बड़ा मॉडल ओपन-सोर्स किया, DeepSeekMoE: एक बिल्कुल नया आर्किटेक्चर जो चीनी और अंग्रेजी का समर्थन करता है और वाणिज्यिक उपयोग के लिए निःशुल्क है। उस समय MoE आर्किटेक्चर को आम तौर पर OpenAI GPT-4 के प्रदर्शन में सफलता की कुंजी माना जाता था। DeepSeek का स्व-विकसित MoE आर्किटेक्चर 2B, 16B और 145B जैसे कई पैमानों पर अग्रणी है, और इसकी कम्प्यूटेशनल क्षमता भी बहुत सराहनीय है।

25 जनवरी, 2024 को DeepSeek ने DeepSeek कोडर तकनीकी रिपोर्ट जारी की। यह रिपोर्ट इसके प्रशिक्षण डेटा, प्रशिक्षण विधियों और मॉडल प्रदर्शन का एक व्यापक तकनीकी विश्लेषण प्रदान करती है। इस रिपोर्ट में, हम देख सकते हैं कि पहली बार, इसने वेयरहाउस-स्तरीय कोड डेटा का निर्माण किया है और फ़ाइलों के बीच निर्भरता का विश्लेषण करने के लिए टोपोलॉजिकल सॉर्टिंग का उपयोग किया है, जिससे लंबी दूरी की क्रॉस-फ़ाइलों को समझने की क्षमता में काफी वृद्धि हुई है। प्रशिक्षण विधियों के संदर्भ में, फिल-इन-मिडिल विधि को जोड़ा गया, जिसने कोड पूरा करने की क्षमता में काफी सुधार किया।

30 जनवरी, 2024 को DeepSeek ओपन प्लेटफॉर्म आधिकारिक तौर पर लॉन्च किया गया और DeepSeek लार्ज मॉडल API सेवा का परीक्षण शुरू हुआ। 10 मिलियन टोकन मुफ्त में पाने के लिए रजिस्टर करें। इंटरफ़ेस OpenAI API इंटरफ़ेस के साथ संगत है, और चैट/कोडर दोनों दोहरे मॉडल उपलब्ध हैं। इस समय, DeepSeek ने प्रौद्योगिकी अनुसंधान और विकास के अलावा एक प्रौद्योगिकी सेवा प्रदाता के मार्ग का पता लगाना शुरू किया।

पर 5 फरवरी, 2024 को DeepSeek ने एक और वर्टिकल डोमेन मॉडल, DeepSeekMath जारी किया, एक गणितीय तर्क मॉडल। इस मॉडल में केवल 7B पैरामीटर हैं, लेकिन इसकी गणितीय तर्क क्षमता GPT-4 के करीब है। आधिकारिक MATH बेंचमार्क सूची में, यह भीड़ से आगे निकल जाता है और 30B और 70B के बीच पैरामीटर आकार वाले कई ओपन सोर्स मॉडल से बेहतर प्रदर्शन करता है। DeepSeekMath की रिलीज़ पूरी तरह से DeepSeek की तकनीकी ताकत और वर्टिकल के अनुसंधान और विकास में इसके अग्रगामी लेआउट और मॉडल अनुसंधान और विकास में इसके अग्रगामी लेआउट को प्रदर्शित करती है।

पर 28 फरवरी, 2024 को DeepSeek ओपन सोर्स मॉडल का उपयोग करने के बारे में डेवलपर्स की चिंताओं को और कम करने के लिए, DeepSeek ने एक ओपन सोर्स पॉलिसी FAQ जारी किया, जो मॉडल ओपन सोर्स लाइसेंसिंग और वाणिज्यिक उपयोग प्रतिबंधों जैसे अक्सर पूछे जाने वाले प्रश्नों के विस्तृत उत्तर प्रदान करता है। DeepSeek अधिक पारदर्शी और खुले दृष्टिकोण के साथ ओपन सोर्स को अपनाता है:

पर 11 मार्च, 2024 को DeepSeek ने मल्टी-मॉडल बड़ा मॉडल DeepSeek-VL जारी कियायह मल्टी-मोडल एआई तकनीक पर DeepSeek का प्रारंभिक प्रयास है। मॉडल का आकार 7B और 1.3B है, और मॉडल और तकनीकी कागजात एक साथ ओपन सोर्स किए गए हैं।

पर 20 मार्च, 2024, हुआनफैंग AI और DeepSeek को एक बार फिर NVIDIA GTC 2024 सम्मेलन में भाग लेने के लिए आमंत्रित किया गया, और संस्थापक लियांग वेनफ़ेंग ने एक तकनीकी मुख्य भाषण दिया जिसका शीर्षक था "विविधता में सामंजस्य: बड़े भाषा मॉडल के मूल्यों को संरेखित करना और अलग करना"। "एकल-मूल्य वाले बड़े मॉडल और बहुलवादी समाज और संस्कृति के बीच संघर्ष," "बड़े मॉडल मूल्य संरेखण का वियोजन," और "वियुग्मित मूल्य संरेखण की बहुआयामी चुनौतियाँ" जैसे मुद्दों पर चर्चा की गई। इसने DeepSeek की तकनीकी अनुसंधान और विकास के अलावा AI विकास के लिए मानवतावादी देखभाल और सामाजिक जिम्मेदारी को प्रदर्शित किया।

मार्च 2024 में, DeepSeek एपीआई आधिकारिक तौर पर भुगतान सेवाओं का शुभारंभ किया गया, जिसने चीनी बड़े मॉडल बाजार में मूल्य युद्ध की प्रस्तावना को पूरी तरह से प्रज्वलित कर दिया: 1 युआन प्रति मिलियन इनपुट टोकन और 2 युआन प्रति मिलियन आउटपुट टोकन।

2024 में, DeepSeek ने चीन में बड़े मॉडलों की रिकॉर्डिंग सफलतापूर्वक पारित कर दी, जिससे इसकी API सेवाओं के पूर्ण उद्घाटन के लिए नीतिगत बाधाएं दूर हो गईं।

मई 2024 में, DeepSeek-V2, एक ओपन सोर्स जनरल MoE बड़ा मॉडल जारी किया गया, और मूल्य युद्ध आधिकारिक तौर पर शुरू हुआ। DeepSeek-V2 MLA (मल्टी-हेड लेटेंट अटेंशन मैकेनिज्म) का उपयोग करता है, जो मॉडल के मेमोरी फ़ुटप्रिंट को पारंपरिक MHA के 5%-13% तक कम कर देता है। साथ ही, इसने स्वतंत्र रूप से DeepSeek MoE स्पार्स स्पार्स संरचना भी विकसित की है, जो मॉडल की कम्प्यूटेशनल जटिलता को बहुत कम करती है। इसके लिए धन्यवाद, मॉडल "1 युआन/मिलियन इनपुट और 2 युआन/मिलियन आउटपुट" का API मूल्य बनाए रखता है।

DeepSeek का बहुत बड़ा प्रभाव पड़ा है। इस संबंध में, सेमीएनालिसिस के प्रमुख विश्लेषक का मानना है कि DeepSeek V2 पेपर "इस साल के सर्वश्रेष्ठ में से एक हो सकता है।" इसी तरह, ओपनएआई के पूर्व कर्मचारी एंड्रयू कैर का मानना है कि यह पेपर "अद्भुत ज्ञान से भरा हुआ है" और उन्होंने इसकी प्रशिक्षण सेटिंग्स को अपने मॉडल पर लागू किया है।

यह ध्यान दिया जाना चाहिए कि यह एक मॉडल है जो GPT-4-Turbo को बेंचमार्क करता है, और API मूल्य बाद वाले का केवल 1/70 है

जून को 17, 2024, DeepSeek ने एक बार फिर बड़ा कदम उठाते हुए DeepSeek कोडर V2 कोड मॉडल जारी किया ओपन सोर्स और दावा किया कि इसकी कोड क्षमताएं उस समय के सबसे उन्नत क्लोज्ड-सोर्स मॉडल GPT-4-Turbo से आगे निकल गईं। DeepSeek Coder V2 DeepSeek की लगातार ओपन सोर्स रणनीति को जारी रखता है, जिसमें सभी मॉडल, कोड और पेपर ओपन सोर्स हैं, और दो संस्करण, 236B और 16B प्रदान किए जाते हैं। DeepSeek Coder V2 की API सेवाएँ ऑनलाइन भी उपलब्ध हैं, और कीमत "1 युआन/मिलियन इनपुट और 2 युआन/मिलियन आउटपुट" पर बनी हुई है।

पर 21 जून 2024, DeepSeek कोडर ने ऑनलाइन कोड निष्पादन का समर्थन किया। उसी दिन, क्लाउड 3.5 सॉनेट को नए आर्टिफैक्ट्स फीचर के साथ रिलीज़ किया गया, जो स्वचालित रूप से कोड जेनरेट करता है और इसे सीधे ब्राउज़र में चलाता है। उसी दिन, DeepSeek वेबसाइट पर कोड असिस्टेंट ने भी यही फीचर लॉन्च किया: कोड जेनरेट करें और एक क्लिक से इसे चलाएं।

आइये इस अवधि की प्रमुख घटनाओं की समीक्षा करें:

निरंतर सफलताएं, वैश्विक ध्यान आकर्षित करना

मई 2024 में, DeepSeek रातों-रात मशहूर हो गया, जब उसने MoE पर आधारित एक ओपन सोर्स मॉडल DeepSeek V2 जारी किया। यह GPT-4-Turbo के प्रदर्शन से मेल खाता था, लेकिन केवल 1 युआन/मिलियन इनपुट की कीमत पर, जो GPT-4-Turbo का 1/70 था। उस समय, DeepSeek उद्योग में एक प्रसिद्ध "मूल्य कसाई" बन गया, और फिर ज़ीचेंग, बाइटडांस और अलीबाबा जैसे मुख्यधारा के खिलाड़ियों ने जल्दी से इसका अनुसरण किया और अपनी कीमतें कम कर दीं। यह उस समय के आसपास भी था जब GPT प्रतिबंध का एक और दौर था, और बड़ी संख्या में AI अनुप्रयोगों ने पहली बार घरेलू मॉडल आज़माना शुरू किया।

जुलाई 2024 में, DeepSeek के संस्थापक लियांग वेनफ़ेंग ने एक बार फिर डार्क सर्ज के साथ एक साक्षात्कार स्वीकार किया और मूल्य युद्ध पर सीधे जवाब दिया: "बहुत अप्रत्याशित। मुझे उम्मीद नहीं थी कि कीमत हर किसी को इतना संवेदनशील बना देगी। हम बस अपनी गति से काम करते हैं और फिर लागत के आधार पर कीमत तय करते हैं। हमारा सिद्धांत पैसा खोना या अत्यधिक लाभ कमाना नहीं है। यह कीमत भी थोड़े लाभ के साथ लागत से थोड़ी अधिक है।"

यह देखा जा सकता है कि, कई प्रतिस्पर्धियों के विपरीत, जो सब्सिडी के लिए अपनी जेब से भुगतान करते हैं, DeepSeek इस कीमत पर लाभदायक है।

कुछ लोग कह सकते हैं: मूल्य में कटौती उपयोगकर्ताओं को लूटने जैसा है, और इंटरनेट युग में मूल्य युद्धों में आमतौर पर यही होता है

जवाब में, लियांग वेनफ़ेंग ने भी जवाब दिया: "उपयोगकर्ताओं को लूटना हमारा मुख्य लक्ष्य नहीं है। हमने कीमत कम की है क्योंकि एक तरफ, अगली पीढ़ी के मॉडल की संरचना का पता लगाने के कारण लागत कम हो गई है, और दूसरी तरफ, हमें लगता है कि एपीआई और एआई दोनों ही सभी के लिए सस्ती और सुलभ होनी चाहिए।"

तो कहानी लिआंग वेनफ़ेंग के आदर्शवाद के साथ जारी रहती है।

4 जुलाई, 2024 को DeepSeek API ऑनलाइन हो गया। 128K संदर्भ के लिए कीमत अपरिवर्तित रही। किसी मॉडल की अनुमान लागत संदर्भ की लंबाई से बहुत करीब से संबंधित होती है। इसलिए, कई मॉडलों में इस लंबाई पर सख्त प्रतिबंध होते हैं: GPT-3.5 के शुरुआती संस्करण में केवल 4k संदर्भ होता है।

इस समय, DeepSeek ने संदर्भ की लंबाई को पिछले 32k से बढ़ाकर 128k कर दिया, जबकि कीमत को अपरिवर्तित रखा (प्रति मिलियन इनपुट टोकन 1 युआन और प्रति मिलियन आउटपुट टोकन 2 युआन)।

पर 10 जुलाई 2024 को दुनिया के पहले एआई ओलंपियाड (एआईएमओ) के परिणाम घोषित किए गए, और DeepSeekMath मॉडल शीर्ष टीमों की आम पसंद बन गयाविजेता शीर्ष 4 टीमों ने अपने प्रवेश मॉडल के आधार के रूप में DeepSeekMath-7B को चुना और प्रतियोगिता में प्रभावशाली परिणाम हासिल किए।

पर 18 जुलाई 2024, DeepSeek-V2 चैटबॉट एरिना पर ओपन सोर्स मॉडल की सूची में शीर्ष पर रहा, लामा3-70बी, क्वेन2-72बी, नेमोट्रॉन-4-340बी, और जेम्मा2-27बी जैसे स्टार मॉडलों को पीछे छोड़ते हुए, तथा ओपन सोर्स बड़े मॉडलों के लिए एक नया बेंचमार्क बनते हुए।

में जुलाई 2024, DeepSeek ने प्रतिभाओं की भर्ती जारी रखी और भविष्य के तकनीकी नवाचार और उत्पाद विकास के लिए तैयार करने हेतु एआई एल्गोरिदम, एआई इन्फ्रा, एआई ट्यूटर और एआई उत्पादों सहित कई क्षेत्रों में दुनिया भर से शीर्ष प्रतिभाओं की भर्ती की।

पर 26 जुलाई, 2024 को, DeepSeek API ने एक महत्वपूर्ण अपग्रेड की शुरुआत की, जो ओवरराइटिंग, FIM (फिल-इन-द-मिडिल) पूर्णता, फ़ंक्शन कॉलिंग और JSON आउटपुट जैसी उन्नत सुविधाओं की एक श्रृंखला का पूरी तरह से समर्थन करता है। FIM फ़ंक्शन बहुत दिलचस्प है: उपयोगकर्ता शुरुआत और अंत देता है, और बड़ा मॉडल बीच में भरता है, जो सटीक फ़ंक्शन कोड भरने के लिए प्रोग्रामिंग प्रक्रिया के लिए बहुत उपयुक्त है। उदाहरण के तौर पर फिबोनाची अनुक्रम लिखना लें:

पर 2 अगस्त, 2024, DeepSeek ने अभिनव रूप से हार्ड डिस्क कैशिंग तकनीक पेश की, जिससे API की कीमतें बहुत कम हो गईं। पहले, API की कीमत प्रति मिलियन टोकन केवल ¥1 थी। हालाँकि, अब, कैश हिट होने के बाद, API शुल्क सीधे ¥0.1 हो जाता है।

यह सुविधा तब बहुत उपयोगी होती है जब निरंतर वार्तालाप और बैच प्रोसेसिंग कार्य शामिल हों।

पर 16 अगस्त, 2024 को DeepSeek ने अपना गणितीय प्रमेय सिद्ध करने वाला मॉडल DeepSeek-Prover-V1.5 जारी किया ओपन सोर्स के रूप में, जिसने हाई स्कूल और कॉलेज के गणितीय प्रमेय सिद्ध करने वाले परीक्षणों में कई प्रसिद्ध ओपन सोर्स मॉडलों को पीछे छोड़ दिया।

पर 6 सितंबर, 2024 को DeepSeek ने DeepSeek-V2.5 फ्यूज़न मॉडल जारी किया। इससे पहले, DeepSeek मुख्य रूप से दो मॉडल प्रदान करता था: चैट मॉडल सामान्य वार्तालाप कौशल पर केंद्रित था, और कोड मॉडल कोड प्रसंस्करण कौशल पर केंद्रित था। इस बार, दो मॉडलों को एक में जोड़ दिया गया है, DeepSeek-V2.5 में अपग्रेड किया गया है, जो मानव वरीयताओं के साथ बेहतर ढंग से संरेखित करता है और लेखन कार्यों, कमांड का पालन करने और अन्य पहलुओं में भी महत्वपूर्ण सुधार हासिल किया है।

पर 18 सितंबर, 2024, DeepSeek-V2.5 एक बार फिर नवीनतम LMSYS सूची में शामिल हुआ, जो घरेलू मॉडलों में सबसे आगे रहा और कई व्यक्तिगत क्षमताओं में घरेलू मॉडलों के लिए नए सर्वोत्तम स्कोर स्थापित करना।

पर 20 नवंबर, 2024, DeepSeek ने DeepSeek-R1-लाइट जारी किया आधिकारिक वेबसाइट पर। यह o1-preview के बराबर एक अनुमान मॉडल है, और V3 के बाद के प्रशिक्षण के लिए पर्याप्त मात्रा में सिंथेटिक डेटा भी प्रदान करता है।

पर 10 दिसंबर 2024 को DeepSeek V2 श्रृंखला ने DeepSeek-V2.5-1210 के अंतिम परिष्कृत संस्करण के रिलीज के साथ अपने समापन की शुरुआत की। यह संस्करण प्रशिक्षण के बाद गणित, कोडिंग, लेखन और भूमिका निभाने सहित कई क्षमताओं में व्यापक सुधार करता है।

इस संस्करण के आगमन के साथ, DeepSeek वेब ऐप ने नेटवर्क खोज फ़ंक्शन भी खोल दिया।

पर 13 दिसंबर, 2024 को, DeepSeek ने मल्टीमॉडलिटी के क्षेत्र में एक और सफलता हासिल की और ओपन सोर्स मल्टीमॉडल बड़े मॉडल DeepSeek-VL2 को जारी किया। DeepSeek-VL2 MoE आर्किटेक्चर को अपनाता है, जो इसकी दृश्य क्षमताओं को काफी बेहतर बनाता है। यह तीन आकारों में उपलब्ध है: 3B, 16B, और 27B, और सभी मेट्रिक्स में इसका लाभ है।

पर 26 दिसंबर 2024 को DeepSeek-V3 को ओपन सोर्स के साथ जारी किया गया: अनुमानित प्रशिक्षण लागत केवल 5.5 मिलियन अमेरिकी डॉलर थी। DeepSeek-V3 ने विदेशों में अग्रणी बंद स्रोत मॉडलों के प्रदर्शन का पूर्णतः परीक्षण किया तथा उत्पादन गति में काफी सुधार किया।

एपीआई सेवाओं के मूल्य निर्धारण को समायोजित किया गया, लेकिन साथ ही, नए मॉडल के लिए 45-दिवसीय अधिमान्य परीक्षण अवधि निर्धारित की गई।

15 जनवरी, 2025 को आधिकारिक तौर पर DeepSeek ऐप जारी किया गया और प्रमुख iOS/Android ऐप बाज़ारों पर पूरी तरह से लॉन्च किया गया।

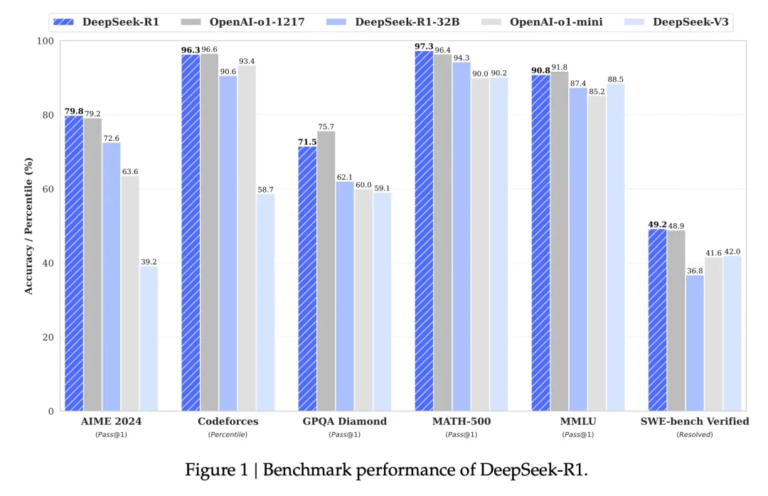

20 जनवरी, 2025 को, चीनी नववर्ष के करीब, DeepSeek-R1 अनुमान मॉडल आधिकारिक तौर पर जारी किया गया और ओपन-सोर्स किया गया। DeepSeek-R1 ने अपने प्रदर्शन को आधिकारिक OpenAI o1 रिलीज़ के साथ पूरी तरह से संरेखित किया और विचार श्रृंखला आउटपुट फ़ंक्शन को खोल दिया। उसी समय, DeepSeek ने यह भी घोषणा की कि मॉडल ओपन सोर्स लाइसेंस को MIT लाइसेंस में बदल दिया जाएगा, और उपयोगकर्ता समझौता स्पष्ट रूप से "मॉडल आसवन" की अनुमति देगा, जो ओपन सोर्स को और अधिक गले लगाएगा और प्रौद्योगिकी साझाकरण को बढ़ावा देगा।

बाद में यह मॉडल बहुत लोकप्रिय हुआ और एक नए युग की शुरुआत हुई

परिणामस्वरूप, 27 जनवरी, 2025 तक, DeepSeek ऐप ने सफलतापूर्वक ChatGPT को पीछे छोड़ दिया और यूएस iOS ऐप स्टोर पर मुफ्त ऐप डाउनलोड सूची में शीर्ष स्थान पर रहा, और एक अभूतपूर्व AI ऐप बन गया।

27 जनवरी 2025 को नए साल की पूर्व संध्या पर 1:00 बजे, DeepSeek Janus-Pro को ओपन सोर्स के रूप में जारी किया गया। यह एक मल्टीमॉडल मॉडल है जिसका नाम प्राचीन रोमन पौराणिक कथाओं में दो-चेहरे वाले देवता जेनस के नाम पर रखा गया है: यह अतीत और भविष्य दोनों का सामना करता है। यह मॉडल की दो क्षमताओं - दृश्य समझ और छवि निर्माण - और कई रैंकिंग पर इसके प्रभुत्व का भी प्रतिनिधित्व करता है।

DeepSeek की विस्फोटक लोकप्रियता ने तुरंत वैश्विक प्रौद्योगिकी शॉकवेव को ट्रिगर कर दिया, यहां तक कि NVIDIA के शेयर की कीमत में भी सीधे तौर पर भारी गिरावट आई, और वैश्विक प्रौद्योगिकी शेयर बाजार का बाजार मूल्य लगभग 1 ट्रिलियन अमेरिकी डॉलर तक कम हो गया। वॉल स्ट्रीट और प्रौद्योगिकी मीडिया ने कहा कि DeepSeek का उदय वैश्विक AI उद्योग परिदृश्य को प्रभावित कर रहा है और अमेरिकी प्रौद्योगिकी दिग्गजों के लिए अभूतपूर्व चुनौती पेश कर रहा है।

DeepSeek की सफलता ने चीन की AI तकनीकी नवाचार क्षमताओं के बारे में अंतर्राष्ट्रीय स्तर पर काफ़ी ध्यान आकर्षित किया है और इस पर काफ़ी चर्चाएँ हुई हैं। अमेरिकी राष्ट्रपति डोनाल्ड ट्रम्प ने एक दुर्लभ सार्वजनिक टिप्पणी में DeepSeek के उदय की प्रशंसा करते हुए इसे "सकारात्मक" बताया और कहा कि यह संयुक्त राज्य अमेरिका के लिए "चेतावनी" है। माइक्रोसॉफ्ट के सीईओ सत्य नडेला और ओपनएआई के सीईओ सैम ऑल्टमैन ने भी DeepSeek की प्रशंसा करते हुए इसकी तकनीक को "बहुत प्रभावशाली" बताया।

बेशक, हमें यह भी समझना चाहिए कि उनकी प्रशंसा आंशिक रूप से DeepSeek की ताकत की मान्यता है, और आंशिक रूप से उनके अपने उद्देश्यों का प्रतिबिंब है। उदाहरण के लिए, जबकि एंथ्रोपिक DeepSeek की उपलब्धियों को मान्यता देता है, यह अमेरिकी सरकार से चीन पर चिप नियंत्रण को मजबूत करने का भी आह्वान कर रहा है।

एंथ्रोपिक के सीईओ ने 10,000 शब्दों का लेख प्रकाशित किया: DeepSeek की वृद्धि का मतलब है कि व्हाइट हाउस को नियंत्रण बढ़ाना चाहिए

सारांश और दृष्टिकोण

DeepSeek के पिछले दो वर्षों पर नजर डालें तो यह वास्तव में एक "चीनी चमत्कार" रहा है: एक अज्ञात स्टार्टअप से लेकर "रहस्यमयी पूर्वी शक्ति" तक, जो अब वैश्विक AI मंच पर चमक रही है, DeepSeek ने अपनी ताकत और नवाचार के साथ एक के बाद एक "असंभव" लिखा है।

इस तकनीकी अभियान का गहरा अर्थ बहुत पहले ही व्यावसायिक प्रतिस्पर्धा के दायरे से बाहर निकल चुका है। DeepSeek ने तथ्यों के साथ घोषणा की है कि भविष्य से संबंधित कृत्रिम बुद्धिमत्ता के रणनीतिक क्षेत्र में, चीनी कंपनियां कोर प्रौद्योगिकी की ऊंचाइयों तक पहुंचने में पूरी तरह सक्षम हैं।

ट्रम्प द्वारा बजाई गई "अलार्म घंटी" और एंथ्रोपिक का छिपा हुआ डर चीन की एआई क्षमताओं के महत्व की पुष्टि करता है: न केवल यह लहरों पर सवार हो सकता है, बल्कि यह ज्वार की दिशा को भी बदल रहा है

डीपसीक उत्पाद मुक्त करना मील के पत्थर

- 2 नवंबर, 2023: DeepSeek कोडर बड़ा मॉडल

- 29 नवंबर, 2023: DeepSeek LLM 67B यूनिवर्सल मॉडल

- 18 दिसंबर, 2023: ड्रीमक्राफ्ट3डी 3डी मॉडल

- 11 जनवरी, 2024: DeepSeekMoE MoE बड़ा मॉडल

- 5 फरवरी, 2024: DeepSeekMath गणितीय तर्क मॉडल

- 11 मार्च, 2024: DeepSeek-VL मल्टीमॉडल बड़ा मॉडल

- मई 2024: DeepSeek-V2 MoE सामान्य मॉडल

- 17 जून, 2024: DeepSeek कोडर V2 कोड मॉडल

- 6 सितंबर, 2024: DeepSeek-V2.5 सामान्य और कोड योग्यता मॉडल का संयोजन

- 13 दिसंबर, 2024: DeepSeek-VL2 मल्टीमॉडल MoE मॉडल

- 26 दिसंबर, 2024: DeepSeek-V3 सामान्य प्रयोजन के बड़े मॉडलों की नई श्रृंखला

- 20 जनवरी, 2025: DeepSeek-R1 अनुमान मॉडल

- 20 जनवरी, 2025: DeepSeek आधिकारिक ऐप (iOS और Android)

- 27 जनवरी, 2025: DeepSeek जेनस-प्रो मल्टीमॉडल मॉडल