OpenAI telah mengeluarkan model inferens terbarunya, o3-mini, yang dioptimumkan untuk bidang seperti sains, matematik dan pengaturcaraan, memberikan respons yang lebih pantas, ketepatan yang lebih tinggi dan kos yang lebih rendah.

Berbanding dengan pendahulunya o1-mini, o3-mini telah meningkatkan dengan ketara keupayaan inferensnya, terutamanya dalam menyelesaikan masalah yang kompleks. Penguji lebih suka jawapan o3-mini sebanyak 56%, dan kadar ralat telah dikurangkan sebanyak 39%. Mulai hari ini, ChatGPT Plus, Pasukan dan Pro pengguna boleh menggunakan o3-mini, dan pengguna percuma juga boleh mengalami beberapa cirinya.

Berbanding dengan model inferens DeepSeek-R1, betapa lebih baiknya OpenAI o3-mini daripada R1?

Artikel ini mula-mula akan memberikan gambaran keseluruhan tentang sorotan o3-mini, dan kemudian kami akan mengekstrak data dari kedua-dua belah pada setiap penanda aras dan membuat graf untuk membandingkannya secara visual. Selain itu, kami juga akan membandingkan harga o3-mini.

Sorotan teras

1.pengoptimuman STEM: cemerlang dalam bidang matematik, pengaturcaraan, sains, dsb., terutamanya mengatasi o1-mini dalam mod usaha inferens tinggi.

2.Fungsi pembangun: menyokong fungsi seperti panggilan fungsi, output berstruktur dan mesej pembangun untuk memenuhi keperluan persekitaran pengeluaran.

3.Respon cepat: 24% lebih pantas daripada o1-mini, dengan masa tindak balas 7.7 saat bagi setiap permintaan.

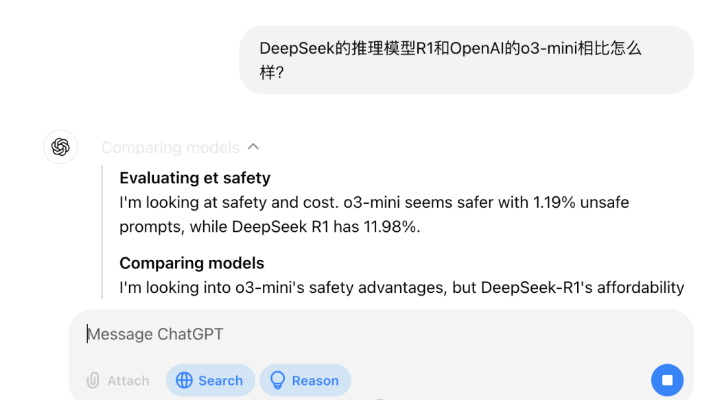

4.Peningkatan keselamatan: memastikan keluaran yang selamat dan boleh dipercayai melalui teknologi penjajaran dalam.

5.Kos efektif: keupayaan inferens dan pengoptimuman kos berjalan seiring, sekali gus mengurangkan ambang penggunaan AI.

Bandingkan

Buka AI Untuk menyerlahkan kelasnya, ia blog rasmi hanya membandingkannya dengan modelnya sendiri. Oleh itu, artikel ini adalah jadual yang diekstrak daripada kertas DeepSeek R1 dan data daripada blog rasmi OpenAI.

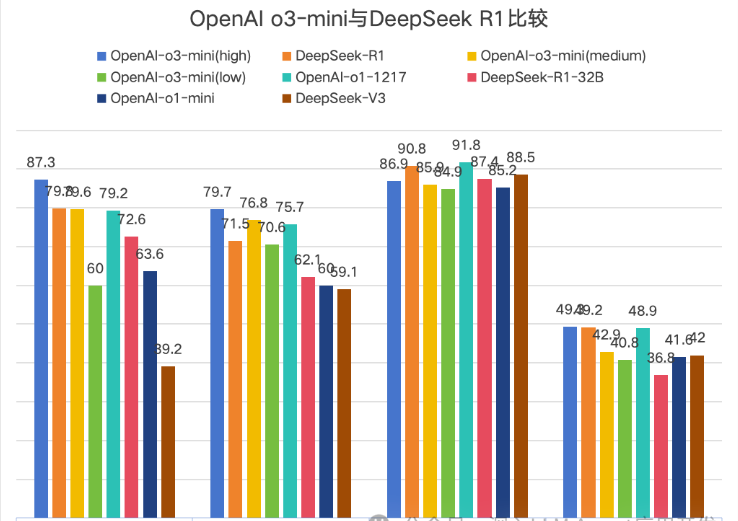

OpenAI secara rasmi membandingkan o3-mini dalam senarai versi, memecahkannya kepada tiga versi: rendah, sederhana dan tinggi, yang menunjukkan kekuatan inferens. Memandangkan DeepSeek menggunakan Math-500 dan OpenAI menggunakan dataset Matematik, perbandingan ini telah dialih keluar di sini.

Carta adalah lebih intuitif dan Codeforces telah dialih keluar kerana nilainya terlalu besar untuk dipaparkan secara intuitif. Walau bagaimanapun, perbandingan pada Codeforces menunjukkan bahawa kekuatan inferens tinggi o3-mini bukanlah petunjuk.

↑1AIME2024→2GPQA Diamond→3MMLU→4SWE-bench-Disahkan

Daripada carta, terdapat sejumlah 4 perbandingan, dan O3-mini (tinggi) biasanya mendahului, tetapi petunjuknya sangat kecil.

harga

| model | Harga input | Cache hit | Harga keluaran |

| o3-mini | $1.10 | $0.55 | $4.40 |

| o1 | $15.00 | $7.50 | $60.00 |

| Deepseek R1 | $0.55 | $0.14 | $2.19 |

Ringkasan

Dengan DeepSeek R1 yang mencetuskan Panik DeepSeek di Amerika Syarikat, yang pertama merasa terancam ialah OpenAI, yang amat ketara dalam penetapan harga model baharunya o3-mini.

Apabila Openai o1 pertama kali dikeluarkan, harganya yang tinggi memberi tekanan kepada banyak pembangun dan pengguna. Kemunculan DeepSeek R1 memberi semua orang lebih banyak pilihan.Daripada perbezaan harga 30 kali ganda antara o1 dan R1 hingga harga akhir o3-mini menjadi dua kali ganda harga DeepSeek R1,

menunjukkan kesan DeepSeek R1 terhadap openai.Walau bagaimanapun, pengguna percuma ChatGPT hanya boleh mengalami o3-mini dengan cara yang terhad, manakala Pemikiran Dalam DeepSeek kini tersedia untuk semua pengguna.Saya juga berharap untuk openai membawa lebih banyak model ai terkemuka di samping mengurangkan kos penggunaan untuk pengguna.

Dari perspektif pengalaman peribadi blogger menggunakan R1, saya ingin mengatakan bahawa Pemikiran Dalam R1 sentiasa membuka fikiran saya. Saya mengesyorkan agar semua orang menggunakannya lebih banyak untuk memikirkan masalah~