DeepSeek-R1-technologie onthuld: kernprincipes van het artikel worden afgebroken en de sleutel tot baanbrekende modelprestaties wordt onthuld

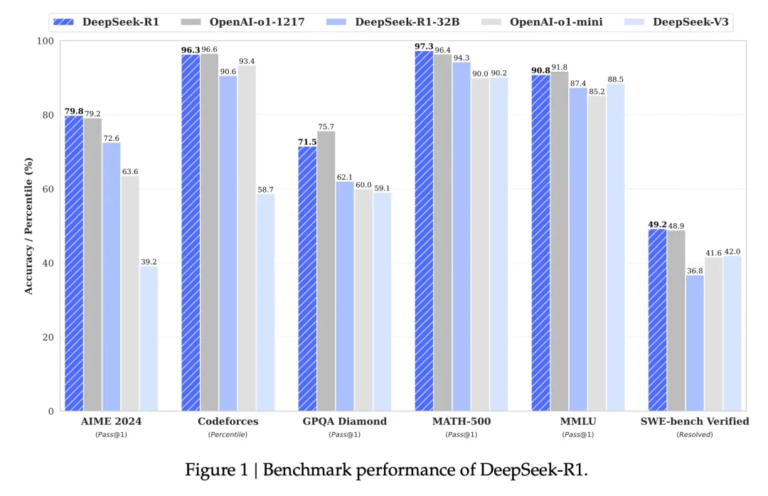

Vandaag delen we DeepSeek R1, Titel: DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning: Incentivizing the reasoning capability of LLM via reinforcement learning. Dit artikel introduceert de eerste generatie redeneermodellen van DeepSeek, DeepSeek-R1-Zero en DeepSeek-R1. Het DeepSeek-R1-Zero-model werd getraind via grootschalige reinforcement learning (RL) zonder supervised fine-tuning (SFT) als eerste stap,…