Niciunul dintre noi nu se aștepta ca 2025 să înceapă astfel în domeniul inteligenței artificiale.

DeepSeek R1 este cu adevărat uimitor!

Recent, "misterioasa putere estică" DeepSeek a "controlat dur" Silicon Valley.

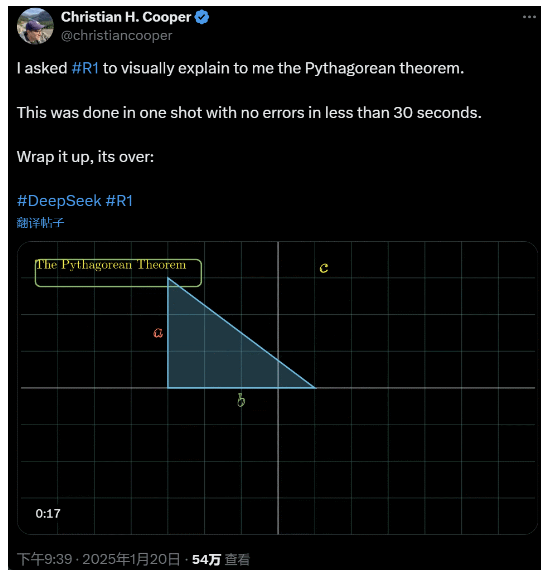

I-am cerut lui R1 să explice în detaliu teorema lui Pitagora. Toate acestea au fost făcute de AI în mai puțin de 30 de secunde, fără nicio greșeală. Pe scurt, s-a terminat.

În cercurile interne și externe de inteligență artificială, internauții obișnuiți au descoperit noua inteligență artificială uimitoare și puternică (care este, de asemenea, sursă deschisă), iar experții academici au strigat "trebuie să recuperăm decalajul". Există, de asemenea, zvonuri conform cărora companiile de IA din străinătate se confruntă deja cu o amenințare majoră.

Să luăm doar acest DeepSeek R1 lansat săptămâna aceasta. Calea sa de învățare prin întărire pură, fără nicio pregătire supravegheată, este șocantă. De la dezvoltarea bazei Deepseek-v3 în decembrie anul trecut până la capacitățile actuale ale lanțului de gândire comparabile cu OpenAI o1, pare să fie o chestiune de timp.

Dar, în timp ce comunitatea AI este ocupată cu citirea rapoartelor tehnice și compararea măsurătorilor reale, oamenii încă au îndoieli cu privire la R1: în afară de faptul că poate depăși o serie de criterii de referință, poate conduce cu adevărat?

Își poate construi propriile simulări ale "legilor fizice"?

Nu vă vine să credeți? Să lăsăm marele model să se joace cu un pinball?

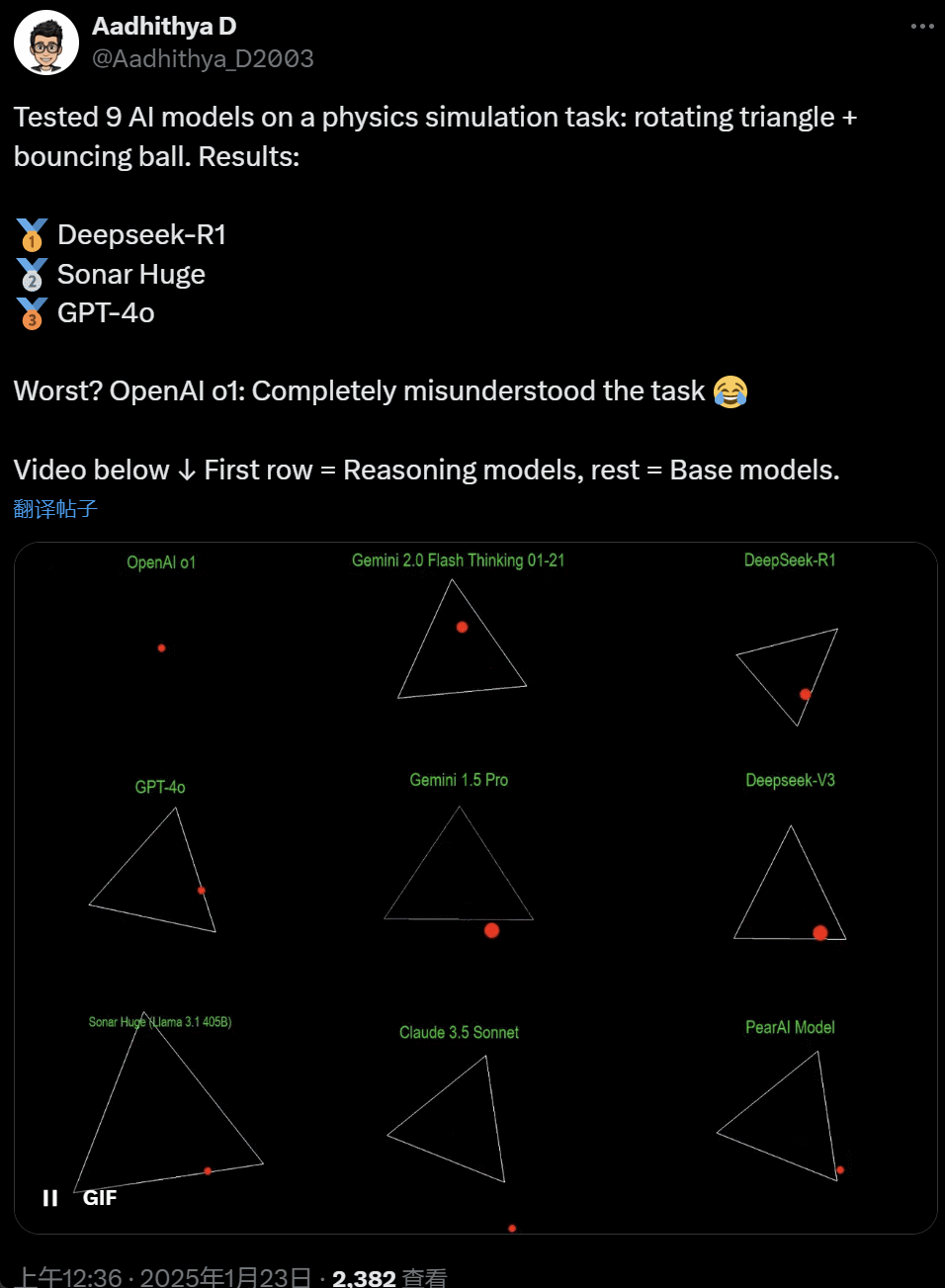

În ultimele zile, unii oameni din comunitatea AI au devenit obsedați de un test - testarea diferitelor modele mari de AI (în special așa-numitele modele de raționament) pentru a rezolva o problemă: "Scrieți un script Python pentru a face o minge galbenă să sară în interiorul unei anumite forme. Faceți forma să se rotească încet și asigurați-vă că mingea rămâne în interiorul formei."

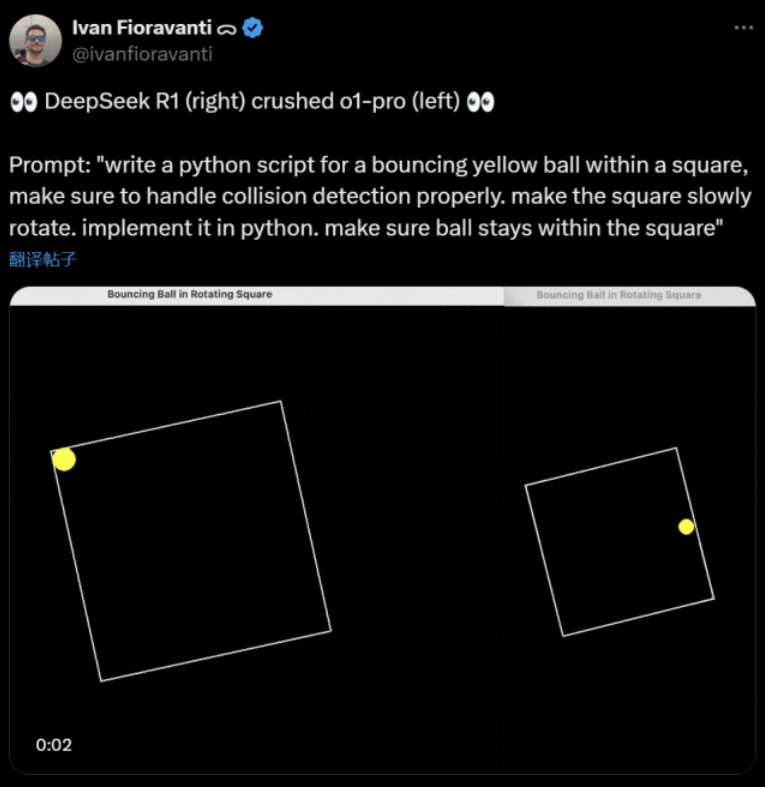

Unele modele le depășesc pe altele în acest benchmark "mingea rotativă". Potrivit lui Ivan Fioravanti, CTO al CoreView, DeepSeek, un laborator național de inteligență artificială, are un model R1 mare cu sursă deschisă care bate modelul o1 pro al OpenAI, care costă $200 pe lună ca parte a programului ChatGPT Pro al OpenAI.

În stânga este OpenAI o1, iar în dreapta este DeepSeek R1. După cum s-a menționat mai sus, solicitarea aici este: "scrieți un script python pentru o minge galbenă săltăreață într-un pătrat, asigurați-vă că gestionați corect detectarea coliziunii. faceți pătratul să se rotească încet. implementați-l în python. asigurați-vă că mingea rămâne în pătrat".

Potrivit unui alt utilizator de pe X, modelele Anthropic Claude 3.5 Sonnet și Google Gemini 1.5 Pro au făcut judecăți incorecte cu privire la principiile fizice, făcând ca mingea să devieze de la forma sa. Unii utilizatori au raportat, de asemenea, că cel mai recent model Gemini 2.0 Flash Thinking Experimental al Google, precum și modelul OpenAI GPT-4o, relativ mai vechi, au trecut evaluarea deodată.

Dar există o modalitate de a face diferența aici:

Netizens sub acest tweet a spus: capacitatea o1 a fost inițial foarte bună, dar a devenit mai slabă după ce OpenAI a optimizat viteza, chiar și cu versiunea de membru $200 / lună.

Simularea unei mingi care sare este o provocare clasică de programare. Simularea precisă combină algoritmi de detectare a coliziunilor, care trebuie să identifice momentul în care două obiecte (cum ar fi o minge și partea laterală a unei forme) se ciocnesc. Un algoritm scris necorespunzător poate afecta performanța simulării sau poate cauza erori fizice evidente.

N8 Programs, cercetător la AI startup Nous Research, a declarat că i-a luat aproximativ două ore să scrie de la zero o minge care sare într-un heptagon rotativ. "Trebuie urmărite mai multe sisteme de coordonate, este necesară o înțelegere a modului în care coliziunile sunt gestionate în fiecare sistem, iar codul trebuie proiectat de la zero pentru a fi robust".

Deși bilele care ricoșează și formele care se învârt sunt un test rezonabil al abilităților de programare, acestea sunt încă proiecte noi pentru modele mari și chiar și mici modificări ale indicațiilor pot produce rezultate diferite. Prin urmare, pentru a deveni în cele din urmă parte a testului de referință pentru modelele mari de inteligență artificială, acesta trebuie să fie îmbunătățit.

În orice caz, după acest val de teste practice, avem o idee despre diferențele de capacități dintre modelele mari.

DeepSeek este noul "mit din Silicon Valley

DeepSeek provoacă panică" în Pacific.

Angajații Meta au postat că "inginerii Meta analizează frenetic DeepSeek pentru a încerca să copieze tot ce pot de la el."

Alexandr Wang, fondatorul startup-ului de tehnologie AI Scale AI, a declarat, de asemenea, public că performanța modelului mare AI al DeepSeek este aproximativ echivalentă cu cel mai bun model din Statele Unite.

El crede, de asemenea, că este posibil ca Statele Unite să fi fost înaintea Chinei în competiția IA din ultimul deceniu, dar lansarea de către DeepSeek a modelului său mare de IA poate "schimba totul".

X Blogger @8teAPi crede că DeepSeek nu este un "proiect secundar", ci este ca fostul "Skunk Works" al Lockheed Martin.

Așa-numitul "Skunk Works" se referă la o mică echipă extrem de confidențială și relativ independentă pe care Lockheed Martin a înființat-o inițial pentru a dezvolta numeroase aeronave avansate, angajată în cercetarea și dezvoltarea tehnologiilor de vârf sau neconvenționale. De la avionul de recunoaștere U-2 și SR-71 Blackbird la F-22 Raptor și avionul de vânătoare F-35 Lightning II, toate au venit de aici.

Ulterior, termenul a evoluat treptat într-un termen generic utilizat pentru a descrie echipele de inovare "mici, dar bune", relativ independente și mai flexibile, înființate în cadrul întreprinderilor sau organizațiilor mari.

El a dat două motive:

- Pe de o parte, DeepSeek are un număr mare de GPU-uri, se pare că peste 10.000, iar Alexandr Wang, CEO al Scale AI, a spus chiar că ar putea ajunge la 50.000.

- Pe de altă parte, DeepSeek recrutează talente doar din primele trei universități din China, ceea ce înseamnă că DeepSeek este la fel de competitivă ca Alibaba și Tencent.

Doar aceste două fapte arată că DeepSeek a obținut în mod clar succes comercial și este suficient de cunoscut pentru a obține aceste resurse.

În ceea ce privește costurile de dezvoltare ale DeepSeek, bloggerul a declarat că societățile chineze de tehnologie pot primi o serie de subvenții, cum ar fi costuri reduse de energie electrică și utilizarea terenurilor.

Prin urmare, este foarte probabil ca majoritatea costurilor DeepSeek să fi fost "plasate" într-un cont în afara activității de bază sau sub forma unui fel de subvenție pentru construirea unui centru de date.

Chiar și în afara fondatorilor, nimeni nu înțelege pe deplin toate acordurile financiare. Unele acorduri pot fi pur și simplu "acorduri verbale" care sunt finalizate doar pe baza reputației.

În orice caz, câteva lucruri sunt clare:

- Modelul este excelent, comparabil cu versiunea lansată de OpenAI acum două luni și, desigur, este posibil să nu fie la fel de bun ca noile modele pe care OpenAI și Anthropic nu le-au lansat încă.

- Din perspectiva actuală, direcția de cercetare este încă dominată de companiile americane. Modelul DeepSeek este o "continuare rapidă" a versiunii o1, dar progresul în cercetare și dezvoltare al DeepSeek este foarte rapid, ajungând din urmă mai repede decât era de așteptat. Ei nu plagiază sau trișează, cel mult fac inginerie inversă.

- DeepSeek își pregătește în principal propriile talente, mai degrabă decât să se bazeze pe doctorii pregătiți de americani, ceea ce extinde foarte mult fondul de talente.

- În comparație cu companiile din SUA, DeepSeek este supus la mai puține constrângeri în ceea ce privește licențele de proprietate intelectuală, confidențialitatea, securitatea, politica etc. și există mai puține preocupări cu privire la utilizarea greșită a datelor pe care oamenii nu doresc să fie instruiți. Există mai puține procese, mai puțini avocați și mai puține preocupări.

Nu există nicio îndoială că tot mai mulți oameni cred că 2025 va fi un an decisiv. Între timp, companiile se pregătesc pentru el. Meta, de exemplu, construiește un centru de date 2GW+, cu o investiție estimată la $60-65 miliarde până în 2025, și va avea peste 1,3 milioane de GPU-uri până la sfârșitul anului.

Meta a folosit chiar un grafic pentru a compara centrul său de date de 2 gigawați cu Manhattan, New York.

Dar acum DeepSeek a făcut mai bine cu costuri mai mici și mai puține GPU-uri. Cum poate acest lucru să nu neliniștească oamenii?

Yann LeCun: Trebuie să îi mulțumim directorului tehnic și co-fondatorului a sursă deschisă

Hyperbolic, Yuchen Jin, pentru postarea faptului că în doar 4 zile, DeepSeek-R1 ne-a demonstrat 4 fapte:

- Inteligența artificială cu sursă deschisă este cu doar 6 luni în urma inteligenței artificiale cu sursă închisă

- China domină competiția open source de inteligență artificială

- Intrăm în epoca de aur a învățării prin consolidare a modelelor mari de limbaj

- Modelele de distilare sunt foarte puternice și vom rula AI foarte inteligente pe telefoanele mobile

Reacția în lanț declanșată de DeepSeek continuă, cum ar fi disponibilitatea gratuită a OpenAI o3-mini, speranța comunității de a reduce discuțiile vagi despre AGI/ASI și zvonul că Meta este în panică.

El crede că este dificil de prezis cine va câștiga în cele din urmă, dar nu ar trebui să uităm puterea avantajului ultimului venit. La urma urmei, știm cu toții că Google a fost cel care a inventat Transformer, în timp ce OpenAI a deblocat adevăratul său potențial.

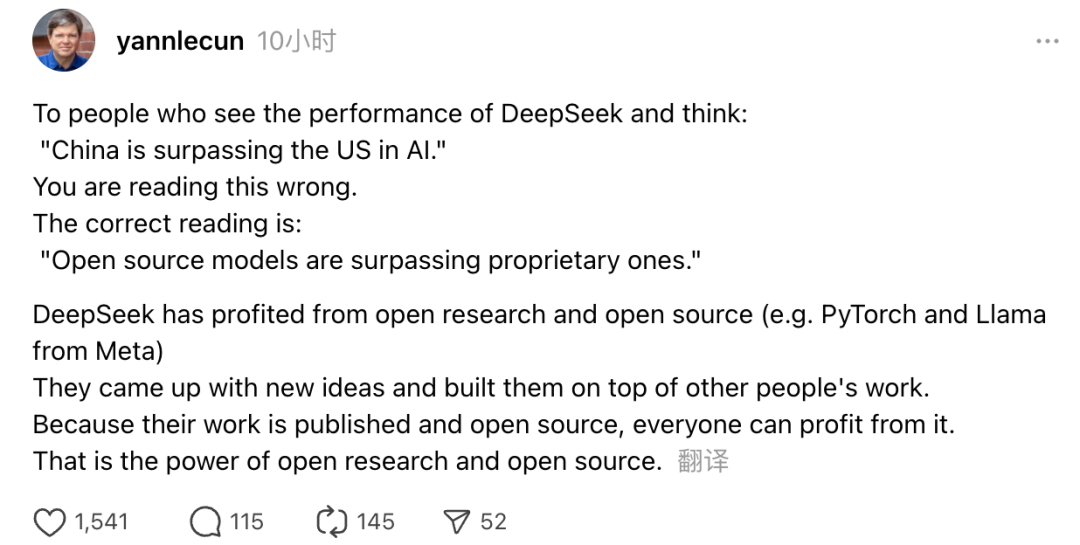

În plus, Yann LeCun, câștigător al Premiului Turing și cercetător-șef al Meta în domeniul inteligenței artificiale, și-a exprimat, de asemenea, opiniile.

"Pentru cei care, văzând performanța DeepSeek, se gândesc că "China depășește SUA în materie de inteligență artificială", au înțeles greșit. Înțelegerea corectă este că modelele open source depășesc modelele proprietare."

LeCun a declarat că motivul pentru care DeepSeek a făcut o asemenea explozie de data aceasta este că a beneficiat de cercetare deschisă și de sursă deschisă (cum ar fi PyTorch și Llama de la Meta). DeepSeek a venit cu idei noi și s-a bazat pe munca altora. Deoarece munca lor este publică și open source, toată lumea poate beneficia de ea. Aceasta este puterea cercetării deschise și a sursei deschise.

Reflecțiile internauților continuă. În timp ce sunt încântați de dezvoltarea noilor tehnologii, ei pot simți, de asemenea, o mică atmosferă de anxietate. La urma urmei, apariția DeepSeekers poate avea un impact real.