DeepSeek-R1-teknologi avslöjad: kärnprinciperna i papperet bryts ner och nyckeln till banbrytande modellprestanda avslöjas

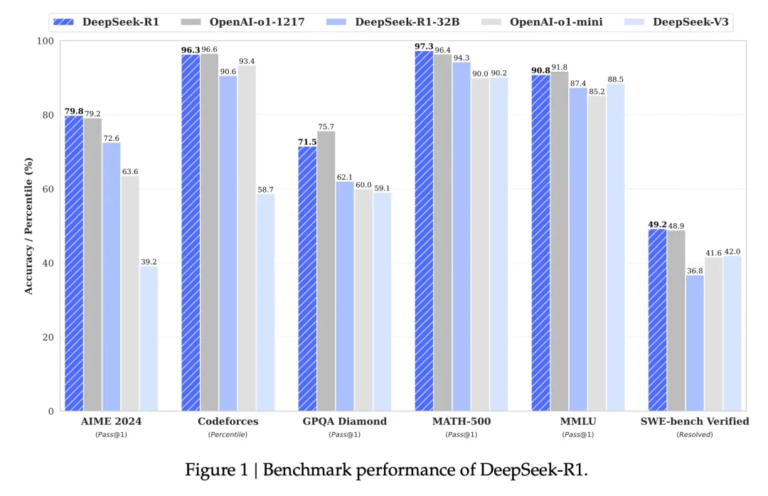

Idag kommer vi att dela DeepSeek R1, Titel: DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning: Incentivizing the reasoning capability of LLM via reinforcement learning. Detta dokument introducerar DeepSeek:s första generation av resonemangsmodeller, DeepSeek-R1-Zero och DeepSeek-R1. DeepSeek-R1-Zero-modellen tränades genom storskalig förstärkningsinlärning (RL) utan övervakad finjustering (SFT) som ett första steg,...