Einführung

Heute spielen große Sprachmodelle (LLMs) eine entscheidende Rolle. Anfang 2025, als der Wettbewerb um KI zunahm, Alibaba hat das neue KI-Modell Qwen2.5-max auf den Markt gebracht, und DeepSeek, ein Unternehmen aus Hangzhou, China, hat das Modell R1 auf den Markt gebracht, das den Höhepunkt der LLM-Technologie darstellt.

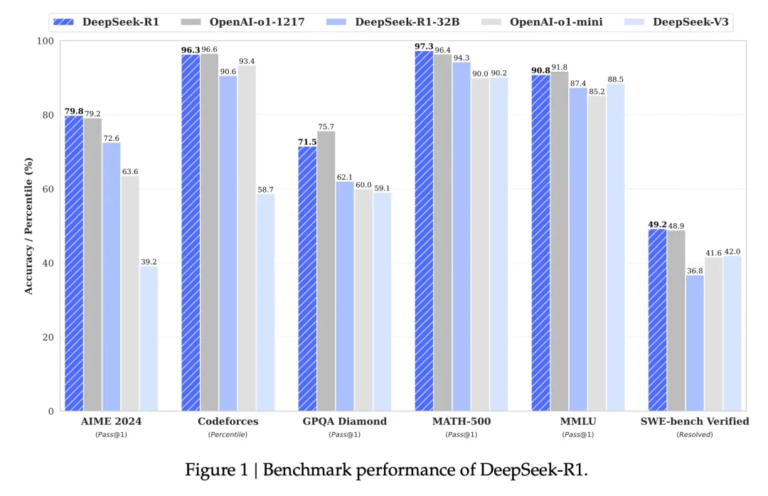

Deepseek R1 ist ein Open-Source-KI-Modell, das aufgrund seiner hervorragenden Benutzerfreundlichkeit und Leistung weltweite Aufmerksamkeit erregt hat. Es gibt auch mehr Hoffnung für die Anwendungsszenarien und die Zukunft der KI. Ein Open-Source-Modell bedeutet, dass jede Einzelperson oder jedes Unternehmen mit ausreichenden Hardwarebedingungen versuchen kann, Deepseek R1 lokal einzusetzen und KI-Funktionen zu erleben, die denen von Open AI O1 ähneln.

Dieser Artikel konzentriert sich auf Qwen2.5-max, analysiert seine Funktionen im Detail, vergleicht es mit DeepSeek R1, erklärt die Unterschiede zwischen den beiden und ihre Anwendungsszenarien und bietet abschließend eine Erfahrungsberichte, die Ihnen bei der Auswahl des am besten geeigneten Modells helfen.

Einführung in das Qwen2.5-max-Modell

Die Qwen-Reihe ist ein berühmtes LLM-Produkt. Qwen2.5-max, das neueste KI-Großmodellprodukt in der Alibaba Cloud Qwen-Reihe, ist als groß angelegtes MoE-Modell (Mixture-of-Experts) positioniert und zielt darauf ab, neue Höhen der Modellintelligenz zu erreichen. Es hofft, eine bessere Leistung zu erzielen und mehr Anforderungen und Anwendungsszenarien zu erfüllen. Es hat einige wesentliche Vorteile:

Vortraining mit großen Datenmengen: Qwen2.5-max wird durch einen riesigen Datensatz von 20 Billionen Tokens unterstützt, der ihm ein starkes Sprachverständnis und eine umfangreiche Wissensbasis verleiht. Wenn wir ein perfektes KI-LLM erhalten möchten, sind gute Daten wichtig.

Ausgezeichnete Argumentationsfähigkeit: Das logische Denken ist der Trumpf von Qwen2.5-max! Es hat in den strengen Tests maßgeblicher Benchmarks wie MMLU-Pro, LiveCodeBench, LiveBench und Arena-Hard außergewöhnliche Stärke bewiesen. Dieses Ergebnis hat bewiesen, dass es gut in komplexer Logik, Wissensfragen und Problemlösung ist.

Nahtlose Umschaltung in mehrere Sprachen: Die mehrsprachige Verarbeitung ist ein weiteres Highlight von Qwen2.5-max, insbesondere im Bereich der nicht-englischen NLP, wo seine Vorteile die von DeepSeek R1 deutlich übertreffen. Sie erstellen eine globale Anwendung? Qwen2.5-max ist die ideale Wahl für Sie.

Wissensbasierte KI erste Wahl: Sie erstellen wissensintensive Anwendungen? Dann ist Qwen2.5-max die richtige Wahl für Sie! Seine leistungsstarke Wissensdatenbank und Argumentationsfunktionen bieten eine solide Grundlage für Wissensmapping, intelligente Fragen und Antworten, Inhaltserstellung und andere Anwendungsszenarien.

Multimodale Kapazitäten erweitert: Ausgestattet mit Bildgenerierungsfunktionen kann Qwen2.5-max multimodale Daten wie Text, Bilder und Videos problemlos verarbeiten und so umfangreichere Anwendungsmöglichkeiten erschließen.

Qwen2.5-max vs. DeepSeek R1: Vergleich

Qwen2.5-max und DeepSeek R1 sind beide führend im Bereich LLM, haben aber jeweils ihren eigenen Schwerpunkt und ihre eigenen Besonderheiten:

| Funktionen/Modelle | Qwen2.5-max | DeepSeek R1 |

| Modell der Architektur | Großes MoE-Modell | MoE-Modell (671 Milliarden Parameter, 37 Milliarden Aktivierungen) |

| Trainingsdatenskala | 20 Billionen Token | Nicht explizit erwähnt, basierend auf DeepSeek-V3-Base Training |

| Kernvorteile | Inferenz, mehrsprachige Verarbeitung, wissensbasierte KI | Kodierungsfunktionen, Fragen- und Antworten, Websuchintegration |

| Multimodale Funktionen | Bilderzeugung | Bildanalyse, Websuche |

| Offene Quelle | Die Qwen-Reihe verfügt normalerweise über Open-Source-Versionen, aber die Open-Source-Version von 2.5-max muss bestätigt werden. | Open-Source-Modelle sind flexibler. |

| Hardwareanforderungen | Höher | Untere |

| Anwendbare Szenarien | Schwerpunkte: komplexes Denken, mehrsprachige Anwendungen, wissensintensive Aufgaben, multimodale Generierung | Kodierungsaufgaben, Frage-Antwort-Systeme, Anwendungen, die die Integration von Webinformationen erfordern, und hardwarebeschränkte Szenarien. |

| Vorteile von Benchmarktests | Mehrsprachige Verarbeitung, XTREME | Fragen beantworten (laut einigen Quellen) |

Ein Satz zur Zusammenfassung:

Wählen Sie Qwen2.5-max: logisches Denken, mehrsprachig, wissensintensiv, multimodale Generation? Wählen Sie es!

Wählen Sie DeepSeek R1: Codierung, Fragenbeantwortung, Webintegration, Hardwarebeschränkung? Wählen Sie es!

Erlebnisadresse: Sneak Preview

Qwen2.5-max:

Die offizielle Erlebnisadresse wird noch aktualisiert, achten Sie also bitte genau darauf:

Qwen Online-ErlebnisReferenzadresse

API-Erfahrungsadresse

DeepSeek R1:

Adresse des Online-Erlebnisses

Herzliche Erinnerung: Die Erlebnisadresse kann sich ändern, bitte beachten Sie die neuesten offiziellen Informationen.

Zusammenfassung: Wählen Sie das Modell, das am besten zu Ihnen passt

Qwen2.5-max und DeepSeek R1, die Zwillingsstars des LLM-Bereichs, jeder mit seinen eigenen Stärken. Je nach Anwendungsszenario und Kernanforderungen ist die Auswahl des am besten geeigneten Modells der richtige Weg. Wir freuen uns auf weitere Durchbrüche in der KI-Technologie, die der Menschheit unbegrenzte Möglichkeiten eröffnen werden!