Les Google Gemini 2.0 La famille est enfin au complet ! Il domine les charts dès sa sortie.

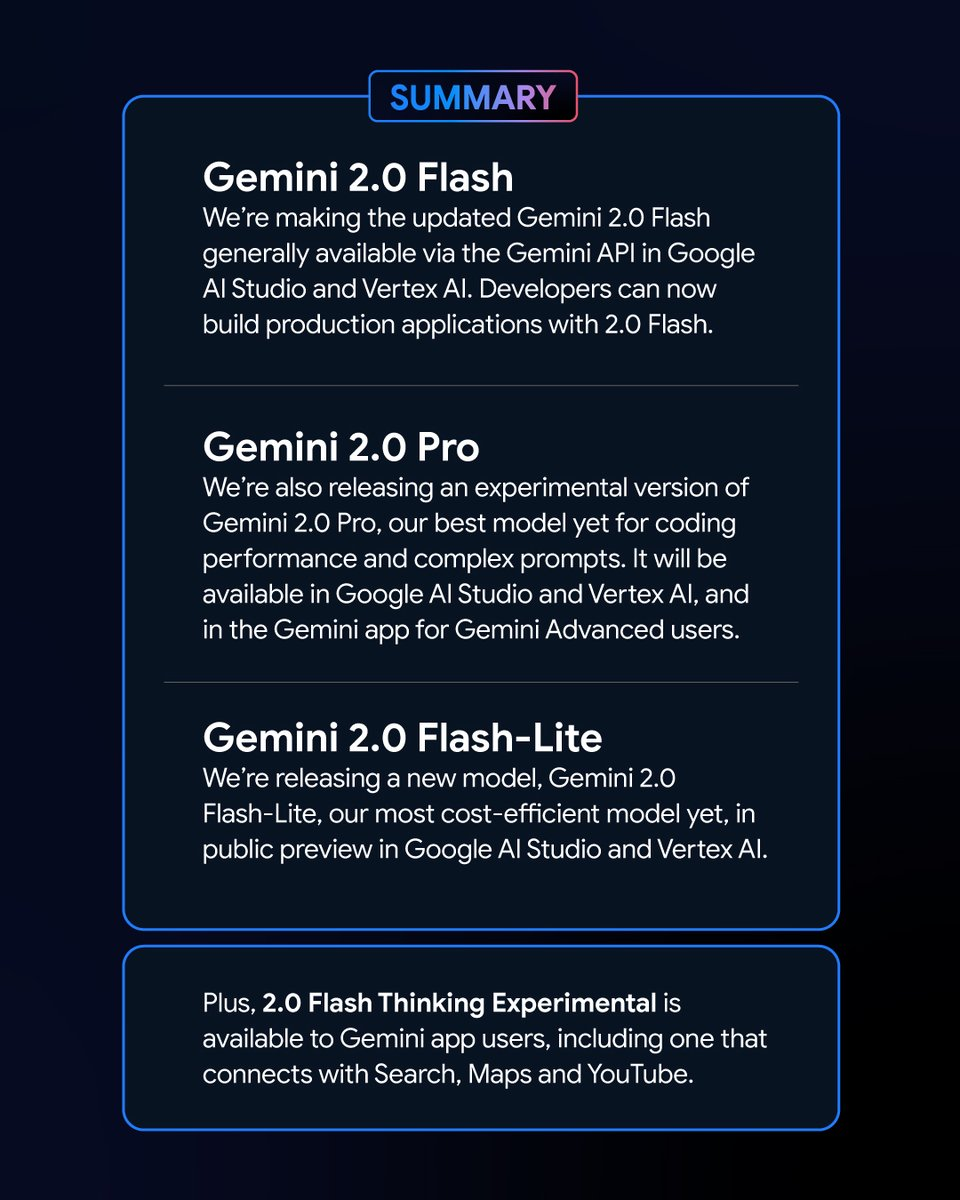

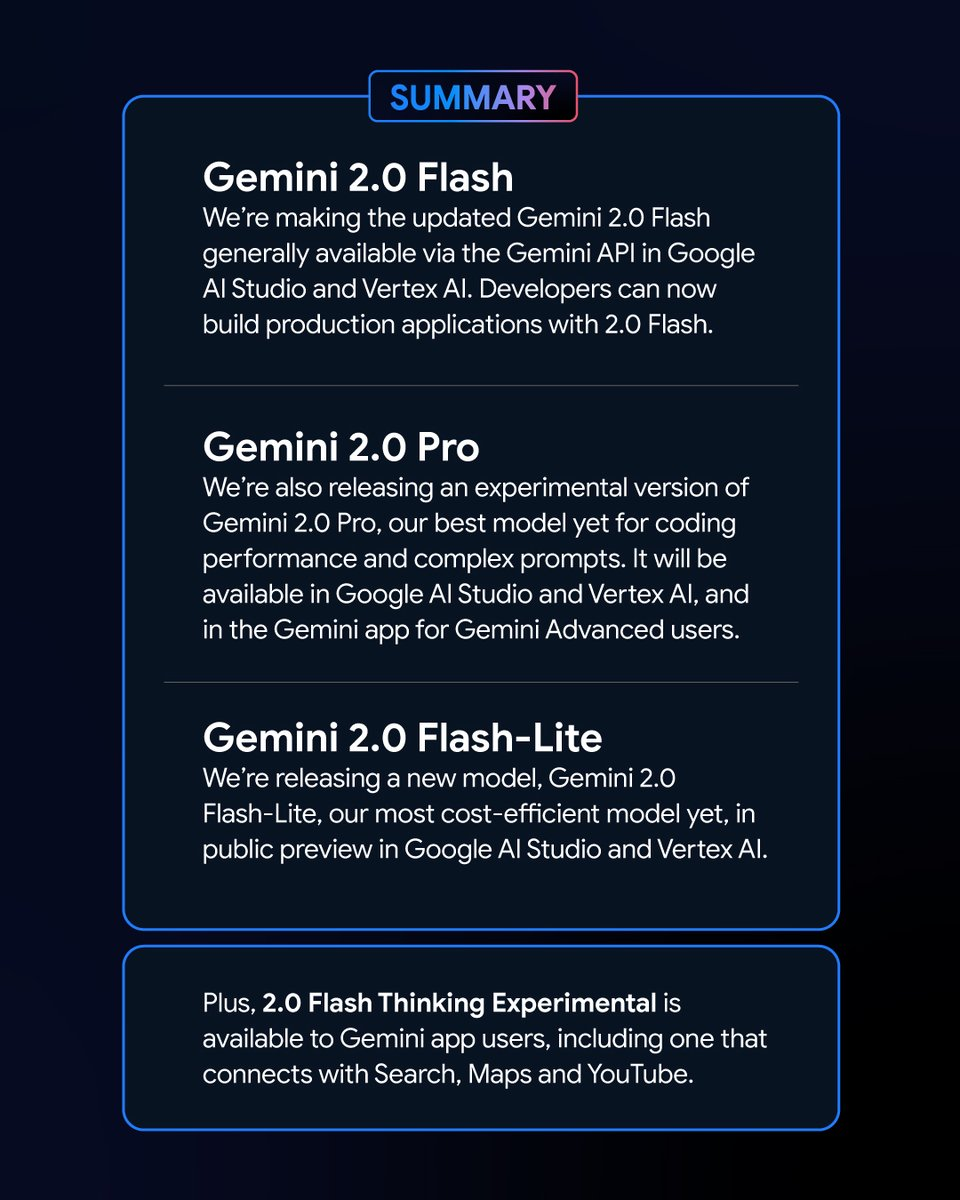

Au milieu de la poursuite et des blocus de Deepseek, Qwen et o3, Google a sorti trois modèles en une seule fois tôt ce matin : Gemini 2.0 Pro, Gemini 2.0 Flash et Gemini 2.0 Flash-Lite.

Dans le classement des grands modèles LMSYS, Gemini 2.0-Pro s'est hissé au sommet, et la famille Gemini-2.0 s'est hissée dans le top 10.

Commençons par examiner les performances du modèle

Les Modèles Gemini 2.0 sortis cette fois-ci ont tous leurs propres points forts en termes de performances!

Gemini 2.0 Pro (expérimental)

Comme le modèle phare de la série Gemini, la version Pro représente les capacités d'IA les plus avancées de Google et excelle dans codage et inférence en particulier:

- Fenêtre de contexte extra-large : prend en charge le traitement de contexte jusqu'à 2 millions de jetons

- Intégration d’outils puissants : intègre en profondeur la recherche Google et l'exécution de code

- Disponibilité: déjà disponible en version expérimentale sur Google AI Studio, Vertex AI et la plateforme Gemini Advanced

Flash Gemini 2.0

se positionne comme un « Un cheval de bataille très efficace »Il est conçu pour équilibrer la vitesse et les performances et est destiné à fournir un support idéal pour les scénarios d'application qui nécessitent des réponses à faible latence :

- Des millions de fenêtres contextuelles : Prend en charge 1 M de contexte de jetons

- Excellentes capacités d’inférence multimodale : Bon traitement des données multimodales, prend actuellement en charge la saisie multimodale et la saisie de texte monomodale

- Extension future des fonctionnalités : Les fonctions de génération d'images et de synthèse vocale seront bientôt disponibles

- Disponibilité: Officiellement publié sur les plateformes Vertex AI Studio et Google AI Studio, et accessible via l'API Gemini.

Gemini 2.0 Flash-Lite (Aperçu)

En tant que modèle « le plus rentable », Flash-Lite offre le meilleur équilibre entre vitesse, coût et performances.

- Avantages économiques : tout en conservant la même vitesse et le même coût que 1.5 Flash, il surpasse 1.5 Flash dans la plupart des tests de référence.

- Fenêtre de contexte à plusieurs niveaux : Prend également en charge 1 M de jetons de puissance de traitement de contexte.

Selon la comparaison d'évaluation des performances publiée par Google, la version expérimentale de Gemini 2.0 Pro a obtenu les scores les plus élevés dans presque tous les tests de référence, avec d'excellentes performances :

Il a obtenu de très bons résultats dans les tâches de génération de code (comme LiveCodeBench v5) et dans les problèmes mathématiques complexes (comme l'algèbre, la géométrie et le calcul). De plus, une amélioration significative a été constatée dans le test de compréhension de documents longs et complexes.

Et le prix

Google est également un fabricant consciencieux en termes de rentabilité des API.

Les millions de jetons de Gemini 2.0 Flash coûtent moins d'un dollar… Il prend en charge plusieurs modes, des recherches en réseau et une fenêtre de contexte sans précédent.

En revanche, Deepseek V3 coûte actuellement un dollar pour un million de jetons, et l’inférence R1 coûte quatre dollars.

PS : Mais je tiens quand même à remercier DeepSeek pour avoir baissé le prix. Celui qui peut baisser le prix fait partie de la famille.

C'est vraiment trop bon marché ! Par rapport aux performances, je pense que Gemini a négligé le prix !

Performances du boîtier

Puisqu'il prétend être aussi bon que Deepseek, nous devons absolument voir comment il fonctionne réellement dans les cas et voir comment divers internautes l'ont testé

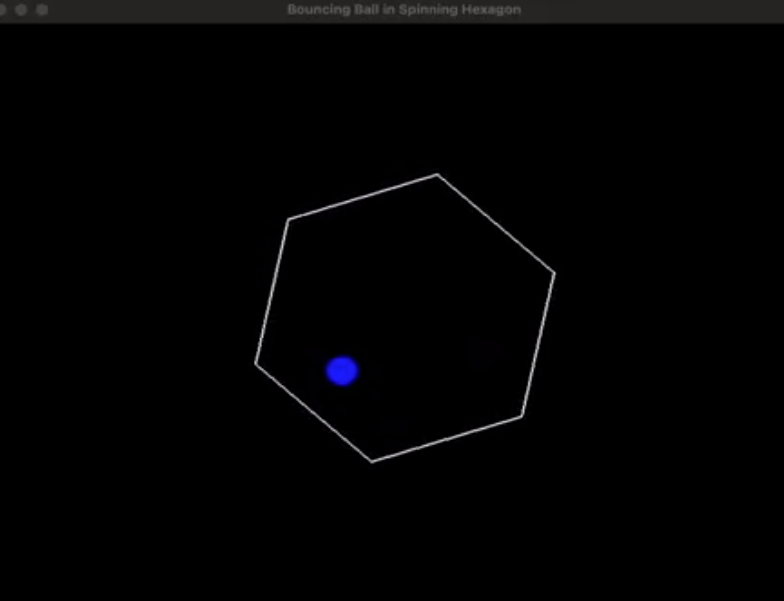

Un jeu de flipper basé sur la physique

Examinons d’abord ce cas populaire, qui utilise un moteur physique pour simuler des effets réalistes tels que les collisions, la friction et la gravité.

Astuce : écrivez un programme Python qui affiche une balle rebondissant à l'intérieur d'un hexagone en rotation. La balle doit être affectée par la gravité et la friction, et doit rebondir de manière réaliste sur les parois en rotation

Voici comment fonctionnent Deepseek R1 et o3-min :

La version générée par Gemini 2.0 Pro Experimental :

Les deux modèles restants ne fonctionnent pas bien

Doublez la difficulté ! Divisez la balle en 100 boules !

Astuce : écrivez un script pour 100 balles jaunes rebondissantes à l'intérieur d'une sphère, en veillant à gérer correctement la détection de collision. Faites tourner lentement la sphère. Assurez-vous que les balles restent à l'intérieur de la sphère. Implémentez dans p5.js

Bien joué ! La rotation lente de la sphère est très fluide et la simulation des lois physiques est excellente. Les 100 boules entrent également en collision de manière régulière et « font leur travail » ~

Écrivez un script p5.js pour simuler 25 particules rebondissant dans un espace vide à l'intérieur d'un conteneur cylindrique. Utilisez une couleur différente pour chaque boule et assurez-vous qu'elles laissent une trace pour montrer leur mouvement. Ajoutez une rotation lente du conteneur pour mieux observer ce qui se passe dans la scène. Assurez-vous de créer des règles de détection de collision et de physique appropriées pour garantir que les particules restent à l'intérieur du conteneur. Ajoutez un conteneur sphérique externe. Ajoutez un effet de zoom avant et arrière lent à l'ensemble de la scène.

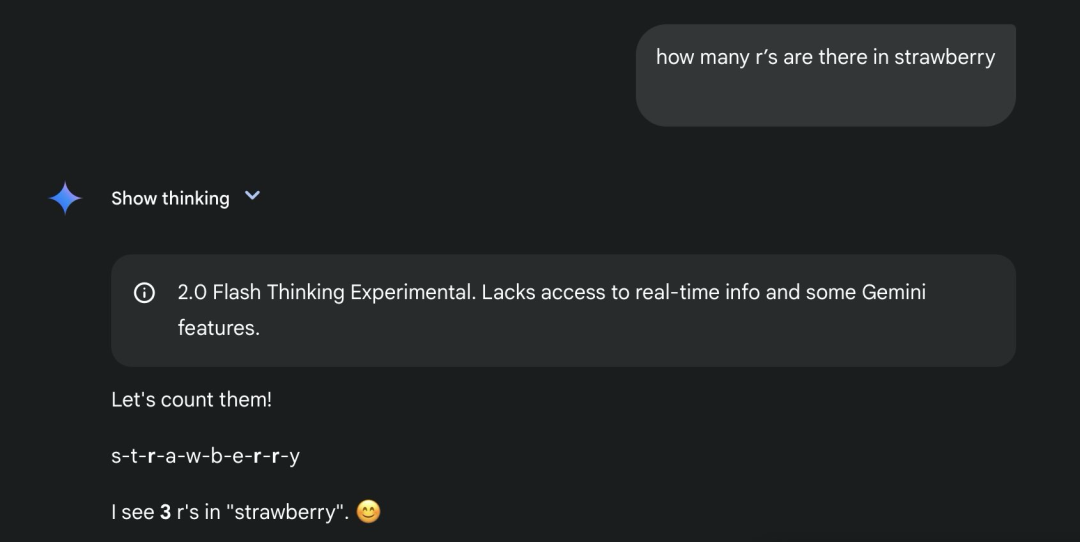

Une question de test de fraise qui ne peut pas être contournée

Et des internautes malins (et rusés) ont à nouveau lancé le test classique de la fraise :

Combien de r y a-t-il dans la fraise

Et Gemini 2.0 Flash Thinking Experimental a trouvé la bonne réponse :

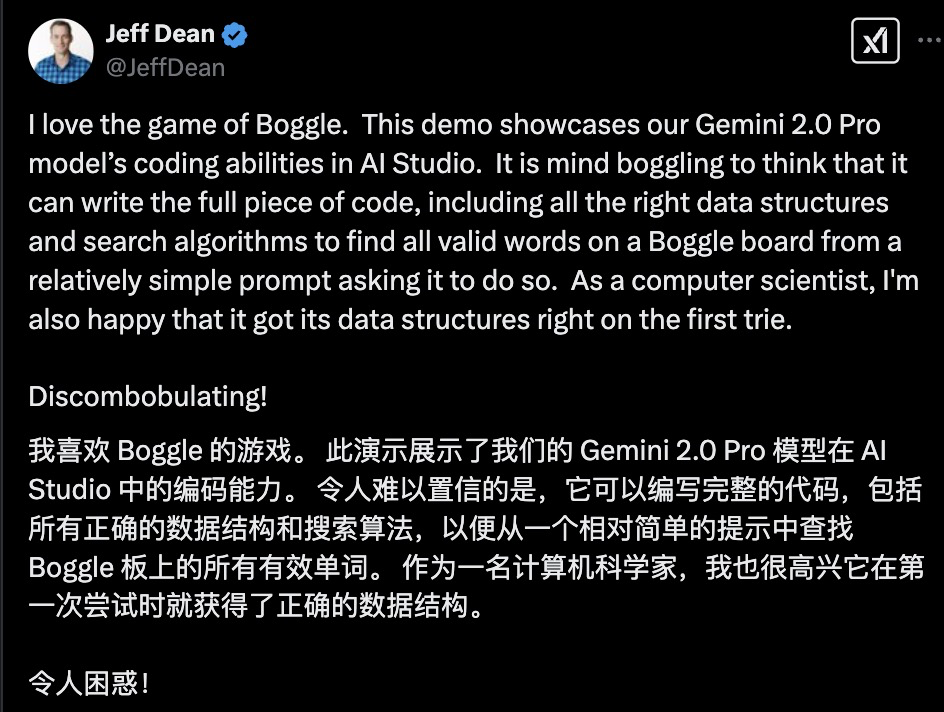

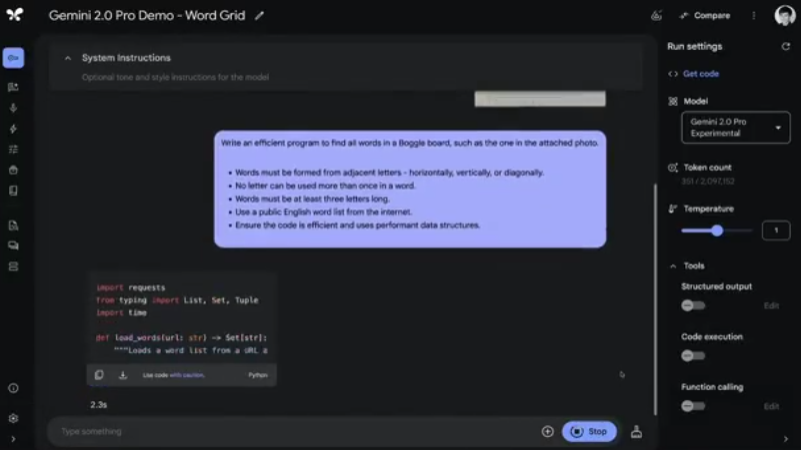

Le patron de Google, Jeff Dean, a personnellement testé ses compétences en programmation

Jeff Dean, scientifique en chef chez Google DeepMind et Google Research, a également testé les compétences de programmation d'une vague de Gemini 2.0 Pro :

Il a demandé au modèle de terminer le jeu classique Boggle, et le code généré la première fois a terminé de trouver tous les mots valides dans le « lettre carrée » jeu:

De plus, Jeff Dean a déclaré que le code a été complété en seulement 18,9 secondes, ce qui est très rapide.

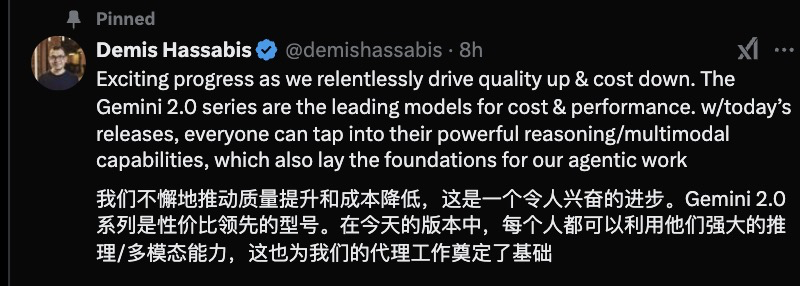

Le PDG de Google DeepMind est plein de confiance dans cette mise à jour majeure du modèle, affirmant que cette version pose les bases pour que Google puisse réaliser le futur travail des agents intelligents :

Le PDG de Google, Sundar Pichai, a déjà clairement indiqué que 2025 serait une période critique pour Google pour accélérer le développement dans le domaine de l'IA. après cette sortie, la route de Google est plus claire !

Par rapport aux itinéraires d'autres géants, l'itinéraire de l'IA de Google se concentre davantage sur l'aspect pratique et propose directement plusieurs options de version, tout comme une boîte à outils d'IA, où vous pouvez choisir comme vous le souhaitez, selon vos besoins, de manière flexible et pratique, et capable de répondre à toutes sortes de besoins.