Introduzione

Oggi, i grandi modelli linguistici (LLM) svolgono un ruolo cruciale. All'inizio del 2025, mentre la competizione per l'IA si intensificava, Alibaba ha lanciato il nuovo modello AI Qwen2.5-maxe DeepSeek, un'azienda di Hangzhou, Cina, ha lanciato il modello R1, che rappresenta l'apice della tecnologia LLM.

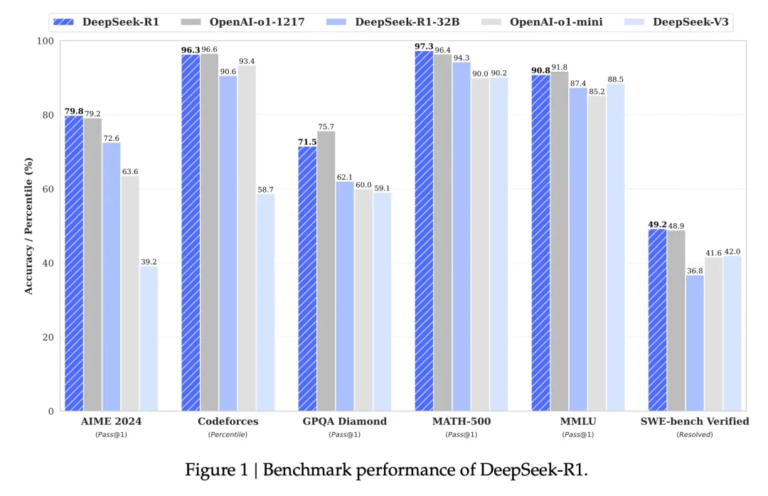

Deepseek R1 è un modello di intelligenza artificiale open source che ha attirato l'attenzione mondiale per la sua eccellente esperienza utente e le sue prestazioni. Porta anche più speranza per gli scenari applicativi e il futuro dell'intelligenza artificiale. Un modello open source significa che qualsiasi individuo o azienda con sufficienti condizioni hardware può provare a distribuire Deepseek R1 localmente e sperimentare funzioni di intelligenza artificiale simili a quelle dell'intelligenza artificiale open source o1.

Questo articolo si concentrerà su Qwen2.5-max, analizzerà in dettaglio le sue caratteristiche, lo confronterà con DeepSeek R1, spiegherà le differenze tra i due e i loro scenari applicativi e, infine, fornirà un indirizzo esperienziale per aiutarti a scegliere il modello più adatto.

Introduzione al modello Qwen2.5-max

La serie Qwen è un famoso prodotto LLM, Qwen2.5-max, l'ultimo prodotto AI di grandi dimensioni nella serie Qwen di Alibaba Cloud, è posizionato come un modello MoE (Mixture-of-Experts) su larga scala, che mira a raggiungere nuove vette di intelligenza del modello. Spera di ottenere prestazioni migliori e soddisfare più esigenze e scenari applicativi. Presenta alcuni vantaggi fondamentali:

Pre-addestramento di dati massivi: Qwen2.5-max è basato su un enorme set di dati di 20 trilioni di token, che gli conferisce una solida comprensione del linguaggio e una vasta base di conoscenza. Se vogliamo ottenere un LLM in intelligenza artificiale perfetto, è importante disporre di buoni dati.

Ottima capacità di ragionamento: Il ragionamento è la carta vincente di Qwen2.5-max! Ha dimostrato una forza straordinaria nei rigorosi test di benchmark autorevoli come MMLU-Pro, LiveCodeBench, LiveBench e Arena-Hard, questo punteggio ha dimostrato che è bravo nella logica complessa, nelle domande di conoscenza e nella risoluzione dei problemi.

Commutazione multilingue senza soluzione di continuità: L'elaborazione multilingue è un altro punto forte di Qwen2.5-max, specialmente nel campo dell'NLP non inglese, dove i suoi vantaggi superano significativamente quelli di DeepSeek R1. Stai creando un'applicazione globale? Qwen2.5-max è la scelta ideale per te.

L'intelligenza artificiale basata sulla conoscenza è la prima scelta: Stai creando applicazioni ad alta intensità di conoscenza? Qwen2.5-max è la scelta giusta per te! La sua potente base di conoscenza e le sue capacità di ragionamento forniscono una solida base per la mappatura della conoscenza, Q&A intelligenti, creazione di contenuti e altri scenari applicativi.

Capacità multimodali ampliate:Dotato di capacità di generazione di immagini, Qwen2.5-max può gestire facilmente dati multimodali quali testo, immagini e video, aprendo possibilità applicative più ampie.

Qwen2.5-max vs DeepSeek R1: Confronto

Qwen2.5-max e DeepSeek R1 sono entrambi leader in LLM, ma ognuno ha il proprio focus e le proprie caratteristiche distintive:

| Caratteristiche/Modelli | Qwen2.5-massimo | DeepSeek R1 |

| Modello di architettura | Modello MoE su larga scala | Modello MoE (671 miliardi di parametri, 37 miliardi di attivazioni) |

| Scala dei dati di formazione | 20 trilioni di token | Non menzionato esplicitamente, in base alla formazione di base DeepSeek-V3 |

| Vantaggi principali | Inferenza, elaborazione multilingue, intelligenza artificiale basata sulla conoscenza | capacità di codifica, risposta alle domande, integrazione della ricerca web |

| Capacità multimodali | Generazione di immagini | Analisi delle immagini, Ricerca sul Web |

| Fonte aperta | Di solito la serie Qwen ha una versione open source, ma la versione open source 2.5-max deve essere confermata. | I modelli open source sono più flessibili. |

| requisiti hardware | Più alto | Inferiore |

| Scenari applicabili | Concentrarsi sul ragionamento complesso, sulle applicazioni multilingue, sui compiti ad alta intensità di conoscenza, sulla generazione multimodale | attività di codifica, sistemi di risposta alle domande, applicazioni che richiedono l'integrazione di informazioni web e scenari con vincoli hardware. |

| Vantaggi del test di benchmark | Elaborazione multilingue, XTREME | domanda e risposta (secondo alcune fonti) |

Una frase per riassumere:

Scegli Qwen2.5-max: ragionamento, multilingue, generazione ad alta intensità di conoscenza, multimodale? Sceglilo!

Scegli DeepSeek R1: codifica, risposte alle domande, integrazione web, limitazioni hardware? Sceglilo!

Indirizzo di esperienza: anteprima

Qwen2.5-massimo:

L'indirizzo ufficiale dell'esperienza è ancora in fase di aggiornamento, quindi prestate molta attenzione:

Esperienza online Qwenindirizzo di emergenza

Indirizzo esperienza API

DeepSeek R1:

Promemoria caldo: L'indirizzo dell'esperienza potrebbe cambiare, fare riferimento alle ultime informazioni ufficiali.

Riepilogo: Scegli il modello più adatto a te

Qwen2.5-max e DeepSeek R1, le stelle gemelle del campo LLM, ciascuna con i propri punti di forza. A seconda dello scenario applicativo e delle esigenze principali, la scelta del modello più adatto è la strada da seguire. Non vediamo l'ora di continuare a fare progressi nella tecnologia AI, che porterà possibilità illimitate all'umanità!