Historia Bliźniętanja 2.0 przyspiesza.

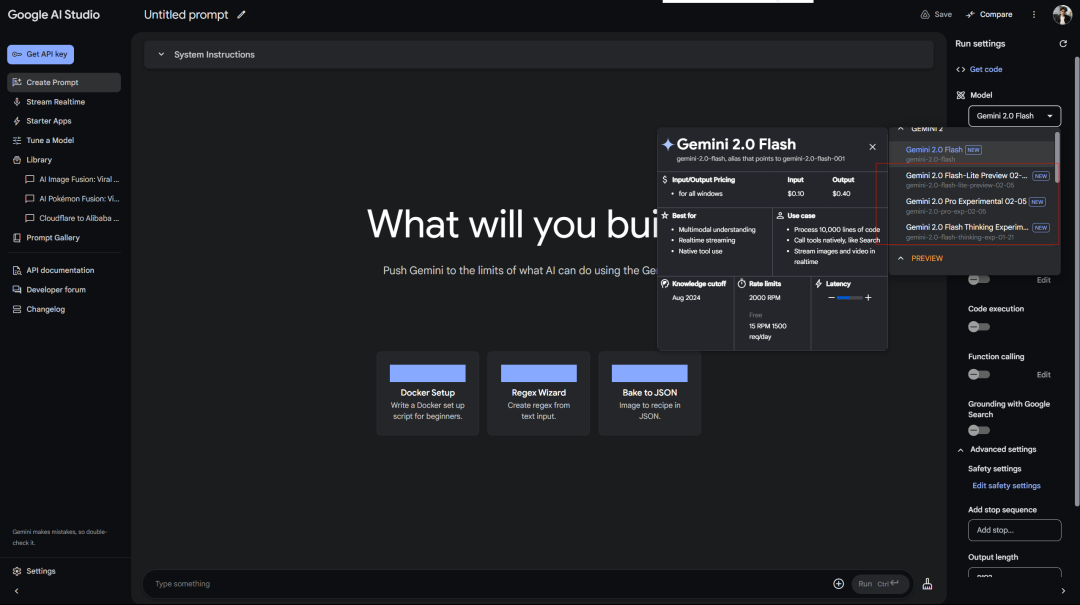

Wersja eksperymentalna Flash Thinking, która ukazała się w grudniu, udostępniła deweloperom działający model charakteryzujący się niskim opóźnieniem i wysoką wydajnością.

Na początku tego roku zaktualizowano wersję 2.0 Flash Thinking Experimental w Google AI Studio, aby jeszcze bardziej zwiększyć wydajność poprzez połączenie szybkości technologii Flash z ulepszonymi możliwościami wnioskowania.

W zeszłym tygodniu zaktualizowana wersja 2.0 Flash została w pełni udostępniona w aplikacjach Gemini na komputery stacjonarne i urządzenia mobilne.

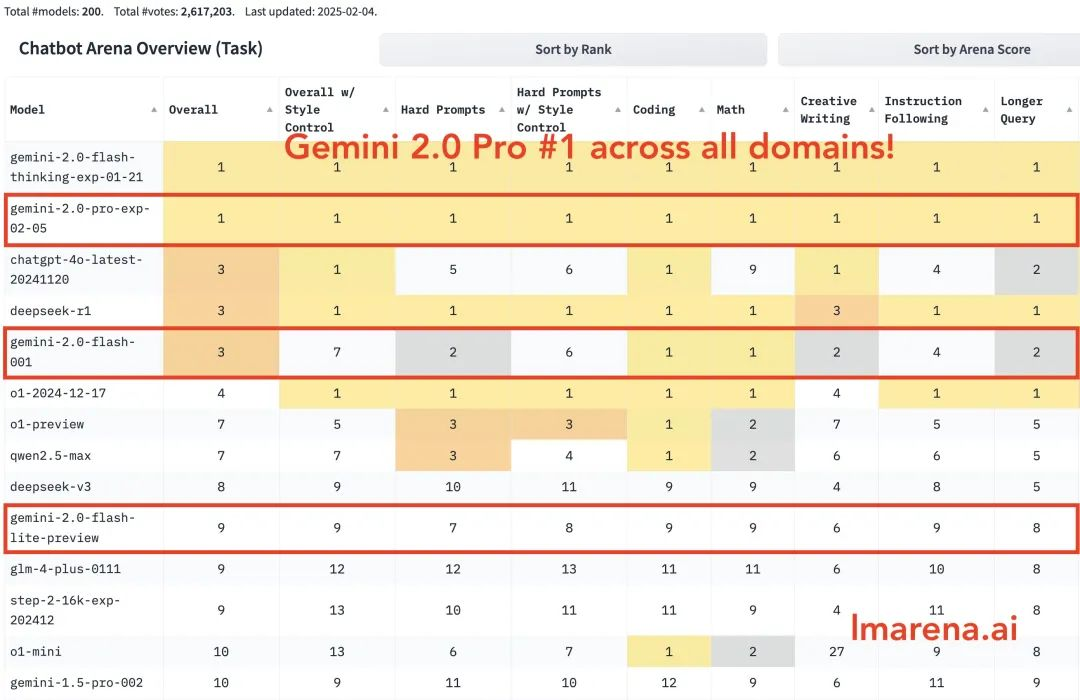

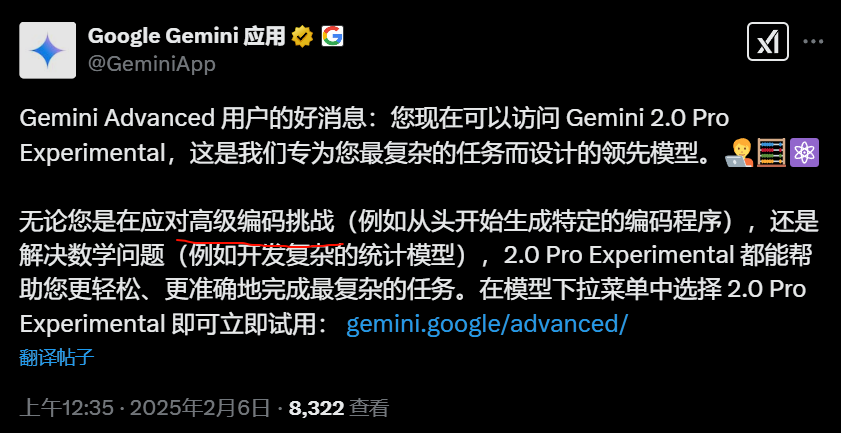

Dziś zaprezentowano jednocześnie trzy nowe wersje: eksperymentalną wersję Gemini 2.0 Pro, która do tej pory najlepiej sprawdzała się w kodowaniu i złożonych poleceniach, ekonomiczną wersję 2.0 Flash-Lite oraz wersję 2.0 Flash Thinking z udoskonalonym modułem myślenia.

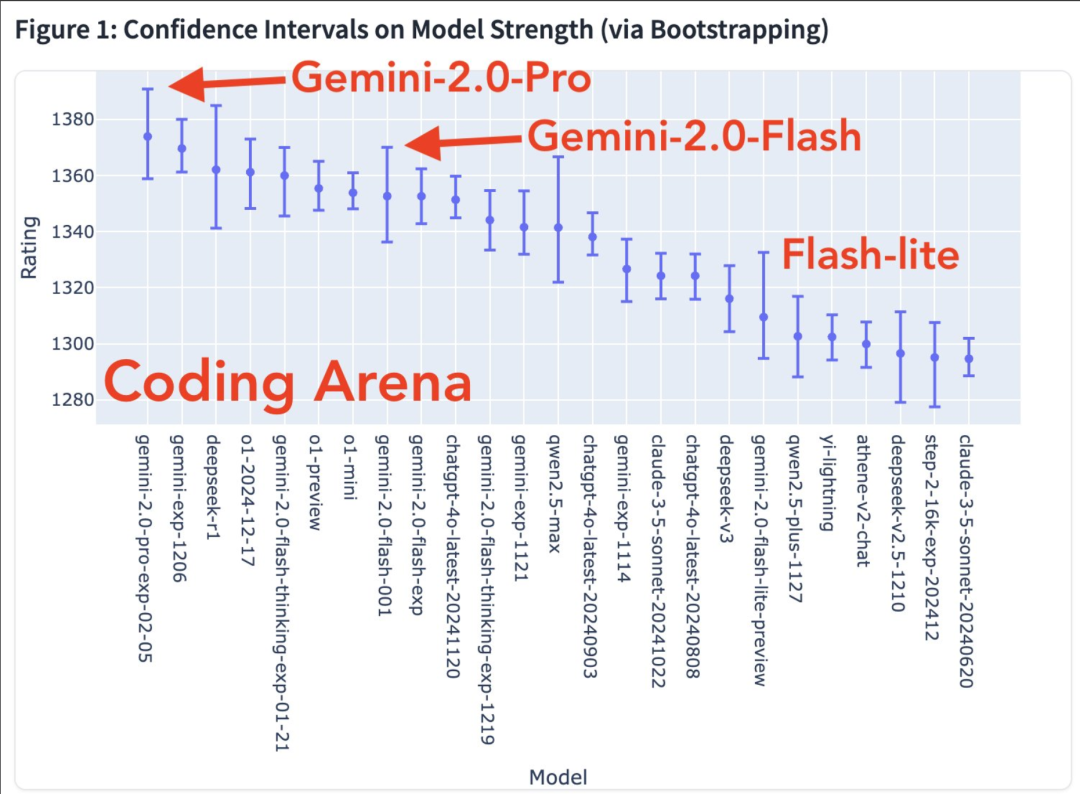

Gemini 2.0 Pro zajmuje pierwsze miejsce we wszystkich kategoriach. Gemini-2.0-Flash zajmuje pierwsze trzy miejsca w kodowaniu, matematyce i łamigłówkach. Flash-lite zajmuje pierwsze dziesięć miejsc we wszystkich kategoriach.

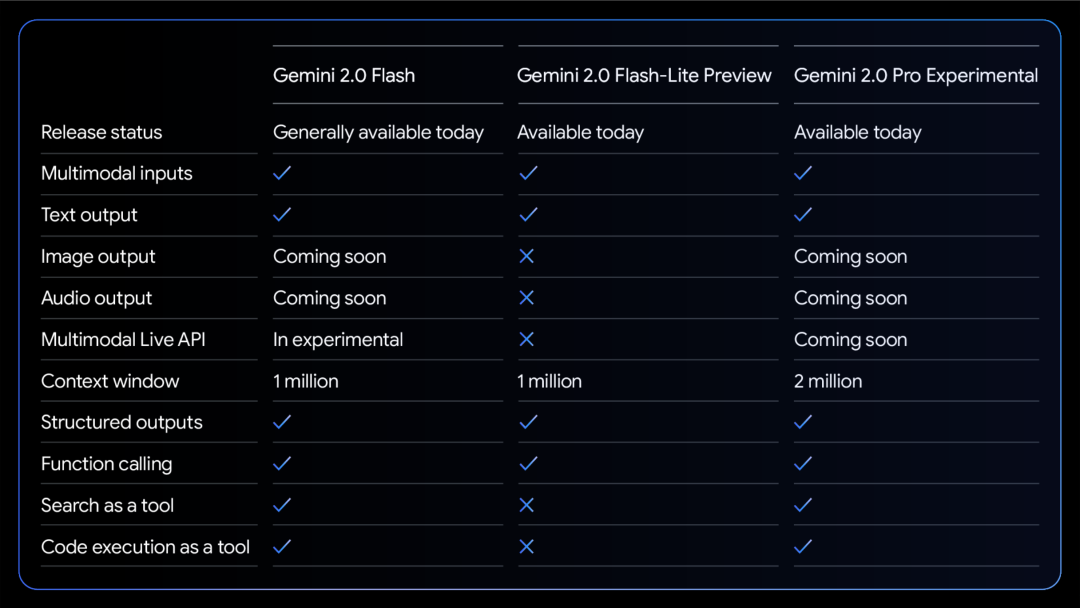

Tabela porównawcza możliwości trzech modeli:

Wszystkie modele obsługują multimodalne wprowadzanie i wyprowadzanie tekstu.

Więcej zdolności modalnych jest w drodze. Wykres siły modelu w obszarze kodowania

Mapa cieplna współczynnika wygranych

Google traktuje użytkowników darmowych lepiej niż OpenAI traktuje użytkowników Plus. Bezpłatny dostęp do Gemini 2.0 Pro Experimental w AI Studio:

Usługa Deepseek zawsze wyświetla komunikat o błędzie... Warto pamiętać, że pierwszym modelem wolnym od wnioskowania był również Flash Thinking 2.0, który był używany w aistudio Google.

Ponadto istnieje wersja internetowa Gemini:

Istnieje również spójny model wnioskowania (więc po co go rozdzielać…)

Google wydało eksperymentalną wersję Gemini 2.0 Pro, a poprawa wyników w oficjalnych testach porównawczych jest naprawdę oczywista.

Posiada najsilniejsze możliwości kodowania i przetwarzania złożonych poleceń, a także lepsze możliwości rozumienia i wnioskowania na temat wiedzy o świecie niż jakikolwiek inny model opublikowany dotychczas przez Google.

Posiada największe okno kontekstowe (200 tys., a mój długi kontekst jest stosunkowo dużą zaletą modelu Gemini), co pozwala na kompleksową analizę i zrozumienie dużej ilości informacji, a także na wywoływanie narzędzi takich jak wyszukiwarka Google i wykonywanie kodu.

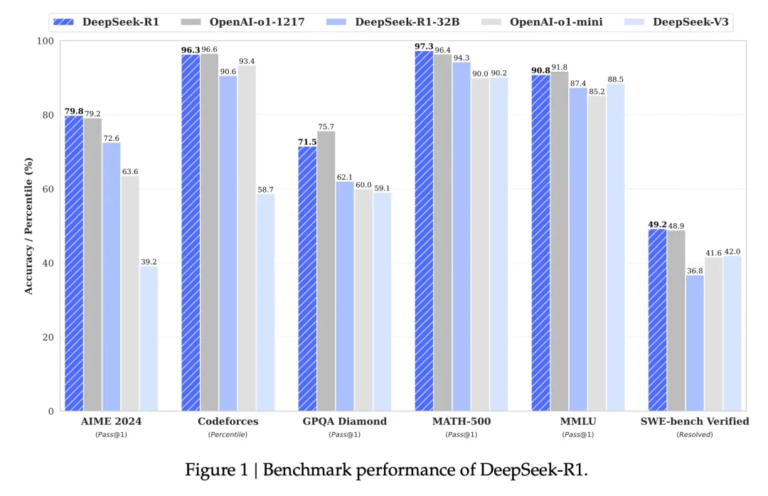

W teście MATH osiągnięto wynik 91,8%, co stanowi wzrost o około 5 punktów procentowych w porównaniu z wersją 1.5. Zdolność rozumowania GPQA osiągnęła wynik 64,7%, a test wiedzy o świecie SimpleQA osiągnął nawet 44,3%.

Najbardziej godna uwagi jest zdolność programowania. W teście LiveCodeBench osiągnął 36,0%, a dokładność konwersji Bird-SQL przekroczyła 59,3%. W połączeniu z superdużym oknem kontekstowym o pojemności 2 milionów tokenów, wystarcza to do obsługi najbardziej złożonych zadań analizy kodu.

Możesz wypróbować to na kursorze.

Zdolność rozumienia wielu języków jest również imponująca – wynik globalnego testu MMLU wynosi 86,5%. Rozumienie obrazu MMMU wynosi 72,7%, a zdolność analizy wideo 71,9%.

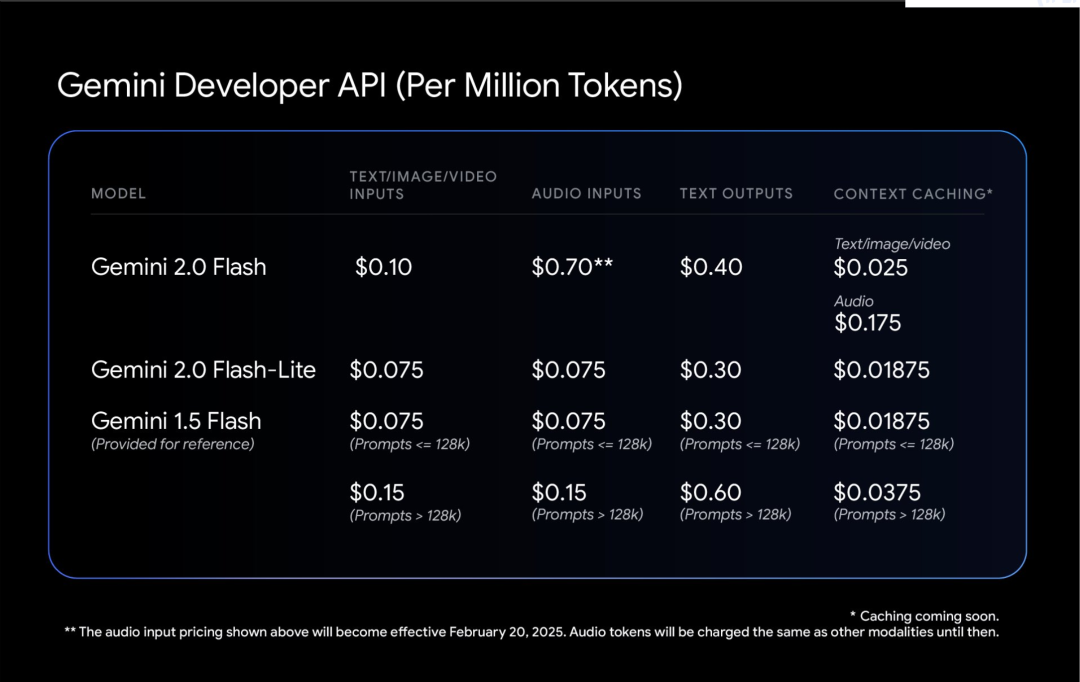

Gemini 2.0 Flash-Lite to ciekawe rozwiązanie.

Utrzymuje prędkość i koszt 1.5 Flash, ale zapewnia lepszą wydajność. Okno kontekstowe z 1 milionem tokenów pozwala mu przetwarzać więcej informacji.

Najbardziej praktyczną rzeczą jest stosunek ceny do wydajności: generowanie podpisów do 40 000 zdjęć kosztuje mniej niż $1. To sprawia, że AI jest bardziej przyziemne.

Bloger Shrivastava wspomniał: Kodowanie Gemini 2.0 Pro jest szalone!

Wskazówka: użyj Three.js, aby stworzyć symulację układu słonecznego. Dodaj skalę czasu, rozwijane menu fokusu, pokaż orbity i pokaż etykiety. Utwórz wszystko w jednym pliku, abym mógł wkleić go do edytora online i wyświetlić wynik.

Dodatkowo niektórzy użytkownicy wspomnieli, że Gemini 2.0 Flash uzyskał lepsze wyniki w jednym z jego własnych testów paradoksalnych:

Na koniec Google wspomniało, że bezpieczeństwo Gemini 2.0, a nie tylko poprawka, jest od samego początku podstawą projektu.

Niech model nauczy się być samokrytyczny. Użyj uczenia wzmacniającego, aby Gemini mógł ocenić swoje własne odpowiedzi i zapewnić dokładniejsze informacje zwrotne. Dzięki temu będzie bardziej odporny, gdy będzie zajmował się wrażliwymi tematami.

Zautomatyzowane testowanie zespołu czerwonego jest interesujące. Zostało zaprojektowane specjalnie, aby zapobiegać wstrzykiwaniu pośrednich słów podpowiedzi, co jest jak wyposażenie AI w system odpornościowy, aby uniemożliwić komuś ukrycie złośliwych poleceń w danych.