DeepSeek R1 Online (Bezpłatnie|Nologin)

Rewolucyjny model Open-Source AI dla zaawansowanego rozumowania, który bije Openai o1

DeepSeek R1 Czat online za darmo

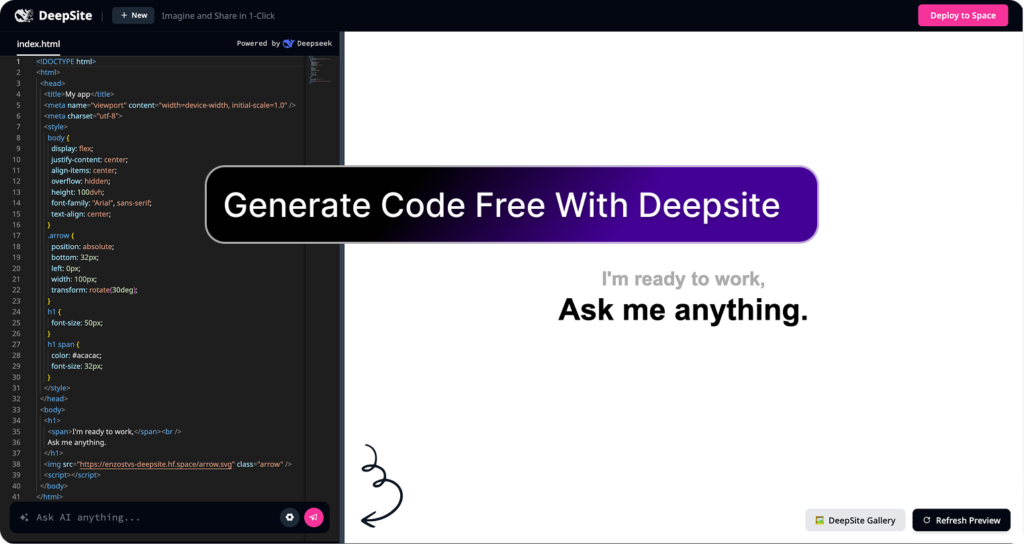

Agent kodowania AI oparty na DeepSeek dostępny online za darmo już teraz!

Głęboka witryna jest zasilany przez deepseek V3, jest narzędziem do generowania kodu, jest teraz darmowy!

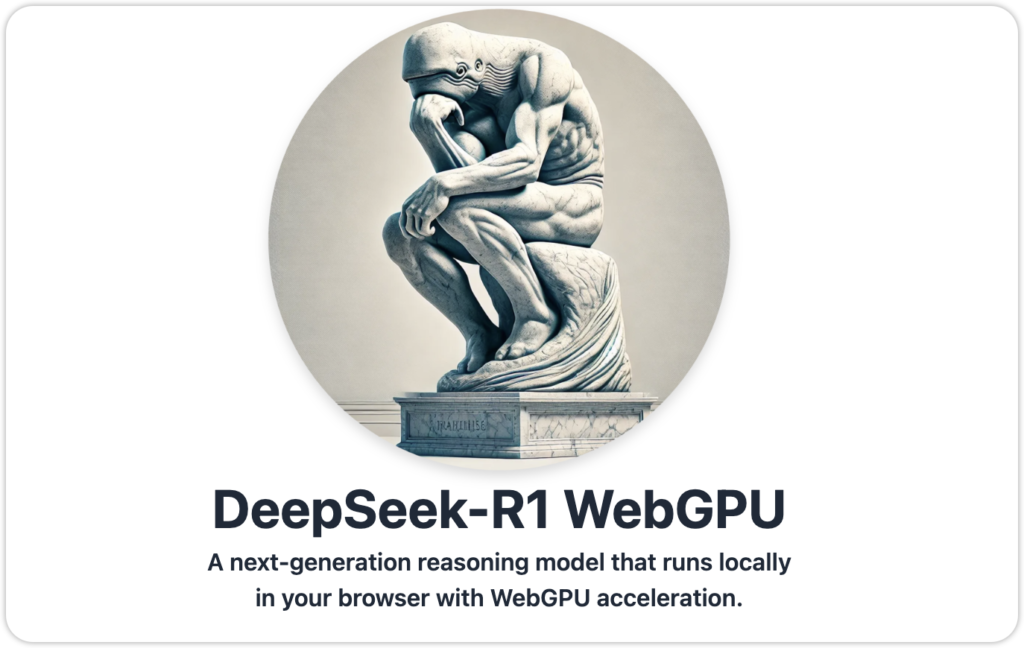

DeepSeek R1 WEBGPU Online

Model rozumowania nowej generacji, który działa lokalnie w przeglądarce z akceleracją WebGPU.

Właśnie ładujesz DeepSeek-R1-Distill-Qwen-1.5B, narzędzie LLM do wnioskowania o parametrach 1.5B zoptymalizowane pod kątem wnioskowania w przeglądarce. Wszystko działa całkowicie w przeglądarce dzięki 🤗 Transformers.js i ONNX Runtime Web, co oznacza, że żadne dane nie są wysyłane na serwer. Po załadowaniu może być nawet używany w trybie offline.

Pełen funkcji DeepSeek R1 online

Architektura

Zbudowany na MoE (mieszanka ekspertów) z 37B aktywnych/671B całkowitych parametrów i 128K długości kontekstu. Wdraża zaawansowane uczenie ze wzmocnieniem w celu osiągnięcia samoweryfikacji, wieloetapowej refleksji i możliwości rozumowania dostosowanego do człowieka.

Wydajność

MatematykaDokładność 97,3% na MATH-500

Kodowanie: Przewyższa 96,3% uczestników Codeforces

Rozumowanie ogólne79,8% zdawalność na AIME 2024 (SOTA)

Wyniki te pozycjonują DeepSeek R1 wśród najbardziej wydajnych modeli AI na świecie.

Wdrożenie

API: Punkt końcowy kompatybilny z OpenAI ($0.14/milion tokenów)

Open Source: Odważniki na licencji MIT, warianty destylowane 1.5B-70B do użytku komercyjnego.

Znajdź w Repozytorium GitHub

Model ekosystemu

Warianty: Base (R1-Zero), Enhanced (R1), 6 lekkich modeli destylowanych

Specjalizacja: Zoptymalizowany pod kątem rozwiązywania złożonych problemów, rozumienia wielu języków i generowania kodu na poziomie produkcyjnym.

Mapa drogowa

Ciągłe aktualizacje dla wsparcia multimodalnego, ulepszenia konwersacji i rozproszonej optymalizacji wnioskowania, napędzane współpracą społeczności open-source.

Open Source

Pierwszy na świecie czysty model rozumowania opracowany przez RL Z implementacją open-source 32B lekka wersja osiąga wydajność matematyczną na poziomie GPT-4 przy Niższy koszt 90%

Łańcuch myśli wizualizacja możliwości, odpowiadając na wyzwania "czarnej skrzynki" sztucznej inteligencji

Czym jest DeepSeek R1 online?

DeepSeek R1 stanowi przełomowy postęp w dziedzinie sztucznej inteligencji, oferując najnowocześniejszą wydajność w zadaniach związanych z rozumowaniem, matematyką i kodowaniem. Ten innowacyjny model demonstruje możliwości porównywalne z wiodącymi zastrzeżonymi rozwiązaniami, zachowując jednocześnie pełną dostępność open-source.

Architektura techniczna i możliwości

Architektura modelu

DeepSeek R1 wykorzystuje zaawansowaną architekturę MoE (Mixture of Experts):

- Aktywowane parametry 37B

- 671B parametry całkowite

- Obsługa długości kontekstu 128K

Framework DeepSeek R1 zawiera zaawansowane techniki uczenia się ze wzmocnieniem, wyznaczając nowe standardy w zakresie możliwości rozumowania AI.

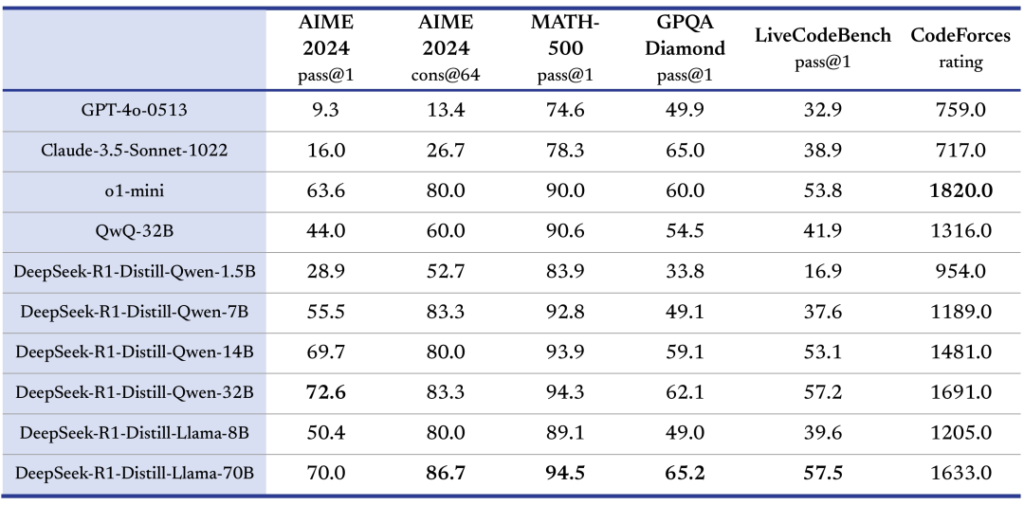

Benchmarki wydajności

DeepSeek R1 osiągnął niezwykłe wyniki w różnych testach porównawczych:

- MATH-500: dokładność 97,3%

- AIME 2024: zdawalność na poziomie 79,8%

- Codeforces: 96.3% Ranking percentylowy

Wyniki te pozycjonują DeepSeek R1 wśród najbardziej wydajnych modeli AI na świecie.

Warianty modeli i destylacja Deepseek online

Dostępne wersje

DeepSeek R1 jest dostępny w wielu wariantach:

- DeepSeek R1-Zero: Model podstawowy

- DeepSeek R1: Wersja rozszerzona

- Wiele wersji destylowanych o parametrach od 1,5B do 70B

Optymalizacja wydajności

Model ten wykazuje wyjątkowe możliwości w zakresie:

Kompleksowe rozwiązywanie problemów

Rozumowanie matematyczne

Generowanie kodu

Rozumienie języka naturalnego

Modele DeepSeek-R1-Distill (pobierz online)

| Model | Model podstawowy | Pobierz |

|---|---|---|

| DeepSeek-R1-Distill-Qwen-1.5B | Qwen2.5-Math-1.5B | HuggingFace |

| DeepSeek-R1-Distill-Qwen-7B | Qwen2.5-Math-7B | HuggingFace |

| DeepSeek-R1-Distill-Llama-8B | Llama-3.1-8B | HuggingFace |

| DeepSeek-R1-Distill-Qwen-14B | Qwen2.5-14B | HuggingFace |

| DeepSeek-R1-Distill-Qwen-32B | Qwen2.5-32B | HuggingFace |

| DeepSeek-R1-Distill-Llama-70B | Llama-3.3-70B-Instruct | HuggingFace |

Więcej informacji na temat modeli DeepSeek-R1-Distill można znaleźć pod adresem tutaj

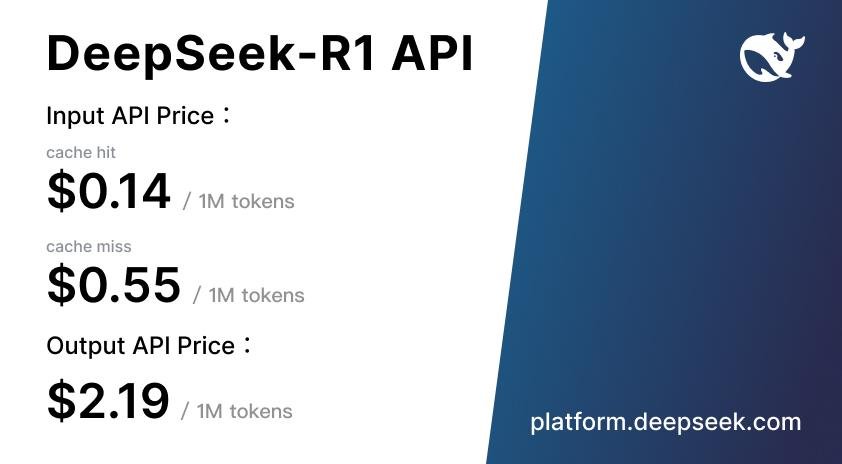

Ceny Deepseek R1

Szczegóły cennika

| MODEL(1) | DŁUGOŚĆ KONTEKSTU | MAX COT TOKENS(2) | MAKSYMALNA LICZBA TOKENÓW WYJŚCIOWYCH(3) | 1M TOKENÓW CENA WEJŚCIOWA (CACHE HIT) (4) | 1M TOKENÓW CENA WEJŚCIOWA (CACHE MISS) | 1M TOKENÓW CENA WYJŚCIOWA |

|---|---|---|---|---|---|---|

| deepseek-chat | 64K | – | 8K | $0.014 | $0.14 | $0.28 |

| deepseek-reasoner | 64K | 32K | 8K | $0.14 | $0.55 | $2.19 (6) |

Porównanie cen: DeepSeek R1 vs. OpenAI o1

1. Ceny DeepSeek R1

DeepSeek R1 oferuje bardzo konkurencyjną strukturę cenową, dzięki czemu jest znacznie bardziej przystępny cenowo niż OpenAI o1:

- Tokeny wejściowe (trafienie pamięci podręcznej): $0,14 za milion tokenów

- Tokeny wejściowe (brak pamięci podręcznej): $0,55 za milion tokenów

- Tokeny wyjściowe: $2,19 za milion tokenów

Inteligentny system buforowania zmniejsza koszty powtarzających się zapytań, zapewniając do Oszczędności 90% dla trafień z pamięci podręcznej25.

2. Ceny OpenAI o1

Z kolei OpenAI o1 jest znacznie droższy:

- Tokeny wejściowe: $15 za milion tokenów

- Tokeny wyjściowe: $60 za milion tokenów

To sprawia, że OpenAI o1 90-95% droższy niż DeepSeek R1 przy równoważnym użytkowaniu112.

3. Efektywność kosztowa

Ceny DeepSeek R1 są następujące 90-95% dolny niż OpenAI o1, oferując opłacalną alternatywę bez uszczerbku dla wydajności. Na przykład:

- 1 milion tokenów wejściowych:

- DeepSeek R1: 0.14(cachehit) lub 0.14(cachecześćt)lub0,55 (brak pamięci podręcznej)

- OpenAI o1: $15

- 1 milion tokenów wyjściowych:

- DeepSeek R1: $2.19

- OpenAI o1: $60

Ta przystępna cena sprawia, że DeepSeek R1 jest atrakcyjnym wyborem dla programistów i przedsiębiorstw1512.

4. Dodatkowe korzyści

- Dostęp open source: DeepSeek R1 jest dostępny na licencji MIT, pozwalającej na swobodne użytkowanie, modyfikację i komercjalizację512.

- Elastyczność API: Interfejs API DeepSeek R1 obsługuje zaawansowane funkcje, takie jak wnioskowanie łańcuchowe i obsługa długich kontekstów (do 128 tys. tokenów)212.

Blogi i wiadomości o Deepseek R1 i Deepseek online

-

Pojedynek czterech najlepszych modeli! Recenzja pokazuje, jak potężny jest Deepseek R1

-

Aktualizacja DeepSeek-R1-0528: Głębsze myślenie, silniejsze rozumowanie

-

DeepSeek udostępnił swój kod źródłowy i szczegółowe wyjaśnienie FlashMLA

-

Czym jest FlashMLA? Kompleksowy przewodnik po jego wpływie na jądra dekodujące AI

1,Co sprawia, że architektura DeepSeek-R1 jest wyjątkowa?

- DeepSeek R1 wykorzystuje System MoE z 37B aktywnych/671B całkowitych parametrów i obsługą 128K kontekstów, zoptymalizowany poprzez czyste uczenie ze wzmocnieniem bez nadzorowanego dostrajania.

2. Jak DeepSeek R1 wypada w porównaniu do OpenAI o1 pod względem cen?

- Koszty DeepSeek R1 90-95% mniej: 0.14/millioninputtokensvsOpenAIo1′s0.14/milliodziewięćputtokensvsOpenAIo1′s15, z równoważnymi możliwościami rozumowania.

3. Czy mogę wdrożyć DeepSeek R1 lokalnie?

- Tak, DeepSeek R1 obsługuje lokalne wdrażanie za pośrednictwem vLLM/SGLang i oferuje 6 modeli destylowanych (1,5B-70B parametrów) dla środowisk o ograniczonych zasobach.

4. Jakie testy porównawcze potwierdzają wydajność DeepSeek R1?

- Osiąga SOTA w MATH-500 (97,3%), Codeforces (96,3% percentyl) i AIME 2024 (79,8%), przewyższając większość modeli komercyjnych.

5. Czy DeepSeek R1 jest oprogramowaniem open source?

- Tak, DeepSeek R1 jest dostępny na licencji MIT z pełną wagą modelu na stronie GitHub, zezwalając na komercyjne wykorzystanie i modyfikację.

6. Jakie zdolności poznawcze wyróżniają DeepSeek R1?

- Cechy samoweryfikacja oraz Refleksja wieloetapowarozwiązywanie złożonych problemów poprzez widoczne rozumowanie łańcuchowe.

7. Które branże odnoszą największe korzyści z DeepSeek R1?

- Idealny do badań nad sztuczną inteligencją, generowania kodu korporacyjnego, modelowania matematycznego i wielojęzycznych aplikacji NLP wymagających zaawansowanego rozumowania.

8. Jak DeepSeek R1 radzi sobie z integracją API?

- Oferuje kompatybilne z OpenAI punkty końcowe API z obsługą kontekstu 128K i inteligentnym buforowaniem ($0.14/milion tokenów dla trafień w pamięci podręcznej).

9. Jakie środki bezpieczeństwa wdraża DeepSeek R1?

- Wbudowana kontrola powtórzeń (temperatura 0,5-0,7) i mechanizmy wyrównujące zapobiegają niekończącym się pętlom powszechnym w modelach trenowanych RL.

10. Gdzie mogę znaleźć dokumentację techniczną DeepSeek R1?

Dostęp do pełnych specyfikacji poprzez Dokument techniczny DeepSeek R1 oraz Dokumenty API.