Suurten tekoälymallien käytön korkeat kustannukset ovat suuri syy siihen, miksi monia tekoälysovelluksia ei ole vielä otettu käyttöön ja mainostettu. Äärimmäisen suorituskyvyn valitseminen merkitsee valtavia laskentatehokustannuksia, mikä johtaa korkeisiin käyttökustannuksiin, joita tavalliset käyttäjät eivät voi hyväksyä.

Kilpailu suurista tekoälymalleista on kuin sotaa ilman savua. Kun DeepSeek julkaisi ja avasi lähdekoodin uusimman R1-suurmallin, OpenAI julkaisi myös oman uusimman o3-mallinsa paineen alaisena. Suuri mallipelaaja Google joutui myös liittymään kovaan kilpailuun edullisista malleista.

Googlen uusi liike: Gemini-sarjan uudet jäsenet paljastettiin

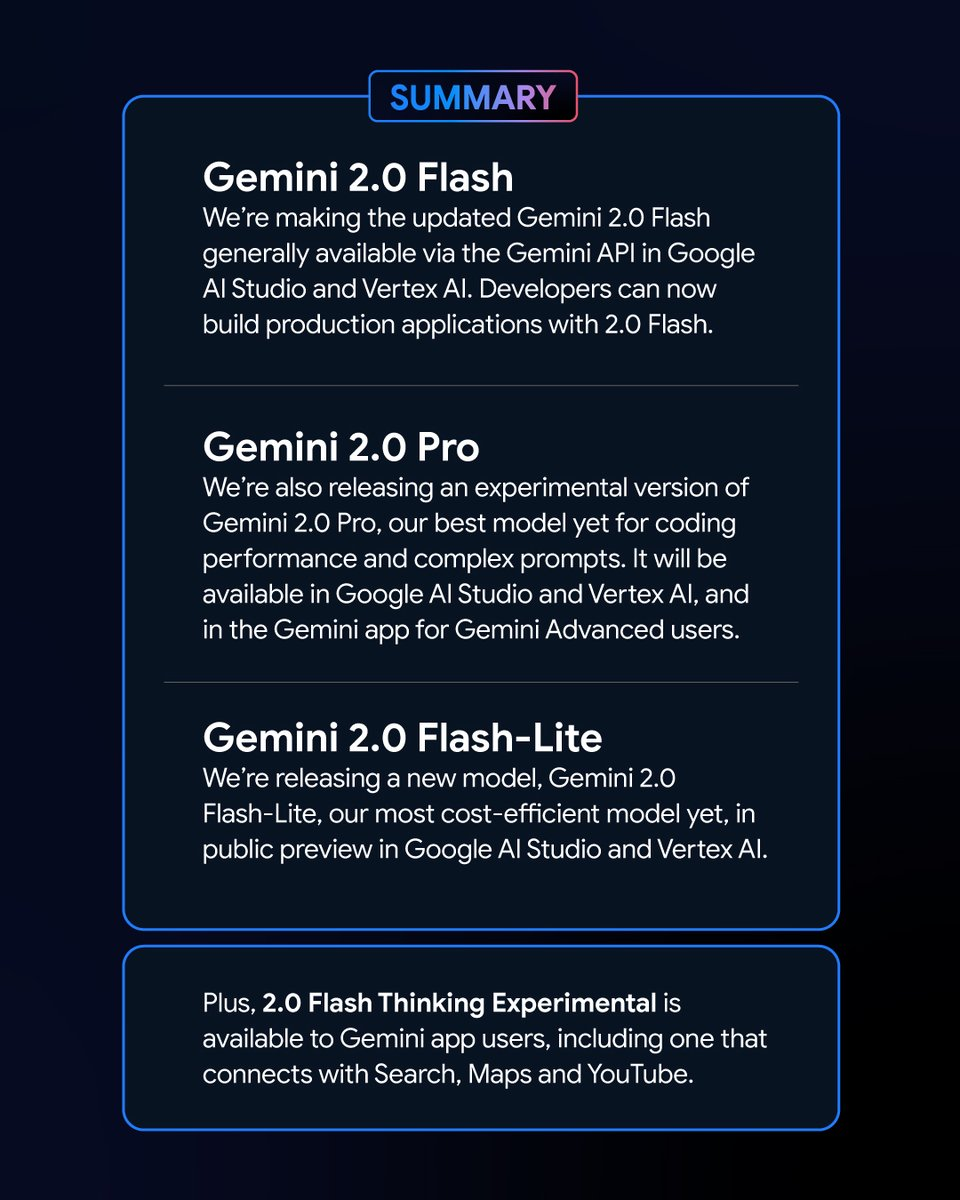

Varhain aamulla 6. helmikuuta Google julkaisi sarjan uusia versioita Gemini-mallista. Niistä kokeellinen versio Kaksoset 2.0 Pro ja Gemini 2.0 Flash – Lite -esikatseluversio herättivät paljon huomiota, ja Gemini 2.0 Flashin uusin versio julkaistiin virallisesti.

Uutena muunnelmana Google Gemini 2.0 Flash – Liten erittäin houkutteleva hinta on vain 0,3 USD miljoonalta tokenilta, joten se on Googlen edullisin malli tähän mennessä.

Gemini 2.0 Pron kokeellisessa versiossa on sen sijaan tehokkaat alkuperäiset multimodaaliset ominaisuudet, jotka voivat muuntaa tekstin ja äänen ja videon välillä.

Gemini 2.0 Flash Thinkingin kokeellinen versio on ilmainen käyttää, ja sillä on myös mahdollisuus käyttää, purkaa ja tehdä yhteenveto YouTube-videoiden sisällöstä.

Logan Kilpatrick, Google AI Studio -tuotteiden johtaja, ilmoitti X-alustalla, että nämä mallit ovat "Googlen historian tehokkaimpia malleja" ja ovat kaikkien kehittäjien saatavilla.

Uusien Gemini-mallien vaikuttava suorituskyky ja tulokset pistetaulukossa

Chatbot Arena Large Model Leaderboardissa Gemini 2.0 Flash Thinking Experimental Edition ja Gemini 2.0 Pro Experimental Edition ovat saavuttaneet erinomaisia tuloksia. Verrattuna aikaisempiin Googlen suuriin malleihin Gemini 2.0 on edistynyt huomattavasti, ja ei yllättäen, ne ovat nousseet menestyksekkäästi tulostaulukon huipulle, yhteispistemäärällä ylittäen ChatGPT-4o:n ja DeepSeek-R1:n. Tämä on valtava parannus.

Tämä tulos perustuu laajaan arvioon suurten mallien kyvyistä eri aloilla, mukaan lukien matematiikka, koodaus ja monikielinen käsittely.

Hinta ja suorituskyky: jokaisella Gemini 2.0 -versiolla on omat etunsa

Gemini 2.0:n eri versioilla on omat ominaisuutensa hinnan ja suorituskyvyn suhteen. Suorituskyvyn ja hinnan välinen tasapaino on saavutettu, mikä antaa käyttäjille enemmän valinnanvaraa. Gemini 2.0:n eri versioiden sovellusliittymiä voidaan kutsua Google AI Studion ja Vertex AI:n kautta. Kehittäjät ja käyttäjät voivat valita sopivan version tarpeidensa mukaan.

Gemini 2.0 on edistynyt ja kehittynyt huomattavasti Gemini 1.5:een verrattuna. Vaikka Gemini 2.0:n eri versioissa on eroja, niitä kaikkia on yleisesti parannettu. Erityisesti sinun on määritettävä käyttämäsi skenaario, ja sitten voit paremmin valita sinulle sopivan Gemini-mallin.

Hinnan suhteen Gemini 2.0 Flash ja Gemini 2.0 Flash – Lite keskittyvät kevyeen käyttöön. Ne tukevat jopa 1 miljoonaa merkkiä kontekstiikkunan pituudessa, ja hinnoittelun kannalta ero pitkän ja lyhyen tekstin käsittelyn välillä Gemini 1.5 Flashissa on poistettu, ja hinta on yhtenäistetty yksikköhintaan.

Gemini 2.0 Flash maksaa 0,4 USD miljoonalta tokenilta tekstin tulostamisesta, mikä on puolet Gemini 1.5 Flashin hinnasta pitkien tekstien käsittelyssä.

Gemini 2.0 Flash – Lite on kustannustehokkaampi optimointi suurissa tekstintulostusskenaarioissa, ja tekstin tulostushinta on 0,3 USD miljoonaa merkkiä kohden. Jopa Googlen toimitusjohtaja Sundar Pichai kehui sitä "tehokkaaksi ja tehokkaaksi".

Suorituskyvyn parantamisen kannalta Gemini 2.0 Flash sisältää kattavampia multimodaalisia vuorovaikutustoimintoja kuin Lite-versiossa. Sen on suunniteltu tukevan kuvatulostusta sekä kaksisuuntaista reaaliaikaista matalan viiveen syöttöä ja ulostuloa modaliteeteille, kuten tekstille, äänelle ja videolle.

Gemini 2.0 Pron kokeellinen versio on erinomainen koodaussuorituskyvyn ja monimutkaisten kehotteiden suhteen. Sen kontekstiikkuna voi saavuttaa jopa 2 miljoonaa merkkiä, ja sen yleinen kyky on kasvanut 75.8%:stä 79.1%:hen verrattuna edelliseen sukupolveen, mikä on merkittävä ero Gemini 2.0 Flashin ja Gemini 2.0 Flash – Liten koodaus- ja päättelykyvyssä.

Gemini-sovellustiimi sanoi X-alustalla, että Gemini Advanced -käyttäjät voivat käyttää Gemini 2.0 Pron kokeellista versiota mallin pudotusvalikon kautta, ja Gemini 2.0 Flash Thinking -kokeellinen versio on ilmainen Gemini-sovelluksen käyttäjille, ja tätä versiota voidaan käyttää yhdessä YouTuben, Google-haun ja Google Mapsin kanssa.

Kilpailun torjunta: Googlen mallin kustannustehokkuuskilpailu

Aikana, jolloin mallikehityksen kustannuksista on tullut alan kuuma puheenaihe, avoimen lähdekoodin, edullisen ja tehokkaan DeepSeek – R1:n lanseeraus on vaikuttanut koko toimialaan.

Googlen vuoden 2024 neljännen vuosineljänneksen talousraportin julkaisun jälkeisessä puhelinkonferenssissa Pichai tunnusti DeepSeek:n saavutukset, mutta korosti myös, että Gemini-mallisarjat ovat johtavia kustannusten, suorituskyvyn ja viiveen välisessä tasapainossa ja että niiden kokonaissuorituskyky on parempi kuin DeepSeek:n V3- ja R1-mallien.

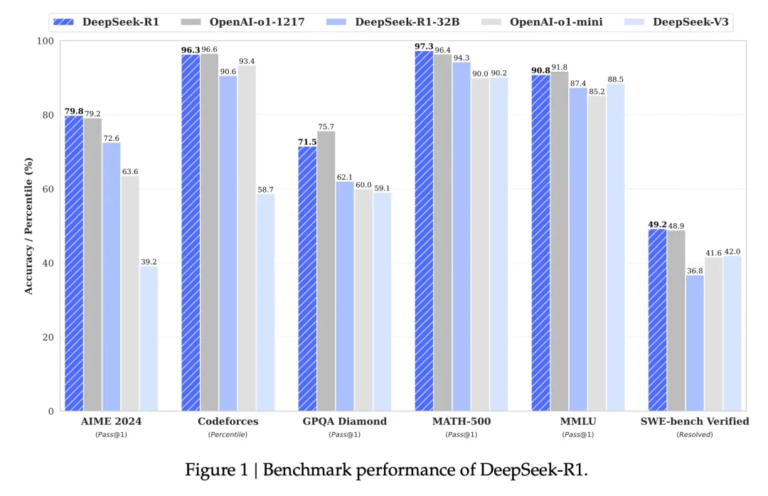

Yang Likunin ja hänen tiiminsä rakentaman LiveBenchin suuren mallin suorituskyvyn vertailutestin sijoituksen näkökulmasta Gemini 2.0 Flashin kokonaissijoitus on korkeampi kuin DeepSeek V3:n ja OpenAI:n o1 – minin, mutta se on jäljessä DeepSeek – R1:stä ja OpenAI:n o1:stä. Googlen julkaisu Gemini 2.0 Flash – Lite on kuitenkin kuin valttikortti. Google toivoo voivansa tehdä uusimmista suurista malleista kohtuuhintaisia useammalle ihmiselle, alentaa käyttäjien käyttökustannuksia ja ottavansa paikan yritysten välisessä kilpailussa hinta/suorituskyvystä.

Kun Google julkaisi uusin Gemini 2.0, nettimies alkoi kokeilla ja analysoida Gemini 2.0 Flashia ja muita suosittuja deepseek- ja openai GPT-4o -malleja yksin. Hän havaitsi, että Gemini 2.0 Flashin uusi versio on suorituskyvyltään ja kustannuksiltaan parempi kuin kaksi muuta mallia. Tämä antaa meille myös kuvan Googlen kehityksestä ja kehityksestä, ja se on hyvä alku.

Tarkemmin sanottuna Gemini 2.0 Flash maksaa 0,1 USD miljoonalta tokeneilta syötteeltä ja 0,4 USD lähtöltä, jotka molemmat ovat paljon alhaisempia kuin DeepSeek V3. Tämä on valtava parannus ja kehitys. Netizen huomautti myös X-alustalla: "Gemini 2.0 Flashin virallinen versio maksaa kolmanneksen GPT-4o-ministä, kun taas se on kolme kertaa nopeampi."

Uusi trendi suurilla mallimarkkinoilla: vastinetta rahalle on kuningas

Nykyään laaja mallikenttä on joutunut uuteen hintasotaan. Aiemmin suurten mallien käytön korkeat kustannukset ovat aiheuttaneet jonkin verran vastustusta niiden käytölle ja edistämiselle. DeepSeek:n laukaiseman suurten mallien hintasodan vaikutus ulkomaisten suurten mallien markkinoille jatkuu edelleen. Samalla avoimen lähdekoodin vaihtoehto on myös mahdollistanut useammille käyttäjille uusimpien suurten mallien tutkimusten ymmärtämisen ja käytön. Avoimen lähdekoodin + alhainen hinta -strategia on myös aiheuttanut paineita monille amerikkalaisille suurille malliyrityksille.

Google julkaisi Gemini 2.0 Flash-Liten ja OpenAI toi ChatGPT-hakutoiminnon vapaasti kaikkien käyttäjien saataville, jotta käyttäjät voivat käyttää hakutoimintoa monipuolisempiin tehtäviin. Metan sisäinen tiimi myös tehostaa tutkimusta suurten mallien hinnanalennusstrategioista ja edistää Metan avoimen lähdekoodin suurten mallien jatkokehitystä.

Tällä erittäin kilpaillulla alalla mikään yritys ei voi istua mukavasti ykköspaikalla. Yritykset yrittävät houkutella ja pitää käyttäjiä parantamalla kustannustehokkuutta. Tämä suuntaus auttaa suuria malleja siirtymään puhtaasta teknologiakehityksestä laajempiin sovelluksiin, ja tulevaisuuden suuret mallimarkkinat jatkavat kehitystä ja muutosta kilpailussa kustannustehokkuudesta.